live555专题

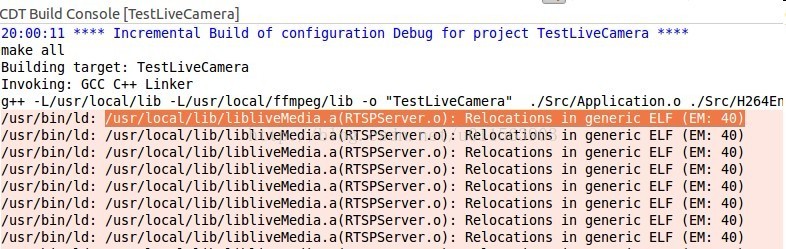

在嵌入式板子上搭建和自定义live555服务器---编译问题和方法整理

live555 官方网站 点我直达,live555是一个简单的专注于实现RTSP服务器的开源库。它自带解析H264 H265 mp3等源的API,有一个简单的推流文件参考RTSP服务器例程testH264VideoStreamer也有官方实现的LIVE555 Media Server。无论是命令行使用还是用API实现定制需求是很方便的。 图龙宝刀点击下载 文章目录 live555

live555学习笔记(二)

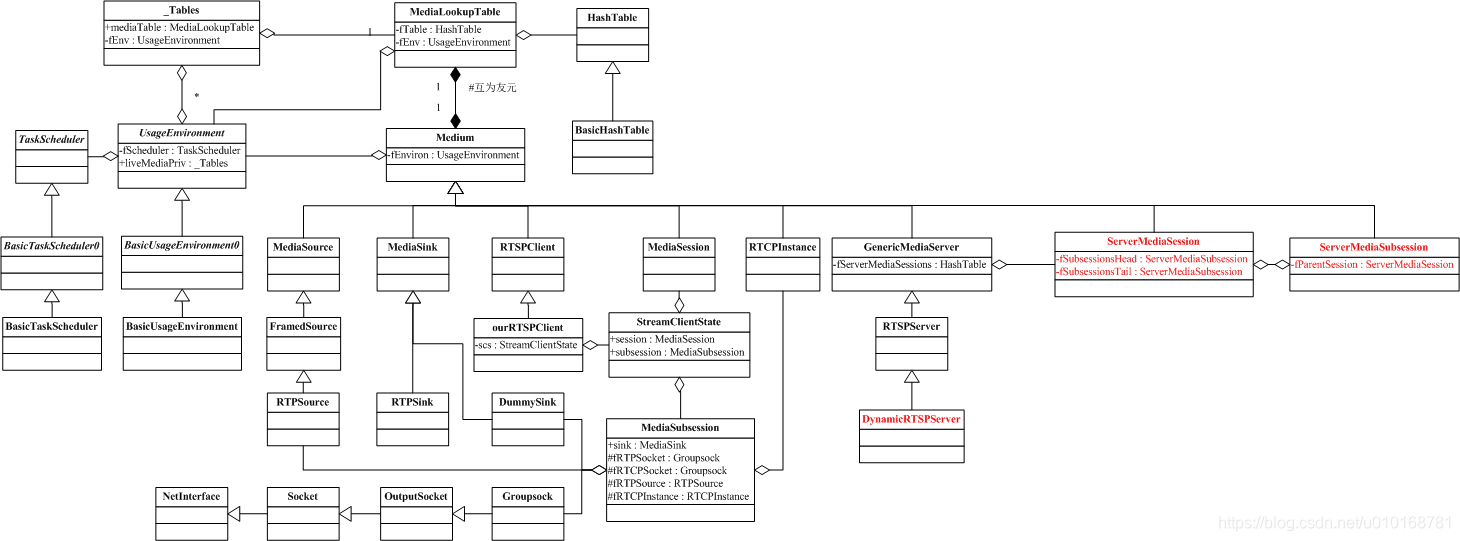

live555学习笔记之源码结构分析 live项目包括了四个基本库、程序入口类(mediaServer)和一些测试代码(testProgs)。 四个基本库: 1、UsageEnvironment 环境类,用于错误信息的输出 包括三个抽象类UsageEnvironment、TaskScheduler、HashTable UsageEnvironment、TaskScheduler

live555笔记(一)

刚接触IPC行业,准备学习rtsp server,rtsp常用的开源项目是live555 1、简介 是一个为流媒体提供解决方案的跨平台的C++开源项目,它实现了对标准流媒体传输是一个为流媒体提供解决方案的跨平台的C++开源项目,它实现了对标准流媒体传输协议如RTP/RTCP、RTSP、SIP等的支持。Live555实现了对多种音视频编码格式的音视频数据的流化、接收和处理等支持,包括MPE

live555实现直播

网上有大神已经把源码贴出来了,我正在实验, http://www.cnblogs.com/mlj318/archive/2013/01/23/2872932.html http://blog.csdn.net/firehood_/article/details/16844397 感谢这俩大神的分享 这位大神的博客讲LIVE555讲的不错 http://blog.csdn.net/niu

live555直播usb 摄像头实现流媒体服务

题记:本篇博客是根据http://blog.csdn.net/nieyongs/article/details/17919325,的基础上,对于其环境的搭建做一阐述,记之防止遗忘。首先感谢博主,能够将自己调试的原码分享,但是下载的代码是不能运行的,缺少库的支撑。下面就将环境的搭建包括库函数的引用及头文件,做一说明。 1 库文件。 a:首先要先安装ffmpeg和x264编码。网上有很很多教程,但

LIVE555学习5:testOnDemandRTSPServer例程解析

文章目录 1 主函数2 ServerMediaSession3 Source 和 Sink 关于testOnDemandRTSPServer例程分析,网上有很多文章,有些写的非常详细,将涉及到的每个函数以及类进行了详细讲解,看了之后很有收获,可是让自己写是如何也写不出来的。只是将自己输入的内容有个输出,防止以后遗忘。。。 1 主函数 主函数如下,只列出了H264,去掉了其他类

LIVE555学习4:live555MediaServer讲解——如何根据指定文件后缀创建ServerMediaSession

在前面《LIVE555学习1:Linux下live555的编译及测试》中,当我们运行起可执行程序live555MediaServer,在VLC中输入rtsp://192.168.1.100/Titanic.ts, 便可以播放ts流。当我们输入其他格式,如H264、H265、aac等,均可以输出对应流。但是在主函数中,只创建了一个RTSPServer实例,并没有创建这些对应不同格式文件的Server

LIVE555学习2:live555代码目录结构

文章目录 1 源码下载2 文档说明3 简单介绍4 目录结构4.1 UsageEnvironment4.2 groupsock4.3 liveMedia4.4 BasicUsageEnvironment4.5 testProgs4.5.1 RTSP client端相关测试用例4.5.1.1 openRTSP4.5.1.2 testRTSPClient 4.5.2 RTSP server端相关测

LIVE555学习1:Linux下live555的编译及测试

以下为在linux下编译和测试live555的全部过程。 文章目录 1 源码下载2 编译3 测试 1 源码下载 官网地址:http://www.live555.com/liveMedia/public/ 打开后,选择live555-latest.tar.gz 2 编译 在主目录下创建文件config.3516c,内容如下: CROSS_COMPILE?= COMPIL

【Live555】live555源码详解(九):ServerMediaSession、ServerMediaSubsession、live555MediaServer

【目录】郭老二博文之:图像视频汇总 【Live555】live555源码详解系列笔记 继承协作关系图 下面红色表示本博客将要介绍的三个类所在的位置: ServerMediaSession、ServerMediaSubsession、DynamicRTSPServer DynamicRTSPServer是live555MediaServer中实现的类,用来创建RTSP服务器 17、Serv

live555 源码分析: DESCRIBE 的处理

前面在 live555 源码分析:RTSPServer 中分析了 live555 中处理 RTSP 请求的大体流程,并分析了处理起来没有那么复杂的一些方法,如 OPTIONS,GET_PARAMETER,SET_PARAMETER 等。篇幅所限,没有分析最为重要的 DESCRIBE,SETUP 和 PLAY 这些方法的处理。 本文继续分析 live555 对 RTSP 请求,分析 DESCRIB

live555 源码分析:RTSPServer

live555 使用 RTSP/RTP/RTCP 协议来实现流媒体的传输,其中使用 RTSP 来建立流媒体会话,并对流媒体会话进行控制。在 live555 中,通过类 RTSPServerSupportingHTTPStreaming::RTSPClientConnectionSupportingHTTPStreaming 来处理 RTSP 请求。客户端发送过来的请求在其父类 GenericMed

VS2015 编译live555源码

编译过程略了,只需要设置好环境,编译出库,解决依赖就差不多了 github地址: https://github.com/tanningzhong/live555-20161011-vs2015

V4L2+FFMPEG+live555实现流媒体服务端

源码下载地址:源码下载 <span style="font-size: 14px; font-family: Arial, Helvetica, sans-serif; background-color: rgb(255, 255, 255);">代码主要参考了如下一篇博客,当然还有其它很多代码,就不一一列举了。</span> 博客链接:http://blog.csdn.net/nieyong

基于live555的一个简单RTSP服务器

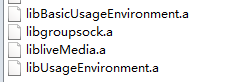

1,编译live555源码目录下的 BasicUsageEnvironment、groupsock、liveMedia、UsageEnvironment四个工程生成相应的库文件; 目录结构如下: 2,包含上面四个工程目录下的include目录文件和生成的库文件,编译mediaServer目录下的文件,会生成相应的exe文件(在windows下编译生exe,在linux下可以生成相应的运行程序

live555转发H264实时流实现直播的实现

本文介绍了在树莓派上通过live555实现了从树莓派的USB端口获取到的H264码流的实时直播的功能。 GitHub:https://github.com/SkyDreamcode/live555H264-V4l2LiveStreaming.git live555实现直播的方式是以testProgs/testOnDemandRTSPServer.cpp文件为参照对象。但是查看这个源码文件实现的

使用live555类库实现的网络直播系统——直播H264文件

下载live555最新代码,编译生成live555 的库文件:libBasicUsageEnvironment.a libgroupsock.a libliveMedia.a libUsageEnvironment.a ,使用这4个库再加上live555 自带的测试程序,可以很简单的实现live555 的直播。live555提供的直播程序是只能直播之前已经录制好的视频(与点播不同)。

在工作中,C、C++密不可分,做我们嵌入式方面的,当然更多的是C,但,有时候却少不了C++,而且是C、C++混搭(混合编程)在一起的,比如,RTP视频传输,live555多媒体播放等都是C++下的,他

深入理解C/C++混合编程(关于#ifdef __cplusplus extern "C" {...}的用法) 在工作中,C、C++密不可分,做我们嵌入式方面的,当然更多的是C,但,有时候却少不了C++,而且是C、C++混搭(混合编程)在一起的,比如,RTP视频传输,live555多媒体播放等都是C++下的,他需要调用JRTPLIB库,再比如,我那邮件发送,我也用C++写的,定义了一个Em

live555 实现音视频传输关键

1.fDurationInMicroseconds 设置一定要正确 2.fPresentationTime 设置一定要正确 3.用流的下一帧减去上一帧的时间差作为fPresentationTime的时间增量是不可取的,因为这样就默认了音视频获取到的相同时间的帧对应的时间戳是相同的 。但是实际中未必是这样 ,音画不同步可能就出现在这里 。

live555 fNumTruncatedBytes〉0

fNumTruncatedBytes >0 的情况。 1.在继承了Live555的FrameSource类的自定义类中,一定要override下面的方法: virtual unsigned maxFrameSize() const { return 100*1024; //根据实际情况设置一个合理的值 } 2.可以看到,parser中是有自己的缓冲的,而且其大小是固定的:

关于客户端和服务器端live555的一点bug修改

客户端主要出错信息: MultiFramedRTPSource error: Hit limit when reading incoming packet over TCP. Increase \"MAX_PACKET_SIZE\" RTCPInstance error: Hit limit [1450,1450] when reading incoming packet ove

live555学习笔记17-H264VideoStreamParser详解 .

十七:H264VideoStreamParser详解 很多人要做实时H264 RTP传输,那么如何充分利用live555来做呢? 大家可以看到现有的H264VideoFileServerMediaSubsession中,sink使用了H264VideoRTPSink,source使用了H264VideoStreamFramer,然而这个连接是很复杂的,在这两个节点间要插入了很多其它的节点,其

用live555将内网摄像机视频推送到外网服务器

最近很多人问,如何将内网的摄像机流媒体数据发布到公网,如果用公网与局域网间的端口映射方式太过麻烦,一个摄像机要做一组映射,而且不是每一个局域网都是有固定ip地址,即使外网主机配置好了每一个摄像机的映射地址,也有可能会因为宽带公网ip地址变动而导致配置无效。 再换一个应用场景,当我们的所有IP摄像机都部署在一个没有有线网络的环境里面,所有的流媒体数据都要通过3G/4G网络发布出去。那么就必

用Darwin和live555实现的直播框架

我们在开发视频直播或者监控类项目的时候,如场馆监控、学校监控、车载监控等等,往往首先希望的是形成一个项目的雏形,然后再在这个框架的基础上进行不断的完善和扩展工作,那么我们今天要给大家介绍的就是,如何形成一个这样的框架: 采集本地音视频数据(Win) -->视频分发服务器-->客户端随意接入 大致流程:我们首先通过DShow采集Windows(XP、Win7经过测试)主机的视频设备(Cam

linux下编译live555

在live555的官网上已经有linux下编译的说明,如下: How to configure and build the code on Unix (including Linux, Mac OS X, QNX, and other Posix-compliant systems) The source code package can be found (as a ".tar.gz"

live555 交叉编译移植到海思开发板

本文章参考了。http://blog.csdn.net/lawishere/article/details/8182952,写了hi3518的配置说明。特此感谢 1、首先到它的主页下载一个源码包: http://www.live555.com/liveMedia/public/ 我下载的是latest的,具体什么版本还真不清楚 2、放到linux目录下解压: root@kubun