iclr2023专题

ICLR2023 | 基于几何结构预训练的蛋白质表示学习

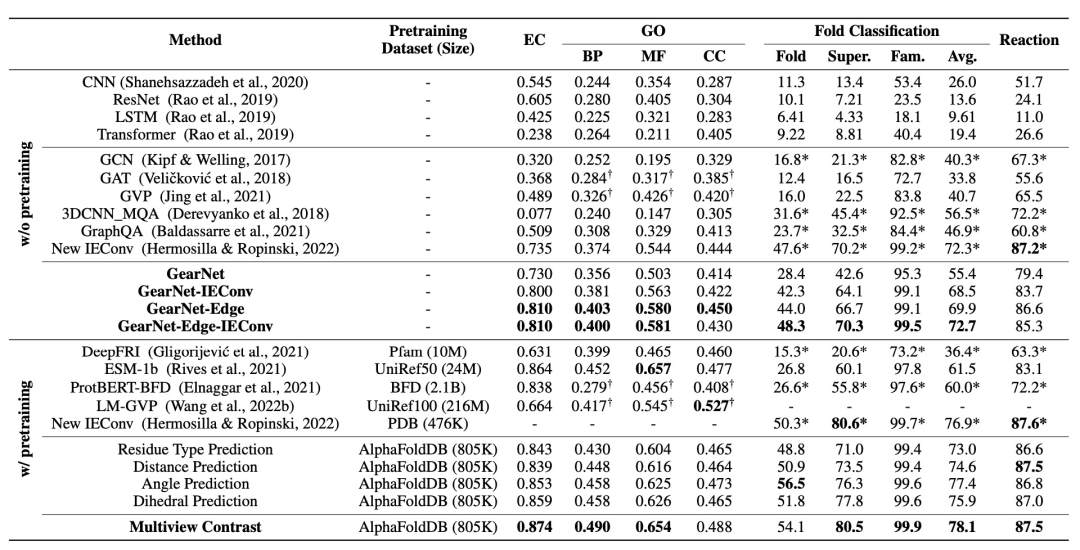

今天为大家介绍的是来自唐建老师团队的一篇关于蛋白质预训练的论文。学习有效的蛋白质表示对于预测蛋白质功能或结构等生物学任务至关重要。现有的方法通常在大量未标记的氨基酸序列上预训练蛋白质语言模型,然后在下游任务中使用一些标记数据微调模型。尽管基于序列的方法有效,但是基于蛋白质结构的预训练还未被探索,因为已知的蛋白质结构数量较少。为此,作者提出了根据蛋白质的三维结构预训练蛋白质表示的方法。在功能预测等

4.10论文阅读 ICLR2023

Adversarial Training of self-supervised Monocular Depth Estimation Against Physical-World Attacks 摘要 作者首先表明了针对MDE的对抗攻击,尤其是物理世界的真实攻击对深度估计系统是个巨大的威胁。传统的对抗训练需要真实标注,这并不适用于自监督深度估计。一些强化自监督模型的技术,例如对比学习,忽略了M

ICLR2023 | RetMol:基于检索的可控分子生成

题目:Retrieval-based Controllable Molecule Generation 文章地址:https://openreview.net/pdf?id=vDFA1tpuLvk 代码地址:GitHub - NVlabs/RetMol: A new retrieval-based framework for controllable molecule generation.

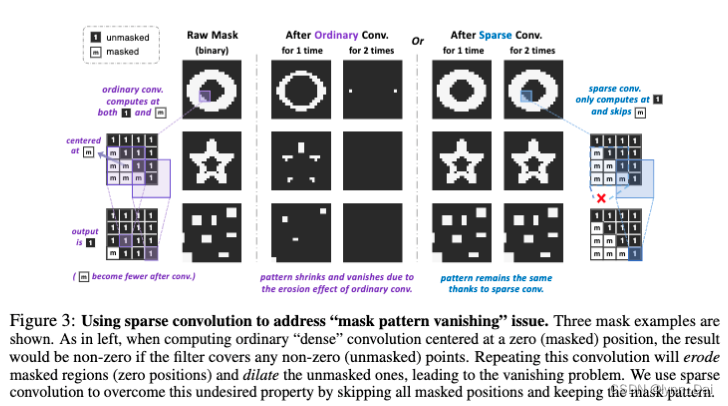

【iclr2023】DESIGNING BERT FOR CONVOLUTIONAL NETWORKS: SPARSE AND HIERARCHICAL MASKED MODELING

论文 & 代码 & Notable-top-25% 摘要 我们发现并攻克了将BERT-style预训练或者图像mask建模应用到CNN中的两个关键障碍:1) CNN不能处理不规则的、随机的掩码输入图像;2)BERT预训练的单尺度性质与convnet的层次结构不一致 对于第一点,我们将没有被mask掉的像素点视作为3d点云(点云是一种方便的3D表达方式)的稀疏体素;使用sparse CNN进行