h264专题

【音视频】播放音视频时发生了什么? 视频的编解码 H264是什么? MP4是什么?

目录 ✨播放一个视频的流程✨为什么要编码(压缩)视频数据?✨如何编码(压缩)数据🎄简单的例子🎄音视频编码方式🎄视频编码格式H264编码是什么?发展历程?H.264基本单元H.264的I帧,P帧,B帧 🎄音频编码格式 ✨视频文件封装格式✨解封装格式✨视频解码✨H264分层结构🎄网络上传输H264视频数据的流程VCL的结构关系 🎄NAL单元 ✨ 参考文章 ✨播放一个视频的流

【Android 多媒体应用】使用MediaCodec将摄像头采集的视频编码为h264

转载自:http://www.cnblogs.com/CoderTian/p/6224605.html MainActivity.java import android.app.Activity;import android.graphics.ImageFormat;import android.hardware.Camera;import android.hardware.Camera

H264的句法和语义(二)

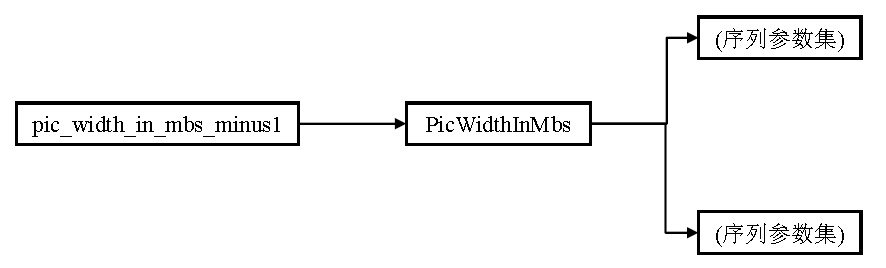

1.2 句法元素的分层结构 1.2.1 句法元素与变量 编码器将数据编码为句法元素然后依次发送。在解码器端,通常要将句法元素作求值计算,得出一些中间数据,这些中间数据就是H.264定义的变量。 图1 从句法元素解出变量 pic_width_in_mbs_minus1 是解码器直接从码流中提取的句法元素,这个句法元素表征图像的宽度以宏块为单位。我们看到,为了

H264视频压缩编码标准(四)

4.变换与量化 4.1树状结构运动补偿 –每个宏块(16×16像素)可以4种方式分割:一个16×16,两个16×8,两个8×16,四个8×8。其运动补偿也相应有四种。而8×8分割还可以有四种方式的分割:一个8×8,两个4×8或两个8×4及4个4×4。这种分割下的运动补偿则称为树状结构运动补偿。

ffmpeg h264解码, 屏蔽因为网络丢包等各种原因导致的花屏帧

ffmpeg h264解码, 屏蔽因为网络丢包等各种原因导致的花屏帧 ---->看来问题只能这样解决了,现在还要多测测,防止产生新的问题。目前来看,对现有代码没有影响,花屏的帧直接屏蔽掉了。 思路: 问了下机顶盒方面h264解码的,他们用的是硬件解码,他们做到不花屏的方法就是简单的设置了一个硬件解码提供的接口:设置了错误处理模式。 我想这个错误处理模式肯定对那些错误的帧直接屏

在安卓和Windows下使用Vizario H264 RTSP

Unity2021.3.35f1,运行模式为ENGINE_SERVER 1.环境设置 Windows设置 安卓设置 2.代码修改 ConnectionProperties中的server必须与真实IP一样,所以需要新增一个获取IP的函数 public string GetLocalIPAddress(){IPHostEntry host;string localIP = "

cefsharp128_cef128_chromium6613_x64_h264版本抢险体验

一、本博测试版本cef128及兼容性测试 1.1 版本 128.0.6613.x (全网保持最新更新测试体验) 感谢您:关注我,关注栏目,总有您想要的资源,推荐好友有优惠 1.2 兼容性测试,支持h264 1.3 视频播放测试 版本兼容 cef128.xx.xx <

H264结构及RTP封装

H264是一种针对视频的压缩编码方式。 一、压缩方法 H264主要基于以下几种方法,将数据进行压缩: 1.帧内预测压缩:解决空间域数据冗余的问题 2.帧间预测压缩:(运动估计与补偿)解决时间域数据冗余的问题 3.整数离散余弦变换(DCT):将空间上的相关性转换为频域上的无关性,然后量化 二、压缩后数据 压缩后,H264文件由I帧、B帧、

H264编码原理(二)帧内预测

假设你去了一家餐厅吃饭,这家餐厅提供了一个有趣的点餐方式。服务员会根据餐厅最近最受欢迎的菜品组合,推荐九个套餐给你。你的任务是从这九个套餐中找到一个最接近你心中想要的菜品组合的套餐,然后告诉服务员你想替换哪些菜,以得到你理想中的一餐。 通过这种点餐方式,你可以迅速找到与你所想菜品最接近的套餐,只需做少量的调整就能得到满意的组合。 类似地,在H.264编码中,编码器选择一个最合适的预测模式,通过

H264码流结构讲解

所谓的码流结构就是指:视频经过编码之后所得到的数据是怎样排列的,换句话说,就是编码后的码流我们该如何将一帧一帧的数据分离开来,哪一块数据是一帧图像,哪一块是另外一帧图像,只要了解了这个,后面的事情就好办了。 1.H264帧的定义 在H264编码中有I帧,p帧和B帧。每一帧都相当于一张静止的图像。在实际的码流传输中会利用编码器来压缩图像以减少视频的体积,其中I帧、P帧、B帧最为常

基于FFMPEG读取摄像头图像编码为h264

1.调用ffmpeg命令采集摄像头图像 $ ffmpeg -f v4l2 -framerate 30 -video_size 1280*720 -i /dev/video0 -c:v libx264 -preset veryfast -f h264 output.h264 -f v4l2: 指定输入设备采用Video4Linux2框架。 -framerate 30: 设置帧率为30。

H264编码原理(一)压缩背后的秘密

一、引言 在当今的数字视频世界中,H.264编码技术无疑占据着至关重要的位置。虽然H.264编码原理可能听起来复杂又深奥,但只要深入了解视频的特性,就能明白为什么它需要如此设计。通过利用视频内容的冗余性和人眼的感知特性,H.264能够显著提高视频的压缩效率,同时保持较高的视觉质量。本文将带您一探究竟,揭示H.264编码技术的核心原理,并对其与其他前沿编码格式的对比进行详细阐述。 二、为什么视频

Ubuntu 安装 ffmpeg , 支持MP3,H264编码

转自:http://blog.csdn.net/s170262941/article/details/23437689 编译支持MP3,H264编码的ffmpeg ffmpeg原有的系统中支持mp3和h264的解码,但是编码并不支持,所以,需要是应用第三方插件进行支持; 从configure --help可以看出: 点击(此处)折叠或打开 [StevenLiu@

H264 视频文件 帧格式 传输封装等 杂碎

rfc3984 Standards Track [Page 2] RFC 3984 RTP Payload Format for H.264 Video February 2005 1. 按照RFC3984协议实现H264视频流媒体 nalu单元 包起始 0x 00 00 00 01 H.264 NAL格式及分析器 http://hi.baidu.com/zsw%5Fdavy/b ...

利用ffmpeg将任意格式的视频转码为h264编码的mp4格式视频

h264(h265)编码的mp4格式为浏览器支持的视频格式,即通过浏览器(chrome等)可以打开本地或在线的h264(h265)编码的mp4视频文件。 参考文档1,ffmpeg mp4转h264、h265命令模式 https://blog.csdn.net/shizao/article/details/108578096 2,JavaCV:将任意视频转码为h264编码的mp4格式视频 htt

H264 获取SPS与PPS

转载地址 H264 获取SPS与PPS 在用Android手机进行h264硬编码的时候如果要进行视频流的实时传输与播放,就需要知道视频流的Sequence Parameter Sets (SPS) 和Picture Parameter Set (PPS)。 今天算是看明白如何获取SPS和PPS,在这里记录下来,希望有需要的朋友可以在这里获取到一些些的帮助。 首先说一下大前提,我设置的

FFmpeg AAC文件和H264文件合成MP4/FLV文件

使用FFmpeg库把AAC文件和H264文件合成MP4/FLV文件,FFmpeg版本为4.4.2-0。 需要aac和h264测试文件的,可以从我上传的MP4文件中用ffmpeg提取,命令如下: ffmpeg -i <input.mp4> -map 0:v -c:v copy <output.h264> -map 0:a -c:a copy <output.aac> 代码如下: #i

毕设系列之JrtpLib H264(裸视频数据) 实时视频传输(发送与接受)

#PS:要转载请注明出处,本人版权所有 #PS:这个只是 《 我自己 》理解,如果和你的 #原则相冲突,请谅解,勿喷 开发环境:Linux 4.8.0-36-generic #36~16.04.1-Ubuntu SMP Sun Feb 5 09:39:57 UTC 2017 x86_64 x86_64 x86_64 GNU/Linux 1 首先直接下载源代码,查看其中的example1

毕设系列之Libx264实时视频流(YUV 420P转H264视频编码篇)

#PS:要转载请注明出处,本人版权所有 #PS:这个只是 《 我自己 》理解,如果和你的 #原则相冲突,请谅解,勿喷 开发环境:Ubuntu 16.04 LTS 本文的技术实现部分参考雷博士的这篇文章。http://blog.csdn.net/leixiaohua1020/article/details/42078645 1、现在网上关于H264的文章有很多,但是我个人认为最好的就是

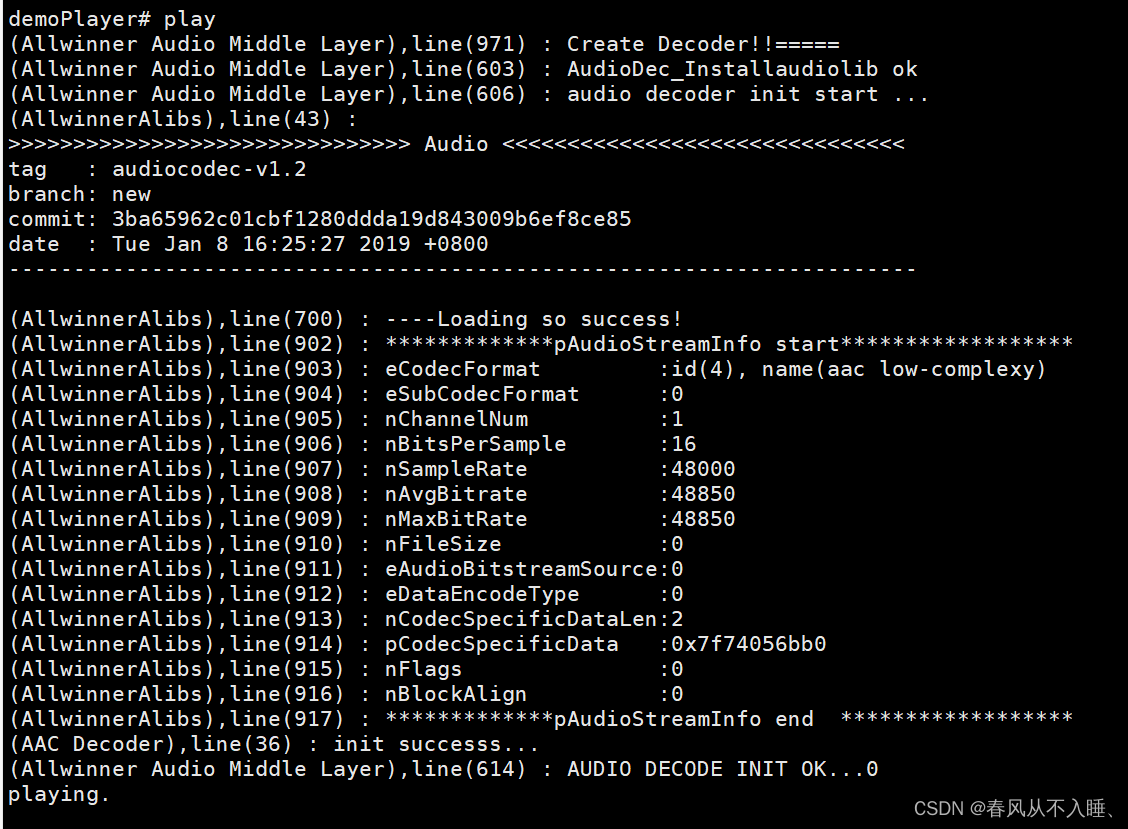

全志摄像头屏幕预览、录制(H264)

一、录像 使用dvr_test录制视频 运行dvr_test demo出现space not enought问题,修改/etc/dvrconfig.ini文件下对应的camera节点下cur_filedir属性无效 修改以下内容解决; 录制时出现摄像头画面异常,如下 摄像头型号与打印信息匹配: 但是出现画面异常,考虑是否只支持720P,尝试修改 路径:vi

android H264码流中的SPS获取

此文对于想要了解如何获取h264码流中SPS参数的过程,但是又不是很熟悉h264的朋友会很有帮助!! This is a follow-up to my World’s Smallest h.264 Encoder post. I’ve received several emails asking about precise details of things in two enti

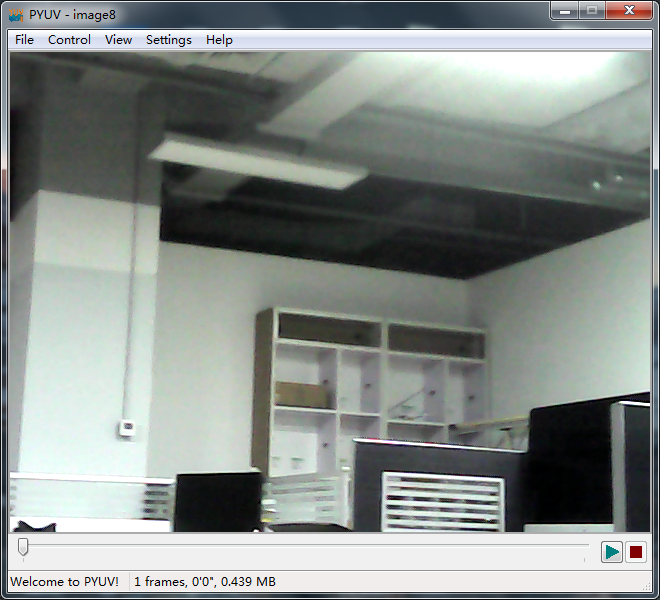

V4L2视频采集与H264编码2—v4l2采集YUV数据

在上一篇中因为是在PC机上使用的USB摄像头只能支持GPEG image格式,但是H264编码需要使用YUV数据,所以我找了个ARM开发板来做测试。本以为代码从PC机移植到开发板是很简单的一个事,谁知因为平台或是V4L2底层驱动的不同,最终也是花了九牛二虎之力才把问题给解了。话不多说,直接上代码: [objc] view plain copy /*===========

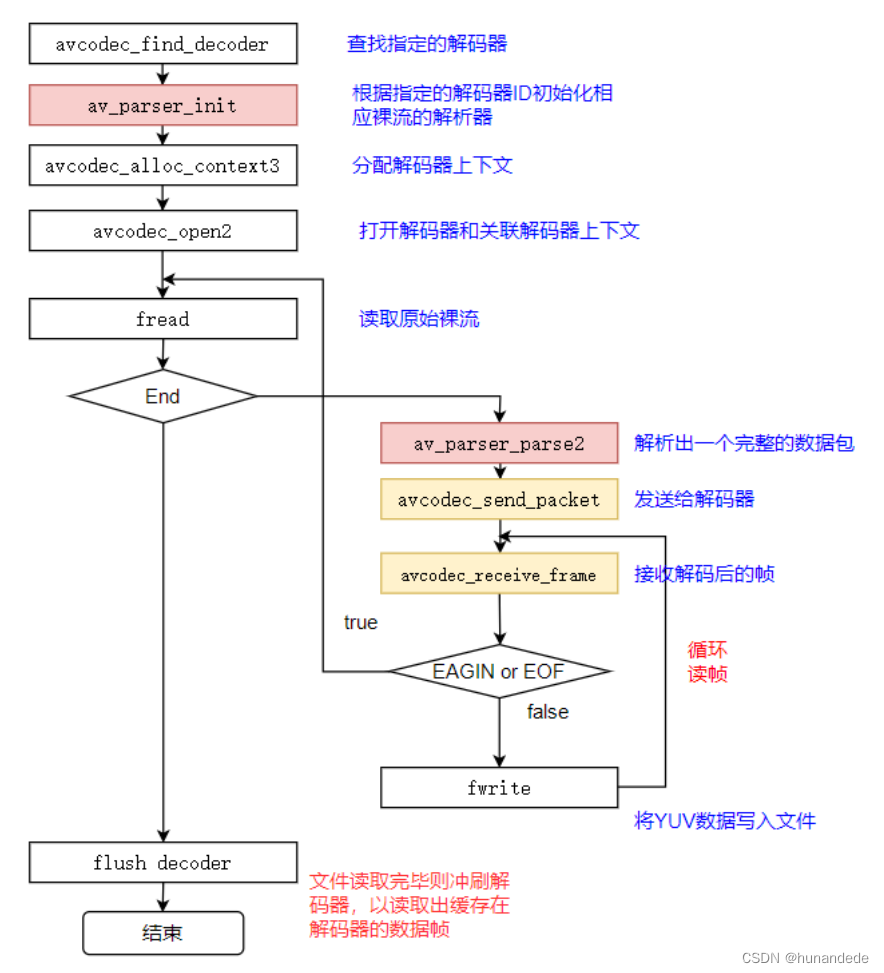

音视频开发19 FFmpeg 视频解码- 将 h264 转化成 yuv

视频解码过程 视频解码过程如下图所示: ⼀般解出来的是420p FFmpeg流程 这里的流程是和音频的解码过程一样的,不同的只有在存储YUV数据的时候的形式 存储YUV 数据 如果知道YUV 数据的格式 前提:这里我们打开的h264文件,默认是YUV420P 格式的, 我们可以通过 AVFrame->frame 获得,获得的值如果

ffmpeg视频编码原理和实战-(4)H264原始码流分析

H.264是一种广泛使用的视频编码标准,它采用一种分层结构,其中最重要的一个层是NAL(网络抽象层)。在H.264编码中,原始码流(bitstream)是由多个NALU(NAL Units)组成的。了解NALU 对于解析和处理H.264视频流非常重要。 NALU(NAL 单元) NALU 是H.264码流的基本单元,每个NALU包含一个头部和有效载荷。以下是NALU的详细结构和功能: 1.

iOS h264 硬解

记录。 http://www.voidcn.com/blog/dongtinghong/article/p-5047279.html 首先要把 VideoToolbox.framework 添加到工程里,并且包含以下头文件。 #include <VideoToolbox/VideoToolbox.h> 解码主要需要以下三个函数 VTDecompressionS

音视频开发—H264 SPS 和 PPS 参数说明

文章目录 序列参数集 (SPS, Sequence Parameter Set)SPS的主要内容: 图像参数集 (PPS, Picture Parameter Set)PPS的主要内容: Slice Header 结构 在H.264视频编码标准中,SPS和PPS是关键的参数集,它们提供了解码所需的各种配置信息。它们分别存储在单独的NALU中,并用于初始化解码器的参数。 序列参