eye专题

np.identity和np.eye

numpy.identity(n, dtype=None) >>> np.identity(3)array([[ 1., 0., 0.],[ 0., 1., 0.],[ 0., 0., 1.]]) numpy.eye(N, M=None, k=0, dtype=< class ‘float’>, order=’C’) Parameters: N : int 行数 M : i

AI播客下载:Eye on AI(AI深度洞察)

"Eye on A.I." 是一档双周播客节目,由长期担任《纽约时报》记者的 Craig S. Smith 主持。在每一集中,Craig 都会与在人工智能领域产生影响的人们交谈。该播客的目的是将渐进的进步置于更广阔的背景中,并考虑发展中的技术的全球影响。人工智能即将改变你的世界,所以请留意。 主持人Craig是纽时多年资深记者,现美国国家人工智能安全委员会(NSCAI)特别雇员。最新一期

【多视图感知】BEVFormer: Learning Bird’s-Eye-View Representation

BEVFormer: Learning Bird’s-Eye-View Representation from Multi-Camera Images via Spatiotemporal Transformers 论文链接:http://arxiv.org/abs/2203.17270 代码链接:https://github.com/fundamentalvision/BEVFormer

matlab中的size()、magic()、eye()函数

1、size():获取矩阵的行数和列数 ① s=size(A),当只有一个输出参数时,返回一个行向量,该行向量的第一个元素是矩阵的行数,第二个元素是矩阵的列数。 ② [r,c]=size(A),当有两个输出参数时,size函数将矩阵的行数返回到第一个输出变量r,将矩阵的列数返回到第二个输出变量c。 ③ size(A,n)如果在size函数的输入参数中再添加一项n,并用1或2为n赋值

梅花香自苦寒来 ----议张恂《笑看JavaEye软工坛之叽叽喳喳》

梅花香自苦寒来 ----议张恂《笑看JavaEye软工坛之叽叽喳喳》 序 从J2EE阵营走出来已经半年了,这时间一直在中国一家一流电信设备商从事C++程序开发工作。如果你没有这样的经历,你是不会知道刚来时有多么的压抑?要知道转方向对于我们从事IT业的人来说是多么的困难,更何况是从应用软件走到系统软件,现在的很多开发人员不也是被牵着鼻子走么? 那时不仅对自己的决定产生了怀疑,虽然部门过了CM

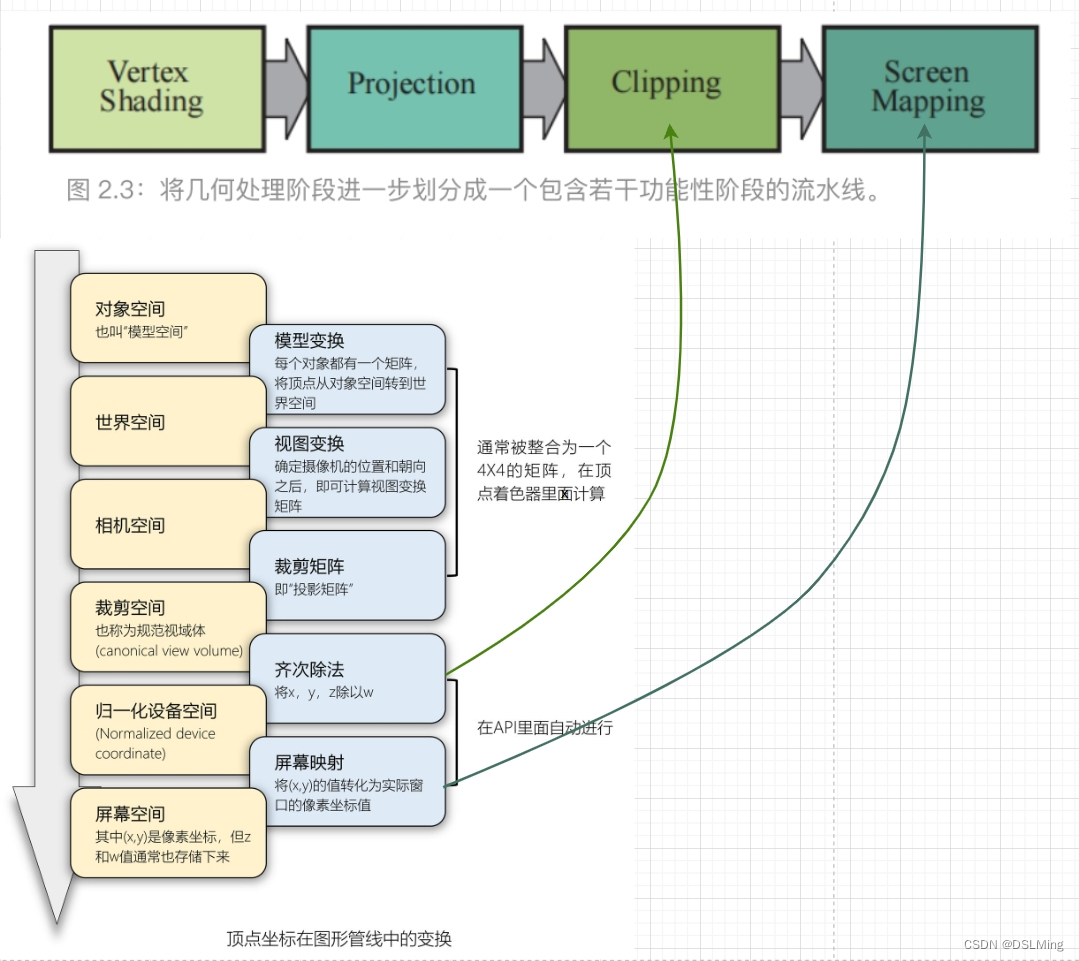

WebGL/Cesium 大空间相机抖动 RTE(Relative to Eye)实现原理简析

在浏览器中渲染大尺寸 3D 模型:Speckle 处理空间抖动的方法 WebGL/Cesium 大空间相机抖动 RTE(Relative to Eye)实现原理简析 注: 相机空间和视图空间 概念等效混用 1、实现的关键代码 const material = new THREE.RawShaderMaterial({uniforms: {cameraPostion: { value:

Detection of ADHD based on Eye Movements during Natural Viewing论文代码复现

Detection of ADHD based on Eye Movements during Natural Viewing论文的复现 论文链接:https://arxiv.org/pdf/2207.01377.pdf 代码链接:https://github.com/aeye-lab/ecml-ADHD 1.环境搭建 原始环境搭建存在不兼容,修改后requiremen.txt 降

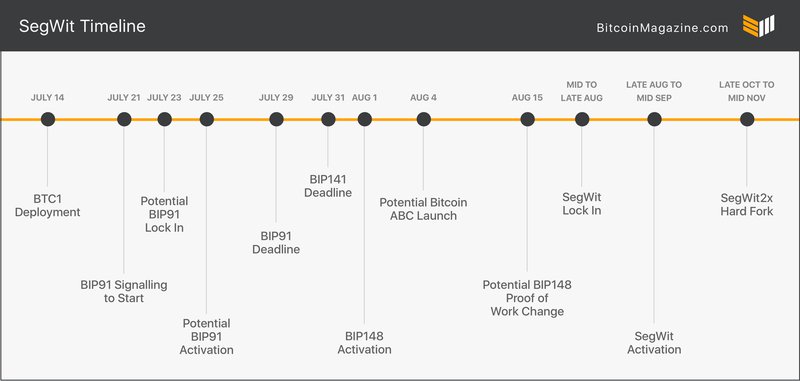

Countdown to SegWit: These Are the Dates to Keep an Eye On

10:50 AM JULY, 03 2017 Bitcoin’s very public scaling debate is entering a crucial phase. Two of the most popular scaling proposals available today — BIP148 and SegWit2x — both intend to tr

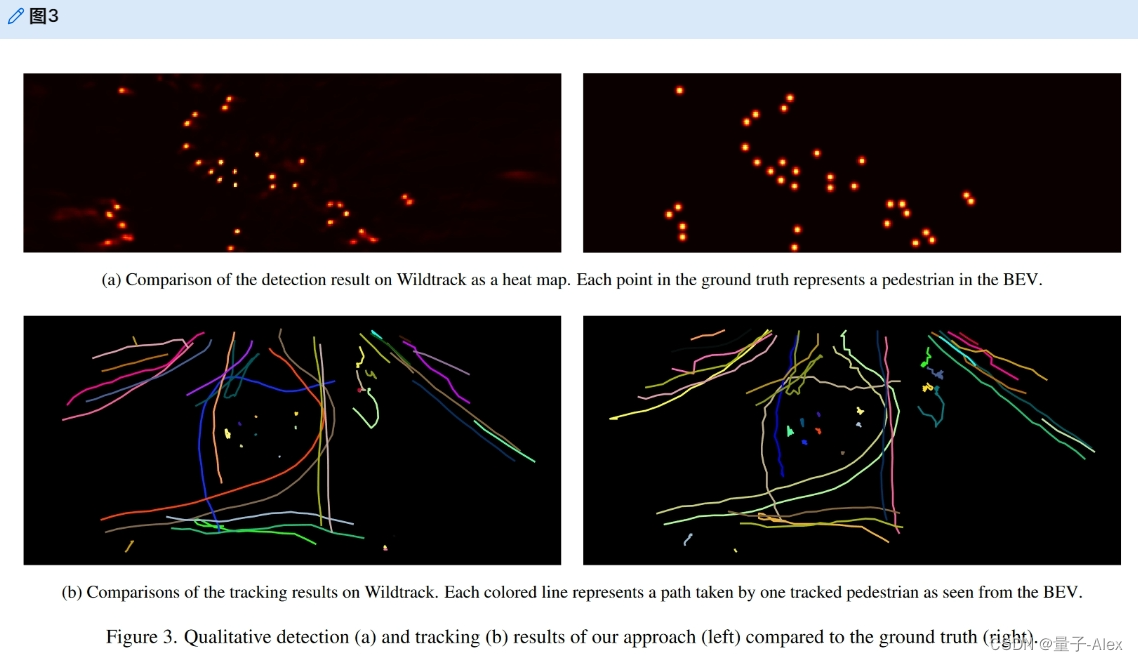

【CV论文精读】EarlyBird: Early-Fusion for Multi-View Tracking in the Bird’s Eye View

【CV论文精读】EarlyBird: Early-Fusion for Multi-View Tracking in the Bird’s Eye View 0.论文摘要 多视图聚合有望克服多目标检测和跟踪中的遮挡和漏检挑战。多视图检测和3D对象检测中的最新方法通过将所有视图投影到地平面并在鸟瞰视图(BEV)中执行检测,实现了巨大的性能飞跃。在本文中,我们研究了BEV中的跟踪是否也能带来多目标

np.eye()以及np.identity()

一、np.eye() 1. 函数的原型:numpy.eye(N,M=None,k=0,dtype=<class 'float'>,order='C) 返回的是一个二维2的数组(N,M),对角线的地方为1,其余的地方为0. 参数介绍: (1)N:int型,表示的是输出的行数 (2)M:int型,可选项,输出的列数,如果没有就默认为N (3)k:int型,可选项,对角线的下标,默认为0表示的

log4j用法http://zengjinliang.javaeye.com/blog/171550

http://zengjinliang.javaeye.com/blog/171550

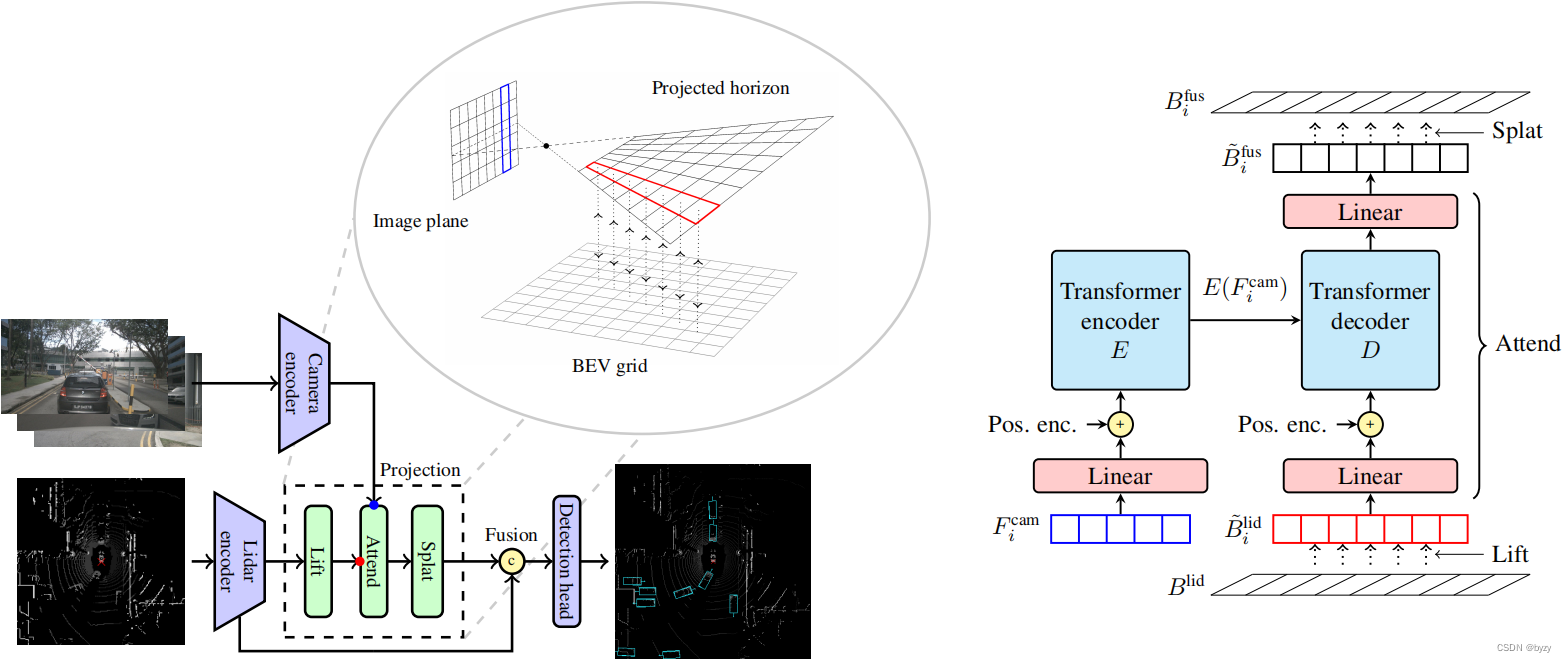

【论文笔记】Lift-Attend-Splat: Bird’s-eye-view camera-lidar fusion using transformers

原文链接:https://arxiv.org/abs/2312.14919 1. 引言 多模态融合时,由于不同模态有不同的过拟合和泛化能力,联合训练不同模态可能会导致弱模态的不充分利用,甚至会导致比单一模态方法性能更低。 目前的相机-激光雷达融合方法多基于Lift-Splat,即基于深度估计投影图像特征到BEV,再与激光雷达特征融合。这高度依赖深度估计的质量。本文发现深度估计不能为这些

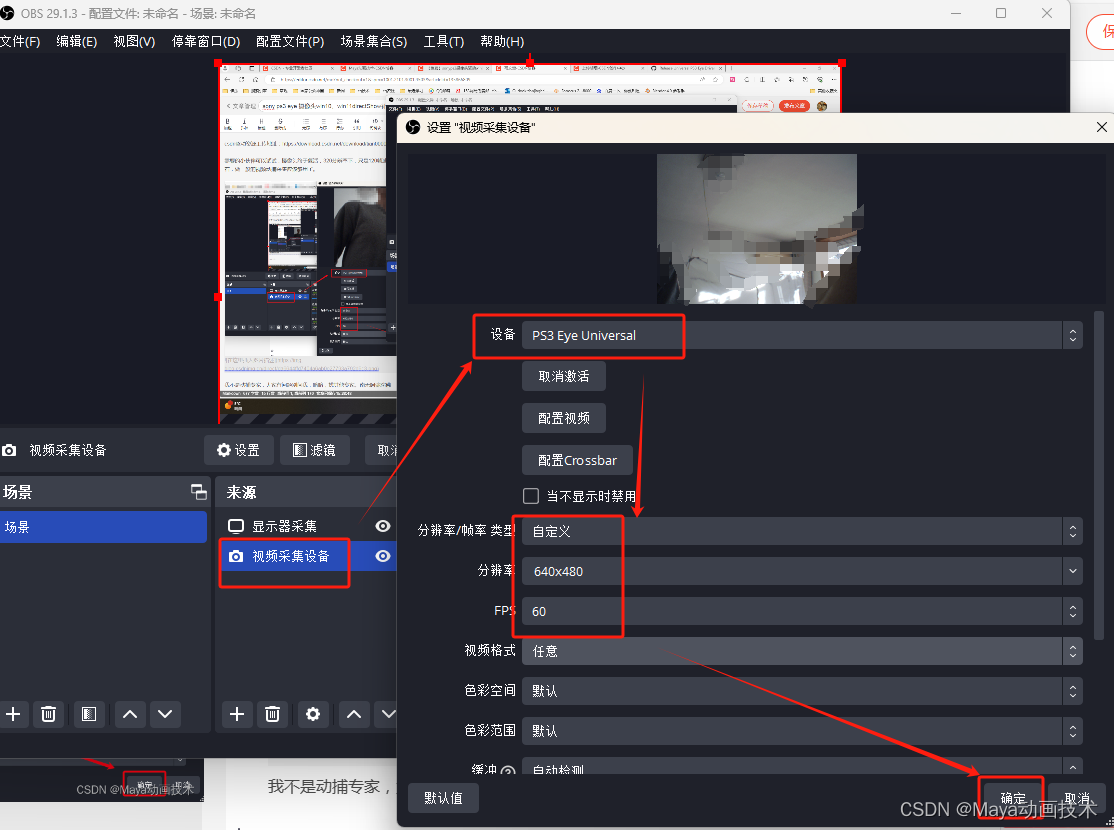

sony ps3 eye 摄像头win10、win11directShow补丁驱动,补充CL5.3驱动无法外部程序调用问题

最近把几年前,淘的sony ps3 eye 摄像头拿出来测试,发现升值了。原来4个打算做动捕用,结果发现安装完CL-Eye-Driver-5.3.0.0341驱动后,无法用外部程序驱动摄像头,后来知乎里发现有人解决了这个为题,是win10下缺乏directShow驱动的问题。两个驱动都要安装,可以在win10\11下外部调用了。阿弥陀佛。 github上有高手解决了此问题,并分享了源码,地址如

np.eye()函数的使用

背景:今天在复现一篇3D图像分割论文的时候,思考了一个问题,我们的数据集一般由原始数据和对应的Ground Truth组成,一般的3D数据都是(Height,Width,Depth)的形状,而对应的Ground Truth也是(Height,Width,Depth)的形状。这个时候就会产生一个疑问,比如我们的分割类别加上背景总共有4类,这个时候(Height,Width,Depth)形状的Grou

spring quartz 动态时间(转自javaeye)

在项目中有一个需求,需要灵活配置调度任务时间,并能自由启动或停止调度。 有关调度的实现我就第一就想到了Quartz这个开源调度组件,因为很多项目使用过,Spring结合Quartz静态配置调度任务时间,非常easy。比如:每天凌晨几点定时运行一个程序,这只要在工程中的spring配置文件中配置好spring整合quartz的几个属性就好。 Spring配置文件 引用 <bean

javaEye的编辑器里要是能加入对ActionScript的支持就更好了!

javaEye的编辑器里要是能加入对ActionScript的支持就更好了,每次插入AS代码时,只能选择相近的语言比如JAVA或XML,感觉有点儿不太好............

Oracle挥舞法律大棒 JavaEye被逼改名ItEye

今天,也就是2011年4月1日愚人节,我们不得不在这样一个特殊含义的节日,向JavaEye会员宣布这样一个富有讽刺性和纪念意义的网站公告:由于Oracle公司通过授权的律师事务所,对JavaEye网站提出了我们无法接受的苛刻条件,在经过我们长期努力的交涉无效之后,Oracle授权的律师事务所以强硬的姿态要求我们服从,并且以停用javaeye.com的域名作为威胁,因此,我们只能被迫放弃已经运营了7

HoloLens 2初入——离线记录Depth、RGB、Eye等数据流,并用py处理

文章目录 HoloLens 2初入——离线记录Depth、RGB、Eye等数据流,并用py处理引言基础环境配置流程录制数据并导入到电脑端Python 处理数据转换图片格式保存为点云 HoloLens 2初入——离线记录Depth、RGB、Eye等数据流,并用py处理 引言 倒腾这个工程的目的其实只是为了学习如何将depth图片和彩色图像对齐。因为我实际的需求是在线处理,如何

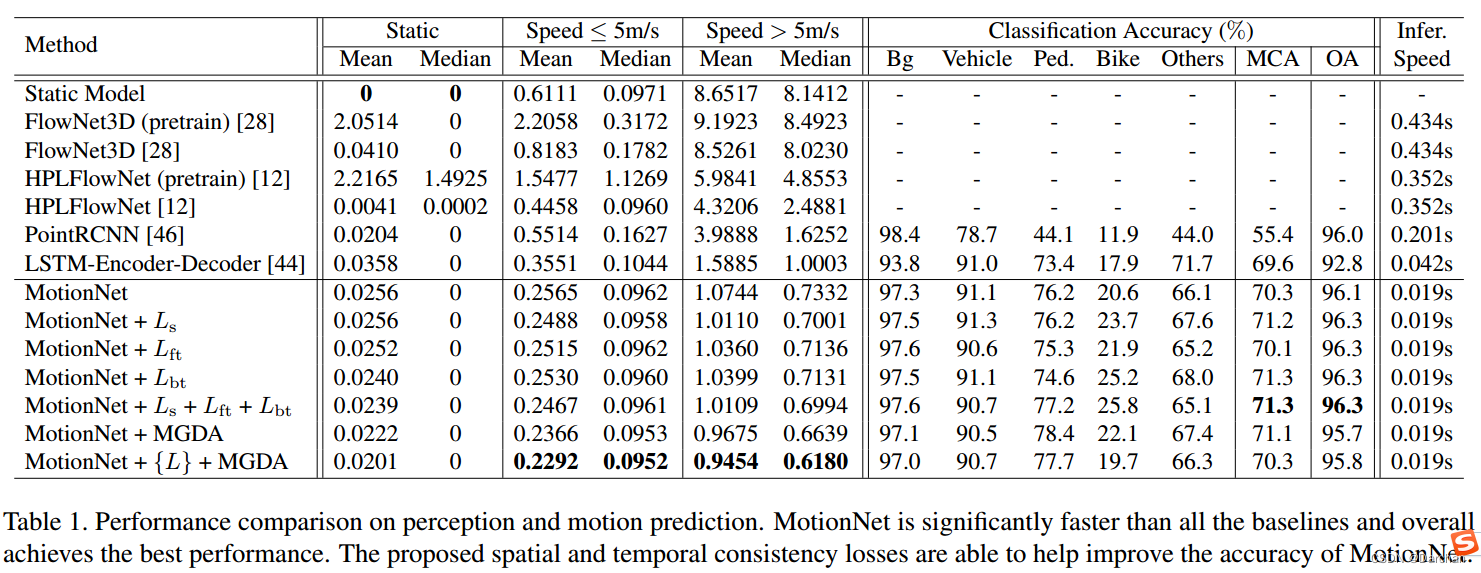

文章解读 -- MotionNet: Joint Perception and Motion Prediction for Autonomous Driving Based on Bird’s Eye

文章解读 – MotionNet: Joint Perception and Motion Prediction for Autonomous Driving Based on Bird’s Eye View Maps 摘要 可靠地感知环境状态的能力,特别是对物体的存在以及它们的运动行为判断,对于自动驾驶至关重要。在这项工作中,我们提出了一个高效的深度模型,称为 MotionNet,用于从 3

基于小安派AiPi-Eye-S1的Nes游戏机

1.作品展示 作品功能可见以下B站视频 外壳可以使用灰太狼大佬提供的外壳STL文件。在嘉立创三维猴上打印(外壳12元+快递6元)。 外壳从以下的帖子中获取: 模型分享 2.作品说明 2.1 硬件部分 硬件上使用到了AiPi-Eye-S1开发板以及3.5寸 240*320像素的电容触摸屏,使用时可以使用USB Type-C线通过开发板上的Type-C接口为设备进行供电。也可以使用锂电池

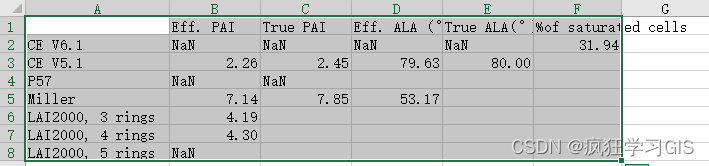

CAN-EYE软件计算植被冠层参数的方法

本文介绍植被冠层参数计算软件CAN-EYE的具体使用方法。 在文章植被冠层参数计算软件CAN-EYE的下载与安装方法(https://blog.csdn.net/zhebushibiaoshifu/article/details/126307810)中,我们介绍了CAN-EYE软件的下载、安装方法;本文就对该软件的具体使用方法进行介绍。 CAN-EYE软件计算LAI、FVC等各类植