epsilon专题

个人笔记--python用tanh画圆形,正方形,长方形(epsilon界面宽度)

用tanh函数画图 圆形 import numpy as npimport matplotlib.pyplot as plt# 创建一个二维网格xx = np.linspace(-1, 1, 1000)yy = np.linspace(-1, 1, 1000)x_i, y_i = np.meshgrid(xx, yy)# 圆的半径和中心r = 0.4center_x, cent

强化学习中Epsilon代表什么

在强化学习中,Epsilon(ε)通常代表一个探索率(exploration rate)。探索率是强化学习算法中一个关键的超参数,用于平衡探索(exploration)和利用(exploitation)的权衡。 探索(Exploration): 在强化学习中,探索是指智能体采取未知动作或者在当前认知中不确定的状态进行尝试。探索对于学习过程非常重要,因为它允许智能体发现新的、可能更好的策略,从而

MT【184】$\epsilon$助力必要性

已知满足不等式$|x^2-4x+a|+|x-3|\le5$的最大值为$3$,求实数$a$的值,并解该不等式. 证明:1)当$x=3$时,$|a-3|\le5$,得$a\in[-2,8]$2)$\forall \epsilon>0,\textbf{令}x=3+\epsilon,|(3+\epsilon)^2-4(3+\epsilon)+a|+|3+\epsilon-3|>5$当$a\ge 3,\e

[C++]直接访问float变量内存的类,addEpison和subEpison、almostEqual约等于,及浮点数排序函数。从此忘记0.000001 再也不要使用FLT_EPSILON!

探究浮点数奥秘,这里给出一个直接访问float变量内存的类,二进制兼容float, 并给出addEpison和subEpison两个函数 而这两个函数,是模糊比较所需要的方法的基础。 //负数时随着内存值int变大,浮点值绝对值越大// 80000000 →→→ bf800000 → ff7fffff ff800000 ff800001 ffffffff// -0

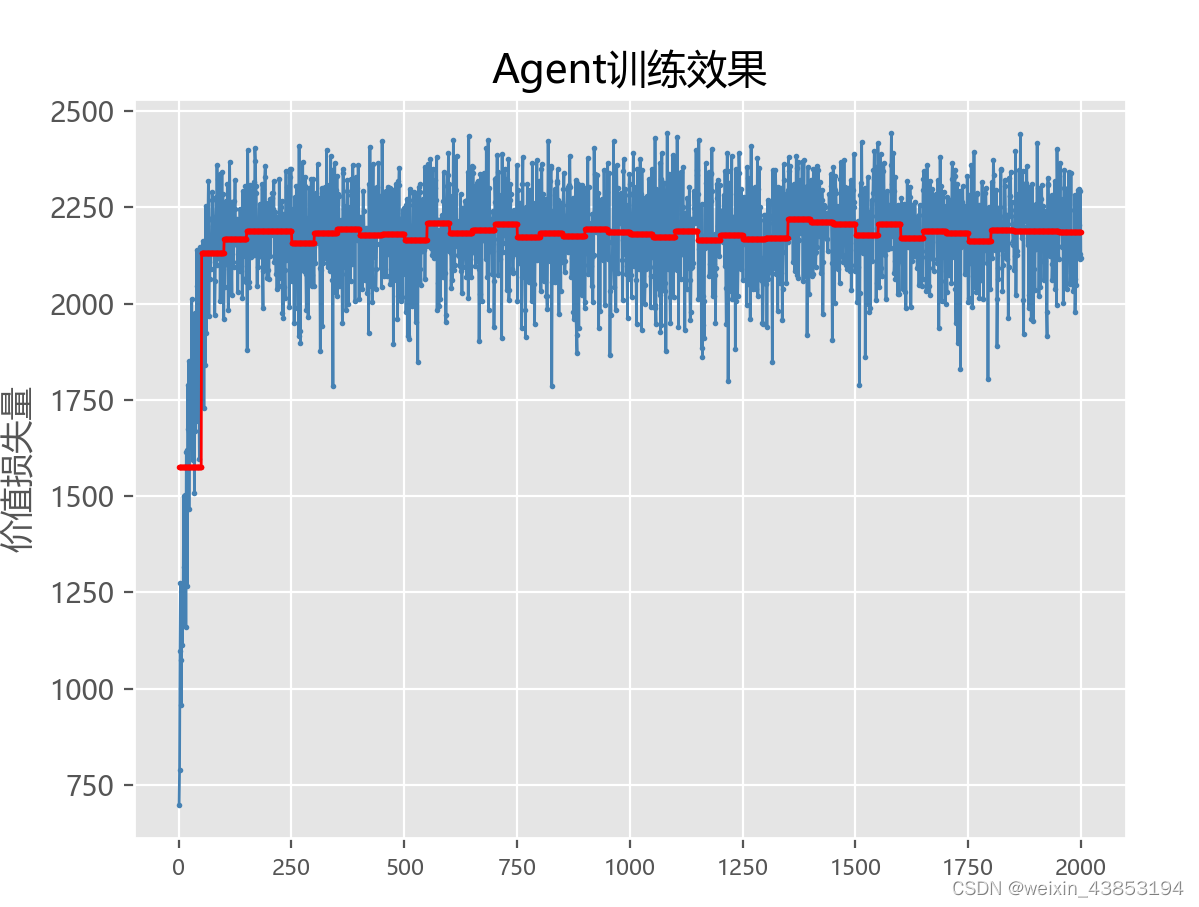

代码实现DQN的ε-greedy(Epsilon贪婪策略),取得相反结果

问题现象:DQN训练中,设置ε-greedy策略,取得相反的训练结果(智能体一开始选择最优动作,后期选择较多随机动作,为什么训练效果反而更好,是哪个环节出现问题了)。 问题描述:(1)智能体有ε的概率选择随机动作,(1-ε)的概率选择最优动作。在训练中,令ε单调递减(一开始更多选择随机动作,随着训练加深,逐渐选择最优动作)。代码如下所示 图A1 参数设置(合理值) 图A2 动作选择函

将Epsilon-NFA转换为NFA--python实现

1.任务要求 从具有epsilon的不确定有限状态自动机(NFA)得到一个无Epsilon 的NFA。 2.思路 Epsilon-NFA到NFA的目标主要是产生一个没有Epsilon边的,跟原状态图等价的新状态图。过程不复杂,首先从起始状态开始,寻找所有Epsilons边到达的对象的集合,然后复制这个集合的所有状态包含的非Epsilon状态。其实状态做完之后,寻找所有能够产生非Epsilon