course2专题

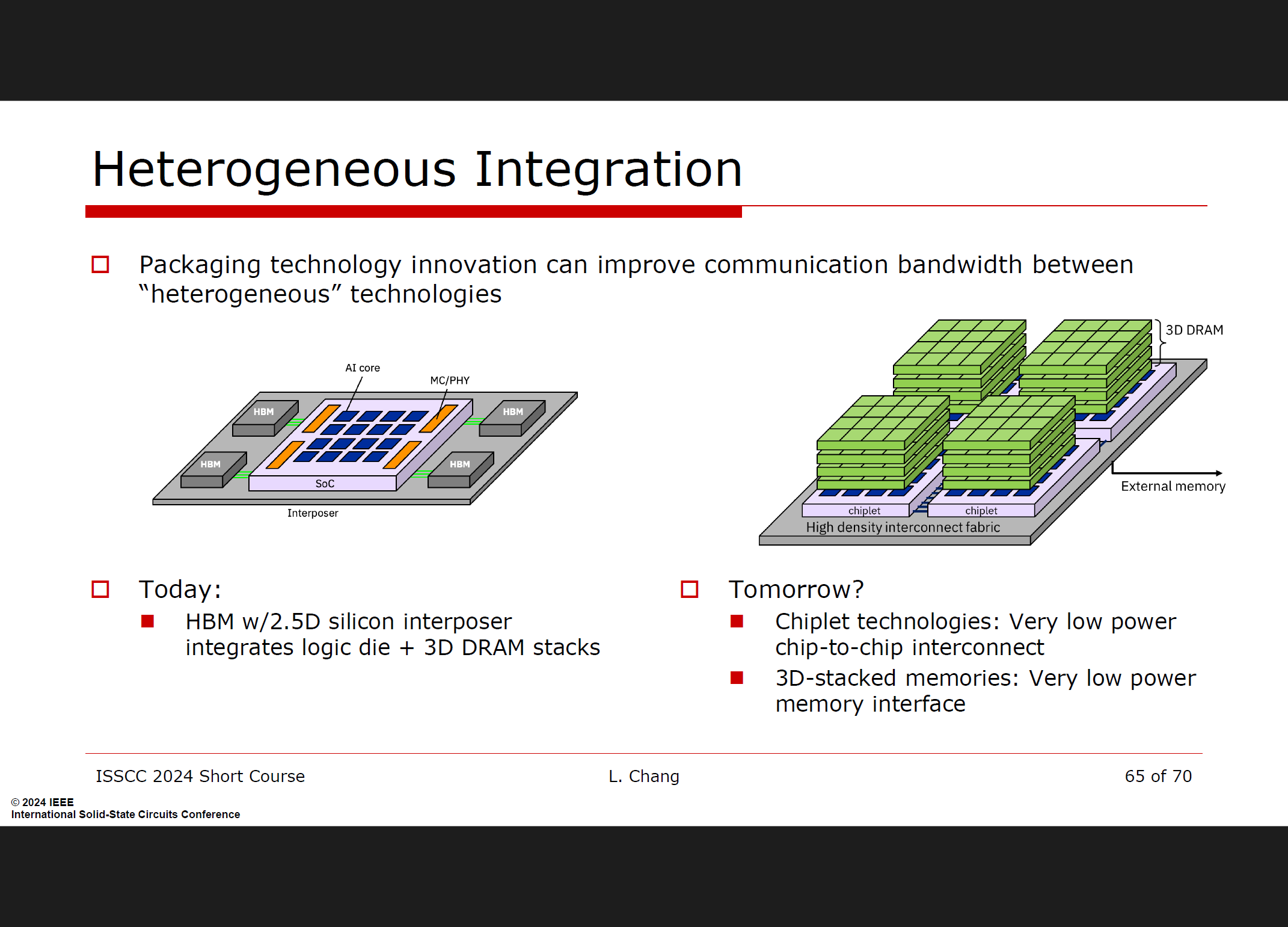

isscc2024 short course2 Performance Compute Environment

这部分分为4部分: 概览:LLMs和生成式AI 探讨大语言模型(LLMs)和生成式AI的整体环境,及其对硬件加速器设计的影响。 高性能AI加速器的特定考虑因素 广泛的模型和使用案例支持:需要设计能支持多种模型和应用场景的加速器。 系统级优化:强调从系统层面进行优化以提升整体性能。 计算效率的路线图 量化与稀疏性:探讨量化(Quantization)和稀疏性(Sparsity)技术如何提高计

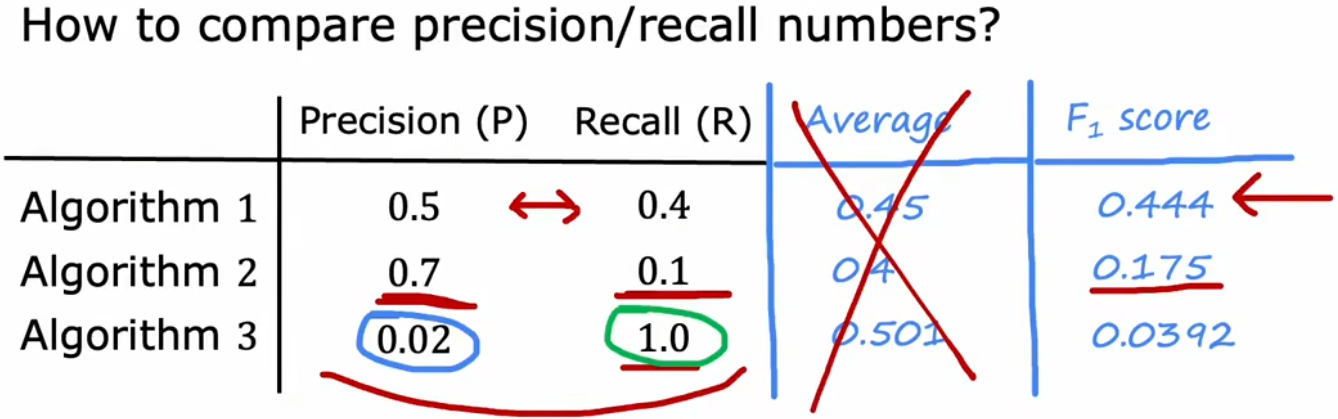

Course2-Week3-使用机器学习的建议

Course2-Week3-使用机器学习的建议 文章目录 Course2-Week3-使用机器学习的建议1. 拆分原始训练集1.1 如何改进模型1.2 二拆分:训练集、测试集1.3 三拆分:训练集、验证集、测试集 2. 避免高偏差和高方差2.1 使用训练误差和验证误差进行分析2.2 选择合适的正则化参数2.3 性能评估的基准2.4 训练集的样本数量2.5 如何改进模型(修订)2.6 神经网

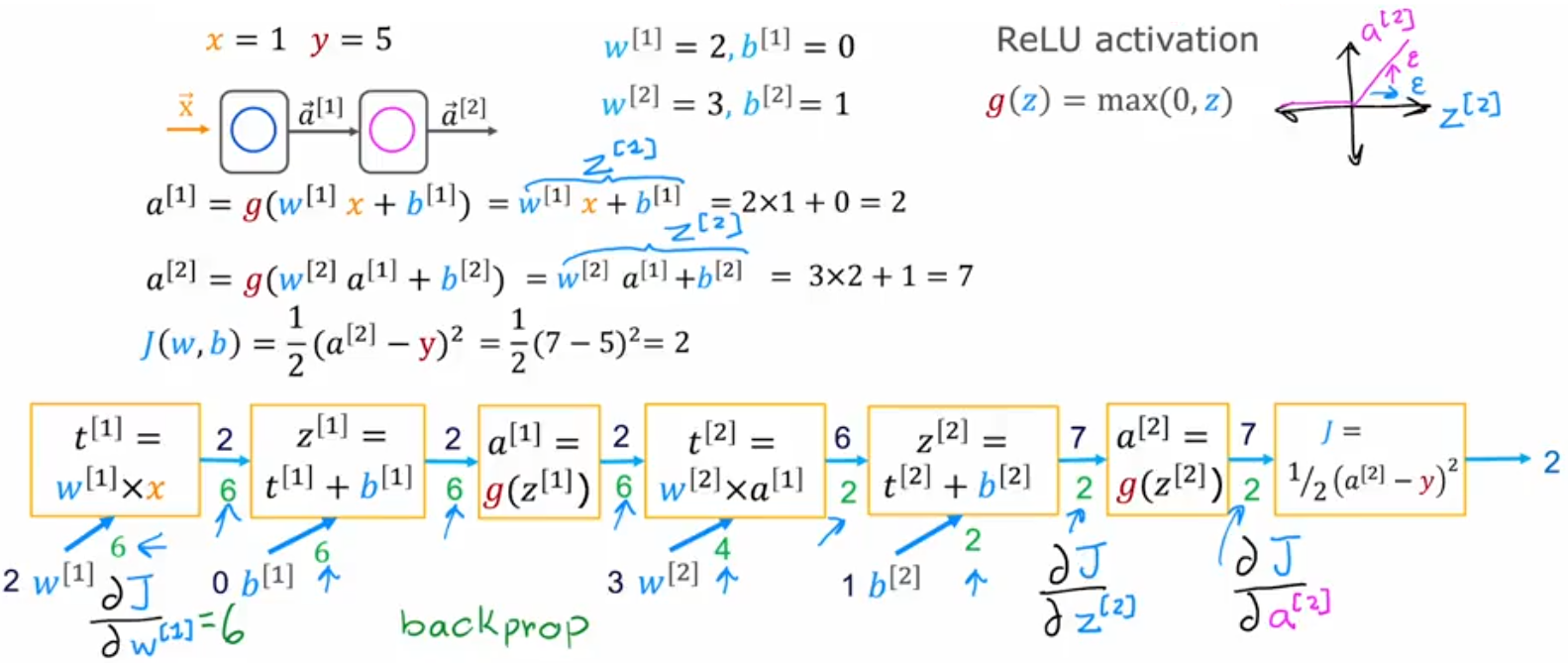

Course2-Week1-神经网络

Course2-Week1-神经网络 文章目录 Course2-Week1-神经网络1. 神经网络概述1.1 欢迎来到Course21.2 神经元和大脑1.3 引入神经网络-需求预测1.4 神经网络的其他示例-图像感知 2. 神经网络的数学表达式2.1 单层的神经网络-需求预测2.3 前向传播的神经网络-手写数字识别 3. TensorFlow简介3.1 配置TensorFlow环境3.2

Course2-Week2-神经网络的训练方法

Course2-Week2-神经网络的训练方法 文章目录 Course2-Week2-神经网络的训练方法1. 神经网络的编译和训练1.1 TensorFlow实现1.2 损失函数和代价函数的数学公式 2. 其他的激活函数2.1 Sigmoid激活函数的替代方案2.2 如何选择激活函数2.3 为什么需要激活函数 3. 多分类问题和Softmax函数3.1 多分类问题3.2 逻辑回归的推广:S

Course2-week3-hyperparameterTuning - BatchNormalization - Framework

hyperparameter tuning 1 - tuning process How to systematically organize hyperparameters tuning process? hyperparameters learning rate α α \alpha β β \beta in momentum, or set the default 0.9min