batchnorm2d专题

在pytorch模型中如何获得BatchNorm2d层的各个mean和var(平均值和方差)

这个内容是将随便做了一个网络结构,然后简单的训练几次,生成模型,并且存储起来,主要是为了学习获得pytorch中的BatchNorm2d层的各个特征图的平均值和方差。代码如下: import torchimport torch.nn as nnimport torch.nn.functional as Ffrom torchvision import datasets,transforms

torch.nn.batchnorm1d,torch.nn.batchnorm2d,torch.nn.LayerNorm解释:

批量归一化是一种加速神经网络训练和提升模型泛化能力的技术。它对每个特征维度进行标准化处理,即调整每个特征的均值和标准差,使得它们的分布更加稳定。 Batch Norm主要是为了让输入在激活函数的敏感区。所以BatchNorm层要加在激活函数前面。 1.torch.nn.batchnorm1d: (1)归一化处理公式: E(x)表示样本某一维的均值,Var(x)表示样本某一维的方差;

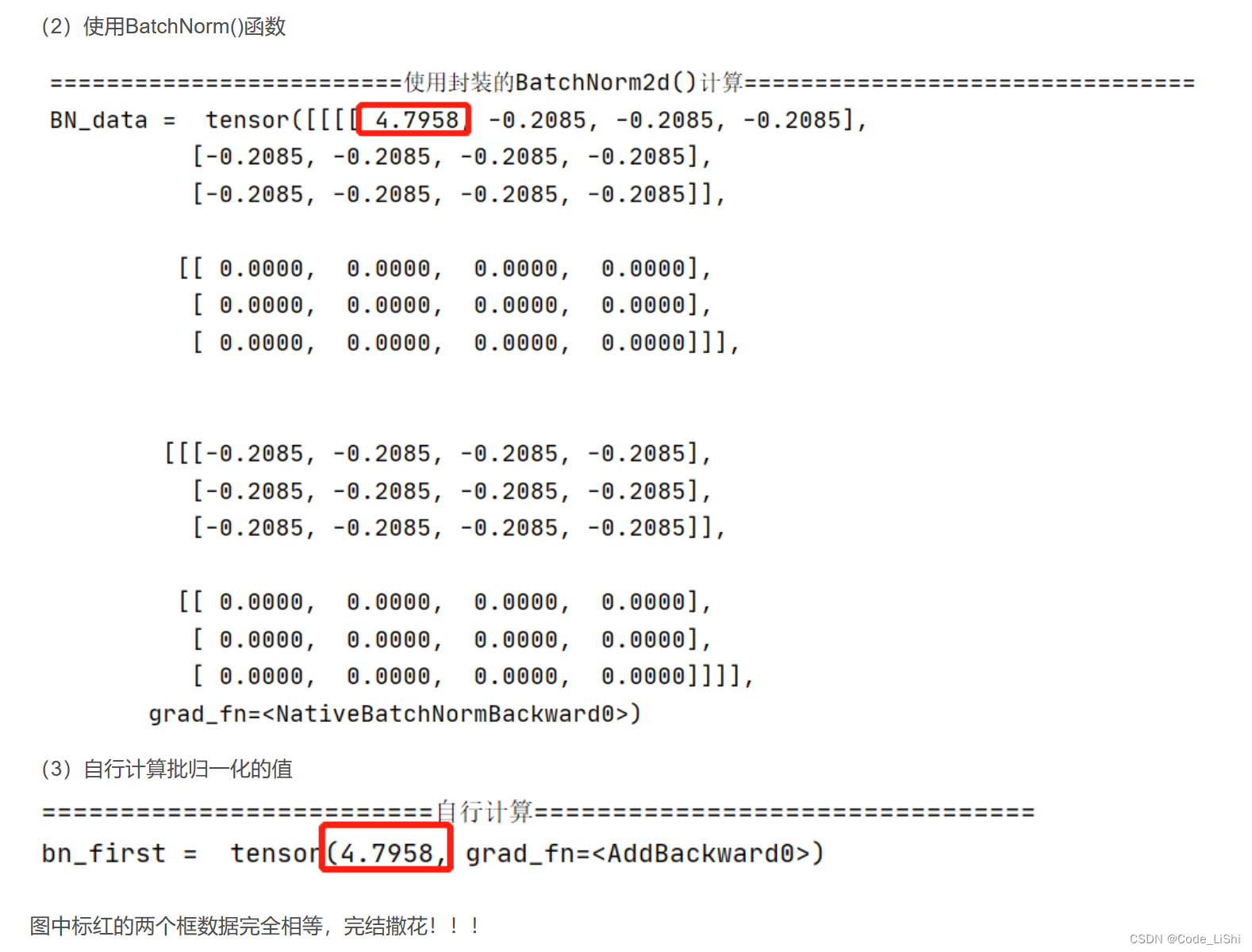

pytorch中对nn.BatchNorm2d()函数的理解

pytorch中对BatchNorm2d函数的理解 简介计算3. Pytorch的nn.BatchNorm2d()函数4 代码示例 简介 机器学习中,进行模型训练之前,需对数据做归一化处理,使其分布一致。在深度神经网络训练过程中,通常一次训练是一个batch,而非全体数据。每个batch具有不同的分布产生了internal covarivate shift问题——在训练过程中,数