本文主要是介绍Pytorch层--AdaptiveAvgPool2d,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

翻译自: https://discuss.pytorch.org/t/what-is-adaptiveavgpool2d/26897

知乎链接: https://www.zhihu.com/question/282046628

函数原型: nn.AdaptiveAvgPool2d(output_size)

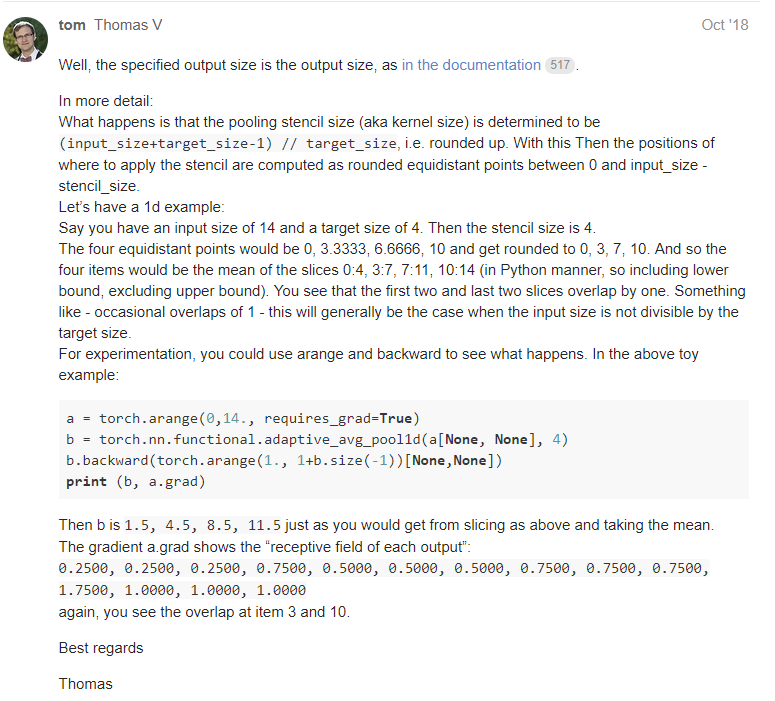

原理解释:

更多细节

池化模板大小计算(Pool Kernel Size): stencil_size=(input_size+target_size-1) // target_size, 即向上舍入。

基于stencil_size, 将计算应用池化模板的(起始)位置: 即计算[0,input_size) 之间的等距点

一个例子:

假设输入大小为14,目标大小为4.那么模板大小为4。

四个等距点将分别为0,3.33333,6.6666,10并且四舍五入为0,3,7,10。因此,四个项目将是切片的平均值0:4, 3:7, 7:11, 10 :14(以Python方式,所以包括下限,不包括上限)。可以看到前两个和最后两个切片会有重叠。当输入大小不能被目标大小整除时,通常会出现这种偶尔重叠1的情况。

对于实验,您可以使用arange 和backward函数来查看发生的情况在如下示例中:

a = torch.arange(0,14., requires_grad=True)

b = torch.nn.functional.adaptive_avg_pool1d(a[None, None], 4)

b.backward(torch.arange(1., 1+b.size(-1))[None,None])

print (b, a.grad)

然后b 1.5, 4.5, 8.5, 11.5就像你从上面切片得到的那样并取平均值。

梯度a.grad显示“每个输出的感知字段”:

0.2500, 0.2500, 0.2500, 0.7500, 0.5000, 0.5000, 0.5000, 0.7500, 0.7500, 0.7500, 1.7500, 1.0000, 1.0000, 1.0000

再次,您在第3项和第10项看到重叠。

对等分点计算的疑惑解释:

为了从总长度为14(= input_size)的数组中获得具有相同长度(4 = kernel_size)的4部分(= target_size),允许一些重叠,我们首先将最右边的部分分开:索引为10,11,12和13。我们将索引0-10部分分成3(4 - 1)等分。

这是Thomas的例子中的numpy片段。

In [1]: import numpy as npIn [2]: input_size = 14In [3]: output_size = 4In [4]: kernel_size = (input_size + output_size - 1) // output_sizeIn [5]: kernel_size

Out[5]: 4In [6]: np.linspace(start=0, stop=input_size - kernel_size, num=output_size)

Out[6]: array([ 0. , 3.33333333, 6.66666667, 10. ])

这篇关于Pytorch层--AdaptiveAvgPool2d的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!