本文主要是介绍Tensorflow的采样方法:candidate sampling,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

采样介绍

假如我们有一个多分类任务或者多标签分类任务,给定训练集 (xi,Ti) ,其中 xi 表示上下文, Ti 表示目标类别(可能有多个).可以用word2vec中的negtive sampling方法来举例,使用cbow方法,也就是使用上下文 xi 来预测中心词(单个target Ti ),或者使用skip-gram方法,也就是使用中心词 xi 来预测上下文(多个target( Ti )).

我们想学习到一个通用函数 F(x,y) 来表征上下文 x 和目标类

完整的训练方法,如使用softmax或者Logistic回归需要对每个训练数据计算所有类 y∈L 的概率 F(x,y) ,当 |L| 非常大的时候,训练将非常耗时。

“candidate sampling”训练方法包括为每一个训练数据 (xi,Ti) 构造一个训练任务,使得我们只需要使用一个较小的候选集合 Ci∈L ,就能评估 F(x,y) ,典型的,candidate set Ci 包含目标类别 Ti 和一些随机采样的类别 Si∈L :

F(x,y) 可以使用神经网络计算来表征(也就是TensorFlow里面常用的logits)

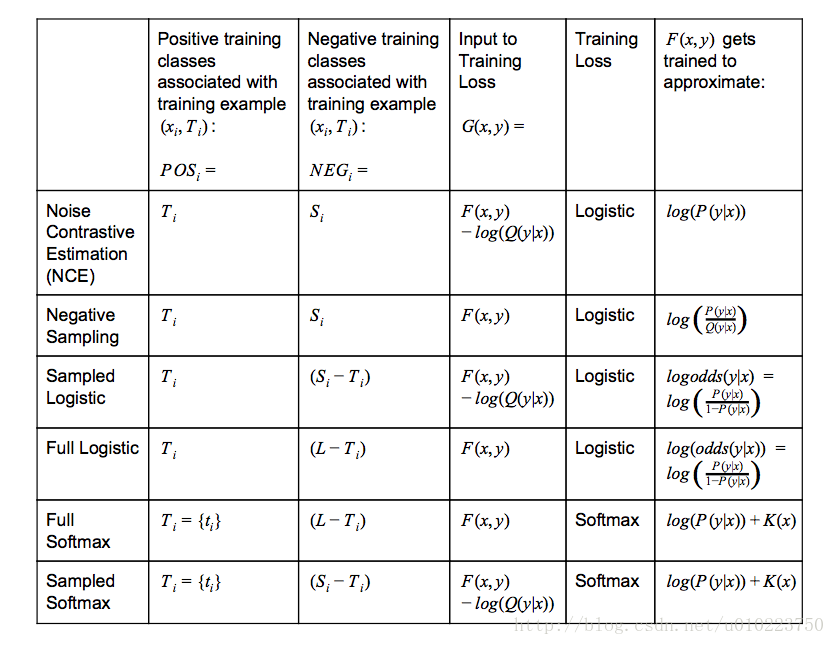

TensorFlow中各种采样

其中:

- Q(y|x) 表示的是给定context xi 采样到 y 的概率

K(x) 表示任意不以来候选集的函数- logistic−training−loss=∑i(∑y∈POSilog(1+exp(−G(xi,y)))+∑y∈NEGilog(1+exp(G(xi,y))))(1)

- softmax−training−loss=∑i(−log(exp(G(xi,ti))∑y∈POSi∪NEGiexp(G(xi,y))))

softmax vs. logistic

在使用tensoflow的时候,我们有时候会纠结选择什么样的损失函数比较好,softmax和logistic在表达形式上是有点区别的,但是也不是很大,而且对于普通的softmax_cross_entropy_with_logits和sigmoid_cross_entropy_with_logits也都能够进行多分类任务,那么他们之间的区别是什么的?

就我个人所想到的,使用sigmoid_cross_entropy_with_logits和softmax_cross_entropy_with_logits的最大的区别是类别的排他性,在分类任务中,使用softmax_cross_entropy_with_logits我们一般是选择单个标签的分类,因为其具有排他性,说白了,softmax_cross_entropy_with_logits需要的是一个类别概率分布,其分布应该服从多项分布(也就是多项logistic regression),我们训练是让结果尽量靠近这种概率分布,不是说softmax_cross_entropy_with_logits不能进行多分,事实上,softmax_cross_entropy_with_logits是支持多个类别的,其参数labels也没有限制只使用一个类别,当使用softmax_cross_entropy_with_logits进行多分类时候,以二类为例,我们可以设置真实类别的对应labels上的位置是0.5,0.5,训练使得这个文本尽量倾向这种分布,在test阶段,可以选择两个计算概率最大的类作为类别标签,从这种角度说,使用softmax_cross_entropy_with_logits进行多分,实际上类似于计算文本的主题分布。

但是对于sigmoid_cross_entropy_with_logits,公式 (1) 可以看出,sigmoid_cross_entropy_with_logits其实是训练出了多个分类器,对于有 n 个标签 的分类问题,其实质是分成了

tensorflow提供了下面两种candidate sample方法

- tf.nn.nce_loss

- tf.nn.sampled_softmax_loss

对比与之前讨论的,从最上面的图中的training loss采用的方法可以知道, tf.nn.nce_loss使用的是logistic 而tf.nn.sampled_softmax_loss采用的是softmax loss,其实这两者的区别也主要在这儿,采用logistic loss的本质上还是训练 n 个分类器,而使用softmax loss的其实只是训练了一个主题分类器,tf.nn.nce_loss主要思路也是判断给定context

个人看法,对于多标签多类别的分类任务使用Logistic比较好,对于多标签单类别的分类任务使用softmax比较好,采样中,采用tf.nn.sampled_softmax_loss训练cbow模型比较好,而 tf.nn.nce_loss训练skip-gram比较好。

这篇关于Tensorflow的采样方法:candidate sampling的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!