本文主要是介绍python爬取netcdf数据,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

需要爬取的数据是POES的五个卫星 METOP1,METOP2,NOAA15 ,NOAA18,NOAA19,2014年至2017年的netcdf数据,一个一个下载的话忒别麻烦。

数据地址:https://satdat.ngdc.noaa.gov/sem/poes/data/processed/ngdc/uncorrected/full/

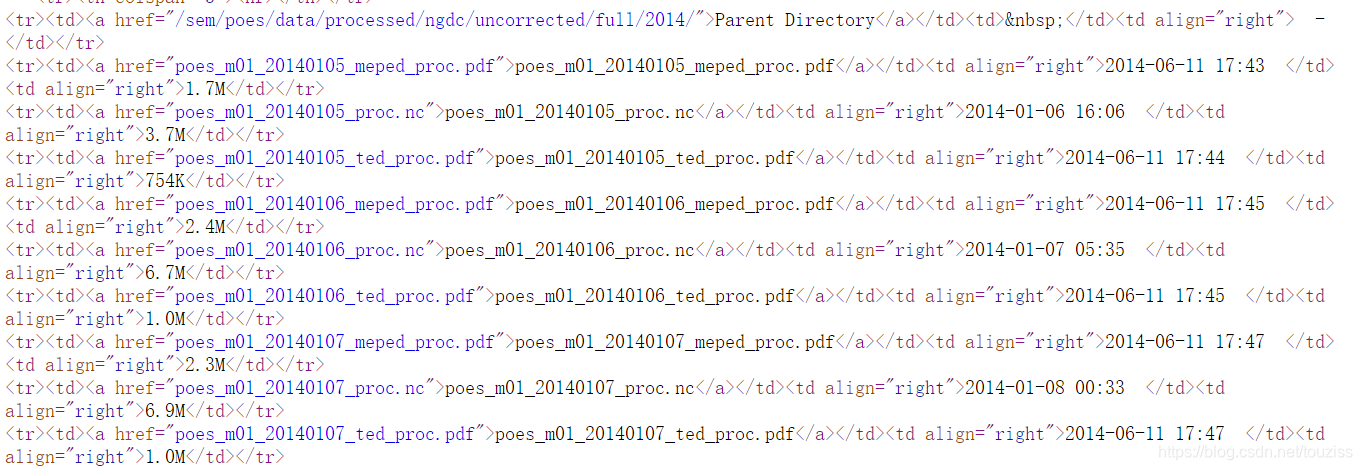

数据排的很好其实,可以按照年份、按照卫星一个一个下载,就不用爬虫跳转url,非常方便,以下载METOP1 2014年的数据为例,打开网页源代码数据下载链接的部分如下:

链接在'a'标签中,而且,我们只需要.nc的文件,可以匹配正则表达式http://www.runoob.com/regexp/regexp-syntax.html

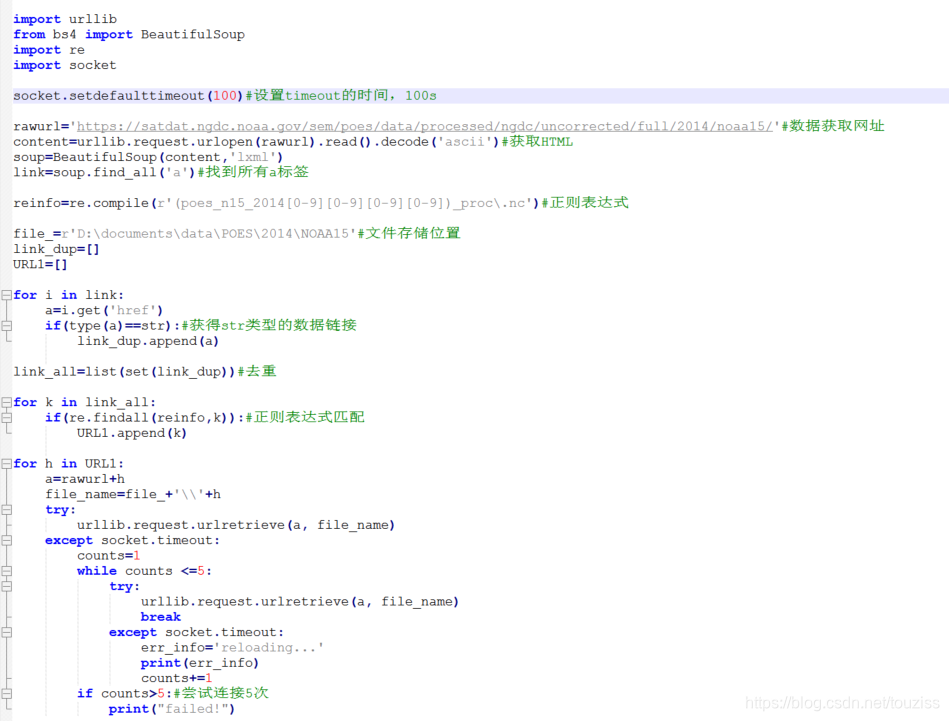

python代码如下:

"""

Created on Tue Dec 18 10:10:22 2018

@author: Administrator

"""

import urllib

from bs4 import BeautifulSoup

import re

rawurl='https://satdat.ngdc.noaa.gov/sem/poes/data/processed/ngdc/uncorrected/full/2014/metop01/'

content=urllib.request.urlopen(rawurl).read().decode('ascii')#获得html文件

soup=BeautifulSoup(content,'lxml')

link=soup.find_all('a')#找到标签‘a’的所有内容

reinfo=re.compile(r'(poes_m01_2014[0-1][0-9][0-3][0-9])_proc\.nc')#只下载netcdf文件,最简单的正则表达式

file_=r'D:\documents\data\POES\2014\METOP1'#存放下载文件的地址

link_dup=[]

URL1=[]

for i in link:

a=i.get('href')#获得链接

if(type(a)==str):#去掉不是String类型的链接

link_dup.append(a)

link_all=list(set(link_dup))#去掉重复的链接

for k in link_all:

if(re.findall(reinfo,k)):#获得符合正则表达式的链接

URL1.append(k)

for h in URL1:

a=rawurl+h

file_name=file_+'\\'+h#保存的文件名

urllib.request.urlretrieve(a, file_name)#获取文件

获取的时候发现了一个问题,假如有一个文件连接比较慢,一时半会下载不下来,就会在这个文件上纠结很久,浪费时间,下不完数据。设置timeout,代码如下。

这篇关于python爬取netcdf数据的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!