本文主要是介绍K8s亲和反亲和策略,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

1. 亲和/反亲和调度策略简述

一般情况下我们部署的 Pod 是通过集群的自动调度策略来选择节点的,默认情况下调度器考虑的是资源足够,并且负载尽量平均,但是有的时候我们需要能够更加细粒度的去控制 Pod 的调度,比如我们内部的一些服务 gitlab 之类的也是跑在Kubernetes集群上的,我们就不希望对外的一些服务和内部的服务跑在同一个节点上了,担心内部服务对外部的服务产生影响;但是有的时候我们的服务之间交流比较频繁,又希望能够将这两个服务的 Pod 调度到同一个的节点上。这就需要用到 Kubernetes 里面的一个概念:亲和性和反亲和性。

亲和性有分成节点亲和性(nodeAffinity)和 Pod 亲和性(podAffinity)。

2. 节点选择器nodeSelector简介

在了解亲和性之前,我们先来了解一个非常常用的调度方式:nodeSelector。我们知道label是kubernetes中一个非常重要的概念,用户可以非常灵活的利用 label 来管理集群中的资源,比如最常见的一个就是 service 通过匹配 label 去匹配 Pod 资源,而 Pod 的调度也可以根据节点的 label 来进行调度。

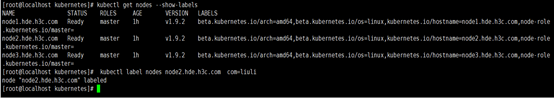

我们可以通过下面的命令查看我们的 node 的 label:

| kubectl get nodes --show-labels |

们先给节点2增加一个com=liuli的标签,命令如下:

| kubectl label nodes node2.hde.h3c.com com=liuli |

我们可以通过上面的--show-labels参数可以查看上述标签是否生效。当 node 被打上了相关标签后,在调度的时候就可以使用这些标签了,只需要在 Pod 的spec字段中添加nodeSelector字段,里面是我们需要被调度的节点的 label 即可。比如,下面的 Pod 我们要强制调度到 node02 这个节点上去,我们就可以使用 nodeSelector 来表示了:(node-selector-demo.yaml)

| apiVersion: v1 kind: Pod metadata: labels: app: nginx-pod name: test-nginx spec: containers: - command: - sleep - "3600" image: nginx: latest imagePullPolicy: Always name: test-nginx nodeSelector: com: liuli |

创建pod

| kubectl create -f node-selector-demo.yaml |

然后我们可以通过 describe 命令查看调度结果:

| kubectl describe pod test-nginx |

可以看到 Events 下面的信息,我们的 Pod 通过默认的 default-scheduler 调度器被绑定到了node2节点。不过需要注意的是nodeSelector属于强制性的,如果我们的目标节点没有可用的资源,我们的 Pod 就会一直处于 Pending 状态,这就是nodeSelector的用法。

通过上面的例子我们可以感受到nodeSelector的方式比较直观,但是还够灵活,控制粒度偏大,接下来我们再和大家了解下更加灵活的方式:节点亲和性(nodeAffinity)。

node亲和性策略表示pod部署到符合某些条件的node上.

3. 亲和性和反亲和性调度策略

但是在实际的生产环境中,往往我们需要根据自己的一些实际需求来控制 pod 的调度,这就需要用到 nodeAffinity(节点亲和性)、podAffinity(pod 亲和性) 以及 podAntiAffinity(pod 反亲和性)。

亲和性调度可以分成软策略和硬策略两种方式:

软策略就是如果没有满足调度要求的节点的话,pod 就会忽略这条规则,继续完成调度过程,说白了就是满足条件最好了,没有的话也无所谓了的策略

硬策略就比较强硬了,如果没有满足条件的节点的话,就不断重试直到满足条件为止,简单说就是你必须满足我的要求,不然我就不干的策略。

对于亲和性和反亲和性都有这两种规则可以设置: preferredDuringSchedulingIgnored DuringExecution和requiredDuringSchedulingIgnoredDuringExecution,前面的就是软策略,后面的就是硬策略。

4. 节点亲和性nodeAffinity案例

节点亲和性主要是用来控制 pod 要部署在哪些主机上,以及不能部署在哪些主机上的。它可以进行一些简单的逻辑组合了,不只是简单的相等匹配。

比如现在我们用一个 Deployment 来管理3个 pod 副本,现在我们来控制下这些 pod 的调度,如下例子:(node-affinity-demo.yaml)

| apiVersion: apps/v1beta1 kind: Deployment metadata: name: affinity labels: app: affinity spec: replicas: 3 revisionHistoryLimit: 15 template: metadata: labels: app: affinity role: test spec: containers: - name: nginx image: nginx: latest ports: - containerPort: 80 name: nginxweb affinity: nodeAffinity: requiredDuringSchedulingIgnoredDuringExecution: # 硬策略 nodeSelectorTerms: - matchExpressions: - key: kubernetes.io/hostname operator: NotIn values: - node3.hde.h3c.com preferredDuringSchedulingIgnoredDuringExecution: # 软策略 - weight: 1 preference: matchExpressions: - key: com operator: In values: - liuli |

上面这个 pod 首先是要求不能运行在 node03 这个节点上,如果有个节点满足com=liuli的话就优先调度到这个节点上。

创建Deployment

| kubectl create -f node-affinity-demo.yaml |

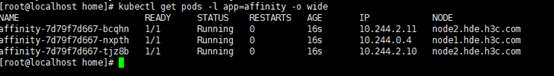

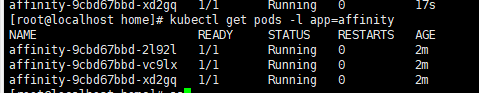

查看pod调度情况

| kubectl get pods -l app=affinity -o wide |

从结果可以看出 两个pod 被部署到了 node2,node3节点上没有部署 pod,

这里的匹配逻辑是 label 的值在某个列表中,现在Kubernetes提供的操作符有下面的几种:

In:label 的值在某个列表中

NotIn:label 的值不在某个列表中

Gt:label 的值大于某个值

Lt:label 的值小于某个值

Exists:某个 label 存在

DoesNotExist:某个 label 不存在

如果nodeSelectorTerms下面有多个选项的话,满足任何一个条件就可以了;如果matchExpressions有多个选项的话,则必须同时满足这些条件才能正常调度 POD。

5. Pod亲和性podAffinity案例

pod 亲和性主要解决 pod 可以和哪些 pod 部署在同一个拓扑域中的问题(其中拓扑域用主机标签实现,可以是单个主机,也可以是多个主机组成的 cluster、zone 等等),而 pod 反亲和性主要是解决 pod 不能和哪些 pod 部署在同一个拓扑域中的问题,它们都是处理的 pod 与 pod 之间的关系,比如一个 pod 在一个节点上了,那么我这个也得在这个节点,或者你这个 pod 在节点上了,那么我就不想和你待在同一个节点上。

由于我们这里只有一个集群,并没有区域或者机房的概念,所以我们这里直接使用主机名来作为拓扑域,把 pod 创建在同一个主机上面。

还是针对上面的资源对象,我们来测试下 pod 的亲和性:(pod-affinity-demo.yaml)

| apiVersion: apps/v1beta1 kind: Deployment metadata: name: affinity labels: app: affinity spec: replicas: 3 revisionHistoryLimit: 15 template: metadata: labels: app: affinity role: test spec: containers: - name: nginx image: nginx:latest ports: - containerPort: 80 name: nginxweb affinity: podAffinity: requiredDuringSchedulingIgnoredDuringExecution: # 硬策略 - labelSelector: matchExpressions: - key: app operator: In values: - nginx-pod topologyKey: kubernetes.io/hostname |

上面这个例子中的 pod 需要调度到某个指定的主机上,至少有一个节点上运行了这样的 pod:这个 pod 有一个app=nginx-pod的 label。

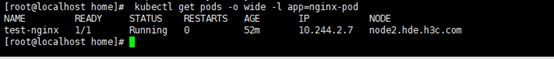

我们查看有标签app= nginx-pod的 pod 列表:

| kubectl get pods -o wide -l app=nginx-pod |

把上面的 test- nginx 和 affinity 这个 Deployment 都删除,然后创建 affinity 这个资源

| kubectl delete -f node-selector-demo.yaml kubectl create -f pod-affinity-demo.yaml kubectl get pods -o wide -l app=affinity

|

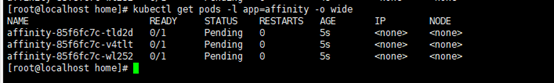

执行结果如下

所有pod处于Pending状态了,这是因为现在没有一个节点上面拥有nginx-pod这个 label 的 pod,而上面我们的调度使用的是硬策略,所以就没办法进行调度

重新部署test- nginx pod,然后部署affinity Deployment,即可发现affinity状态均为ready

| kubectl create -f node-selector-demo.yaml kubectl delete -f pod-affinity-demo.yaml kubectl create -f pod-affinity-demo.yaml kubectl get pods -o wide -l app=affinity |

执行结果如下

6. Pod反亲和性podAntiAffinity案例

pod 反亲和性则是反着来的,比如一个节点上运行了某个 pod,那么我们的 pod 则希望被调度到其他节点上去,同样我们把上面的 podAffinity 直接改成 podAntiAffinity,(pod-antiaffinity-demo.yaml)

| apiVersion: apps/v1beta1 kind: Deployment metadata: name: affinity labels: app: affinity spec: replicas: 3 revisionHistoryLimit: 15 template: metadata: labels: app: affinity role: test spec: containers: - name: nginx image: nginx: latest ports: - containerPort: 80 name: nginxweb affinity: podAntiAffinity: requiredDuringSchedulingIgnoredDuringExecution: # 硬策略 - labelSelector: matchExpressions: - key: app operator: In values: - nginx-pod topologyKey: kubernetes.io/hostname |

如果一个节点上面有一个app= nginx-pod这样的 pod 的话,那么我们的 pod 就别调度到这个节点上面来.

这篇关于K8s亲和反亲和策略的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!