本文主要是介绍docker部署filebeat,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

一、背景

最近公司用到了filebeat,所以学习了下这个技术。filebeat是一个轻量级的日志采集工具,使用golang语言开发,可以将日志转发到es,kafka等。官方对filebeat提供了最全面的支持。filebeat的性能非常好,部署简单,是一个非常理想的文件采集工具。相比logstash它的内存占用更少,filebeat开发的目的也是为了替换logstash。当然也有缺点,比如filebeat官方提供的功能比较单一,往往无法满足我们的需求,我们经常把日志采集到kafka,然后借助flink等工具继续处理。

二、原理

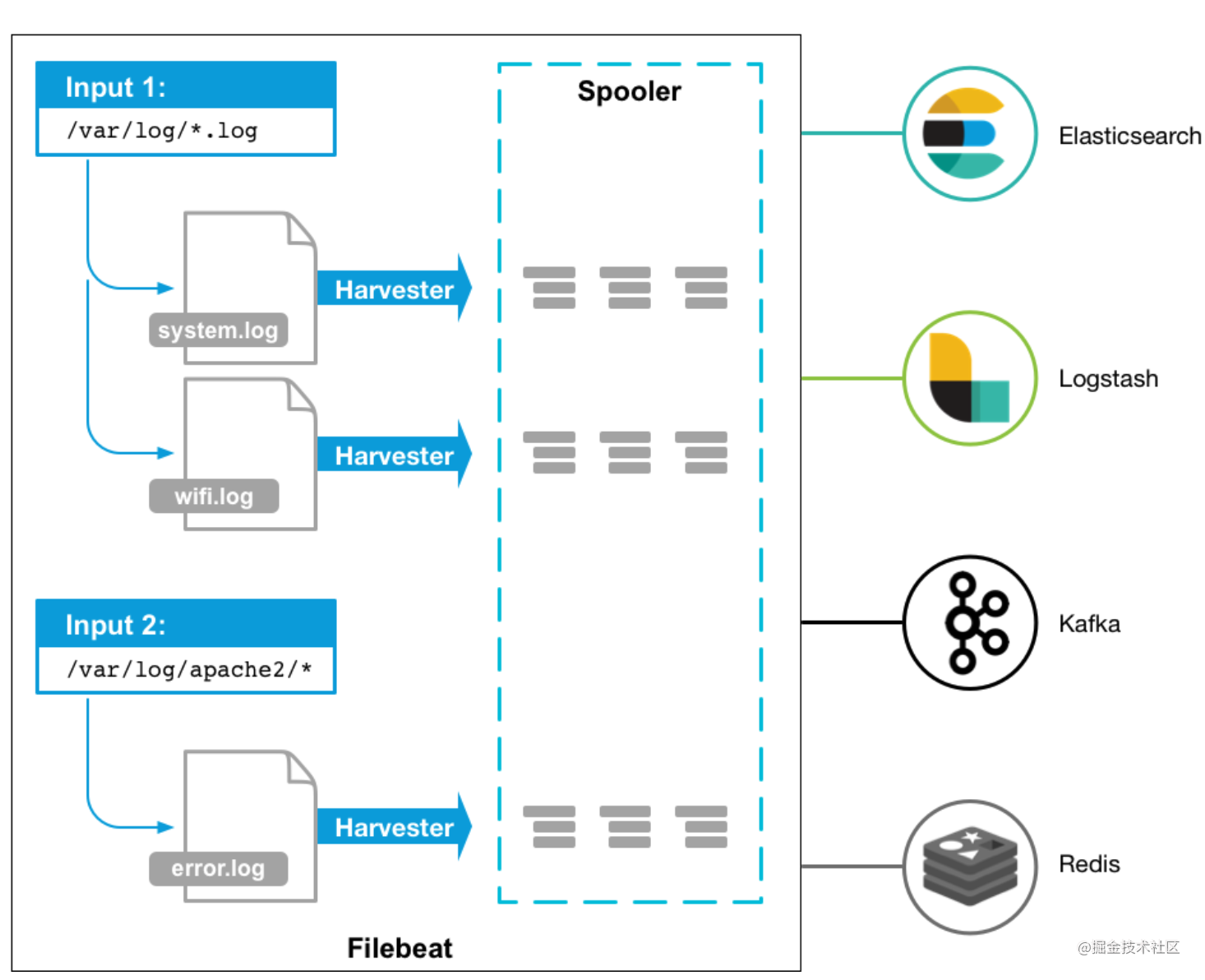

如下图是filebeat的工作流程。首先当业务写入日志后,filebeat的Harvester模块会采集一行或者多行日志,然后Harvester聚合日志发送到输出方,如es、kafka。为了保存文件状态,Harvester会将日志的偏移量记录到registry文件中。每个输入都对应一个registry文件,如果filebeat重启了,会从registry文件恢复。那filebeat如何保证日志至少发送成功一次呢?实际也是用的这个registry文件,发送出后后,如果没有收到成功确认,那么filebat会重新发送,直到成功。

三、docker部署

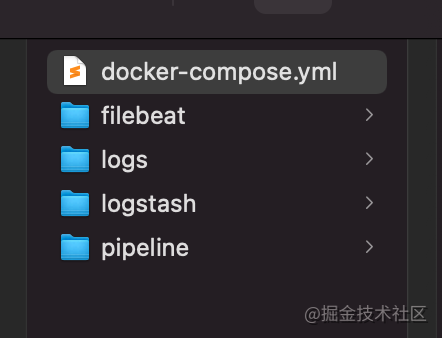

考虑到docker的优势,如一致的运行环境,轻松的迁移等,我们采用docker部署filebeat。下面是docker-compose部署的例子

3.1、配置docker-compose文件

version: "3"

services:elasticsearch:image: elasticsearch:7.11.1container_name: elasticsearchhostname: elasticsearch1environment:- discovery.type=single-node- bootstrap.memory_lock=true- "ES_JAVA_OPTS=-Xms512m -Xmx512m"ports:- 9200:9200- 9300:9300networks:- "elk-net"kibana:image: docker.elastic.co/kibana/kibana:7.1.1environment:- SERVER_NAME=kibana- ELASTICSEARCH_URL=http://elasticsearch1:9200- XPACK_MONITORING_ENABLED=trueports:- "5601:5601"networks:- "elk-net"depends_on:- "elasticsearch"filebeat:image: docker.elastic.co/beats/filebeat:7.1.1volumes:- ./filebeat/logs/nginx:/var/log/nginx/- ./filebeat/logs/biz:/var/log/biz/- ./filebeat/logs/log4j:/var/log/log4j/- ./filebeat/filebeat/filebeat.yml:/usr/share/filebeat/filebeat.ymlnetworks:- "elk-net"depends_on:- "elasticsearch"- "kibana"

networks:elk-net:

这里将采集log4j,nginx和业务日志到es,然后展示到kibana

3.2、配置filebeat

# 详情如下:

filebeat.inputs:

- type: logenabled: truepaths:- /var/log/nginx/*.logscan_frequency: 10stail_files: truefields:index_name: "nginx_log"

- type: logenabled: true#不以[开头的行都合并到上一行的末尾multiline.type: patternmultiline.pattern: '^[[:space:]]+(at|\.{3})[[:space:]]+\b|^Caused by:'multiline.negate: falsemultiline.match: afterpaths:- /var/log/log4j/*.logfields:index_name: "log4j_log"

- type: logenabled: truemultiline.type: patternmultiline.pattern: '^[[:space:]]+(at|\.{3})[[:space:]]+\b|^Caused by:'multiline.negate: falsemultiline.match: afterfields:index_name: "biz_log"scan_frequency: 10spipeline: "extract-traceid-pipeline"paths:- /var/log/biz/*.log# # # 7.x的版本中需要禁用此索引生命周期,否则在指定es索引名字的时候会有问题

setup.ilm.enabled: false

setup.template.name: "my-log"

setup.template.pattern: "my-*"

setup.template.enabled: true

setup.template.overwrite: false# 输出到es

output.elasticsearch:#worker: 1#bulk_max_size: 1500hosts: ["elasticsearch1:9200"]index: "pb-%{[fields.index_name]}-*"indices:- index: "pb-nginx-%{+yyyy.MM.dd}"when.equals:fields.index_name: "nginx_log"- index: "pb-log4j-%{+yyyy.MM.dd}"when.equals:fields.index_name: "log4j_log"- index: "pb-biz-%{+yyyy.MM.dd}"when.equals:fields.index_name: "biz_log"

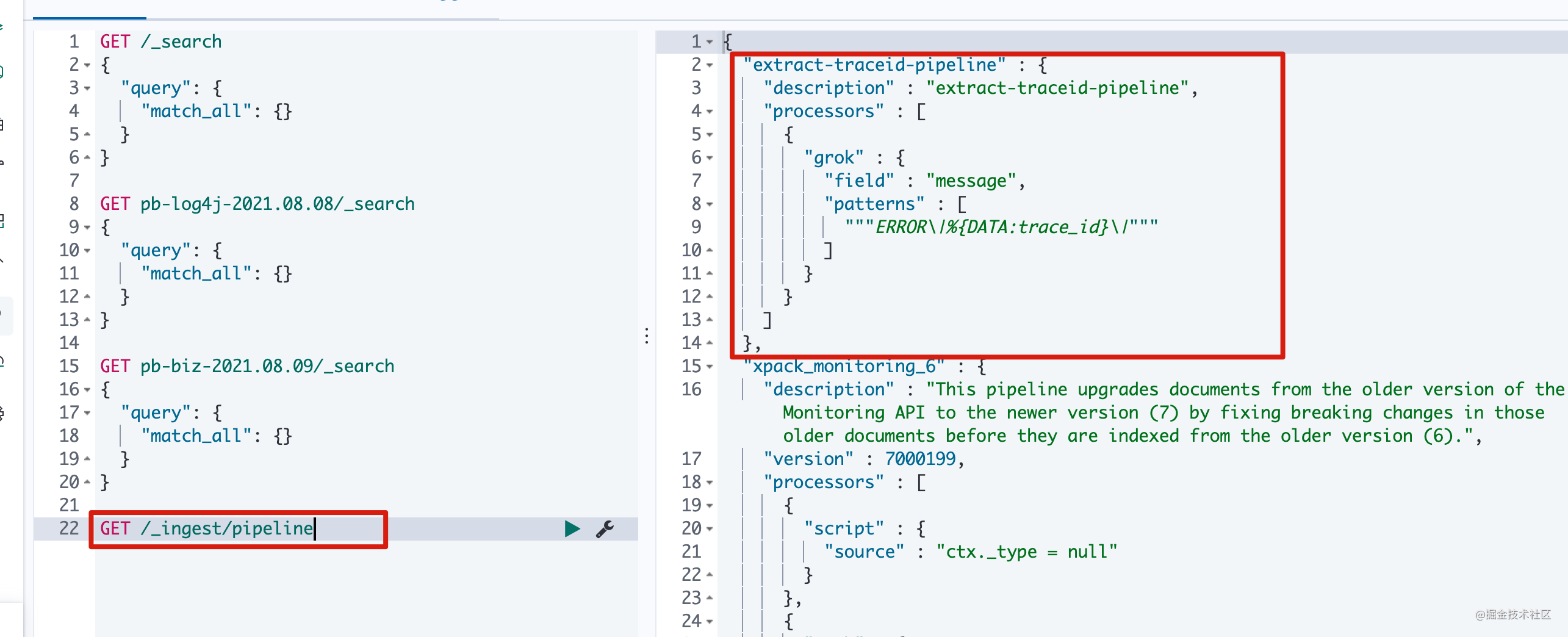

pipeline加到es

curl -H "Content-Type: application/json" -XPUT 'http://127.0.0.1:9200/_ingest/pipeline/extract-traceid-pipeline' -d@extract-traceid-pipeline.json

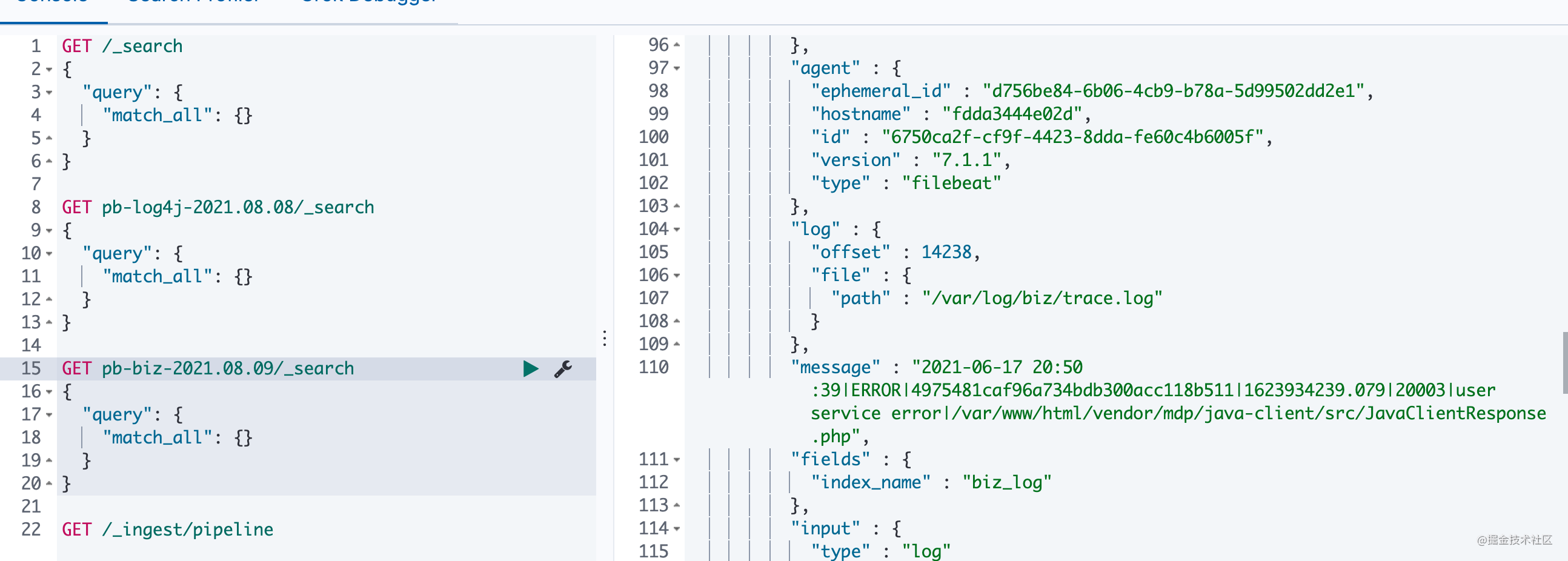

效果如下

四、filebeat关键参数

4.1、如何区分不同的日志

- fields,添加附件字段,可以使values,arrays,dictionaries或者任何嵌套数据。在输出的时候也可以加上条件语句判断,when.equals,然后输出到不同的index

- 输入添加tag字段,可以用于分组

4.2、如何提取参数,以trace为例

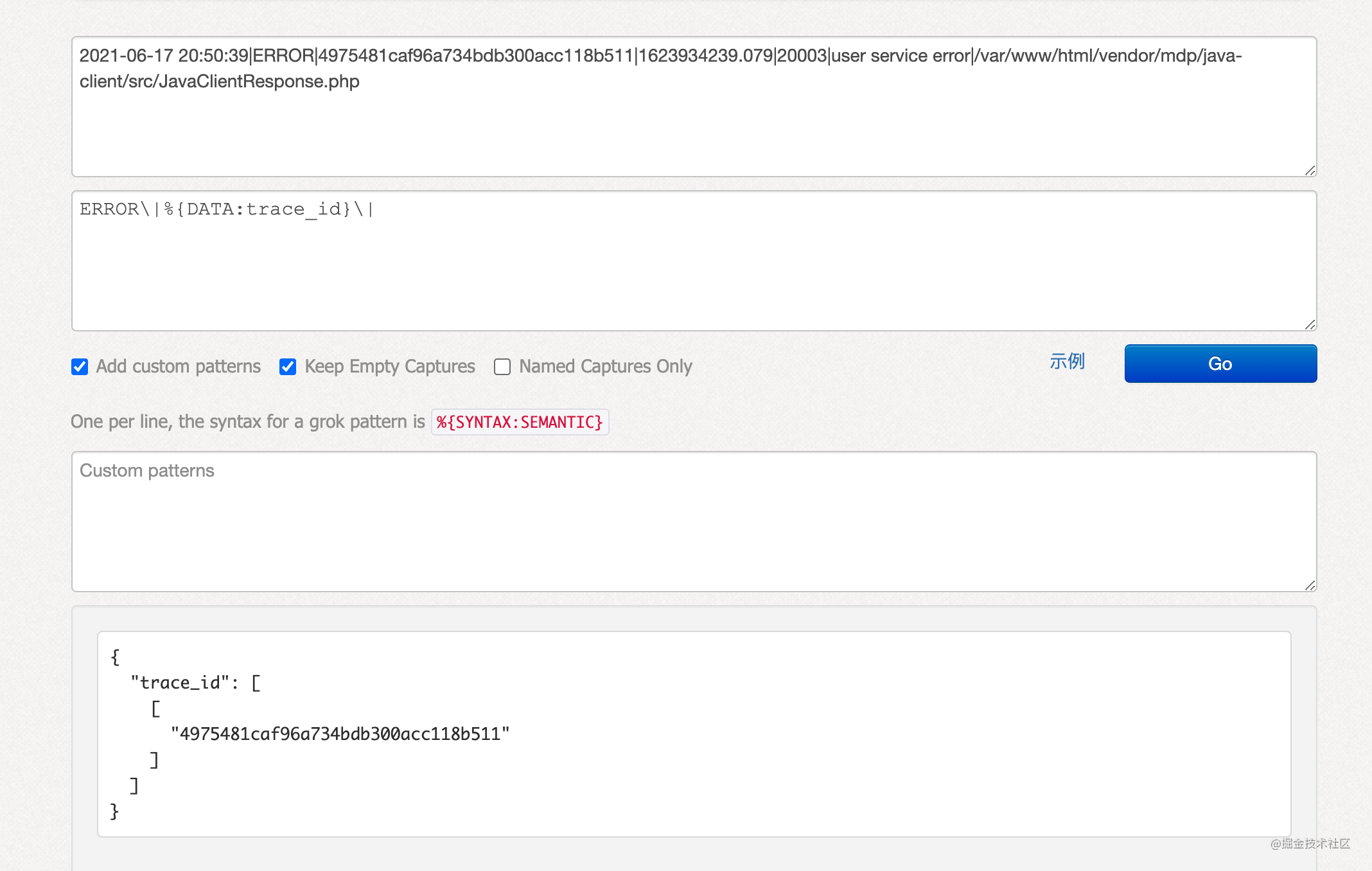

这个使用gork语法可以提取。具体步骤如下

- 编写pipleline文件

"description" : "extract-traceid-pipeline","processors" : [{"grok" :{ "field" : "message","patterns" : ["ERROR\\|%{DATA:trace_id}\\|"] }}]

}

- 测试效果

https://www.5axxw.com/tools/v2/grok.html

写入到es和filebeat配置文件

curl -H "Content-Type: application/json" -XPUT 'http://127.0.0.1:9200/_ingest/pipeline/extract-traceid-pipeline' -d@extract-traceid-pipeline.json

查看写入效果

最终效果

4.2、如何收集java异常堆栈

multiline.type: patternmultiline.pattern: '^[[:space:]]+(at|\.{3})[[:space:]]+\b|^Caused by:'multiline.negate: falsemultiline.match: after

4.3、pipleline为什么不起作用

官网是放在了out中,但是这个版本实际配置不起作用,需要加到input中

- type: logenabled: truemultiline.type: patternmultiline.pattern: '^[[:space:]]+(at|\.{3})[[:space:]]+\b|^Caused by:'multiline.negate: falsemultiline.match: afterfields:index_name: "biz_log"scan_frequency: 10spipeline: "extract-traceid-pipeline"paths:- /var/log/biz/*.log

4.4、业务日志比较复杂,gork无法处理怎么办

这种情况一般是输出到kafka,然后由其他中间件处理,如flink。

output.kafka:# initial brokers for reading cluster metadatahosts: ["kafka1:9092", "kafka2:9092", "kafka3:9092"]# message topic selection + partitioningtopic: '%{[fields.log_topic]}'partition.round_robin:reachable_only: falserequired_acks: 1compression: gzipmax_message_bytes: 1000000

4.5、如何提高采集效率?

-

1、配置bulk_max_size参数即可,这是output.elasticsearch的属性,控制发送给Elasticsearch的bulk API中,每批数据能包含多少条event,默认情况下,我们是每行数据一个document(或者说是event),因此,每次filebeat默认只会发送50行数据,因此,当我们添加进来的数据由几十万行的时候,可以简单推算,我们需要推送多少次bulk request才能完成这个文件的数据录入

-

2、worker这个也是output.elasticsearch的属性,我们可以指定filebeat使用多高的并发来往Elastic发送数据,我们也可以适当的增加这个值,比如我们的ES集群有3个data节点 hosts: [“10.0.07:9200”,“10.0.08:9200”,“10.0.09:9200”],我们可以把这个worker设为 3。

-

3、harvester_buffer_size 这个是Log input的属性,这个属性限定了单个文件采集器harvester每次读取文件的大小,默认的大小是16K。如果我们要增加某些文件的读取吞吐,可以调整这个值的大小。可以通过定义多个input,每个input单独指定的方式来确定不同文件的吞吐大小

参考文档

- 1、官方文档

- 2、logstash 和filebeat 是什么关系

- 3、区分来源

这篇关于docker部署filebeat的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!