本文主要是介绍大模型笔记:最少到最多提示过程 (Least to Most prompting, LtM),希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

LEAST-TO-MOST PROMPTING ENABLES COMPLEX REASONING IN LARGE LANGUAGE MODELS 2023 ICLR

1 概述

- 进一步发展维链提示过程 (CoT prompting)

-

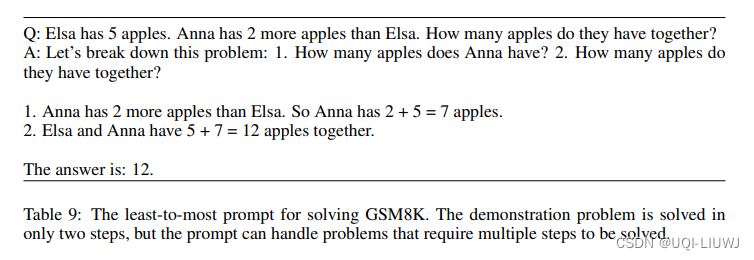

分为两个阶段:

第一阶段:向语言模型提出查询,将问题分解成子问题。 - 第二阶段:再次向语言模型提出查询,逐个解决这些子问题。

- 解决第二个子问题的答案建立在第一个子问题的答案之上。

- 原始问题被附加在最后作为最终的子问题。

-

2 和CoT的对比

Least to Most prompting:

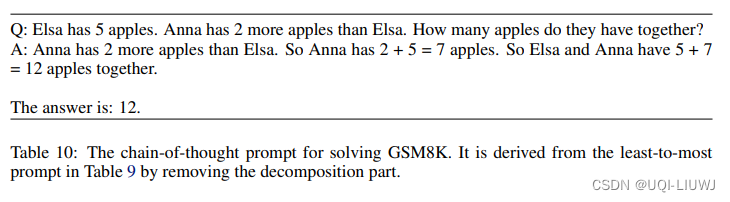

CoT:

这篇关于大模型笔记:最少到最多提示过程 (Least to Most prompting, LtM)的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!