本文主要是介绍【图像版权】论文阅读:CRMW 图像隐写术+压缩算法,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

不可见水印

- 前言

- 背景介绍

- ai大模型水印

- 生成产物不可见水印

- CRMW 在保护深度神经网络模型知识产权方面与现有防御机制有何不同?

- 使用图像隐写术和压缩算法为神经网络模型生成水印数据集有哪些优势?

- 特征一致性训练如何发挥作用,将水印数据集嵌入到神经网络模型中,以确保图像的不可见性和抗压缩性?

前些天发现了一个人工智能学习网站,内容深入浅出、易于理解。如果对人工智能感兴趣,不妨点击查看。

前言

拜读学长的论文

CRMW,它利用图像隐写术和压缩算法来保护神经网络模型免遭非法复制和重新分发

论文:https://arxiv.org/abs/2103.04980

背景介绍

ai大模型水印

对于人工智能大模型,如GPT和DALL·E,水印技术可以分为两大类:数据注入式的黑盒水印和生成产物(例如图像)中的不可见水印。这两种方法各自针对不同的安全和版权保护需求。

-

数据注入式黑盒水印技术(Data Injection-based Black-box Watermarking):这种技术涉及在训练数据中嵌入特定的标记或模式,使得模型在训练过程中学习到这些标记。这种标记的存在不会影响模型的正常性能,但可以通过特定的查询或输入激活,从而验证模型的身份或所有权。这种技术的关键优势在于其隐蔽性和对模型性能的最小影响,使其成为一种有效的知识产权保护手段。

-

生成产物中的不可见水印技术(Invisible Watermarking in Generated Outputs):专注于在AI生成的产品,如图像、文本或音频中嵌入隐蔽的标记。这种水印技术利用人类感知的限制,将水印信息嵌入到生成物中,而不影响其外观或可读性。对于图像来说,这可能涉及在特定频率范围内调整像素值;对于文本,可能涉及使用特定单词或短语的模式。这种方法的目的是确保即使在复制或转发过程中,原始创建者的标记也能够被保留和识别,从而有助于版权保护和追踪非法分发的内容。

这两种水印技术在确保人工智能技术的安全应用和知识产权保护方面发挥着重要作用,旨在平衡创新的自由与创作者权利的保护。

生成产物不可见水印

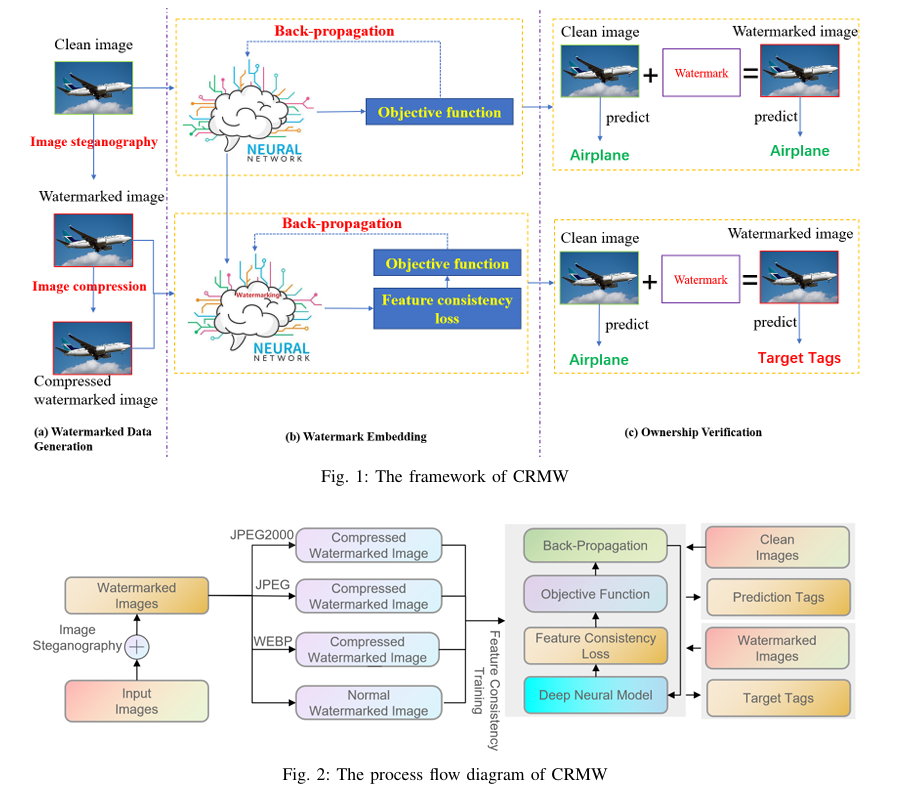

本文提出了一种新颖的方案 CRMW,它利用图像隐写术和压缩算法来保护神经网络模型免遭非法复制和重新分发。

CRMW 在保护深度神经网络模型知识产权方面与现有防御机制有何不同?

CRMW 在保护深度神经网络模型知识产权方面与现有防御机制的不同之处在于几个关键方面:

-

对图像压缩的鲁棒性:CRMW 旨在抵抗图像压缩,使其非常适合存储资源有限的环境,例如工业物联网 (IIoT) 设置 [T2]。 即使在数据被压缩的情况下,这种压缩弹性也能确保水印保持完整,从而增强模型的整体安全性[T3]。

-

水印的不可见性和维护:CRMW利用图像隐写术和压缩算法生成水印数据集,该数据集可以嵌入到神经网络模型中,同时保持不可见性[T6]。 这意味着水印的存在不会影响模型的性能或外观,使攻击者难以检测和删除水印。

-

基于后门的黑盒模型水印:CRMW 采用基于后门的黑盒模型水印方法,允许通过 API [T3] 进行远程所有权验证。 此方法增强了水印的稳健性,并提供了一层针对知识产权盗窃的保护。

-

特征一致性训练:CRMW 利用特征一致性训练将公共水印和压缩水印嵌入到目标深度学习模型中 [T3]。 通过最小化特征空间中正常图像和压缩水印图像之间的距离,CRMW 确保水印有效嵌入到模型中,即使存在压缩也是如此。

总体而言,CRMW 通过解决与图像压缩、不可见性和攻击鲁棒性相关的挑战,提供了一种全面且创新的方法来保护深度神经网络模型的知识产权[T6]。

使用图像隐写术和压缩算法为神经网络模型生成水印数据集有哪些优势?

使用图像隐写术和压缩算法为神经网络模型生成水印数据集具有以下几个优点:

-

隐藏和隐形:图像隐写技术使水印触发器能够以人眼无法察觉的方式嵌入图像数据中[T6]。 这确保了水印保持隐藏状态并且不会影响图像的视觉质量,从而保持数据的完整性和真实性。

-

鲁棒性:通过结合图像压缩算法,水印数据集可以承受压缩过程引起的失真[T3]。 这种稳健性确保即使数据被压缩,水印也保持完整,从而使其能够适应常见形式的图像处理。

-

安全性:隐写术和压缩技术的结合增强了水印数据集的安全性,使未经授权的用户更难以篡改或删除水印[T3]。 这种增加的安全层有助于保护与神经网络模型相关的知识产权。

-

兼容性:图像隐写和压缩算法被广泛使用并与各种类型的图像数据兼容,使其成为为神经网络模型生成水印数据集的通用工具[T6]。 这种兼容性确保了水印处理可以有效地应用于不同类型的图像和数据集。

-

抵御攻击的能力:在水印生成中使用这些先进技术增强了水印针对攻击和未经授权的访问的整体抵御能力[T3]。 通过以隐蔽且稳健的方式嵌入水印,水印数据集变得更能抵抗删除或更改尝试。

总体而言,利用图像隐写术和压缩算法为神经网络模型生成水印数据集提供了一种安全、稳健、隐形的方法来保护知识产权并确保模型的真实性[T6]。

特征一致性训练如何发挥作用,将水印数据集嵌入到神经网络模型中,以确保图像的不可见性和抗压缩性?

特征一致性训练在将水印数据集嵌入神经网络模型中起着至关重要的作用,通过将水印图像的特征与原始图像的特征对齐来确保不可见性和抗图像压缩性。 以下是特征一致性训练对这些方面的贡献:

-

隐形:

- 特征一致性训练旨在最小化特征空间中正常图像和水印图像的特征之间的距离[T3]。 通过这样做,水印的嵌入方式不会显着改变原始图像的特征,确保人眼无法察觉水印。

- 这种功能对齐有助于保持图像的视觉质量和完整性,使潜在攻击者或可能尝试检测和删除水印的未经授权的用户看不到水印。

-

抗图像压缩:

- 通过训练具有特征一致性的神经网络模型,优化水印嵌入过程以承受图像压缩引起的失真[T2]。 即使在压缩后,带水印的图像的特征仍被保留,确保水印保持完整且可识别。

- 这种对图像压缩的抵抗力对于数据可能经历压缩过程的场景至关重要,因为它确保即使在压缩数据中仍然可以准确地提取和验证水印。

-

稳健性:

- 特征一致性训练增强了水印针对攻击以及更改或删除尝试的鲁棒性[T6]。 通过将加水印图像的特征与原始图像的特征对齐,水印变得更能抵抗操纵和篡改。

- 这种稳健性确保水印数据集保持安全可靠,即使面对旨在损害神经网络模型完整性的潜在威胁或恶意活动。

总体而言,特征一致性训练有助于将水印数据集嵌入到神经网络模型中,从而确保不可见性、抗图像压缩性以及针对攻击的整体鲁棒性[T2]、[T3]。

这篇关于【图像版权】论文阅读:CRMW 图像隐写术+压缩算法的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!