本文主要是介绍FusionFS: Fusing I/O Operations using CISCOps in Firmware File Systems——论文泛读,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

FAST 2022 Paper 元数据论文阅读笔记汇总

问题

现代高带宽和低延迟存储技术,如NVMe SSD[50]和3D Xpoint[6],显著提高了I/O性能,从而提高了应用程序性能。然而,软件和硬件I/O开销,包括系统调用、数据移动、应用程序和操作系统中的通信成本,以及存储硬件延迟(例如PCIe),仍然是充分利用存储硬件功能的致命弱点。

现有方法局限性

一种方法是将文件系统移动到用户空间,避免数据和元数据更新的系统调用和内核陷阱来减少软件间接性[22,60,49,27,35]。但主要的I/O开销,如数据和元数据移动成本、主机和设备通信成本(如PCIe延迟)、以及轮询或中断仍然存在。

另一个方法是近存储处理[46]。供应商提出了嵌入存储处理器的计算存储设备(CSD),这些存储处理器从ARM内核[11]、FPGA[49,52,30,44,47,14]到RISC-V处理器[51]。为了降低I/O成本并将计算卸载到CSD,最近的研究探索了应用程序定制技术[14]、软件运行时[47]、系统软件[49]和数据库[46]。这些技术可以分为以下系统:(1)近存储计算卸载系统,包括用于数据库的ActiveStore[46]、PolarDB[14],通过重写应用程序逻辑来卸载计算,专注于数据处理。但这些系统要么缺乏存储管理,要么将管理委托给主机文件系统[14]。前者导致数据和元数据缺乏完整性、崩溃一致性、持久性或跨租户管理存储资源。后者在基本I/O操作方面产生了高昂的I/O开销,并且未能充分利用CSD的潜力。(2)近存储文件系统和键值存储设计来加速I/O和存储管理。如CrossFS[44]、DevFS[30]、Insider[47],绕过操作系统,在存储固件内卸载文件系统和键值存储[49],用于直接I/O。但这些设计缺乏接近存储的处理能力,导致大量数据移动,并且无法管理存储资源(如设备计算和内存)或处理多租

本文方法

我们提出了FusionFS,一种直接访问固件级别的近存储文件系统,利用近存储的计算能力实现快速I/O和数据处理。

-

引入了一种新的抽象CISCOps,将多个I/O和数据处理操作合并为一个融合操作,并将它们卸载以进行近存储处理。通过卸载,CISCOps显著降低了主要的I/O开销,如系统调用、数据移动、通信和其他软件开销。

-

为了增强CISCOps,引入了MicroTx,一种用于I/O和数据处理操作的细粒度崩溃一致性和快速(自动)恢复机制。

-

提出了一种新的完全公平调度器(CFS),用于跨租户的近存储计算和内存资源,从而保持近存储计算资源的高效和公平使用。

开源代码:GitHub - RutgersCSSystems/FusionFS: FusionFS: Fusing I/O Operations using CISCOps in Firmware File Systems, FAST '22

使用微基准、宏基准和实际应用程序,针对最先进的用户级、内核级和固件级文件系统对FusionFS进行评估,结果显示性能提高了6.12倍、5.09倍和2.07倍,恢复速度提高了2.65倍。

实验

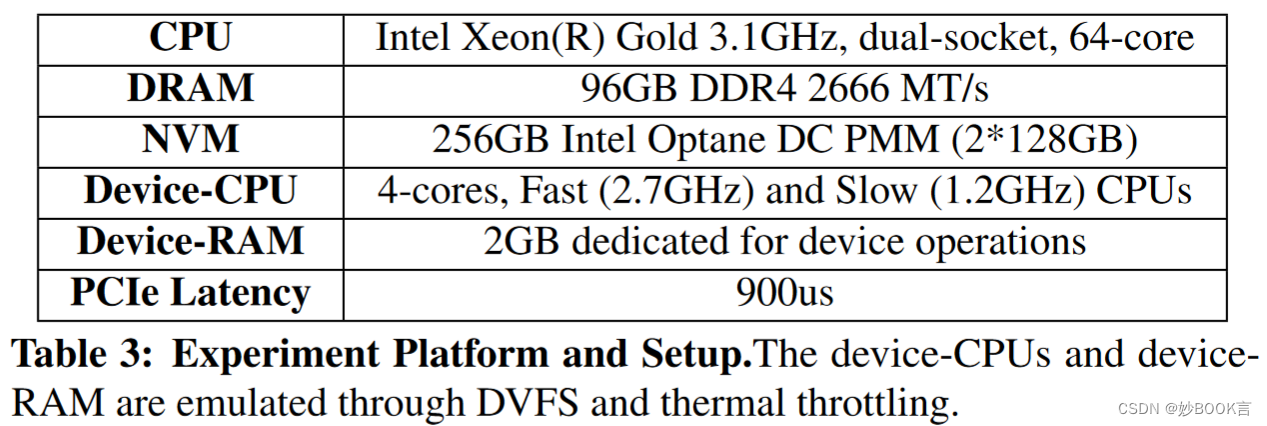

实验环境:模拟

数据集:Filebench,LevelDB,Snappy压缩,Linux文件加密

实验对比:吞吐量、崩溃恢复时间、平均延迟

总结

提出近存储的直接访问固件的文件系统:引入了一种新的抽象CISCOps,将多个I/O和数据处理操作合并为一个融合操作,并将它们卸载以进行近存储处理,从而降低了主要的I/O开销,如系统调用、数据移动、通信和其他软件开销;为了增强CISCOps,引入了MicroTx,进行I/O和数据处理操作的细粒度崩溃一致性和快速(自动)恢复机制;提出了一种新的完全公平调度器(CFS),用于跨租户的近存储计算和内存资源,从而保持近存储计算资源的高效和公平使用。

这篇关于FusionFS: Fusing I/O Operations using CISCOps in Firmware File Systems——论文泛读的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!

![Java实现将byte[]转换为File对象](/front/images/it_default.jpg)