本文主要是介绍深度学习(8)---Diffusion Modle原理剖析,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

文章目录

- 一、简要回顾

- 二、原理解释

- 2.1 核心图:

- 2.2 第一阶段概括

- 2.3 第一阶段解释

- 2.4 第二阶段概括

- 2.5 第二阶段解释

一、简要回顾

1. Diffusion Modle的基本过程可由下面这张图说明:

2. Diffusion Modle与VAE的区别:

二、原理解释

2.1 核心图:

2.2 第一阶段概括

1. 训练阶段步骤如下图所示:(1) 重复下面五个步骤。(2) 从样本库里拿出一张干净的图片。(3) 随机在1-T中生成一个数字。(4) 生成一个纯噪声。(5) 产生一个有噪声的图。

2. 第五步形象说明如下所示,红标指的地方理解成噪声图。

3. 那其实实际过程跟上一篇文章中讲的有一些不一样,可参照下图理解。

2.3 第一阶段解释

1. 在整体思路部分我们已经知道了正向过程其实就是一个不断加噪的过程,于是我们考虑能不能用一些公式表示出加噪前后图像的关系呢。先思考一下后一时刻的图像受哪些因素影响呢?更具体的说 x 2 x_2 x2 是由 x 1 x_1 x1 和所加的噪声共同决定的,也就是说后一时刻的图像主要由两个量决定,其一是上一时刻图像,其二是所加噪声量。我们就可以用一个公式来表示 x t x_t xt 和 x t − 1 x_{t-1} xt−1 时刻两个图像的关系,如下所示:

Z 1 Z_1 Z1 表示添加的高斯噪声。 X t − 1 X_{t-1} Xt−1 和 Z 1 Z_1 Z1 前面的系数是权重,它们的平方和为1。其实 a t a_t at 还和另外一个量 β t β_t βt 有关,关系式如下:

其中 β t β_t βt 是预先给定的值,它是一个随时刻不断增大的值。既然 β t β_t βt 越来越大,则 a t a_t at 越来越小, Z 1 Z_1 Z1 的权重随着时刻增加越来越大,表明我们所加的高斯噪声越来越多,这和我们整体思路所述是一致的,即越往后所加的噪声越多。

2. 现在,我们已经得到了 x t x_t xt 和 x t − 1 x_{t-1} xt−1 时刻两个图像的关系,但是 x t − 1 x_{t-1} xt−1 时刻的图像是未知的。【注:只有 x 0 x_0 x0 阶段图像是已知的,即原图】我们需要再由 x t − 2 x_{t-2} xt−2 时刻图像推导出 x t − 1 x_{t-1} xt−1 时刻图像。依此类推,直到由 x 0 x_0 x0 时刻推导出 x 1 x_1 x1 时刻图像即可。

最后一步的等式用了高斯分布的相关性质。

3. 再列出 x t − 2 x_{t-2} xt−2 时刻图像与 x t − 3 x_{t-3} xt−3 时刻图像的关系,如下所示:

同理,我们将公式5代入到公式4中,得到 x t x_{t} xt 时刻图像和 x t − 3 x_{t-3} xt−3 时刻图像的关系,公式如下:

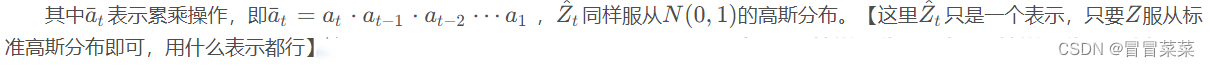

4. 我们如果这么一直计算下去,就会得到 x t x_{t} xt 时刻图像和 x 0 x_{0} x0 时刻图像的关系,公式如下:

2.4 第二阶段概括

生成图阶段步骤如下图所示:(1) 生成一个纯噪声图。(2) 重复T次。(3) 再生成一个纯噪声图。(4) 生成前一个图,这里我认为可以理解成弱噪声图。

2.5 第二阶段解释

1. 逆向过程是将高斯噪声还原为预期图片的过程。一个 x t x_{t} xt时刻的高斯噪声。我们希望将 x t x_t xt 时刻的高斯噪声变成 x 0 x_0 x0 时刻的图像,这是很难一步到位的,所以先考虑 x t x_t xt 时刻与 x t − 1 x_{t-1} xt−1 时刻的关系,然后一步步向前推导得出结论。

2. 利用贝叶斯公式来求 x t − 1 x_{t-1} xt−1 时刻图像,公式如下:

3. 公式8中 q ( X t ∣ X t − 1 ) q(X_t|X_{t-1}) q(Xt∣Xt−1) 可以由正向过程求得,但 q ( X t ) q(X_t) q(Xt) 和 q ( X t − 1 ) q(X_{t-1}) q(Xt−1) 是未知的。由公式7可知,可由 X 0 X_0 X0 得到每一时刻的图像,那当然可以得到 X t X_t Xt 和 X t − 1 X_{t-1} Xt−1 时刻的图像,故将公式8加一个 X 0 X_0 X0 作为已知条件,将公式8变成公式9,如下所示:

现在可以发现公式9右边3项都是可以算的啦,我们列出它们的公式和对应的分布,如下图所示:

4. 知道了公式9等式右边3项服从的分布,我们就可以计算出等式左边的 q ( X t − 1 ∣ X t , X 0 ) q ( X_{t − 1}∣X_t,X_0 ) q(Xt−1∣Xt,X0)。高斯分布表达式和计算过程如下所示:

上图为等式右边三个高斯分布表达式,这个结果怎么得的大家应该都知道叭,就是把各自的均值和方差代入高斯分布表达式即可。现在我们只需对上述三个式子进行对应乘除运算即可,如下图所示:

5. 现在我们有了均值 u u u 和方差 σ 2 σ^2 σ2 就可以求出 q ( X t − 1 ∣ X t , X 0 ) q(X_{t − 1}∣X_t,X_0 ) q(Xt−1∣Xt,X0),也就是求得了 x t − 1 x_{t−1} xt−1 时刻的图像。不知道大家有没有发现一个问题,我们刚刚求得的最终结果 u u u 和 σ 2 σ^2 σ2 中含了 X 0 X_0 X0,这是我们最后想要的结果,这时我们考虑用公式7来反向估计 X 0 X_0 X0,如下所示:

此时将公式10代入到上图的 u u u 中:

现在整理一下 t − 1 t-1 t−1 时刻的均值 u u u 和方差 σ 2 σ^2 σ2,如下所示:

有了公式12我们就可以估计出 X t − 1 X_{t-1} Xt−1 时刻的图像了,接着就可以一步步求出 X t − 2 X_{t-2} Xt−2、 X t − 3 X_{t-3} Xt−3、 X 1 X_1 X1、 X 0 X_0 X0 的图像啦。

这篇关于深度学习(8)---Diffusion Modle原理剖析的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!