本文主要是介绍UserWarning: RNN module weights are not part of single contiguous chunk of memory.,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

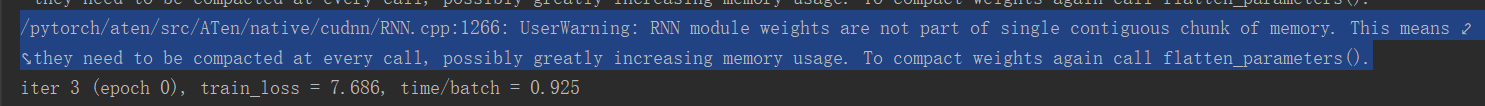

最近几天的代码用到了gru,但是当代码使用DataParallel时,就会报下边图片的问题。使用单GPU训练时就不存在下述警告。

查阅资料以后,发现作者https://blog.csdn.net/feifei3211/article/details/102998288的解决方法非常有效地解决了该警告。为了便于查阅,我还是将问题及问题的解决方法记录下来。解决方法如下:

class en_GRU(nn.Module):def __init__(self, input_size, hidden_size, num_layers):super(en_GRU, self).__init__()self.gru = nn.GRU(input_size, hidden_size, num_layers)def forward(self, x, hidden):if not hasattr(self, '_flattened'):self.gru.flatten_parameters()setattr(self, '_flattened', True)output, h_n = self.gru(x, hidden)return output, h_n在gru的forward函数里加入了标红的语句,self.gru.flatten_parameters()。

这篇关于UserWarning: RNN module weights are not part of single contiguous chunk of memory.的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!