本文主要是介绍论文A simple but tough-to-beat baseline for sentence embedding,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

转载自https://blog.csdn.net/sinat_31188625/article/details/72677088

论文原文:A simple but tough-to-beat baseline for sentence embedding

引言

在神经网络泛滥的时候,这篇文章像一股清流,提出了一个无监督的句子建模方法,并且给出了该方法的一些理论解释。通过该方法得到的句子向量,在STS数据集上取得了不输给神经网络的效果。

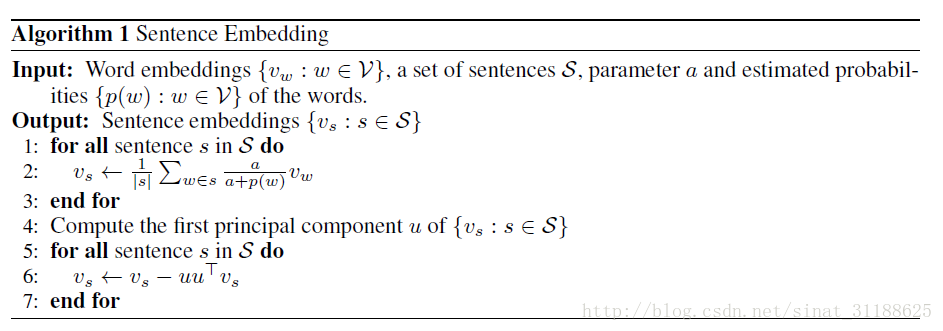

句子建模算法

作者将该算法称之为WR。

W表示Weighted,意为使用预估计的参数给句中的每个词向量赋予权重。

R表示Removal,意为使用PCA或者SVD方法移除句向量中的无关部分。

输入:

预训练的词向量{vw:w∈Vvw:w∈V},例如word2vec、glove等

待处理的句子集合 SS

参数a(论文中建议a的范围: [1e−4,1e−3][1e−4,1e−3])

词频估计{p(w):w∈Vp(w):w∈V}

输出:

句子向量{vs:s∈Svs:s∈S}

实验结果

这是文中的第一个实验——句子相似性评价。

实验使用的数据集都是公共数据集,在这些数据集上方法都取得了不输给RNN和LSTM的表现。

但是在情感分析方面,该方法不及RNN和LSTM,作者分析的了可能原因:

1. 算法使用的词向量(word2vec, glove等)大都基于分布式假说——拥有相近上下文的单词具有相近的意思,但是这些词向量对句子中的antonym problem(我的理解是句子中会出现转折)的感知能力有限。

2. 对于预估计词频来确定权重的方式,在情感分析中可能不是很有效。例如,单词”not”在情感分析中是非常重要的,但是在确定权重时,采用的词频估计会导致其难以在情感分析中发挥作用。

实验复现

作者在Github上开源了该算法代码,于是我在此基础上,对作者的实验继进行复现,实验代码在我的github上

实验结果:(黄色背景的数据为论文中数据,用来和我的实验数据进行比较)

部分数据存在缺失,可能是忘记记录了,但是实验效果和论文基本一致。

总结

这种句子的建模方式非常高效且便捷。由于这是一种无监督学习,那么就可以对大规模的语料加以利用,这是该方法相比于一般有监督学习的一大优势。

通过对实验的复现,发现运行一次程序只需要十几分钟,并且主要的运行耗时都在将词向量模型载入内存这个过程中,这比动不动就需要训练几周的神经网络模型确实要好很多,并且在这个词相似性任务中,与神经网络旗鼓相当。

这篇关于论文A simple but tough-to-beat baseline for sentence embedding的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!

![[论文笔记]LLM.int8(): 8-bit Matrix Multiplication for Transformers at Scale](https://img-blog.csdnimg.cn/img_convert/172ed0ed26123345e1773ba0e0505cb3.png)