本文主要是介绍论文阅读:Removing rain from single images via a deep detail network,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

之前的概述所包含的文章内容主要包括了视频的去雨,以及基于传统方法(像核回归非局部均值滤波、低秩矩阵、基于Patch的建模、判别稀疏编码、GMM层先验等等)的单幅图像去雨。

从这篇往后会认真看去雨的网络方法。

1、2017CVPR : DDN

这篇文章主要基于深度卷积神经网络以及ResNet,提出了一种深度细节网络用于减少从输入到输出的映射范围,使得学习过程更简单。

同时使用先验图像域知识,在训练中聚焦于高频细节,去除背景干扰,将模型聚焦于图像中雨的结构。

CNN可以有效提高模型探索捕捉各种特征的能力。

ResNet可以直接减少从输入到输出的映射范围。

本文的贡献:

1、使用了一种无损的负残差映射,用于定义干净图像和雨图之间的差异。预测残差来减少映射范围。

2、采用了ResNet结构作为图像特征深入探索的参数层,同时利用先验知识并使用图像细节层作为输入,而不是直接在图像上应用ResNet。这样便去除了背景干扰,细节层大部分像素都接近0.

3、合成了一个包含14000对干净雨图的数据集。

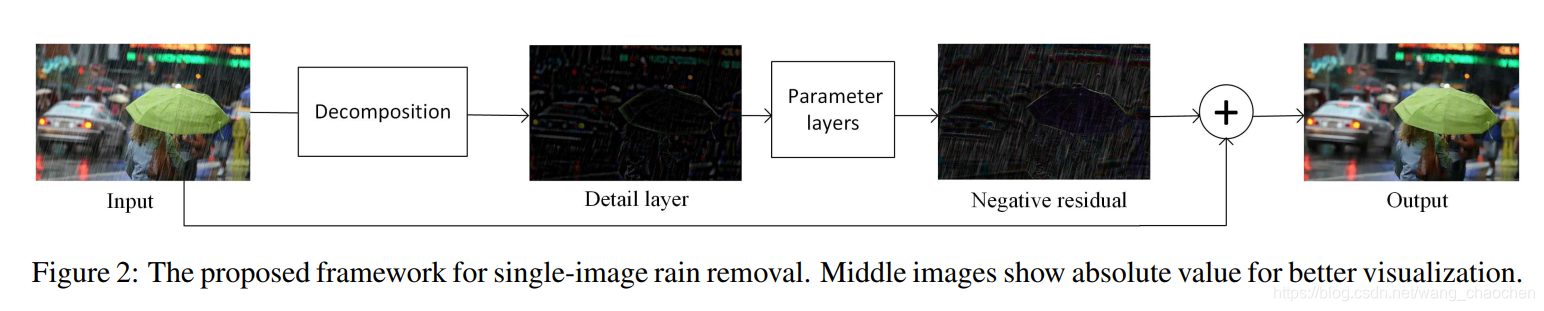

网络框架

其中,参数层结构为ResNet结构。

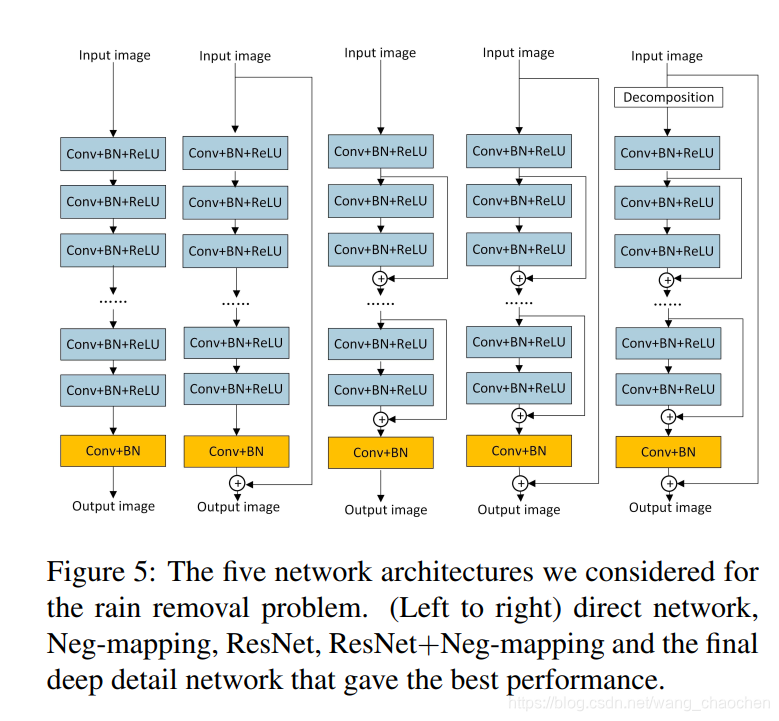

从左至右分别是直接连接的网络(只有从上到下的直接连接,包括conv,BN,ReLU,没有别的连接结构)、负残差映射(增添了一条直接跨越整个网络的跳跃连接,传递无损信息)、ResNet网络结构、ResNet+负残差网络结构、DDN(相比前一个,多了一个分解模块,分解出高频细节层)

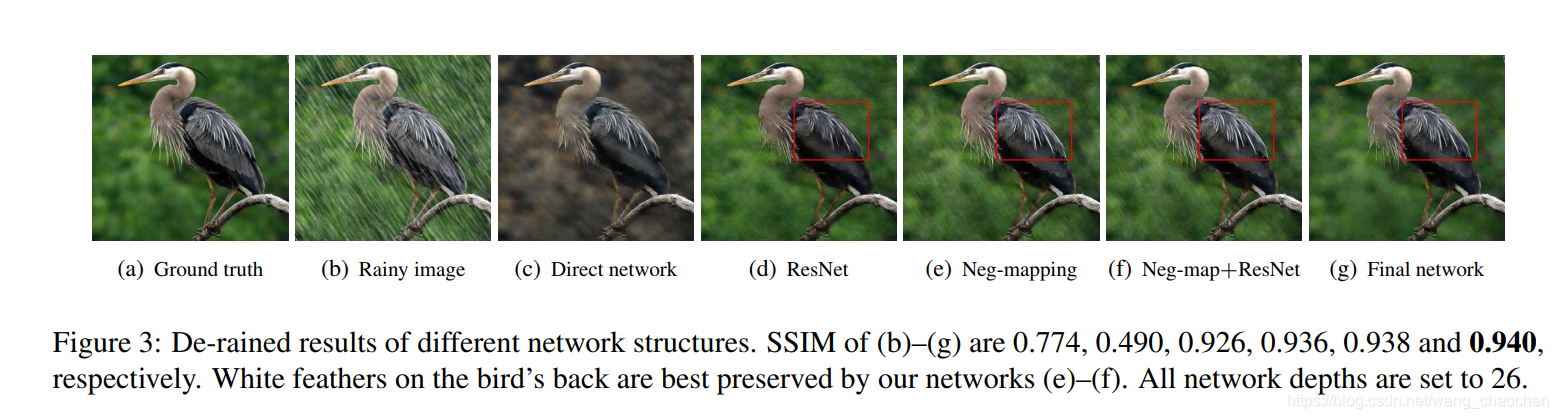

如图,直接连接的网络存在严重的颜色偏移,ResNet网络结构处理的图片羽毛部分出现模糊,负残差映射则是保留了颜色和对象细节但仍然存在一些雨纹,Neg-mapping + ResNet 还存在一些微小的细雨纹。

负残差比ResNet的训练及测试误差更小。

具体网络设计:

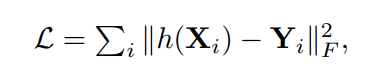

1、深度CNN网络的目标函数:

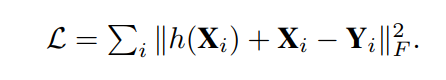

2、负残差映射:

Y-X 减少了像素值的范围,同时跳跃连接用于传播无损信息。

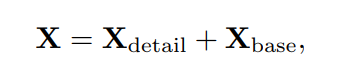

3、细节层作输入

将含雨图像X过一个低通滤波,本文采用指导滤波,得到Xbase,主要是背景部分。

X- Xbase 得到细节层,主要包含雨纹以及物体结构。高频成分。细节层的稀疏性利用

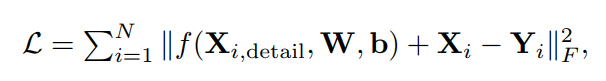

4、最终的目标函数:

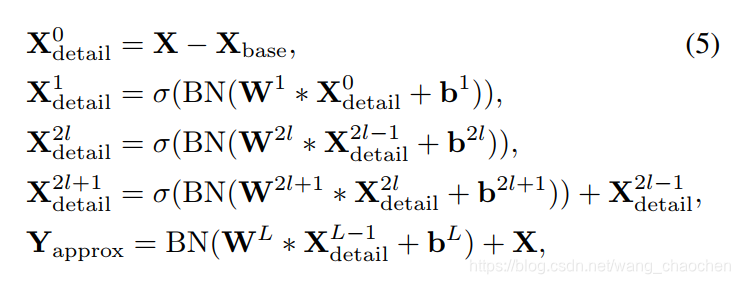

其中f是ResNet,W、b是要学习的网络参数。

5、基本的网络结构:

网络结构中删除了池化操作,保留空间信息。

6、与ResNet的不同:

网络结构虽是基于ResNet进行修改,但还是有很多不同。

ResNet通过改变映射形式来简化学习过程,而我们的深度细节网络使用负映射直接减少了映射范围。ResNet旨在为高级视觉任务(如图像分类和目标检测)训练一个极深的神经网络。我们的深度网络利用图像领域的知识来解决图像回归问题,提高图像质量。

ResNet使用图像本身作为网络的输入,而我们的网络使用细节层进行改进的训练,以及提出的负映射。

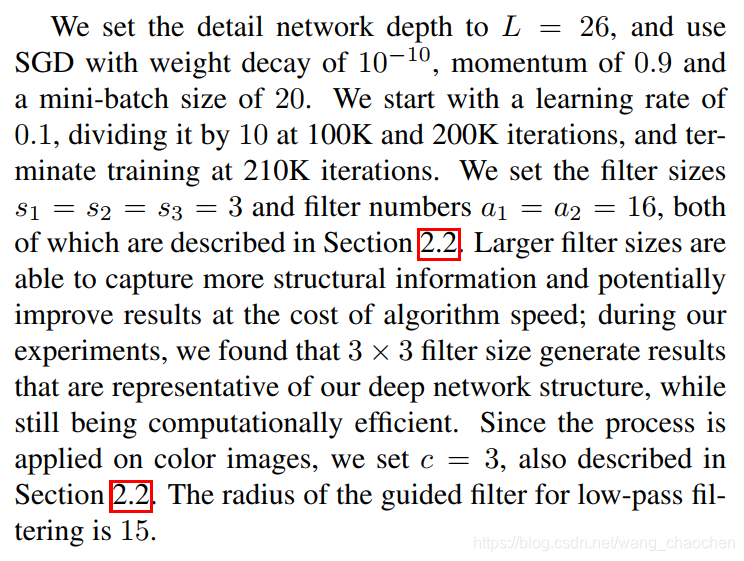

训练:

使用随机梯度下降法(SGD)来最小化目标函数。

数据集:1000张干净的图片增添14个不同方向和强度的雨纹,生成14000张图片。

环境:Caffe,耗费14个小时。

参数:

分页符

这篇关于论文阅读:Removing rain from single images via a deep detail network的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!