本文主要是介绍王小草【机器学习】笔记--分类算法之决策树,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

标签(空格分隔): 王小草机器学习笔记

决策树可以用于解决分类问题,也可以用于解决连续型的回归预测问题,是业界常说的机器学习的十大算法之一。决策树也属于监督学习的一种。

在教科书里必须会出现的,常用的决策树大概有3种,分别是C4.5,ID3,CART算法。本章中都会一一详细讲述。

1. 决策树的结构

决策树是由节点和有向边组成。节点分两种类型:内部节点与叶子节点。

内部节点:表示的是一个特征

叶子节点:表示的是一个类。

也就是说样本通过内部节点的各个特征的判断,最终会到达属于它的叶子节点,从而就获得了它被分在的类别。

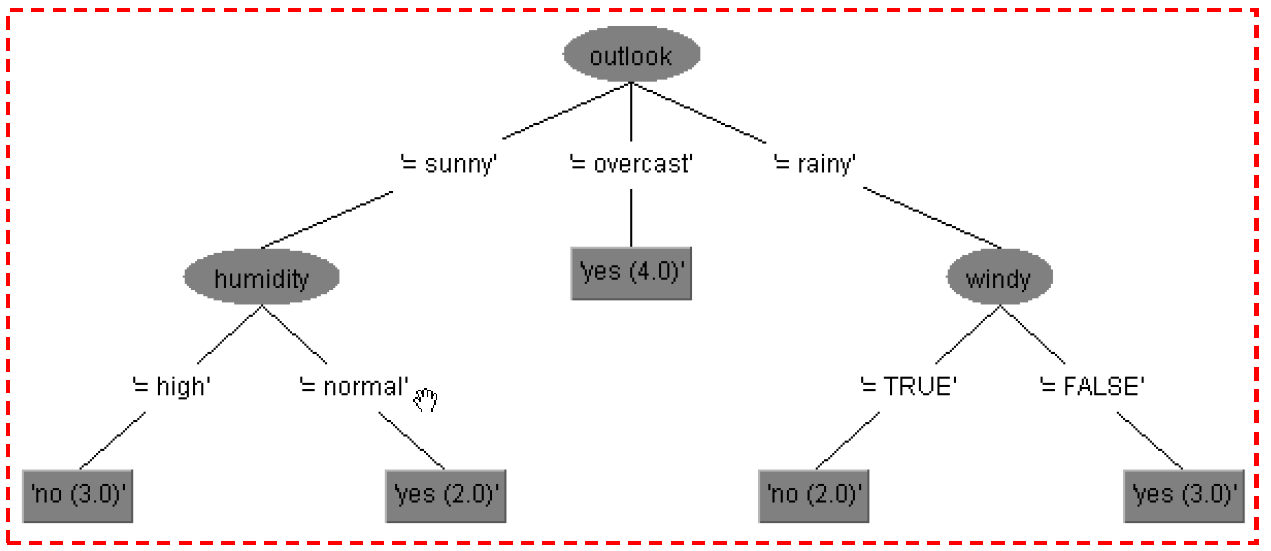

下面是一个决策树的图形:圆形节点表示内部节点(特征),方形节点表示叶子节点(类别)。这个决策树有两个类别:出去打球,不出去打球。有三个特征:outlook,humidity,windy。

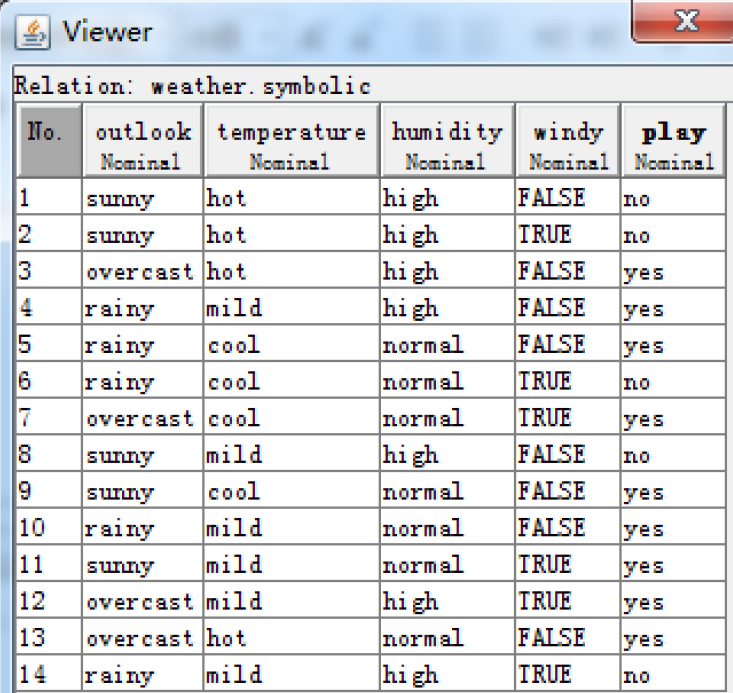

这是一个很经典的案例,下面是原始数据。

结合数据与图形进行解析:首先拿了outlook这个特征来进行分类,outlook有三种值:sunny,overcast,rainy。当取overcast的时候,有4个样本,4个样本全是yes的类别,所以没有必要再继续使用其他特征去分类了。当取sunny的时候有5个样本,但是5个样本中类别不一致(3个no,2个yes),所以接着又选取了humidity这个特征来做分类,当outlook为sunny,humidity为high的时候,全部3个样本都为no,当humigity为normal的时候,全部2个样本为yes。既然同一个节点的类别一致了,那么分类也到此结束了。再看另一侧,当outlook为rainy的时候,仍然没有分出一致的类别,所以使用了windy这个特征进一步做分类,发现在outlook为rainy,windy为true的时候全部2个样本都是no,当为false的时候全部3个样本为yes。至此,每一个叶子节点上的类别都是一致的了,所以决策树通过这个3个特征非常准确得分出了所有样本的类别。

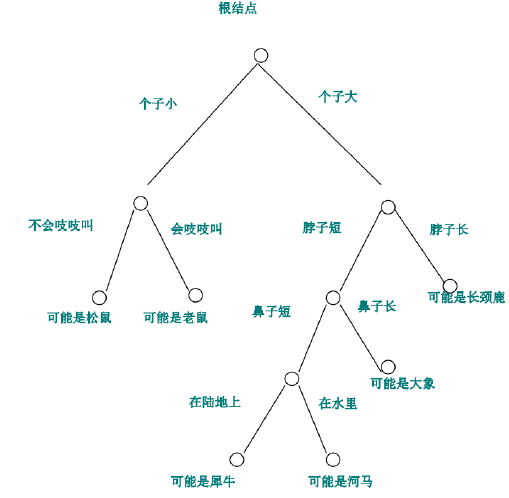

再通过两个图形来认识一下决策树的结构:

案例一:相亲之前通过年龄,长相,收入,是否为公务员这4个特征来分类“约会”与“不约会”的两个类别

案例二:通过个头大小,叫声,脖子长短,鼻子长短,水生与陆生这5个特征来分类动物的种类。

2. 特征的选择

上面的介绍中也看到,要做到正确的分类,大部分时候都是需要用到多个特征的,有效特征越多则分类的错误率可能就越低。

但是那么多特征,到底要先使用哪个特征后使用哪个特征呢?特征使用的先后顺序是否会对分类的准确性或是效率产生影响呢?

那必须会呀~

那要通过什么指标来衡量每个特征,并依次选出最先使用的特征呢?

本节我首先介绍一下熵的含义与计算,然后依次介绍C4.5,ID3,Cart三种算法的特征选择标准。

2.1 熵,条件熵

2.1.1熵的定义

熵entropy表示对随机变量不确定性的度量。

设X是一个取有限个值的离散随机变量。

比如下表,x取3个值,并对应了三个概率:

| x= | 1 | 2 | 3 |

|---|

这篇关于王小草【机器学习】笔记--分类算法之决策树的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!