本文主要是介绍nn.LayerNorm解释,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

这个是层归一化。我们输入一个参数,这个参数就必须与最后一个维度对应。但是我们也可以输入多个维度,但是必须从后向前对应。

import torch

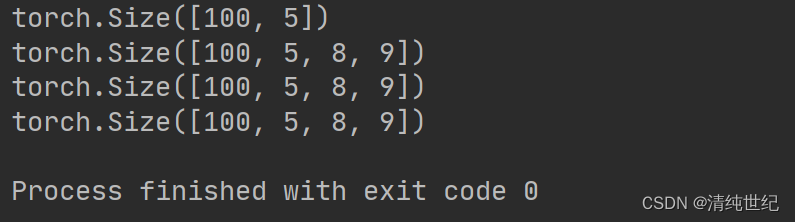

import torch.nn as nna = torch.rand((100,5))

c = nn.LayerNorm([5])

print(c(a).shape)a = torch.rand((100,5,8,9))

c = nn.LayerNorm([9])

print(c(a).shape)a = torch.rand((100,5,8,9))

c = nn.LayerNorm([8,9])

print(c(a).shape)a = torch.rand((100,5,8,9))

c = nn.LayerNorm([5,8,9])

print(c(a).shape)

这篇关于nn.LayerNorm解释的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!