本文主要是介绍机器学习---归纳偏执(Inductive Bias),希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

归纳偏执(Inductive Bias)

背景与概念介绍

No-Free-Lunch (不存在免费午餐理论)提出没有先验知识进行学习是不可能的。如果我们不对特征空间有先验假设,则所有算法的平均表现是一样的。

一、概念

Inductive bias,我们来看一下这两个单词是什么意思:

- 归纳(Induction)是自然科学中常用的两大方法之一(归纳与演绎, induction and deduction),指的是从一些例子中寻找共性、泛化,形成一个比较通用的规则的过程;

- 偏置(Bias)是指我们对模型的偏好。

通俗的讲,归纳偏执可以理解为:

在现实生活中,我们会从观察到的现象中归纳出一定的规则。

根据这些规则对模型做一定的约束,归纳偏置即变成了关于目标函数的必要假设

提出这个假设的目的是为了选择出更符合现实规则的模型。在此过程中,归纳偏置起到“模型选择”的作用

二、举例

深度神经网络就偏好性地认为,层次化处理信息有更好效果;

深度神经网络就偏好性地认为,层次化处理信息有更好效果;

循环神经网络则将时序信息考虑进来,强调顺序重要性;

图网络则认为中心节点与邻居节点的相似性会更好引导信息流动。

注意到,Vision Transformer 的图像特定归纳偏置比 CNN 少得多。在 CNN 中,局部性、二维邻域结构 和 平移等效性 存在于整个模型的每一层中。而在 ViT 中,只有 MLP 层是局部和平移等变的,因为自注意力层都是全局的。二维邻域结构 的使用非常谨慎:在模型开始时通过将图像切分成块,并在微调时调整不同分辨率图像的位置嵌入 (如下所述)。此外,初始化时的位置嵌入不携带有关图像块的 2D 位置的信息,图像块之间的所有空间关系都必须从头开始学习。

- CNN 的 Inductive Bias是局部性 (Locality)和空间不变性 (Spatial Invariance) / 平移等效性 (Translation Equivariance),即空间位置上的元素 (Grid Elements) 的联系/相关性近大远小,以及空间 平移的不变性 (Kernel 权重共享);

- RNN 的 Inductive Bias 是 序列性 (Sequentiality) 和 时间不变性 (Time Invariance),即序列顺序上的时间步 (Timesteps) 有联系,以及时间变换的不变性 (RNN 权重共享)。

三、意义

归纳偏置的意义或作用是使得学习器具有了泛化的能力。

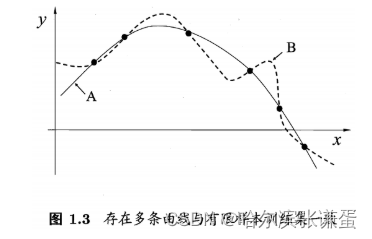

对于上图中的 6 个离散实心点,可由很多不同的曲线拟合之。但训练的模型必然存在一定的 “偏好” 或者说 “倾向”,才能学习出模型自己认为正确的拟合规则。

显然,加了一定正则的偏置的实线 A 比虚线 B 更为简单而通用 (模型复杂度受到惩罚而更低,恰当拟合数据点,泛化性能更好)。

参考资料及推荐:

归纳偏置 (Inductive Bias)_industive bias-CSDN博客

【理论知识学习32】归纳偏差与选择性偏差(概念作用以及举例说明)-CSDN博客

【机器学习】浅谈 归纳偏置 (Inductive Bias)_何处闻韶的博客-CSDN

这篇关于机器学习---归纳偏执(Inductive Bias)的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!