本文主要是介绍为什么能通过文本分析情感?,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

通过文本分析情感,通常称为情感分析(Sentiment Analysis)或意见挖掘(Opinion Mining),是自然语言处理(NLP)的一个分支。这项技术能够识别和提取文本中的主观信息(对呀!所有的文本实际上都是向我们自己开始不断地进行一个基础的信息进行一个传递),并对作者的情感倾向、情绪状态或观点(以下就是其开始不断地进行的基础内容)进行分类。以下是为什么能够通过文本分析情感的几个关键点:

1. **语言特征**:

人类在表达情感时会使用特定的语言特征,如形容词、副词、感叹词和情感丰富的词汇。

2. **情感词汇**:

存在大量与特定情感状态相关联的词汇,如“快乐”、“悲伤”、“愤怒”等,这些词汇可以直接反映作者的情感。

3. **上下文理解**:

通过理解文本中的上下文,可以更准确地判断词汇的情感色彩,因为相同的词汇在不同的上下文中可能表达不同的情感。

4. **语义分析**:

通过分析文本的语义内容,可以识别出隐含的情感和观点,即使这些情感和观点没有直接通过情感词汇表达(类似于男女双方谈恋爱的时候,所需要不断地进行做出的一个决策和分析)。

5. **情感词典和数据库**:

研究人员和数据科学家构建了包含情感标签的词典和数据库,这些资源可以用来识别和分类文本中的情感。

6. **机器学习模型**:

利用机器学习算法,可以从标注数据中学习情感的模式,从而对未见过的文本进行情感分类。

7. **文本表示**:

通过将文本转换为数值形式(如词袋模型、TF-IDF、词嵌入等),机器学习模型可以处理和分析文本数据。

词袋模型、TF-IDF、词嵌入

词袋模型(Bag of Words, BoW)、TF-IDF(Term Frequency-Inverse Document Frequency)和词嵌入(Word Embedding)是自然语言处理中用于文本表示的三种常见技术。它们各自有不同的特点和应用场景:

1. **词袋模型(BoW)**:

- 词袋模型是一种简单的文本表示方法,它将文本视为一个词汇集合,不考虑词序和语法结构(这个不考虑的内容就是他的缺点。)。

- 在BoW中,文本被表示为一个向量,向量的每个维度对应于词汇表中的一个词,而向量的值通常表示该词在文本中出现的频率。

什么是向量?

计算机科学中的向量:在计算机科学中,向量通常指的是数组或类似的数据结构,它们可以存储一系列元素,这些元素可以是数字、字符或其他数据类型。

机器学习中的向量:在机器学习领域,数据通常被表示为特征向量,这些向量是实数的集合,用于描述数据点的特征。例如,在文本处理中,词嵌入可以将单词转换为向量,以便在向量空间中进行数学运算和分析。

- BoW忽略了词汇之间的顺序,因此无法捕捉语义信息(他只是不断地追踪一个基础的频率,但是实际上其没有办法能够识别到其内部的语义信息,这就是一件不太好的事情。)。

2. **TF-IDF**:

- TF-IDF是一种统计方法,用于评估一个词对于一个文档集或一个语料库中的其中一份文档的重要性(上一种方法是实现对于其中内容进行一个基础的登记和登录(统计的是其内部的一个词汇的出现的频率!))。

- TF代表词频(Term Frequency),表示词条(关键字)在文档(这里的限定条件明显大于了前面一种的基础的限定条件,这是一个不可以进行忽视的地方)中出现的频率。

- IDF代表逆文档频率(Inverse Document Frequency),表示词条的普遍重要性。

如何理解词条的普遍重要性?

词条的普遍重要性通常是指一个词在大量文档或语料库中出现的频率和分布情况*(这里增加了一个基础的超级特殊的值,这个特殊的值就是分布情况,这是一个很独特的值),以及它在区分不同文档类别方面的作用。在自然语言处理和信息检索领域,理解词条的普遍重要性对于文本分析和文档表示至关重要。以下是几个关键点,帮助你理解词条的普遍重要性:

1. **频率**:

词条(关键字)出现的频率是衡量其重要性的基本指标。一个词如果在很多文档中都频繁出现,可能表明它是一个通用词,而不是特定主题的关键词(为什么而不是特定主题的关键词,因为一个词如果在很多文档中(这是一个关键地方的知识的认识点)都频繁出现)。

2. **区分能力**:

如果一个词条在特定类型的文档中频繁出现,而在其他类型的文档中很少出现,那么它可能对区分这些文档类别具有重要作用。

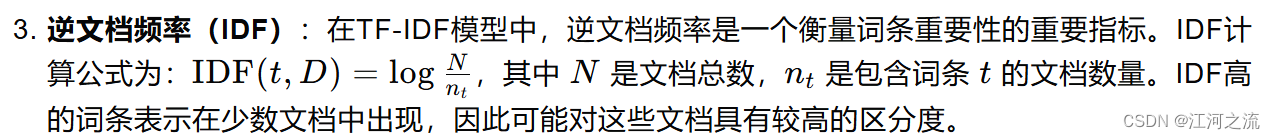

3. **逆文档频率(IDF)**:

在TF-IDF模型中,逆文档频率是一个衡量词条重要性的重要指标。IDF计算公式为:\[ \text{IDF}(t, D) = \log \frac{N}{n_t} \],其中 \( N \) 是文档总数,\( n_t \) 是包含词条 \( t \) 的文档数量。IDF高的词条表示在少数文档中出现,因此可能对这些文档具有较高的区分度(数学就是人们不断地告别迷茫的一个关键性知识和一个关键性的助手)。

4. **信息增益**:

词条的普遍重要性也可以通过信息增益来衡量,即词条在减少文档类别不确定性方面的作用。

5. **关键词提取**:

在文档中识别关键词时,通常会寻找那些普遍重要性高的词条,因为它们可能对文档的主题有较强的指示作用。

6. **主题建模**:

在主题建模中,词条的普遍重要性有助于识别文档中的主要主题和子主题。

7. **文本分类**:

在文本分类任务中,具有高普遍重要性的词条可以作为分类特征,帮助模型区分不同的文档类别。

8. **搜索引擎优化(SEO)**:

在SEO中,理解词条的普遍重要性有助于优化网页内容,提高搜索引擎排名。

9. **数据稀疏性**:

在高维文本数据中,普遍重要的词条可以减少数据稀疏性,提高模型的性能。

10. **语言学特征**:

从语言学角度来看,普遍重要的词条可能反映了语言使用中的一些基本模式和规律。

理解词条的普遍重要性有助于我们更好地处理和分析文本数据,无论是在学术研究、商业分析还是技术开发中,这一概念都有着广泛的应用。

- TF-IDF帮助我们理解词条(关键字)在文档中的重要性,对于文档d中的词条t,它的TF-IDF值是:`TF(t, d) * IDF(t, D)`,其中D是文档的集合。

- 与BoW相比,TF-IDF可以减少常见词的权重,增加罕见词的权重。

3. **词嵌入(Word Embedding)**:

- 词嵌入是一种将词汇映射到向量的技术,这些向量通常通过机器学习模型从大规模文本数据中学习得到。

- 与BoW和TF-IDF不同,词嵌入能够捕捉词与词之间的语义关系,例如,“国王”和“女王”在向量空间中的距离可能比“国王”和“椅子”更近。

- 词嵌入模型的例子包括Word2Vec、GloVe(Global Vectors for Word Representation)和FastText。

每种文本表示方法都有其优势和局限性:

- BoW简单直观,易于实现,但无法捕捉词序和语义信息。

- TF-IDF能够突出文档中重要的词汇,但仍然无法表示词与词之间的语义关系。

- 词嵌入能够提供丰富的语义信息,但计算成本较高,且需要大量的训练数据。

在实际应用中,选择哪种文本表示方法取决于具体任务的需求和可用资源。有时,这些方法也可以结合使用,以获得更好的结果。

8. **语法分析**:

通过分析文本的语法结构,可以更好地理解情感表达的方式,例如,某些句型可能更倾向于表达负面情绪。

9. **情感强度的量化**:

可以量化文本中情感的强度,例如,通过分析特定情感词汇的使用频率或强度级别。

10. **跨文化和跨语言分析**:

情感分析不仅限于一种语言,通过跨语言的NLP技术,可以分析不同文化和语言背景下的情感表达。

11. **社交媒体和网络文本**:

社交媒体和在线评论提供了丰富的情感表达文本,这些文本可以用于训练和测试情感分析模型。

情感分析在商业智能、市场研究、品牌监控、客户服务和政治分析等领域有着广泛的应用。通过分析消费者的情感反馈,企业和组织可以更好地理解公众的观点和需求。

参考教材:

ISBN 978-7-5661-3092-1 对应的是一本名为《Python 数据分析 微课版》的书籍,作者是杨旭,出版社为哈尔滨工程大学出版社,出版年份为 2021 年。

(资料来源:kimi编辑器)

这篇关于为什么能通过文本分析情感?的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!