本文主要是介绍【Python数据预处理系列】精通Pandas:数据清洗中的字符串分割技巧(例子:如何将籍贯列中的横线替换为省份和市区),希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

本文将深入探讨Pandas库在数据清洗中的应用,特别是字符串分割技巧。

在数据分析的预处理步骤中,有效地处理和准备原始数据是至关重要的一步。我们将通过具体示例,展示如何使用Pandas中的

.str.split()函数来对数据集中的字符串进行分割,进而提取所需信息。

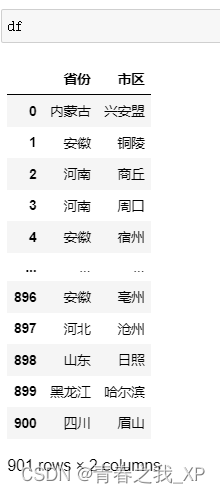

本文例子讲解如何将包含横线的籍贯列拆分为省份和市区两个部分。首先,我们创建了一个空的DataFrame,然后使用data["籍贯"].str.split('-')方法对"籍贯"列进行字符串分割。接着,我们分别提取了分割后的第一部分(省份)和第二部分(市区),并将它们添加到新的DataFrame中。这些操作可以帮助我们在数据分析过程中更好地处理和利用原始数据。

一、准备数据

此数据是关于每个样本的籍贯信息,前半部分为省份或自治区,后半部分为市区。

即”省份-市区“

import pandas as pd

data=pd.read_excel("籍贯.xlsx")

二、 使用.str.split('-')方法进行字符串分割。

#首先,创建一个空的DataFrame,命名为df。

df=pd.DataFrame()#使用data["籍贯"].str.split('-')方法对"籍贯"列进行字符串分割。

data["籍贯"].str.split('-')

这里.str.split('-')是pandas中的一个内置函数,用于对字符串进行分割。

是针对DataFrame中的Series对象data["籍贯"],用于执行字符串操作。

三、提取分隔符”-“前的省份数据

str[0]表示提取列表中的第一个元素,即分割后的第一部分,它代表了省份。

#str[0]表示提取列表中的第一个元素,即分割后的第一部分,它代表了省份。

df['省份'] =data["籍贯"].str.split('-').str[0]四、提取分隔符”-“后的市区数据

str[1]表示提取列表中的第二个元素,即分割后的第二部分,它代表了市区。

#str[1]表示提取列表中的第二个元素,即分割后的第二部分,它代表了市区。

df['市区'] = data["籍贯"].str.split('-').str[1]#df['地区'] = df['省份'] + '-' + df['市区']

这篇关于【Python数据预处理系列】精通Pandas:数据清洗中的字符串分割技巧(例子:如何将籍贯列中的横线替换为省份和市区)的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!