本文主要是介绍防范AI诈骗:技术、教育与法律的共同防线,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

防范AI诈骗:技术、教育与法律的共同防线

引言

随着人工智能技术的飞速发展,AI在各个领域展现出巨大潜力的同时,也带来了一些新的挑战。其中,利用AI技术进行的诈骗行为,如AI换脸、AI换声等,给人们的财产安全带来了威胁。本文将探讨如何通过技术、教育和法律的结合,构建一个更加安全的网络环境。

1.AI诈骗的常见形式

1.1 AI换脸技术

AI换脸技术,也称为深度伪造(Deepfake),通过深度学习算法,可以将一个人的面部特征映射到另一个人的面部,从而生成逼真的视频。这种技术被用于制作虚假视频,误导公众,甚至用于诈骗。

技术原理: 深度伪造技术通常利用深度学习中的生成对抗网络(GANs)来创建逼真的假视频。两个神经网络相互竞争:一个生成假视频,另一个尝试识别假视频。随着时间的推移,生成器网络学会创建越来越难以区分的假视频。

诈骗案例:

- 政治人物的虚假视频,可能影响公众舆论或选举结果。

- 名人或公众人物的虚假视频,用于敲诈勒索或诽谤。

- 伪造视频证据,用于法律诉讼或误导调查。

- 2024年4月,福州市某科技公司法人代表郭先生10分钟内被骗430万元。案发时,他的好友通过微信视频联系他,称有朋友在外地竞标,需要430万元保证金,想借用郭先生公司的账户走账。基于对好友的信任,加上已经视频聊天“核实”了身份,郭先生进行了转账。事后,郭先生拨打好友电话才得知被骗。

防范措施:

- 开发和使用专门的深度伪造检测工具。

- 增强视频内容的验证机制,如数字水印和区块链技术。

- 提高公众对深度伪造的认识,教育人们如何识别假视频。

1.2 AI换声技术

AI换声技术通过模仿特定人的声音,生成音频文件,用于欺骗电话另一端的人,实施诈骗。

技术原理: AI换声技术通过声音识别和合成技术,模仿特定人的声音特征,生成听起来与真人无异的音频。

诈骗案例:

- 通过模仿公司高层的声音,欺骗员工进行财务转账。

- 模仿亲人的声音,骗取紧急资金或个人信息。

- 近日,小李的“大学同学”通过QQ跟她借钱。为了打消小李的顾虑,对方还打来一段四五秒的视频电话,小李见视频中的人确实是“同学”本人,便放心地给对方转了3000元。然而,没过多久“同学”又提出了借钱的请求,就在小李准备第二次转账时,她察觉到了异常,便给对方打了电话,这才发现同学的账号被盗,和自己借钱的并不是同学,马上报警。

防范措施:

- 使用多因素认证,确保交易和通信的安全。

- 增加对声音识别技术的监管和审查。

- 教育公众在接到可疑电话时,通过其他方式验证身份。

1.3 其他形式

除了换脸和换声,AI诈骗还包括通过自动化脚本进行的钓鱼攻击、利用机器学习预测用户行为进行的诈骗等。

自动化脚本和钓鱼攻击:

- 自动化脚本可以模拟人类行为,发送大量钓鱼邮件。

- 钓鱼邮件通常包含恶意链接或附件,用于窃取个人信息或安装恶意软件。

机器学习预测用户行为:

- 通过分析用户数据,预测用户行为,进行针对性的诈骗。

- 利用用户习惯和偏好,发送个性化的诈骗信息。

防范措施:

- 使用高级的网络安全工具,如防火墙和防病毒软件。

- 教育用户识别钓鱼邮件和链接,避免点击可疑内容。

- 加强数据保护法规,限制对个人数据的非法访问和使用。

2.技术防范

2.1 增强AI识别能力

开发和部署更先进的AI识别系统,能够识别并标记出AI生成的虚假内容。

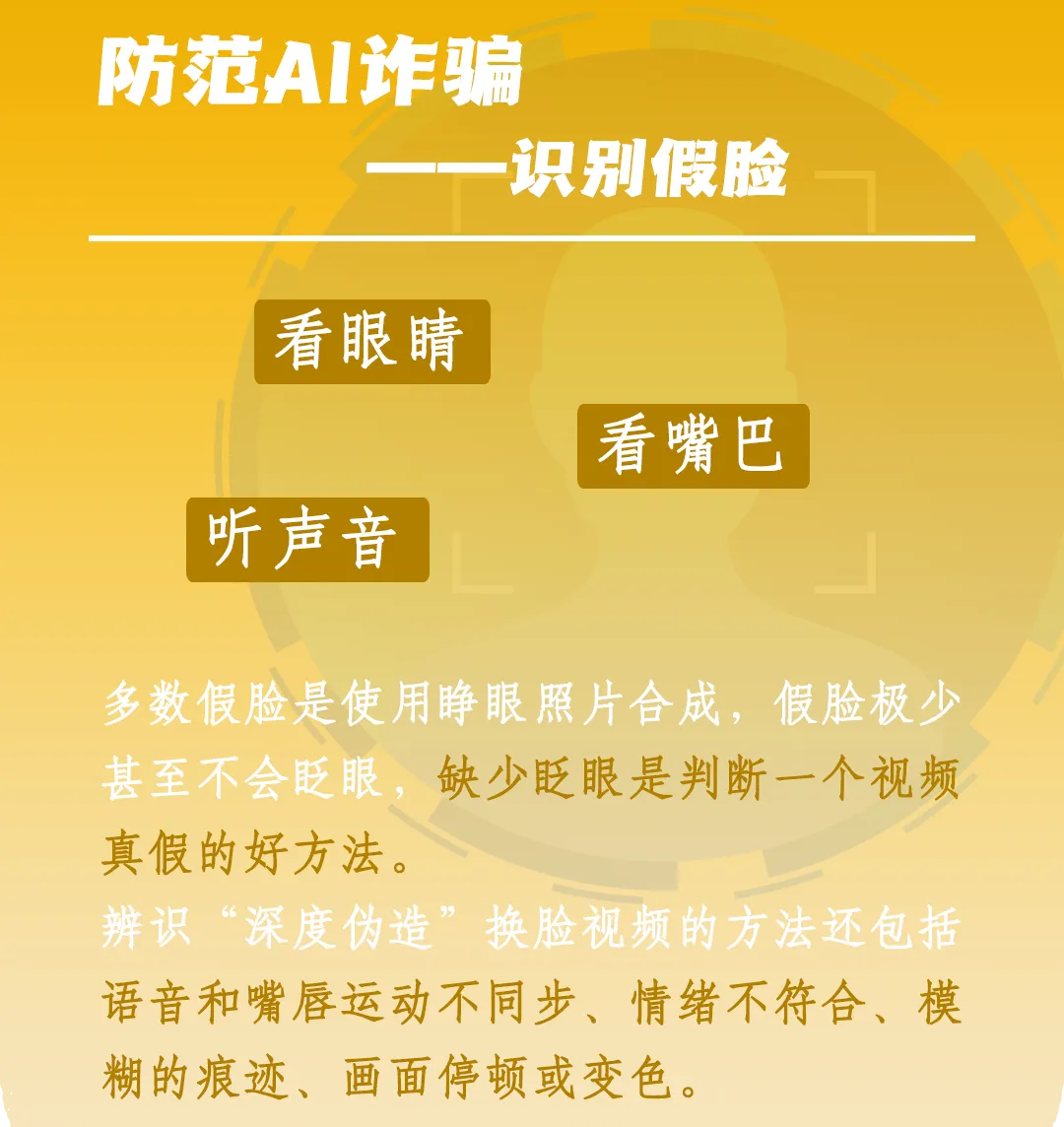

深度伪造检测: 开发专门的算法和工具来检测深度伪造视频。这些工具可以分析视频内容的不一致性,如像素级别的异常、面部表情的不自然等,以识别出AI生成的内容。

声音识别技术: 对于AI换声技术,可以开发声音识别系统,通过分析声音的频谱特性、语调变化等,来识别合成声音和真实声音的差异。

机器学习模型: 利用机器学习模型来不断学习和识别新的AI诈骗手段。随着时间的推移,这些模型可以变得更加精准,能够识别出更复杂的诈骗行为。

2.2 多因素认证

增加身份验证的复杂性,例如结合生物识别技术,可以提高安全性。

生物识别技术: 结合声音、嘴巴、指纹、面部识别、虹膜扫描等生物识别技术,可以大幅提高身份验证的安全性。这些技术难以被复制,从而降低诈骗成功的可能性。

行为生物识别: 除了物理生物特征,还可以分析用户的行为模式,如打字节奏、鼠标使用习惯等,作为身份验证的另一层保障。

一次性密码(OTP): 在进行敏感操作时,如转账或修改账户信息,可以通过短信或应用程序生成一次性密码,增加额外的安全层。

2.3 数据加密

使用高级加密标准(AES)等技术,保护个人数据不被非法获取和使用。

高级加密标准(AES): 使用AES等加密算法对敏感数据进行加密,确保即使数据被非法获取,也无法被未授权的第三方解读。

端到端加密: 在通信过程中使用端到端加密技术,确保只有通信双方可以访问通信内容,保护用户隐私和数据安全。

定期更新加密协议: 随着计算能力的提高和攻击手段的演变,定期更新加密协议和密钥,以保持数据安全。

技术防范小结:技术防范是构建安全防线的重要组成部分。通过增强AI识别能力、实施多因素认证和加强数据加密,可以显著提高防范AI诈骗的能力。然而,技术防范并非万能,还需要结合教育、法律等其他措施,共同构建一个全面的防范体系。

3.教育和意识提升

3.1 公众教育

通过媒体、教育机构等渠道,普及AI诈骗的相关知识,提高公众的防范意识。

媒体宣传: 利用电视、广播、报纸、网络等多种媒体渠道,普及AI诈骗的基本知识和防范技巧。通过新闻报道、专题节目、公益广告等形式,提高公众对AI诈骗的认识。

教育机构的作用: 学校和教育机构可以开设相关课程或讲座,教育学生和公众如何识别和防范AI诈骗。这包括网络安全知识、个人信息保护等内容。

社区活动: 社区中心和非政府组织可以举办讲座和研讨会,向社区居民普及AI诈骗的相关知识,特别是针对老年人和易受骗群体。

3.2 培训和研讨会

定期举办培训和研讨会,教育人们如何识别和应对AI诈骗。

专业培训: 为执法人员、网络安全专家等专业人员提供培训,教授他们如何识别、追踪和打击AI诈骗。

企业培训: 企业可以定期举办员工培训,特别是财务部门和客服部门,教授他们如何识别和应对AI诈骗,保护企业和客户的利益。

在线研讨会: 利用网络会议平台,举办在线研讨会和网络研讨会,使更多人能够方便地参与学习和交流。

3.3 案例分析

通过分析真实案例,让人们了解AI诈骗的常见手段和防范方法。

真实案例分享: 通过分享真实发生的AI诈骗案例,让人们了解诈骗分子的手法和受害者的经历,从而提高警惕。

案例研究: 深入分析案例,探讨诈骗的动机、手段、受害者心理等,为防范AI诈骗提供更深入的见解。

模拟演练: 组织模拟演练,让人们在安全的环境中体验AI诈骗的过程,学习如何识别和应对。

教育和意识小结:教育和意识提升是构建社会防范AI诈骗的第一道防线。通过公众教育、培训和研讨会、案例分析等措施,可以有效地提高公众的防范意识和能力。这不仅需要政府、教育机构、企业和社区的共同努力,也需要每个人的积极参与和学习。只有当每个人都具备了足够的知识和技能,我们才能更有效地抵御AI诈骗的威胁。

4.法律和政策

4.1 制定相关法规

明确法律框架: 制定明确的法律框架,界定AI诈骗的违法行为,包括但不限于制作、传播深度伪造内容、进行AI换声诈骗等。

保护个人权利: 确保法律保护个人权利,如肖像权、名誉权和隐私权,防止AI技术被滥用。

技术监管: 制定技术监管政策,要求AI技术提供商和使用者遵守特定的安全标准和道德准则。

4.2 加强执法力度

执法资源投入: 增加执法资源,包括人力、技术和资金,以提高对AI诈骗案件的侦破率。

跨部门协作: 加强不同执法部门之间的协作,如警察、网络安全部门、金融监管机构等,形成打击AI诈骗的合力。

快速响应机制: 建立快速响应机制,一旦发现AI诈骗行为,能够迅速采取措施,减少损失。

4.3 国际合作

跨国法律合作: 与其他国家建立法律合作机制,共同打击跨国AI诈骗犯罪。

信息共享: 建立国际信息共享平台,共享AI诈骗情报和打击经验。

技术交流: 促进国际间在AI识别技术和网络安全方面的技术交流与合作。

法律和政策小结:法律和政策是构建安全网络环境的基石。通过制定相关法规、加强执法力度和国际合作,可以有效打击AI诈骗行为,保护公众利益。这需要政府、立法机构、执法部门和国际社会的共同努力。通过这些措施,我们可以为公众提供一个更加安全、可靠的网络环境,减少AI诈骗带来的风险和损失。

5.结论

AI诈骗是一个复杂的社会问题,需要技术、教育和法律三方面的共同努力来解决。通过提高技术防范能力,加强公众教育和意识提升,以及完善相关法律法规,我们可以构建一个更加安全、可靠的网络环境。

参考文章:【网安科普】如何防范AI诈骗?

这篇关于防范AI诈骗:技术、教育与法律的共同防线的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!