adamw专题

Pytorch常用的函数(八)常见优化器SGD,Adagrad,RMSprop,Adam,AdamW总结

Pytorch常用的函数(八)常见优化器SGD,Adagrad,RMSprop,Adam,AdamW总结 在深度学习中,优化器的目标是通过调整模型的参数,最小化(或最大化)一个损失函数。 优化器使用梯度下降等迭代方法来更新模型的参数,以使损失函数达到最优或接近最优。 如下图,优化算法可分为一阶算法和二阶算法,常用的是一阶算法,今天主要介绍下一阶优化相关的优化器。 1 SGD优化

Adagrad求sqrt SGD Momentum Adagrad Adam AdamW RMSProp LAMB Lion 推导

随机梯度下降(Stochastic Gradient Descent)SGD 经典的梯度下降法每次对模型参数更新时,需要遍历所有的训练数据。随机梯度下降法用单个训练样本的损失来近似平均损失。 θ t + 1 = θ t − η g t ( 公式 1 ) \theta_{t+1} = \theta_{t}-\eta g_t (公式1) θt+1=θt−ηgt(公式1) 小批量梯度下降法(

Pointnet++改进优化器系列:全网首发AdamW优化器 |即插即用,实现有效涨点

简介:1.该教程提供大量的首发改进的方式,降低上手难度,多种结构改进,助力寻找创新点!2.本篇文章对Pointnet++特征提取模块进行改进,加入AdamW优化器,提升性能。3.专栏持续更新,紧随最新的研究内容。 目录 1.理论介绍 2.修改步骤 2.1 步骤一 2.2 步骤二 2.3 步

深度学习——Optimizer算法学习笔记(AdamW)

1 致谢 感谢赵老师的讲授! 2 前言 今天在学习Pytorch~记得Johnson助教好像讲过有一个优化算法最好用的,不过忘了是哪一个了,然后就回顾了一下赵老师讲课的视频; 3 最常用的Optimizer算法是Adam方法 最常用的Optimization算法是Adam方法; (我在Wider Face数据集上用过一次Adam方法,不过用了一下感觉效果不是很好; 后来赵老师在课上讲

SGD-adam-adamw

title: SGD && Adam && Adamw的C语言实现以及对比总结 date: 2023-03-08 17:08:50 tags: SGD && Adam && Adamw的C语言实现以及对比总结 文章目录 title: SGD && Adam && Adamw的C语言实现以及对比总结 date: 2023-03-08 17:08:50 tags: SGD && Adam

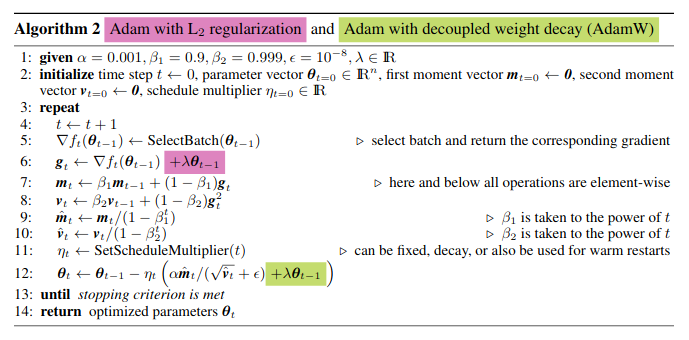

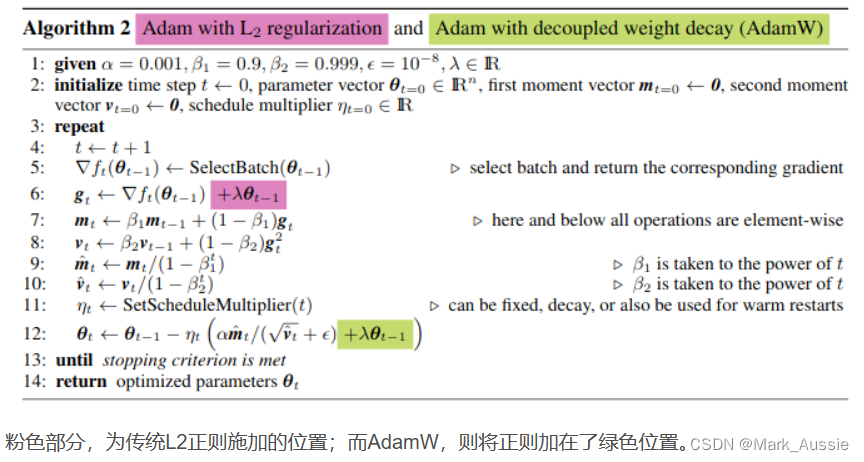

Adam和AdamW区别

AdamW 是 Adam 优化器加上 L2 正则,这样可限制参数值不可太大,之前的 L2 正则是直接加在损失函数上,Loss = Loss + 1/2 * λ ∑θ^2;Adamw 即 Adam + weight decate ,效果与 Adam + L2 正则化相同,但是计算效率更高,之前的 L2 正则化需要在 loss 中加入正则项再算梯度,反向传播,AdamW 直接将正则项的

AdamW优化器(自适应梯度方法)

DECOUPLED WEIGHT DECAY REGULARIZATION解耦权值衰减正则化 摘要 L2正则化和权值衰减正则化对于标准随机梯度下降是等价的(当按学习率重新调整时),但是在自适应梯度算法的情况下确并非如此,如Adam。虽然这些算法的通用实现采用L2正则化(通常称它为“权值衰减”,这可能是由于我们暴露的不等量性造成的误导),我们提出了一个简单的修正,通过将权重衰减与采用损失函数的优