反压专题

Flink重点原理与机制 | 网络流控及反压机制

点击上方蓝色字体,选择“设为星标” 回复”面试“获取更多惊喜 0 简介 网络流控的概念与背景TCP 的流控机制Flink TCP-based 反压机制(before V1.5)Flink Credit-based 反压机制 (since V1.5)总结与思考 1 网络流控的概念与背景 1.1 为什么需要网络流控 首先我们可以看下这张最精简的网络流控的图,Producer 的吞吐率是 2MB/

Flink重点难点:Flink任务综合调优(Checkpoint/反压/内存)

在阅读本文之前,你应该阅读过的系列: 《Flink重点难点:时间、窗口和流Join》 《Flink重点难点:网络流控和反压》 《Flink重点难点:维表关联理论和Join实战》 《Flink重点难点:内存模型与内存结构》 《Flink重点难点:Flink Table&SQL必知必会(一)》 Flink重点难点:Flink Table&SQL必知必会(二) CheckPoint调优

HLS进阶技巧——反压fifo

在Vitis HLS设计中,由于只能获取到fifo的empty、full信号,而不像RTL设计中还能拿到write/read count,所以在dataflow中,只能通过empty、full信号来进行数据驱动。反压fifo是通过fifo的full信号来控制程序的运行。下面介绍两种笔者涉及到的反压技巧,以便大家在自己的设计中举一反三。 技巧1 下图所示为dataflow中一个最基本的结构,在反

Flink 原理与实现:再谈反压

扫码关注公众号免费阅读全文:冰山烈焰的黑板报 Flink 原理与实现:如何处理反压问题 这一篇文章中我们讲了 Flink 的反压机制。本文我将更加详细的介绍先后采用的两种反压机制: 基于 TCP 的反压(< 1.5)基于信用的反压(≥ 1.5) 1. 逻辑视图 Flink 网络栈是 flink-runtime 的核心组件,所有来自 TaskManager 的工作单元(子任务)都通过它来互

Flink 原理与实现:如何处理反压问题

扫码关注公众号免费阅读全文:冰山烈焰的黑板报 流处理系统需要能优雅地处理反压(backpressure)问题。反压通常产生于这样的场景:短时负载高峰导致系统接收数据的速率远高于它处理数据的速率。许多日常问题都会导致反压,例如,垃圾回收停顿可能会导致流入的数据快速堆积,或者遇到大促或秒杀活动导致流量陡增。反压如果不能得到正确的处理,可能会导致资源耗尽甚至系统崩溃。 目前主流的流处理系统 Sto

Mark :Spark Streaming 反压(Back Pressure)机制介绍

背景 在默认情况下,Spark Streaming 通过 receivers (或者是 Direct 方式) 以生产者生产数据的速率接收数据。当 batch processing time > batch interval 的时候,也就是每个批次数据处理的时间要比 Spark Streaming 批处理间隔时间长;越来越多的数据被接收,但是数据的处理速度没有跟上,导致系统开始出现数据堆积,可能进

Spark Streaming反压

在默认情况下,Spark Streaming 通过 receivers (或者是 Direct 方式) 以生产者生产数据的速率接收数据。当 batch processing time > batch interval 的时候,即每个批次数据处理的时间要比 Spark Streaming 批处理间隔时间长;越来越多的数据被接收,但是数据的处理速度没有跟上,导致系统开始出现数据堆积,可能进一步导致

Flink 反压问题处理

在分布式流处理系统中,反压(Backpressure)是一个常见的问题,它发生在下游处理速度跟不上上游数据发送速度时。Apache Flink 是一个高性能的流处理框架,它提供了多种机制来处理反压问题。下面是一步步分析问题原因,给出案例,并提出解决方案的过程。 ### 1. 问题原因分析 **上游发送速度过快**:如果上游数据源产生数据的速度超过了下游处理单元的处理能力,就会产生反压。 **

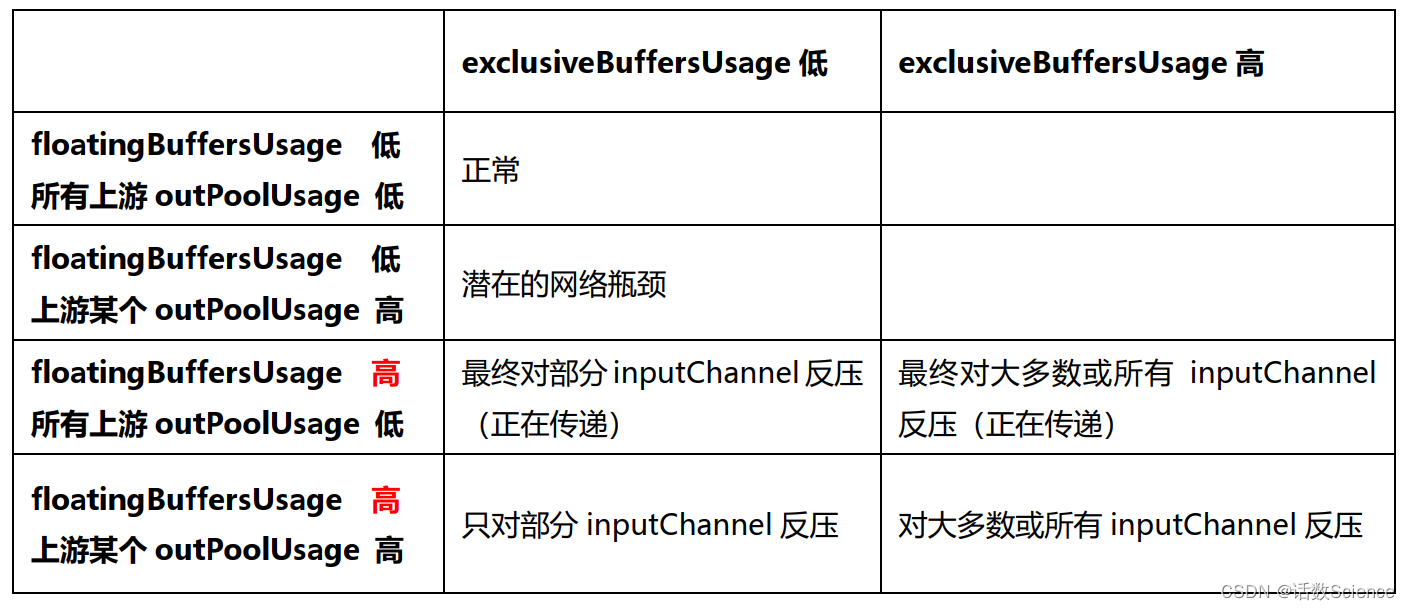

【Flink精讲】Flink反压调优

Flink 网络流控及反压的介绍: Apache Flink学习网 反压的理解 简单来说, Flink 拓扑中每个节点(Task)间的数据都以阻塞队列的方式传输,下游来不及消费导致队列被占满后,上游的生产也会被阻塞,最终导致数据源的摄入被阻塞。反压(BackPressure) 通常产生于这样的场景:短时间的负载高峰导致系统接收数据的速率远高于它处理数据的速率。许多日常问题都会

flink反压及解决思路和实操

1. 反压原因 反压其实就是 task 处理不过来,算子的 sub-task 需要处理的数据量 > 能够处理的数据量,比如: 当前某个 sub-task 只能处理 1w qps 的数据,但实际上到来 2w qps 的数据,但是实际只能处理 1w 条,从而反压 常见原因有: 数据倾斜:数据分布不均,个别task 处理数据过多 算子性能问题:可能某个节点逻辑很复杂,比如sink节点很

数字前端/FPGA设计——握手与反压问题

声明:本文来自0431大小回 前言:在芯片设计或者FPGA设计过程中,流水设计是经常用到的,但是考虑数据安全性,需要与前后级模块进行握手通信,这时候就需要对流水数据进行反压处理,本文将具体介绍握手与反压。 目录 握手协议握手与反压反压带存储体的反压 字节的问题代码分析逐级反压与跨级反压不带存储体的反压 代码分析 握手协议 本文讲述valid-ready握手,下面列出三种握手情况

Apache Flink 进阶教程(七):网络流控及反压剖析

目录 前言 网络流控的概念与背景 为什么需要网络流控 网络流控的实现:静态限速 网络流控的实现:动态反馈/自动反压 案例一:Storm 反压实现 案例二:Spark Streaming 反压实现 疑问:为什么 Flink(before V1.5)里没有用类似的方式实现 feedback 机制? TCP 流控机制 TCP 流控:滑动窗口 Flink TCP-based 反压机制

Apache Flink 进阶教程(七):网络流控及反压剖析

目录 前言 网络流控的概念与背景 为什么需要网络流控 网络流控的实现:静态限速 网络流控的实现:动态反馈/自动反压 案例一:Storm 反压实现 案例二:Spark Streaming 反压实现 疑问:为什么 Flink(before V1.5)里没有用类似的方式实现 feedback 机制? TCP 流控机制 TCP 流控:滑动窗口 Flink TCP-based 反压机制

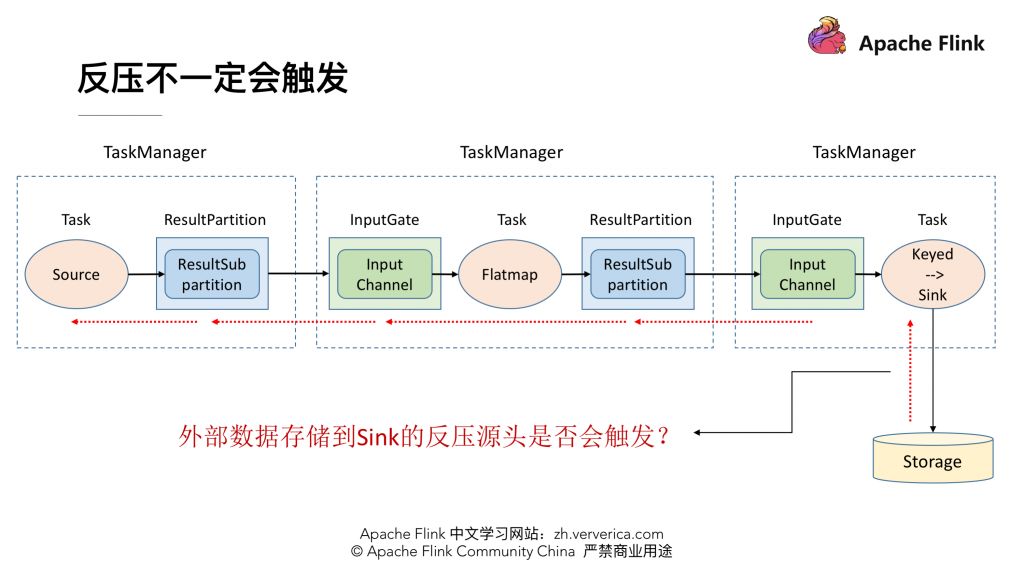

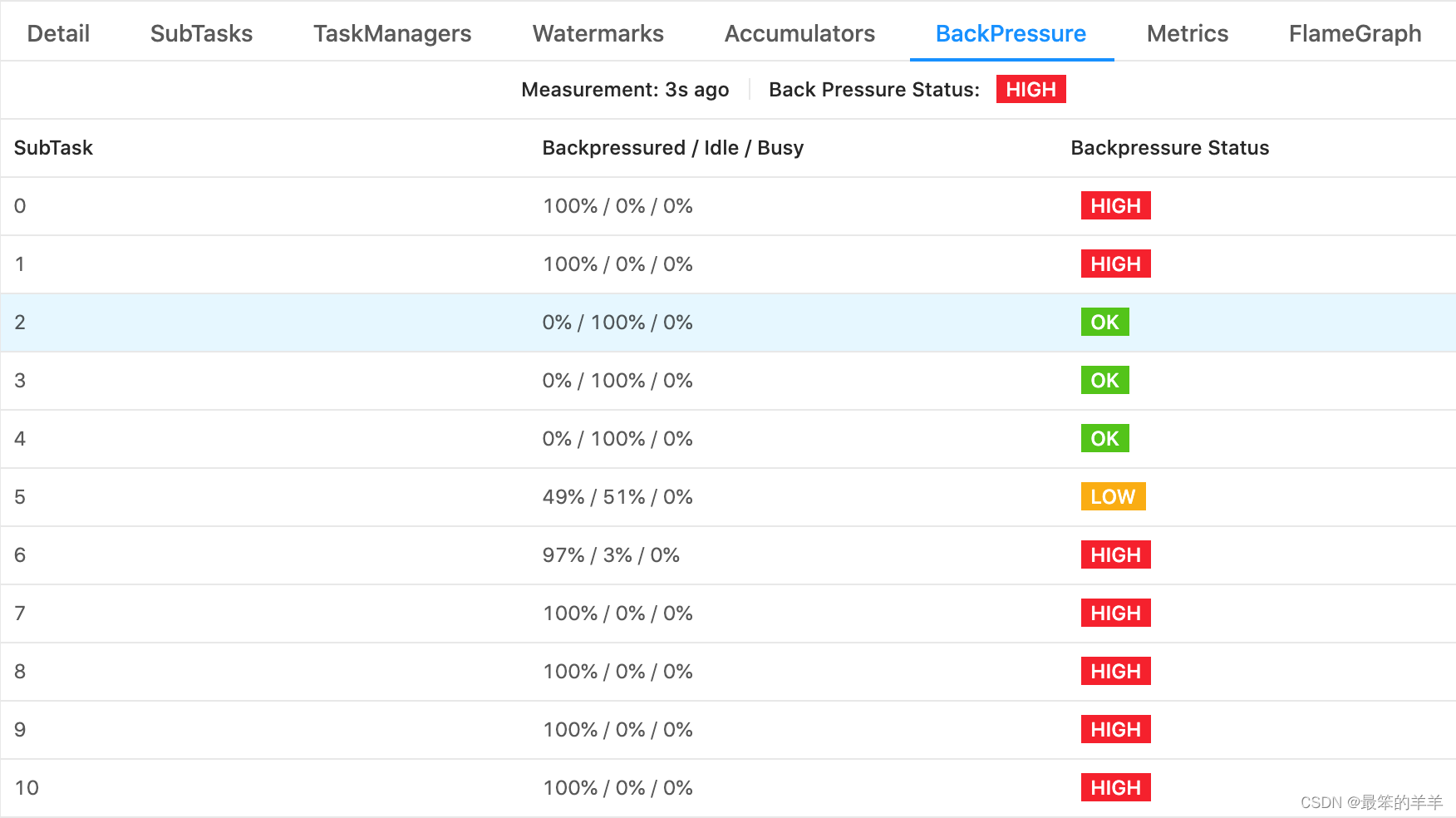

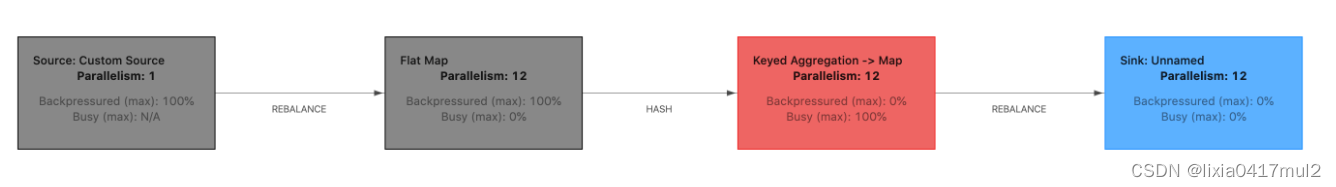

Flink系列之:监控反压

Flink系列之:监控反压 一、反压二、Task 性能指标三、示例四、反压状态 Flink Web 界面提供了一个选项卡来监控正在运行 jobs 的反压行为。 一、反压 如果你看到一个 task 发生 反压警告(例如: High),意味着它生产数据的速率比下游 task 消费数据的速率要快。 在工作流中数据记录是从上游向下游流动的(例如:从 Source 到 Sink)。反压沿

Flink反压如何查看和优化

我们在使用Flink程序进行流式数据处理时,由于种种原因难免会遇到性能问题,如我们在使用Flink程序消费kafka数据,可能会遇到kafka数据有堆积的情况,并且随着时间的推移,数据堆积越来越多,这就表名消费处理数据的速度没有跟上生产的速度。面对这种情况,我们如何知道到底哪个环节造成性能瓶颈问题,这就需要我们对flink作业链路进行分析排查,找出存在瓶颈的算子。好在flink为我

Flink 流量控制及反压

流量控制 Flink在两个Task之间建立Netty连接进行数据传输,每一个Task会分配两个缓冲池,一个用于输出数据,一个用于接收数据。当一个Task的缓冲池用尽之后,网络连接就处于阻塞状态,上游Task无法产出数据,下游Task无法接收数据,也就是我们所说的“反压”状态。这是一种非常自然的“反压”的机制,但是过程也相对比较粗暴。由于TaskManager之间的网络连接是由不

识别flink的反压源头

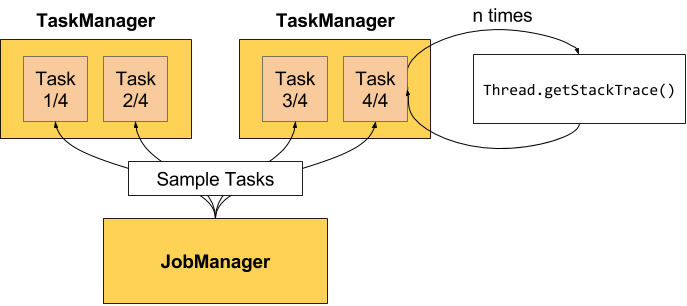

背景 flink中最常见的问题就是反压,这种情况下我们要正确的识别导致反压的真正的源头,本文就简单看下如何正确识别反压的源头 反压的源头 首先我们必须意识到现实中轻微的反压是没有必要去优化的,因为这种情况下是由于偶尔的流量峰值,TaskManager的GC,定时任务,或者网络波动正好触发引起的,我们要优化的是那种出现持续的反压的情况 其次反压是通过JobManager通过对TaskMana

Flink核心篇,四大基石、容错机制、广播、反压、序列化、内存管理、资源管理

Flink核心篇,四大基石、容错机制、广播、反压、序列化、内存管理、资源管理 1、Flink的四大基石包含哪些?2、讲一下Flink的Time概念?3、介绍下Flink窗口,以及划分机制?4、介绍下Flink的窗口机制,以及各组件之间是如何相互工作的?5、在流数据处理中,有没有遇到过数据延迟等问题,通过什么处理呢?6、WaterMark是什么?原理讲解一下?7、窗口如何划分的?什么时候触发计