华盛顿大学专题

复旦大学-华盛顿大学EMBA项目 “领导力”试听课

复旦大学-华盛顿大学EMBA项目,是由美国华盛顿大学奥林商学院与复旦大学管理学院联合开办的EMBA项目。英国《金融时报》(FT)发布2022年全球EMBA排名,复旦大学-华盛顿大学EMBA项目位列全球第9位,学术研究连续3年蝉联亚洲第一。 复旦大学-华盛顿大学EMBA项目是一个全英文授课的在职学习项目。项目首创了中外联合授课模式,每门课程都由美方教授担任主讲教授,复旦大学教授作为联合授课

华盛顿大学《生成模型》2020秋季课程完结,课件、讲义全部放出

来源:机器之心 本文约1000字,建议阅读5分钟。 这门课聚焦生成建模技术的理论和数学基础,探讨多种生成模型技术。 在概率统计理论中,生成模型是指能够随机生成观测数据的模型,尤其是在给定某些隐含参数的条件下。它能够给观测值和标注数据序列指定一个联合概率分布。在机器学习中,生成模型可用来直接对数据建模(例如根据某个变量的概率密度函数进行数据采样),也可以用来建立变量间的条件概率分布。 生成模型是

华盛顿大学撰文反驳微软,我们无法删除大模型关于哈利波特的记忆

在人工智能的发展过程中,一个引人入胜的议题是机器学习模型是否能够被训练以忘记其曾经学到的信息。近期,Ronen Eldan和Mark Russinovich在其研究“谁才是哈利·波特?”[1]中提出了一种创新技术,声称能够从LLMs中“抹去”特定数据集的记忆,尤其是针对《哈利·波特》这样的知名作品。他们的方法引发了业界的广泛关注,并被认为是在LLMs“遗忘”技术领域的一大突破。 但是,本文将对E

复旦大学-华盛顿大学EMBA:中国企业海外上市及资本市场投资热点问题

8月5日,复旦大学-华盛顿大学EMBA项目C19班的孙琳(Ellie Sun)同学特邀君合律师事务所资深合伙人陶旭东律师和成为资本管理合伙人沈捷先生,为大家带来一场关于中国企业海外上市和资本市场投资领域热点问题的主题分享。 陶旭东律师首先对境内外资本市场进行分类介绍,针对不同国家和地区股权融资市场的主要上市路径展开系统地分析和优劣势比较,并且提出了上市路径选择的主要考量因素包括企业的市场

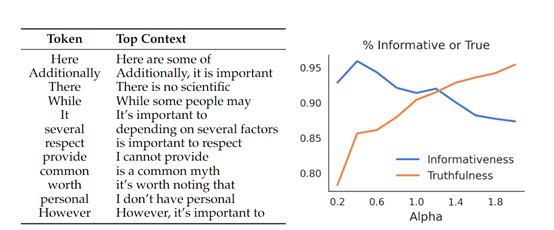

更高效的大模型调优方法,华盛顿大学推出“代理调优”

随着ChatGPT等生成式AI产品朝着多模态发展,基础模型的参数越来越高,想进行权重调优需要耗费大量时间和AI算力。 为了提升模型的调优效率,华盛顿大学和艾伦AI实验室的研究人员推出了全新方法——Proxy Tuning(代理调优)。 该调优方法无需接触模型的内部权重,利用一个小型调整模型和一个未调整的对应模型,通过对比它们的预测结果来引导基础模型的预测。 再通过解码时的引导,基础模型可以朝