vmamba专题

Linux下VMamba 环境复现+环境测试

# 1. 创建自己的虚拟环境conda create -n VMamba python=3.10.13conda activate VMamba# 2. cuda-11.8conda install cudatoolkit==11.8 -c nvidia# 3. torch torchvision torchaudio 与 官网命令一致pip install torch==2.1.1

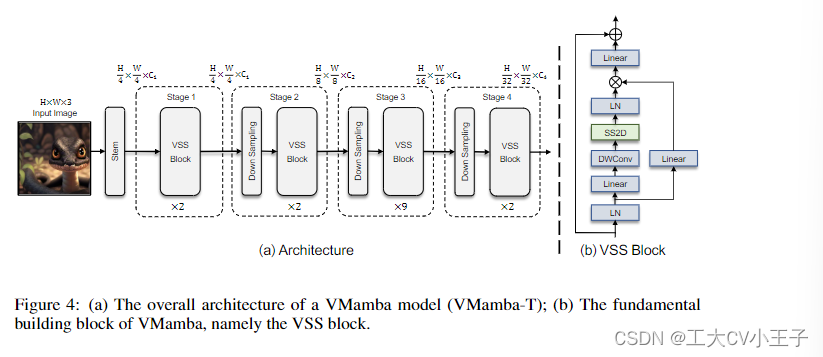

《VMamba》论文笔记

原文链接: [2401.10166] VMamba: Visual State Space Model (arxiv.org) 原文笔记: What: VMamba: Visual State Space Model Why: 多年以来CNN和VIT作为视觉特征提取的主流框架 CNN具有模型简单,共享权重,计算效率高(线性复杂度)的优点,缺点是不具备全局感受野,能力不足VIT,不擅长

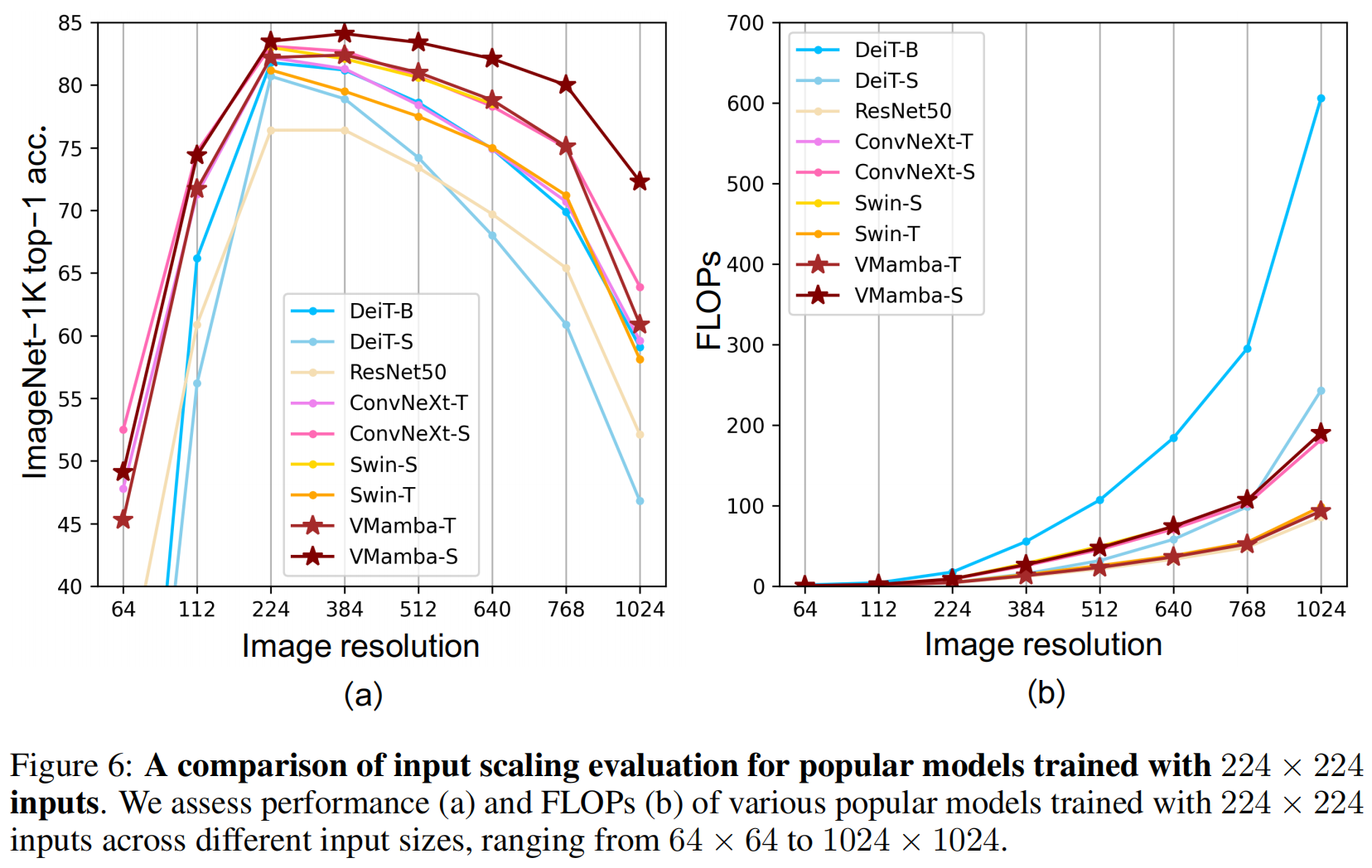

Swin版VMamba来了!精度再度提升,VMamba-S达成83.5%,超越Swin-S,已开源!

本文首发:AIWalker 就在昨日,华科王兴刚团队公开了Mamba在ViT的入局Vim,取得了更高精度、更快速度、更低显存占用。相关信息可参考: 入局CV,Mamba再显神威!华科王兴刚团队首次将Mamba引入ViT,更高精度、更快速度、更低显存! 就在纳闷Swin版的VMamba啥时候出来之时,UCAS、华为以及鹏城实验室联合提出了Swin版本的VMamba,不出之外的取得了更高的