vilt专题

ViLT: Vision-and-Language Transformer Without Convolution or Region Supervision

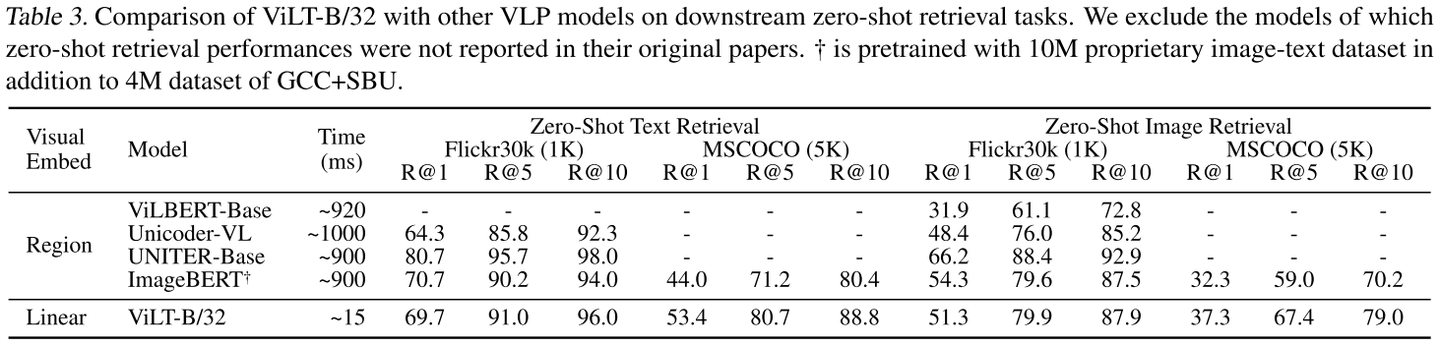

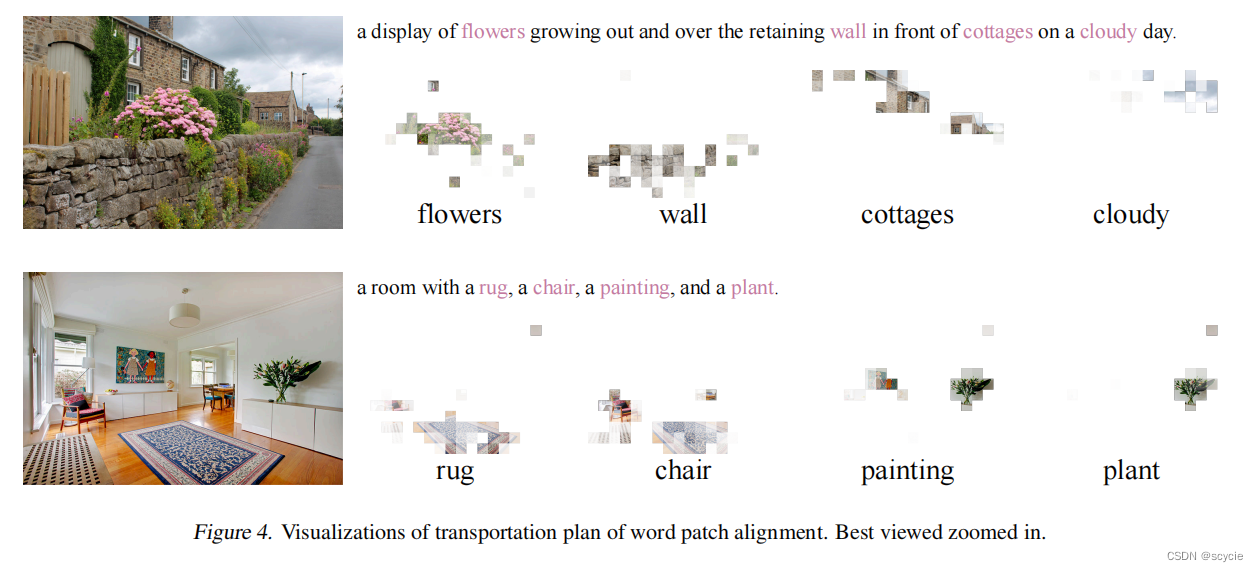

论文地址:https://arxiv.org/pdf/2102.03334.pdf 代码地址:https://github.com/dandelin/vilt. 摘要 目前的VLP方法严重依赖于图像特征提取过程,其中大部分涉及区域监督(如目标检测)和卷积体系结构(如ResNet)。虽然在文献中被忽略了,但我们发现在效率/速度方面存在问题,简单地提取输入特征比多模态交互步骤需要更多的计算,本文在