subnetworks专题

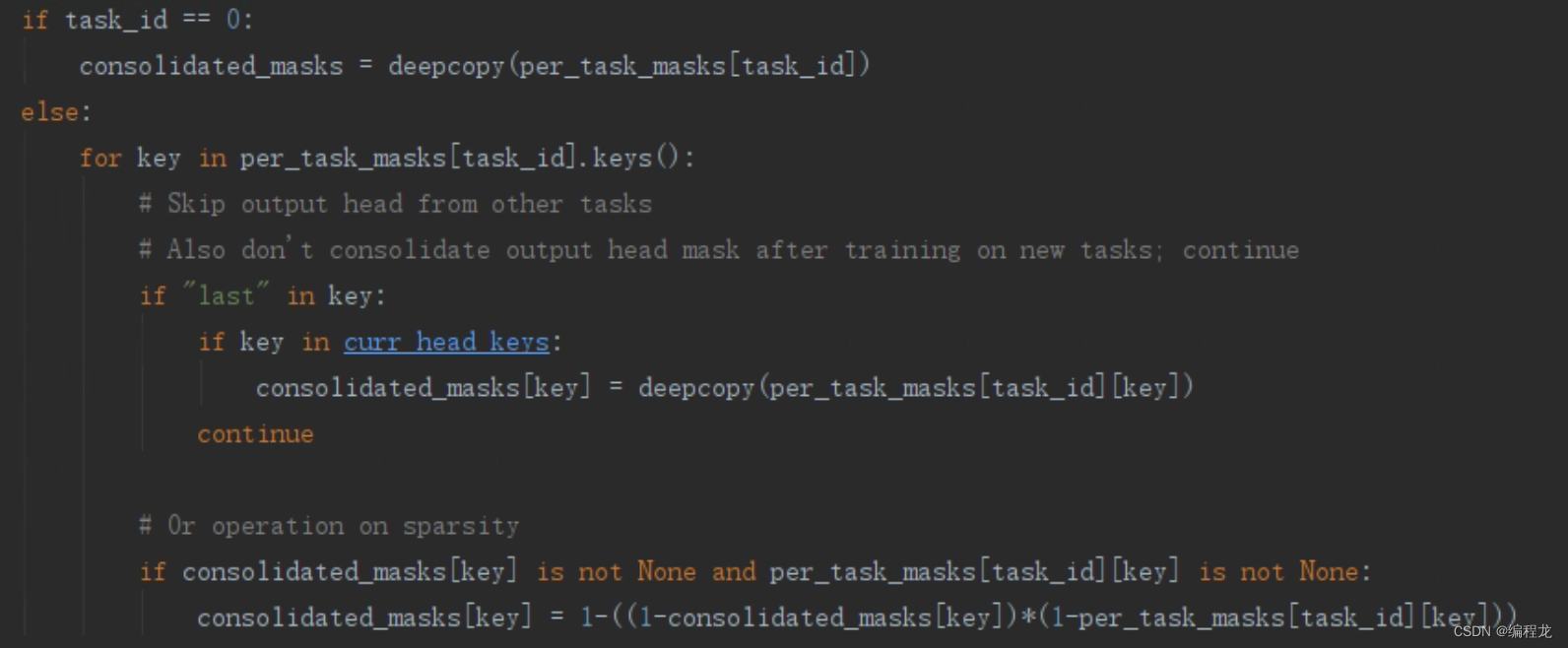

Forget-free Continual Learning with Winning Subnetworks论文阅读+代码解析

本篇文章是来自ICML2022上的一篇,而且是由之前出名的FedWEIT的团队进行研究的,因此这篇文章中也存在着相似的影子,论文地址点这里。 一. 背景(简要介绍) 持续学习又被称为增量式学习,要求不断地接受数据样本并且不会产生灾难性遗忘。最广泛的3种类型为:基于正则化的持续学习,基于记忆重塑的持续学习以及基于动态架构的持续学习。然而,上述的方法都会造成新的内存压力,特别是对于记忆重塑和动态架