streamer专题

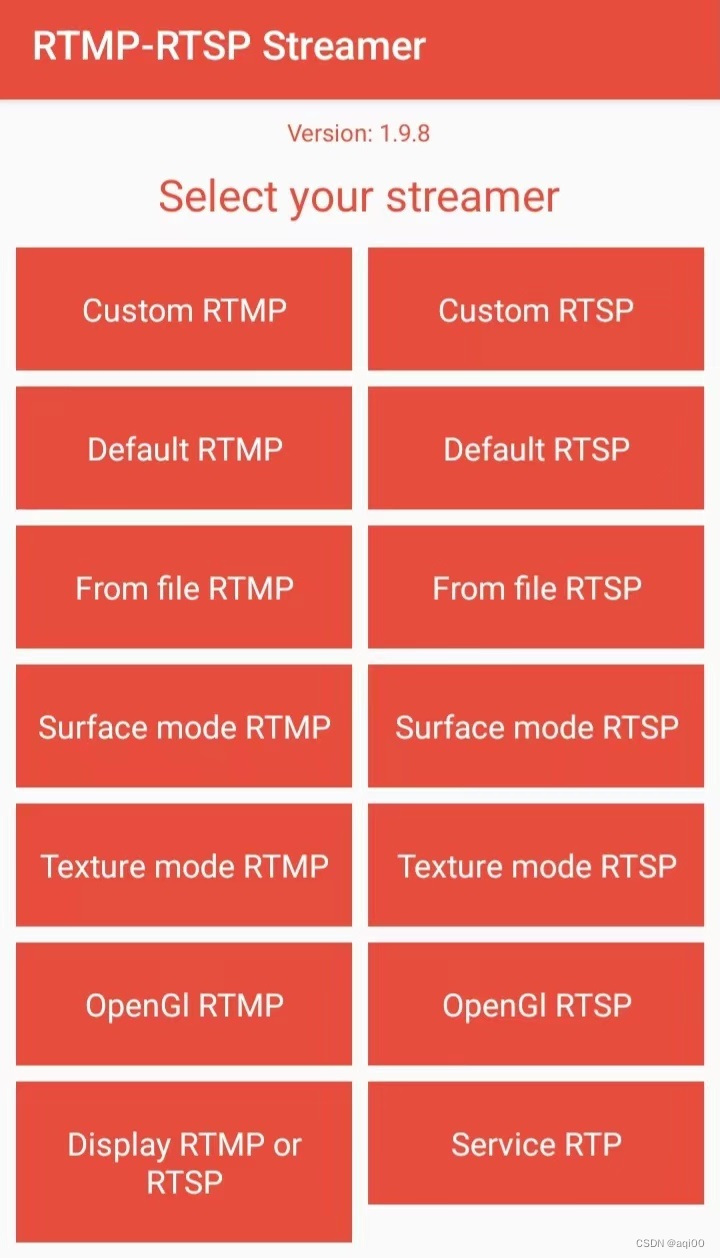

FFmpeg开发笔记(三十一)使用RTMP Streamer开启APP直播推流

RTMP Streamer是一个安卓手机端的开源RTMP直播推流框架,可用于RTMP直播和RTSP直播,其升级版还支持SRT直播(腾讯视频云就采用SRT协议)。RTMP Streamer支持的视频编码包括H264、H265、AV1等等,支持的音频编码包括AAC、G711、OPUS等等,可谓功能强大的APP直播框架。 由于升级版的RTMP Streamer采取全Kotlin编码,对运行环境与开

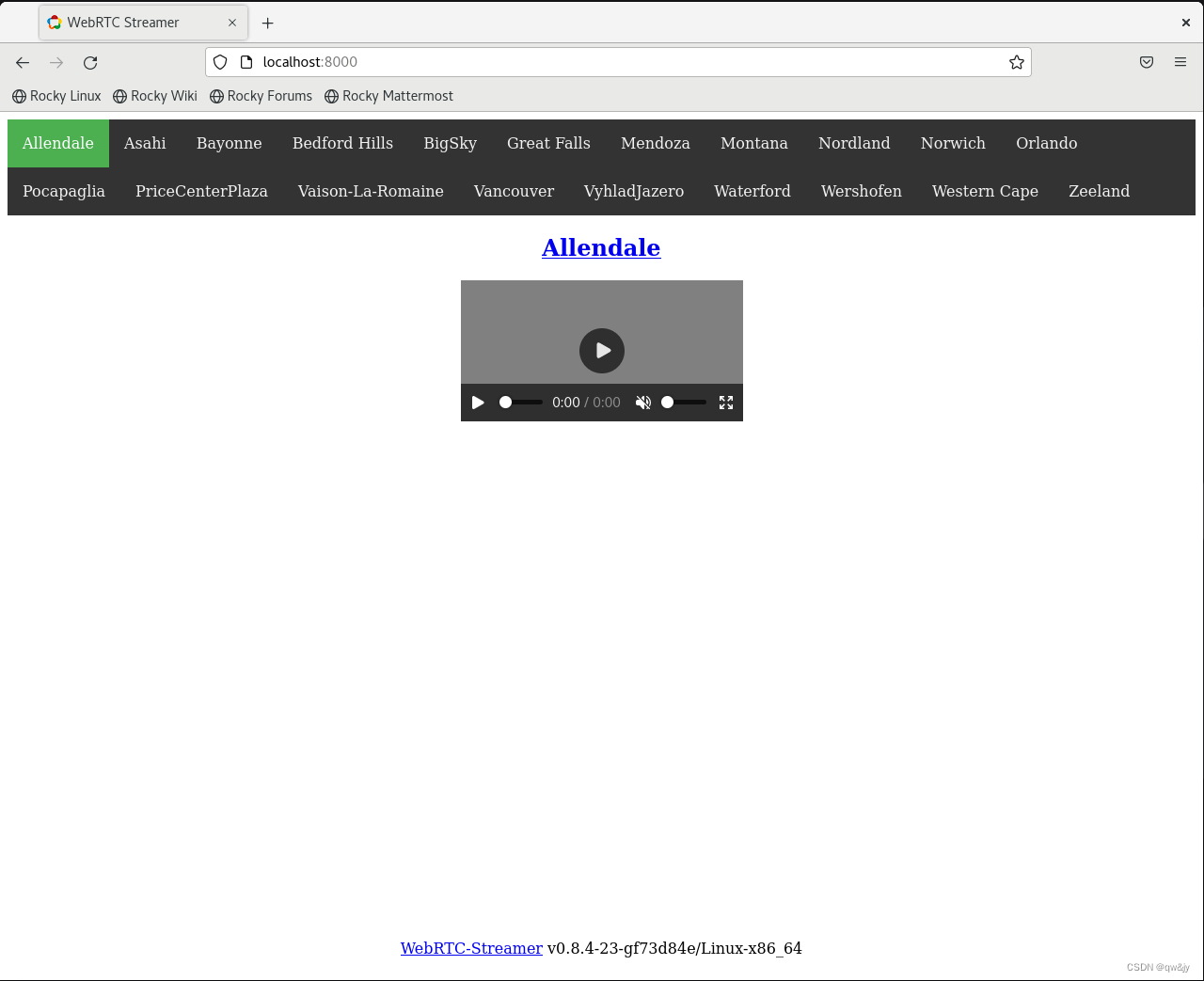

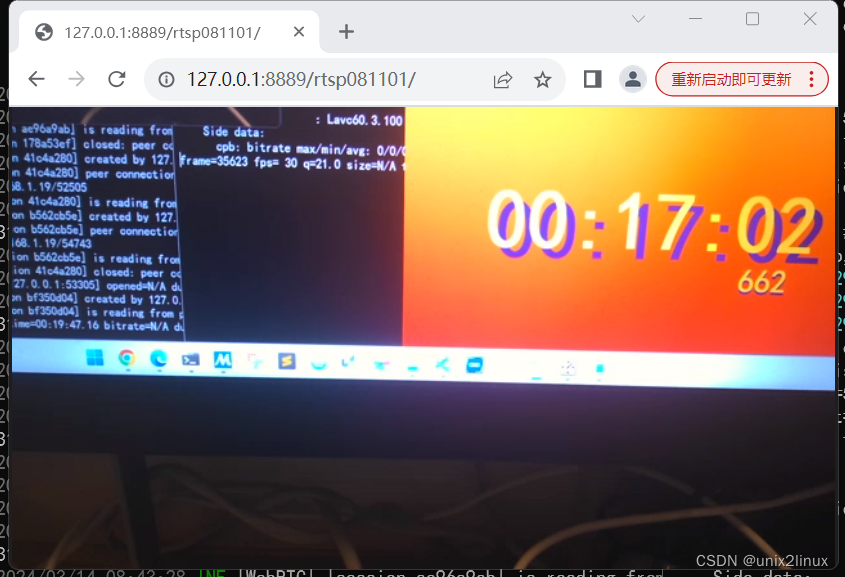

Docker部署WebRTC-Streamer

文章目录 WebRTC-Streamer概述Docker部署WebRTC-StreamerVue使用WebRTC-Streamer一些问题 WebRTC-Streamer概述 WebRTC-Streamer是一个基于WebRTC技术的流媒体传输工具,它可以通过Web浏览器实现实时音视频流的传输和播放。它提供了一种简单而强大的方式,允许用户在不需要插件或额外软件

Parade Series - Web Streamer Low Latency

Parade Series - FFMPEG (Stable X64) 延时测试秒表计时器 ini/config.ini [system]home=serverstore=store\nvr.dbversion=V20240312001verbose=false[monitor]list=rtsp00,rtsp01,rtsp02timeout=30000[rtsp00

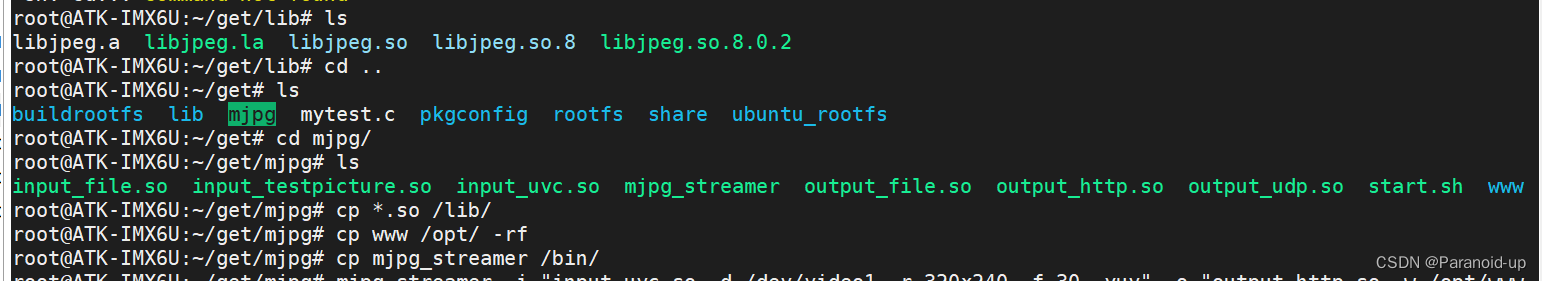

正点原子阿尔法IMX6ULL开发板移植mjpg_streamer

正点原子阿尔法IMX6ULL开发板移植mjpg_streamer 文章目录 正点原子阿尔法IMX6ULL开发板移植mjpg_streamer1.nfs共享目录2.移植 MJPG 库3 移植 mjpg-streamer 服务器 1.nfs共享目录 首先已经搭建号nfs环境。在开发板下 先创建目录get mkdir get 开发板终端执行下列命令 mount -t

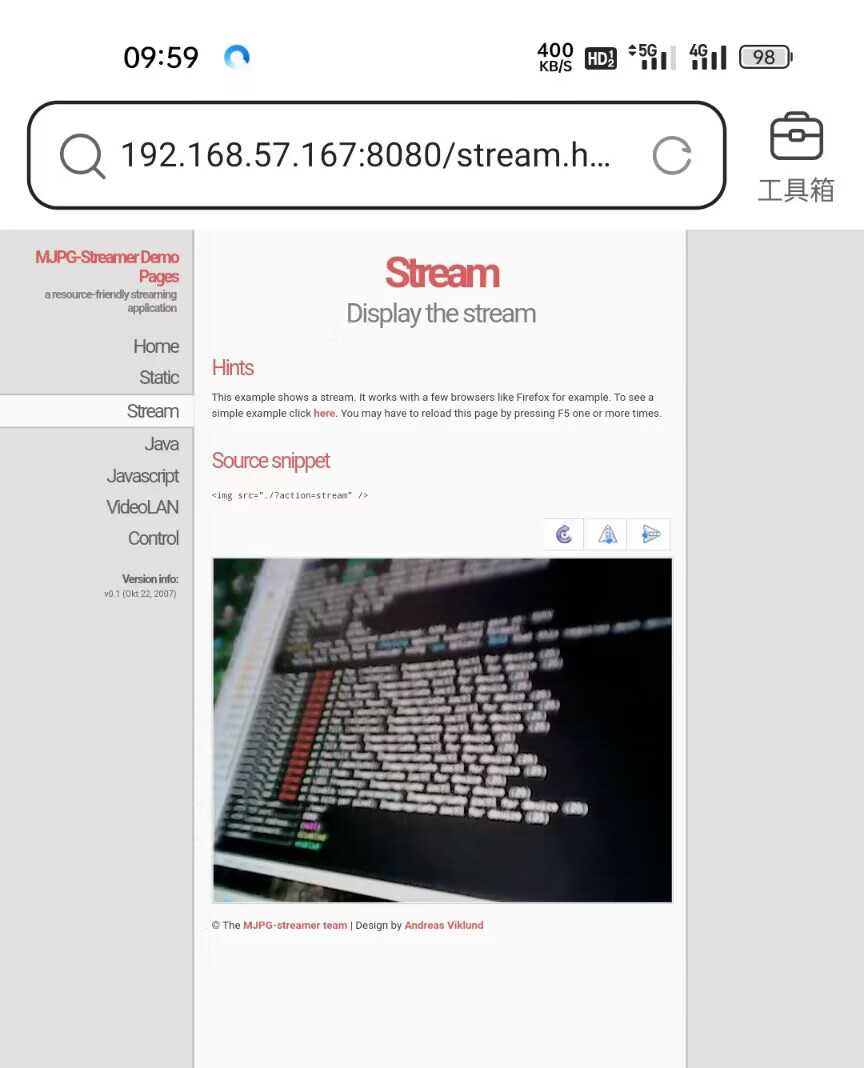

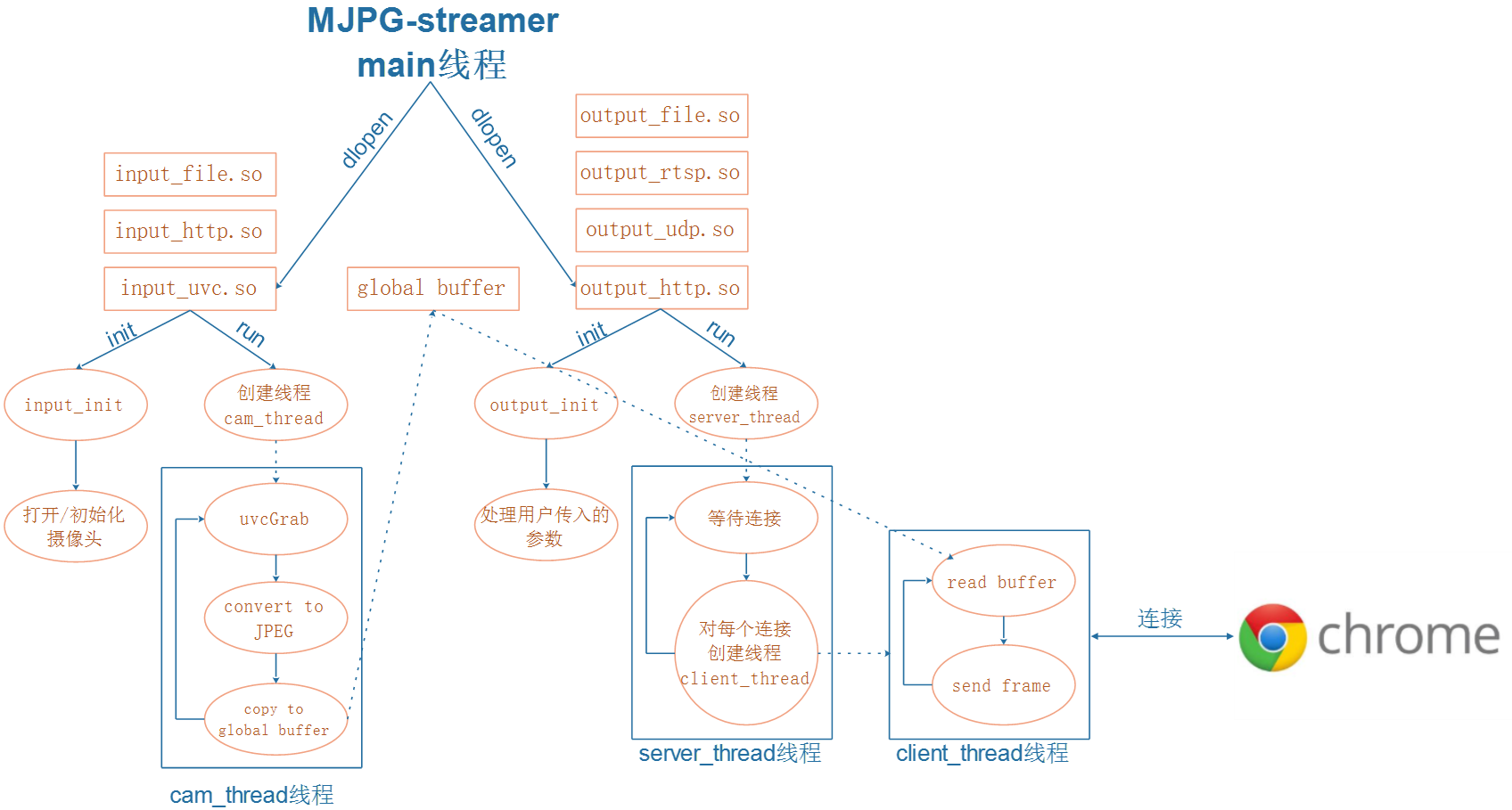

MJPG-streamer方案实现物联网视频监控

目录 前言 一、JPEG,MJPG格式简介 JPEG MJPG MJPG的优点 MJPG的缺点 二、软硬件准备 三、编译MJPG-streamer 四、运行MJPG-streamer 五、其它常见用法 六、MJPG-streamer 程序框架 七、源码下载 前言 最近想做一个安防相关的项目,所以跟着韦东山老师的视频来学习视频监控方案的相关知识,韦东山老师讲的

ubuntu 20.04 使用 webrtc-streamer自动退出,报错GLIBC 问题解决方法

文章目录 前言Ubuntu 20.4中使用webrtc-streamer报错总结 前言 前端vue2 项目需要播放海康的视频流,本地启动起来了,现在需要的服务器上部署,服务器是Ubuntu 20.04,下面是部署时遇到的问题及解决方法,总耗时2天。 不知道怎么在Ubuntu中部署前端项目的可以去看我之前几篇文章。 【vue2】前端如何播放rtsp 视频流,拿到rtsp视频流地址

树莓派3b++mjpg-streamer+usb摄像头实现低延时远程监控

树莓派3b++mjpg-streamer+usb摄像头实现低延时远程监控 使用mjpg-streamer可以实现远程监控,mjpg-streamer的优点是图像清晰延迟小,比起motion延时那可是快了超级多 (注意最好是使用raspberry的源来安装会避免很多麻烦) 1.更新一下软件包 分两次输入 sudo apt-get update sudo apt-get upgrade

ALVR 编译 windows android [Streamer Client]

ALVR下载源码地址:ALVR download 1 ALVR windows编译 [Streamer Building] 1.1 环境安装 参照官方文档:https://github.com/alvr-org/ALVR/wiki/Building-From-Source, @1 rust环境安装: 下载并安装https://static.rust-lang.org/rustup/dis

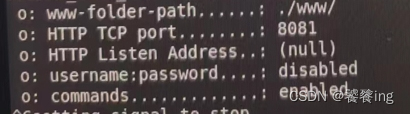

mjpg-streamer配置其它端口访问视频

环境 树莓派4B ubuntu 20.04 U口摄像头 确认摄像头可访问 lsusb查看 在dev下可查看到video* sudo mplayer tv://可打开摄像头并访问到视频 下载mjpg-streamer并编译安装 在github下载zip包,下载的源码,需要编译安装 unzip解压 cd mjpg-streamer/mjpg-streamer-experimental进入目录

mjpg-streamer使用介绍

前几天自己没事玩了一下mjpg-streamer,感觉还不错,这里结合网上的一些资料和自己的心得把主要步骤贴出来供大家参考一下: ps:我在ubuntu11.10和12.04里面都是过,按照以下步骤都没什么问题,我的内核版本是3.2.0的,摄像头使用的是ZC0301PL,开发板是杂牌的,ARM11,核心芯片是S3C6410。PC上也是可以运行的,并不一定非要使用开发板,根据需要修改一下Mak

tiny6410上移植mjpg-streamer

转载 mjpg-stream 的移植需要 jpeg 的库,所以我们先移植 jpeg 的库 (1)jpeg库的移植 1)jpeg源码包通过下面这个网址下载 http://www.ijg.org/files/jpegsrc.v8b.tar.gz 2)解压源码包 tar xvf jpegsrc.v8b.tar.gz 3)配置源码 cd jpeg-8b ./configure --prefi

Mjpeg-streamer源码学习笔记-Main-动态库插件(三)

目标文件:mjpg-stream/mjpg-stream.c + mjpg-stream.h + input.h + output.h 这一篇的主要难点是main()中的结构体globals引出的动态链接库,插件,条件变量,互斥锁等问题。 新手写,有不对的请大神指正,鼓励。 本人参考文章: http://www.360doc.com/content/13/0913/13/

Mjpeg-streamer源码学习笔记-Main-get_long_only(一)

目标文件:mjpg-stream/mjpg-stream.c 这一篇的主要难点是get_long(),get_long_only(). 新手写,有不对的请大神指正,鼓励。 本人参考文章: http://www.360doc.com/content/13/0913/13/13876325_314174121.shtml http://blog.sina.com.cn/s/

IMX6UL开发板 mjpg-streamer 移植实现远程监控

本节介绍移植 MJPG 库和 mjpg-streamer 服务器到迅为 i.MX6UL 全能板上,并将采集到的图像通过网络在 PC 机上显示出来,交叉编译工具为 arm-linux-gnueabihf,摄像头为 USB 免驱摄像头。 硬件平台:迅为imx6ull开发板: 1 移植 MJPG 库 因为使用 mjpg-streamer 要用到 MJPG 库,所以我们要先把 MJPG

v4l2摄像头移植mjpg_streamer笔记

v4l2摄像头移植mjpg_streamer笔记 mjpg-stream的移植需要jpeg的库,所以我们先移植jpeg的库 (1)jpeg库的移植1)jpeg源码包通过下面这个网址下载http://www.ijg.org/files/jpegsrc.v8b.tar.gz2)解压源码包tar xvf jpegsrc.v8b.tar.gz3)配置源码cd jpeg-8b./

Xilinx zynq7000移植Mjpg_streamer

PC-Linux 版本:Ubuntu 14.04 Arm-Linux 内核版本:Linux version 3.17.0-xilinx (ubuntu@ubuntu) (gcc version 4.6.3 (Sourcery CodeBench Lite 2012.03-79) ) #29 SMP PREEMPT Sat Sep 29 19:26:22 PDT 2018 Jpeg版

全志开发板h616 ----使用 mjpg-streamer 测试 USB 摄像头

一.USB 摄像头测 试 1. 首先将 USB 摄像头插入到 Orange Pi 开发板的 USB 接口中 2.然后通过 lsmod 命令可以看到内核自动加载了下面的模块 3. 通过 v4l2-ctl 命令可以看到 USB 摄像头的设备节点信息为 /dev/video0 orangepi@orangepi:~$ sudo apt update

![ALVR 编译 windows android [Streamer Client]](/front/images/it_default.jpg)