ptuning专题

阿里云部署ChatGLM-6B及ptuning微调教程

一、模型部署 1.进入阿里云人工智能平台PAI。 2.申请免费试用。 3.打开交互式建模 PAI-DSW。 4.新建实例。 5.填写配置。 6.实例准备完成后点击打开。 7.打开实例后点击Teminal。 8.在Teminal中依次输入以下命令并执行。 apt-get updateapt-get install g

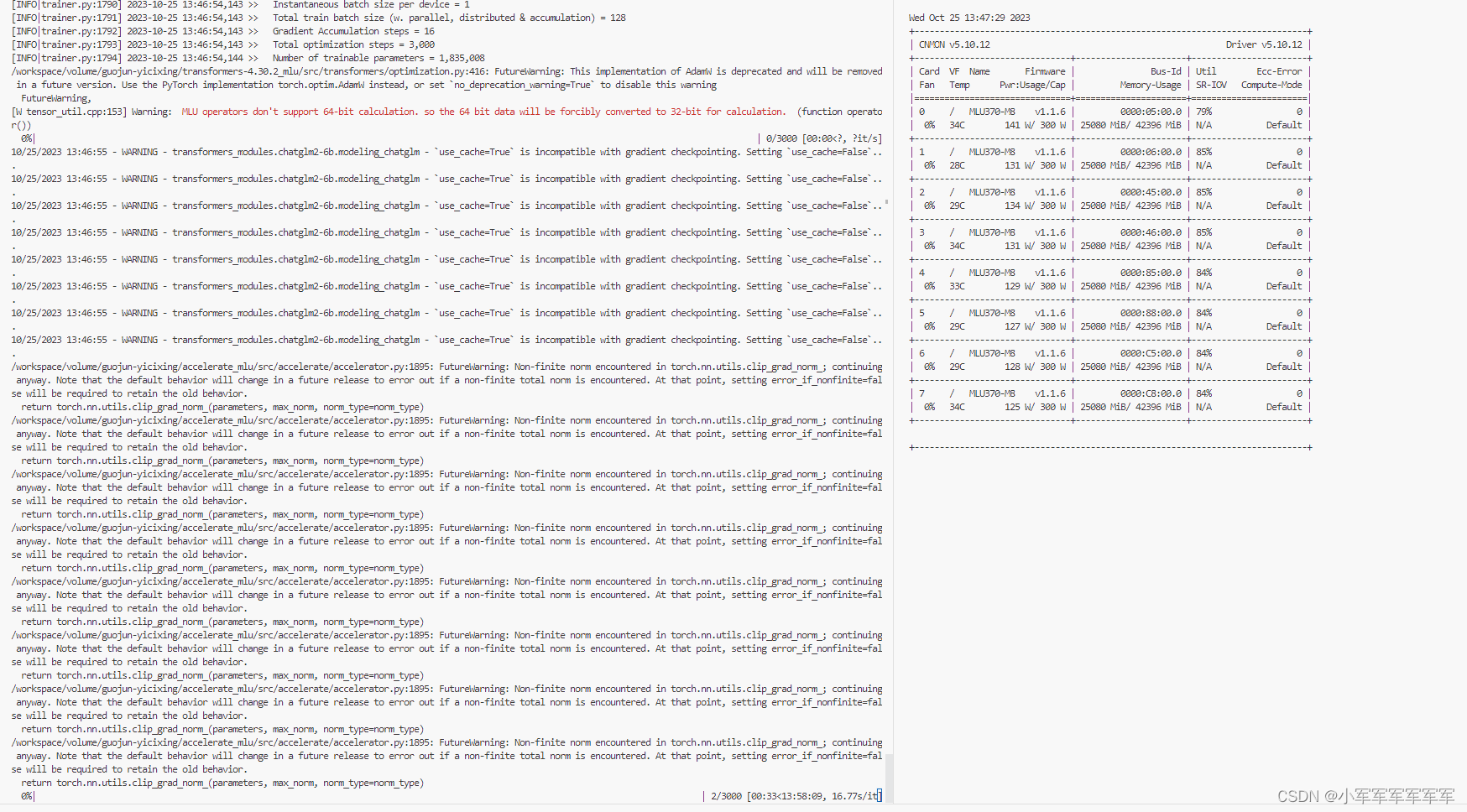

寒武纪芯片MLU370-M8完成GLM2-6B多轮对话Ptuning-v2

文章目录 前言一、环境准备1.云平台环境准备2.私有库安装3.快速模型下载4.代码修改 二、开始运行1.启动脚本2.运行状态 总结 前言 前几篇讲到了有关大模型在寒武纪卡上推理,是不是觉得越来越简单了,接下来上干活知识,基于寒武纪卡完成大模型微调,以及后面还会讲到基于寒武纪卡完成数字人训练+推理,敬请期待。 废话不多说,我们现在开始 一、环境准备 1.云平台环境准备

chatglm2微调—ptuning

Freeze: 即参数冻结,对原始模型部分参数进行冻结操作,仅训练部分参数,以达到在单卡或不进行TP或PP操作,就可以对大模型进行训练。 P-Tuning: 在输入的embedding层前,将prompt转换为可学习的额外一层embedding层. P-Tuning,仅对大模型的Embedding加入新的参数。P-Tuning-V2,将大模型的Embedding和每一层前都加上新的参数。当pr