mllm专题

MiniCPM-V: A GPT-4V Level MLLM on Your Phone

MiniCPM-V: A GPT-4V Level MLLM on Your Phone 研究背景和动机 现有的MLLM通常需要大量的参数和计算资源,限制了其在实际应用中的范围。大部分MLLM需要部署在高性能云服务器上,这种高成本和高能耗的特点,阻碍了其在移动设备、离线和隐私保护场景中的应用。 文章主要贡献: 提出了MiniCPM-V系列模型,能在移动端设备上部署的MLLM。 性能优越:

大白话说什么是“MLLM”多模态大语言模型

1. 什么是MLLM多模态大语言模型 1.1 先来思考一个问题 如果上传了一张图片,并向大模型提问。“图片中绿色框框中的人是谁?” 大模型回答:“那是波多野吉衣老师” 请问,大模型是怎么做到的? 我们用常规的思路来想一下,难道是: 第一步:先对图片进行目标检测,先把绿色框的内容剪切出来; 第二步:在剪切后的图片中,把人脸标记出来,并读取其landmark转为向量; 第三步:在人脸向

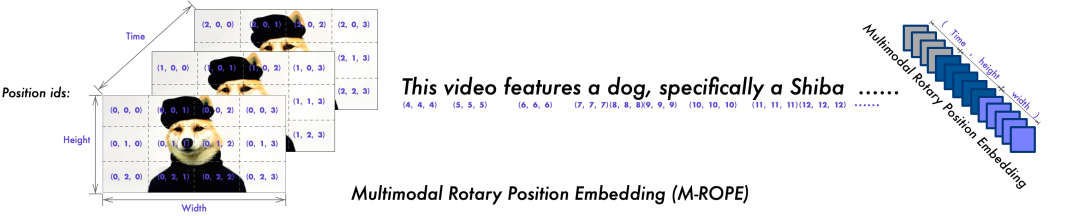

MLLM(二)| 阿里开源视频理解大模型:Qwen2-VL

2024年8月29日,阿里发布了 Qwen2-VL!Qwen2-VL 是基于 Qwen2 的最新视觉语言大模型。与 Qwen-VL 相比,Qwen2-VL 具有以下能力: SoTA对各种分辨率和比例的图像的理解:Qwen2-VL在视觉理解基准上达到了最先进的性能,包括MathVista、DocVQA、RealWorldQA、MTVQA等。理解 20 分钟+ 的视频:Qwe

MLLM(一)| 文/图生视频任务大升级,BigModel 开源了视频模型CogVideoX

CogVideoX的体验地址:https://bigmodel.cn/console/trialcenter?modelCode=cogvideox 自2021年起,智谱 AI 技术团队便开始着手布局包括 text-2-img、text-2-video、img-2-text、video-2-text 在内的多模态模型,并陆续研发并开源了CogView、CogVideo、Rela

迈向『闭环』| PlanAgent:基于MLLM的自动驾驶闭环规划新SOTA!

中科院自动化所深度强化学习团队联合理想汽车等提出了一种新的基于多模态大语言模型MLLM的自动驾驶闭环规划框架—PlanAgent。该方法以场景的鸟瞰图和基于图的文本提示为输入,利用多模态大语言模型的多模态理解和常识推理能力,进行从场景理解到横向和纵向运动指令生成的层次化推理,并进一步产生规划器所需的指令。在大规模且具有挑战性的nuPlan基准上对该方法进行了测试,实验表明PlanAgent在常规场

十、多模态大语言模型(MLLM)

1 多模态大语言模型(Multimodal Large Language Models) 模态的定义 模态(modal)是事情经历和发生的方式,我们生活在一个由多种模态(Multimodal)信息构成的世界,包括视觉信息、听觉信息、文本信息、嗅觉信息等MLLMs的定义 由LLM扩展而来具有接收和推理多模态信息能力的模型 2 模型概念区分 跨模态模型单模态大模型多模态模型多模态语言大模型 跨

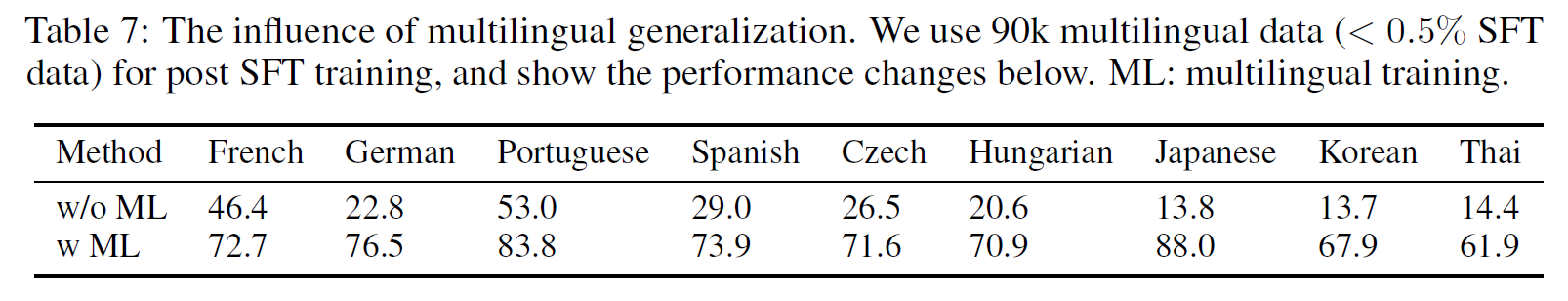

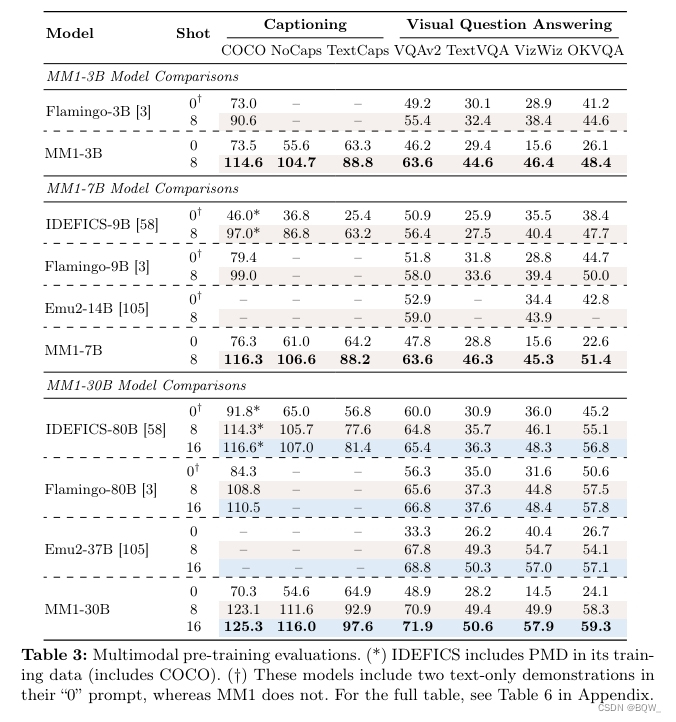

【极速前进】20240422:预训练RHO-1、合成数据CodecLM、网页到HTML数据集、MLLM消融实验MM1、Branch-Train-Mix

一、RHO-1:不是所有的token都是必须的 论文地址:https://arxiv.org/pdf/2404.07965.pdf 1. 不是所有token均相等:token损失值的训练动态。 使用来自OpenWebMath的15B token来持续预训练Tinyllama-1B,每1B token保存一个checkpoint。对于每个checkpoint都评估token级别的loss

NLM、LLM、MLLM概述

一、NLP:自然语言处理( Natural Language Processing, NLP) 自然语言处理( Natural Language Processing, NLP)是计算机科学领域与人工智能领域中的一个重要方向。它研究能实现人与计算机之间用自然语言进行有效通信的各种理论和方法。 自然语言处理是一门融语言学、计算机科学、数学于一体的科学。因此,这一领域的研究将涉及自然语言,即人们

一文读懂「MLLM,Multimodal Large Language Model」多模态大语言模型

一. 什么是多模态? 模态是事物的一种表现形式,多模态通常包含两个或者两个以上的模态形式,是从多个视角出发对事物进行描述。生活中常见多 模态表示,例如传感器的数据不仅仅包含文字、图像,还可以包括与之匹配的温度、深度信息等。使用多模态数据能够使得事物呈现更加立体、全面,多模态研究成为当前研究重要方面,在情感分析、机器翻译、自然语言处理 和生物医药前沿方向取得重大突破。 1.1 背景 T

多模态大模型MLLM 指令微调相关文章

文章目录 LLM“家谱树”MLLM使用指南--任务导向上手大模型多模态大模型的发展多模态数据模型架构 MLLM 指令微调相关文章BLIP-2模型结构Q- Former训练细节 **InstructBLIP**使用的模型数据集构造训练和评估

多模态MLLM都是怎么实现的(7)-Sora

上一篇的链接:多模态MLLM都是怎么实现的(6)-Dit Diffusion Transformer (qq.com) 上上一篇的链接:多模态MLLM都是怎么实现的(5)-Backbone, Unet or Transformer?从0搭建一个SD (qq.com) 上上上一篇的链接:多模态MLLM都是怎么实现的(4)-去噪声 (qq.com) 上上上上一篇的链接: 多模态MLLM都是怎么实

多模态MLLM都是怎么实现的(1)

好多读者私信说想了解一下多模态的内容,我这人最大的优点就是听劝... 好,那么好 , 今天开始陆续写点多模态内容,没想好是不是要写个专栏(因为我之前挖的坑太多...),然而还是开了,今天先写点基础做个seed 有想了解一下多模态扫盲的读者,可以自己先看看这篇论文 2311.13165.pdf (arxiv.org) 说是论文其