mixup专题

关于Balanced-MixUp是自定义的交叉熵损失函数

Balanced-MixUp的自定义的交叉熵损失函数 def cross_entropy_loss(input: torch.Tensor,target: torch.Tensor) -> torch.Tensor:return -(input.log_softmax(dim=-1) * target).sum(dim=-1).mean() 官方的 nn.CrossEntropyLoss()

数据增强mixup技术

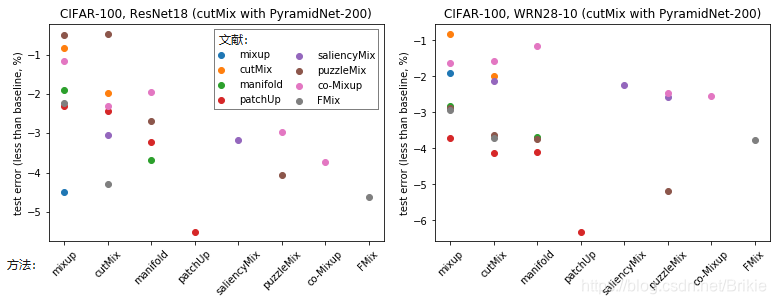

目录 一. mixup 1. mixup方法 2. mixup的讨论 2.1 mixup效果如何 2.2 为什么使用Beta分布 2.3 参数有何影响,如何选择 2.4 是否可以使用多个样本混合 2.5 为什么要使用凸组合 二. mixup的改进 1.多种改进方法简介 1.1 cutMix 1.2 manifold mixup 1.3 patchUp 1.4 puzz

数据增强之mixup算法详解

论文地址:mixup: BEYOND EMPIRICAL RISK MINIMIZATION (一)、什么是数据增强? (1). 数据增强主要指在计算机视觉领域中对图像进行数据增强,从而弥补训练图像数据集不足,达到对训练数据扩充的目的。 (2). 数据增强是一种数据扩充方法,可分为同类增强(如:翻转、旋转、缩放、移位、模糊等)和混类增强(如mixup)两种方式。 (二)、同类数据增强方式主要有哪