minicpm专题

4B参数秒杀GPT-3.5:MiniCPM 3.0惊艳登场!

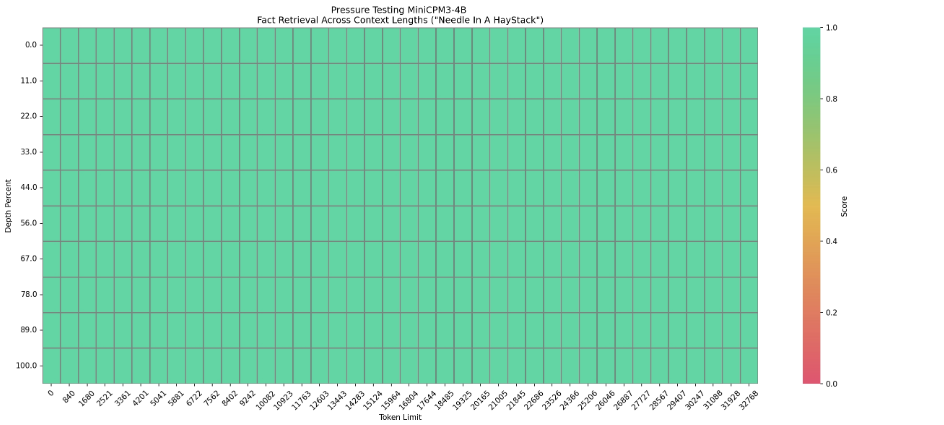

面壁智能 在 AI 的世界里,总有那么几个时刻让人惊叹不已。面壁智能推出的 MiniCPM 3.0,这个仅有4B参数的"小钢炮",正在以惊人的实力挑战着 GPT-3.5 这个曾经的AI巨人。 MiniCPM 3.0 MiniCPM 3.0 MiniCPM 3.0 目前的主要功能有: 长上下文功能:原生支持 32k 上下文长度,性能完美。我们引入了

MiniCPM-V: A GPT-4V Level MLLM on Your Phone

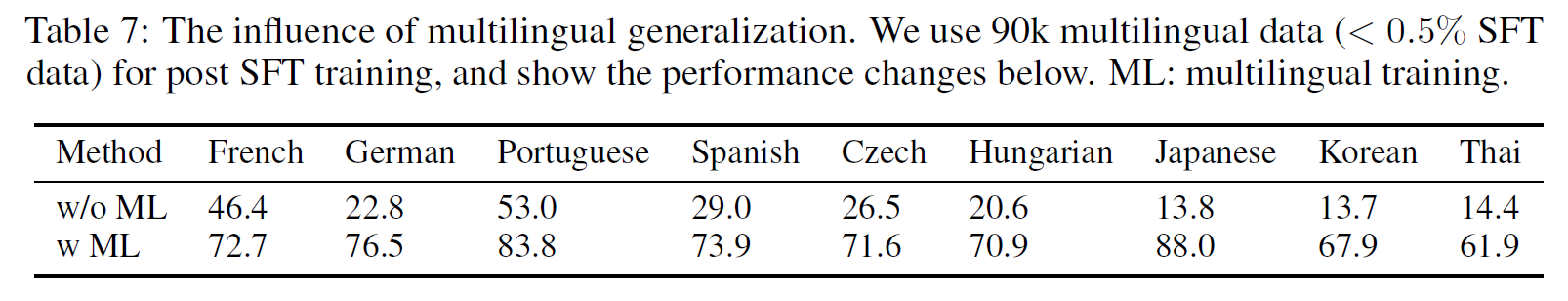

MiniCPM-V: A GPT-4V Level MLLM on Your Phone 研究背景和动机 现有的MLLM通常需要大量的参数和计算资源,限制了其在实际应用中的范围。大部分MLLM需要部署在高性能云服务器上,这种高成本和高能耗的特点,阻碍了其在移动设备、离线和隐私保护场景中的应用。 文章主要贡献: 提出了MiniCPM-V系列模型,能在移动端设备上部署的MLLM。 性能优越:

[大模型]MiniCPM-2B-chat Lora Full 微调

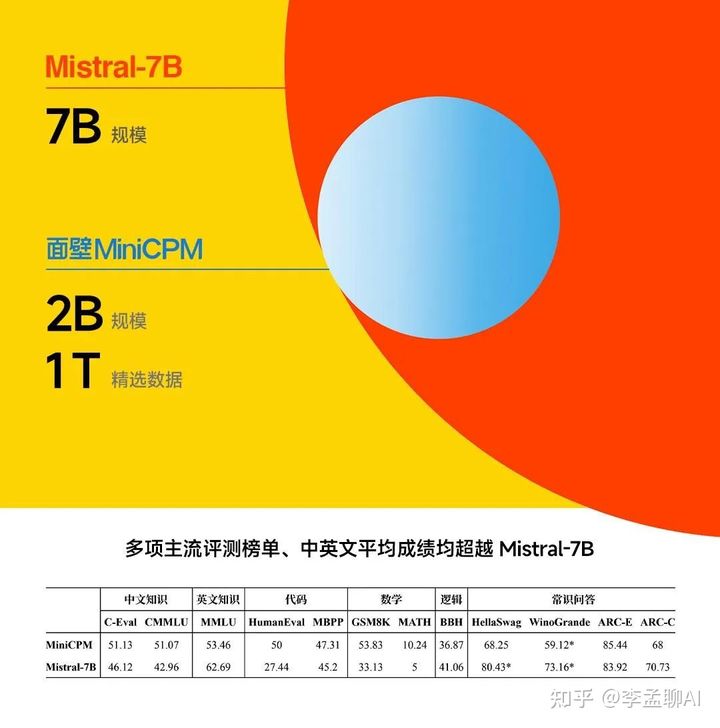

MiniCPM-2B-chat 介绍 MiniCPM 是面壁智能与清华大学自然语言处理实验室共同开源的系列端侧大模型,主体语言模型 MiniCPM-2B 仅有 24亿(2.4B)的非词嵌入参数量。 经过 SFT 后,MiniCPM 在公开综合性评测集上,MiniCPM 与 Mistral-7B相近(中文、数学、代码能力更优),整体性能超越 Llama2-13B、MPT-30B、Falcon-4

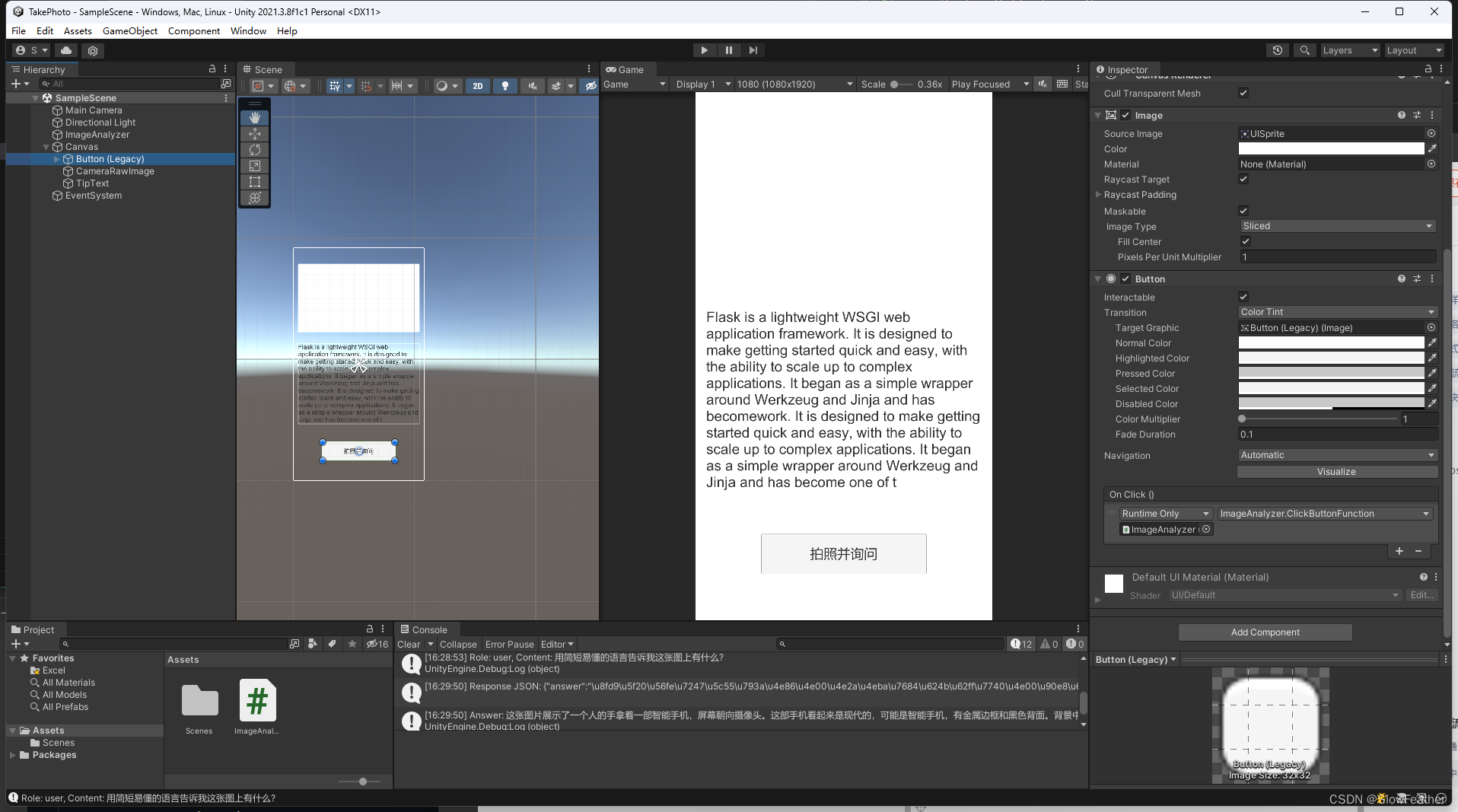

Unity MiniCPM-V 让引擎拥有视觉

Unity MiniCPM-V 让引擎拥有视觉 前言项目Python环境布置Unity场景布置代码编写添加并设置脚本总结 鸣谢AI提示 前言 新发布的MiniCPM-V,忍不住玩一下,可以让之前制作的语音助手拥有一定的视觉能力(不是OpenCV不行,而是AI更加符合一个助手所需要的观察力)。这个简单的小项目中我只实现了少量交互代码,大部分全部由ChatGPT 3.5完成,可以在文

【记录】初次本地搭建的模型-MiniCPM 2B

前言 查阅众多开源大模型后,打算动手尝试搭建端侧模型,看看效果。选中MiniCPM主要是因为参数小,同时中文支持相对较好。 首先对按照官网提供的demo进行了尝试,然后在colab中完成了一个webui程序并测试,最后通过docker环境在本地搭建并测试成功。 Colab Demo测试 from transformers import A

MiniCPM-V_2.0

MiniCPM-V 官网 安装 克隆我们的仓库并跳转到相应目录 git clone https://github.com/OpenBMB/MiniCPM-V.gitcd MiniCPM-V 2. 创建 conda 环境 conda create -n minicpmv2 python=3.10 -yconda activate

LLMs之MiniCPM:MiniCPM(揭示端侧大语言模型的无限潜力)的简介、安装和使用方法、案例应用之详细攻略

LLMs之MiniCPM:MiniCPM(揭示端侧大语言模型的无限潜力)的简介、安装和使用方法、案例应用之详细攻略 目录 MiniCPM的简介 0、更新日志 1、公开的模型 2、局限性 3、文本模型评测 越级比较: 同级比较: Chat模型比较: DPO后模型比较: MiniCPM-2B-128k 模型评测 MiniCPM-MoE-8x2B模型评测 多模态模型

[大模型]MiniCPM-2B-chat transformers 部署调用

MiniCPM-2B-chat transformers 部署调用 MiniCPM-2B-chat 介绍 MiniCPM 是面壁智能与清华大学自然语言处理实验室共同开源的系列端侧大模型,主体语言模型 MiniCPM-2B 仅有 24亿(2.4B)的非词嵌入参数量。 经过 SFT 后,MiniCPM 在公开综合性评测集上,MiniCPM 与 Mistral-7B相近(中文、数学、代码能力更优)

1元竟能驱动170万次AI推理?面壁智能MiniCPM 2B大模型,部署教程 移动端 安卓 苹果 ios android

在科技日新月异的今天,我们似乎习惯了“更新换代”的节奏。但你有没有想过,那些陪伴我们多年的老手机,也能摇身一变成为AI神器?面壁智能的MiniCPM 2B大模型,就给我们带来了这样的惊喜。 你可能不知道,这个仅有20亿参数的大模型,却拥有“越级打怪”的实力。与业内知名的大模型相比,它在多项主流评测中都展现出了优越的性能。更令人振奋的是,它的成本极低,仅需1元就能驱动170万次AI推理!

![[大模型]MiniCPM-2B-chat Lora Full 微调](https://img-blog.csdnimg.cn/direct/1b9775b35ecf41d0b84e94ae4974da3d.png#pic_center)

![[大模型]MiniCPM-2B-chat transformers 部署调用](https://img-blog.csdnimg.cn/direct/7db98dc1d80543bfa68e1c7333f2b514.png#pic_center)