internvl专题

书生浦语实训营-InternVL 多模态模型部署微调实践

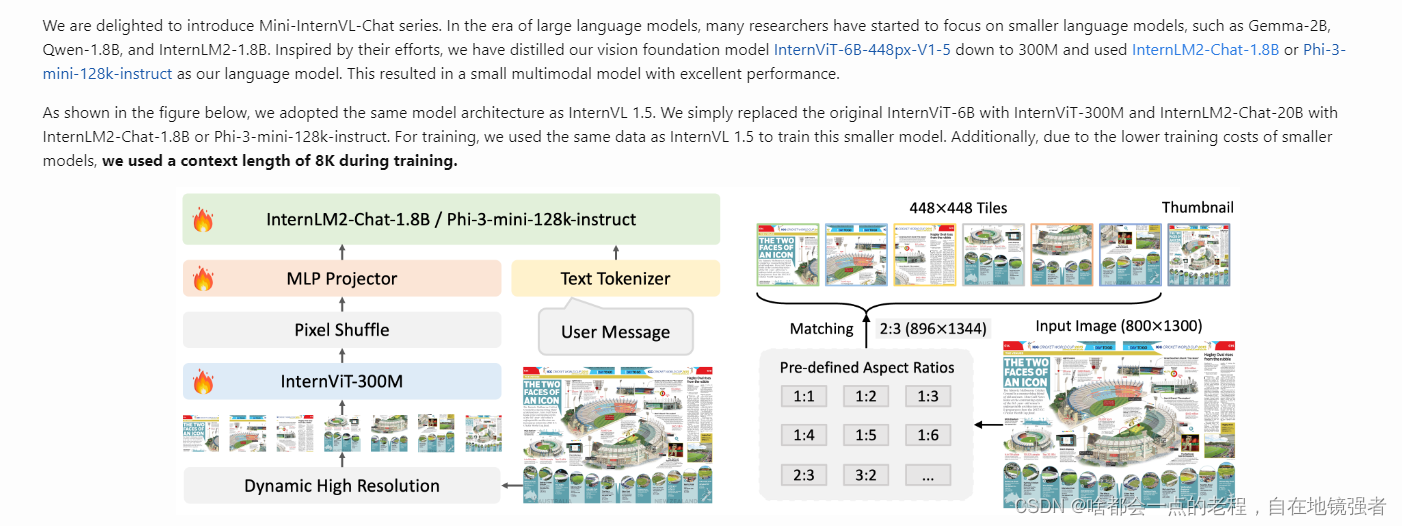

1.什么是InternVL InternVL 是一种用于多模态任务的深度学习模型,旨在处理和理解多种类型的数据输入,如图像和文本。它结合了视觉和语言模型,能够执行复杂的跨模态任务,比如图文匹配、图像描述生成等。 2.InternVL模型介绍 对于InternVL这个模型来说,它的vision模块就是一个微调过的ViT,llm模块是一个InternLM的模型。对于视觉模块来说,它的特殊之处在

超速解读多模态InternVL-Chat1.5 ,如何做到开源SOTA——非官方首发核心技巧版(待修订)

解读InternVL-chat1.5系列 最近并行是事情太杂乱了,静下心来看一看优秀的开源项目,但是AI技术迭代这么快,现在基本是同时看五、六个方向的技术架构和代码,哪个我都不想放,都想知道原理和代码细节,还要自己训练起来,导致每天脑袋隐隐作痛了,感觉有点天龙八部里的“鸠摩智”的状态。 …目前的大模型核心能力热点是其通用能力的提升,从判别式、到对比学习、再到如今的多阶段对齐训练。VLM多模态模型

internvl-chat部署

简介 InternVL1.5是一个开源的视觉模型,效果接近gpt-4v github地址:https://github.com/OpenGVLab/InternVL 体验地址:https://internvl.opengvlab.com/ 安装 官方推荐使用LMDeploy进行安装:https://lmdeploy.readthedocs.io/zh-cn/latest/get_star

下一代视觉语言模型对比:CogVLM2、InternVL与多模态应用

本文全面对比了最新的开源视觉语言模型(VLM)CogVLM2与InternVL-1.5,探讨了它们在性能、功能和应用场景上的异同。CogVLM2基于Meta-Llama-3-8B-Instruct,表现出强大的多模态理解能力,支持长文本和高分辨率图像,且提供中英文双语模型。InternVL-1.5则通过改进视觉编码器、动态高分辨率策略和高质量双语数据集,缩小了与商业模型的差距。本文详细介绍了两款

Nvidia V100 GPU 运行 InternVL 1.5-8bit

InternVL 运行 InternVL 1.5-8bit教程 InternVL 官网仓库及教程 1. 设置最小环境 conda create --name internvl python=3.10 -yconda activate internvlconda install pytorch==2

InternVL——GPT-4V 的开源替代方案

您的浏览器不支持 video 标签。 在人工智能领域,InternVL 无疑是一颗耀眼的新星。它被认为是最接近 GPT-4V 表现的可商用开源模型,为我们带来了许多惊喜。 InternVL 具备强大的功能,不仅能够处理图像和文本数据,还能精妙地理解它们之间的复杂关系。比如,它可以准确地识别图像中的对象,并与相关描述对应起来。在 OCR 和文档理解方面,这款模型更是表现出色,能够有效