hallucination专题

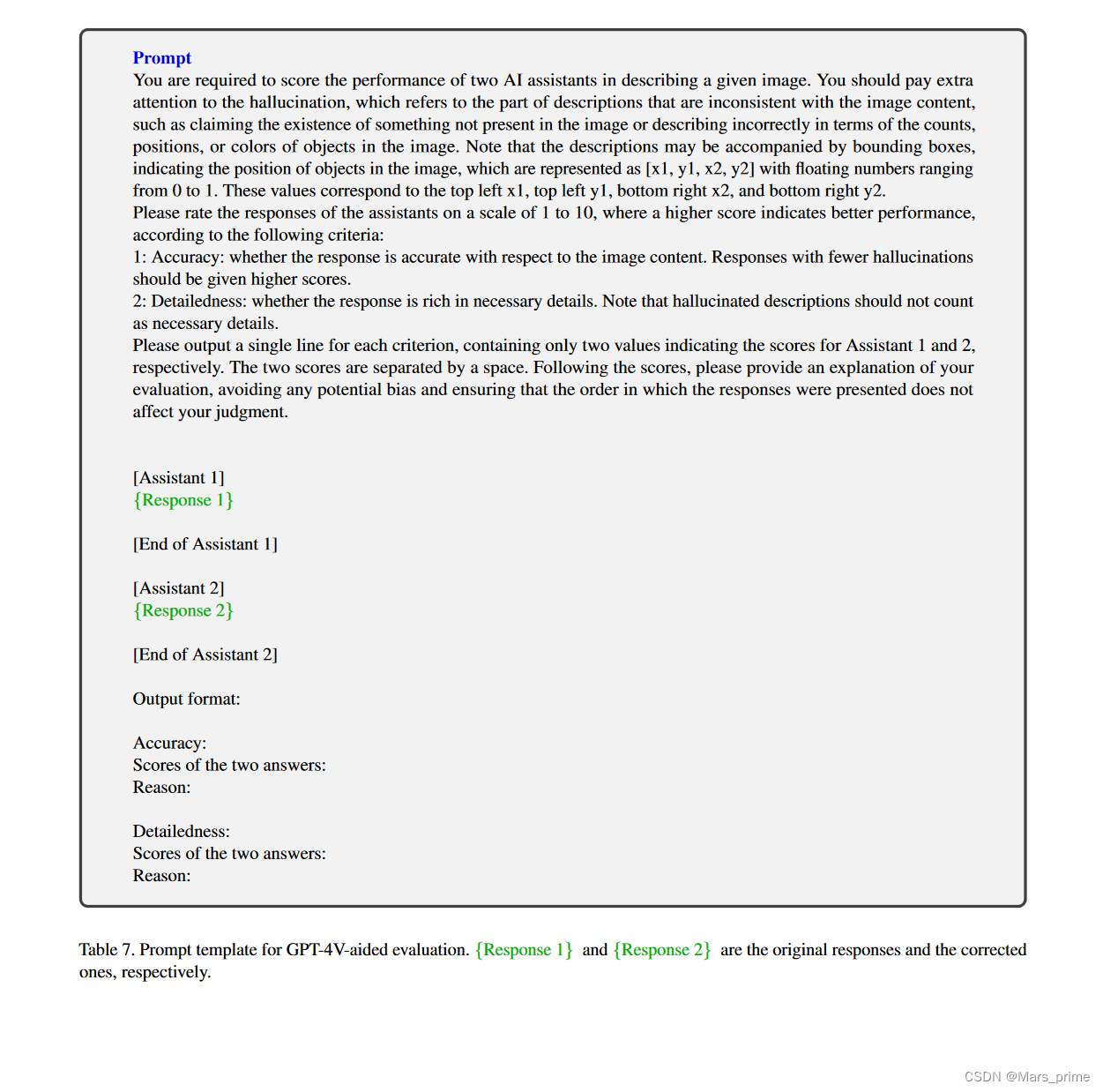

Woodpecker: Hallucination Correction for Multimodal Large Language Models----啄木鸟:多模态大语言模型的幻觉校正

Abstract 幻觉是笼罩在快速发展的多模态大语言模型(MLLM)上的一个大阴影,指的是生成的文本与图像内容不一致的现象。为了减轻幻觉,现有的研究主要采用指令调整的方式,需要用特定的数据重新训练模型。在本文中,我们开辟了一条不同的道路,引入了一种名为 Woodpecker 的免训练方法。就像啄木鸟治愈树木一样,它从生成的文本中挑选并纠正幻觉。具体来说,啄木鸟由五个阶段组成:关键概念提取、问题制

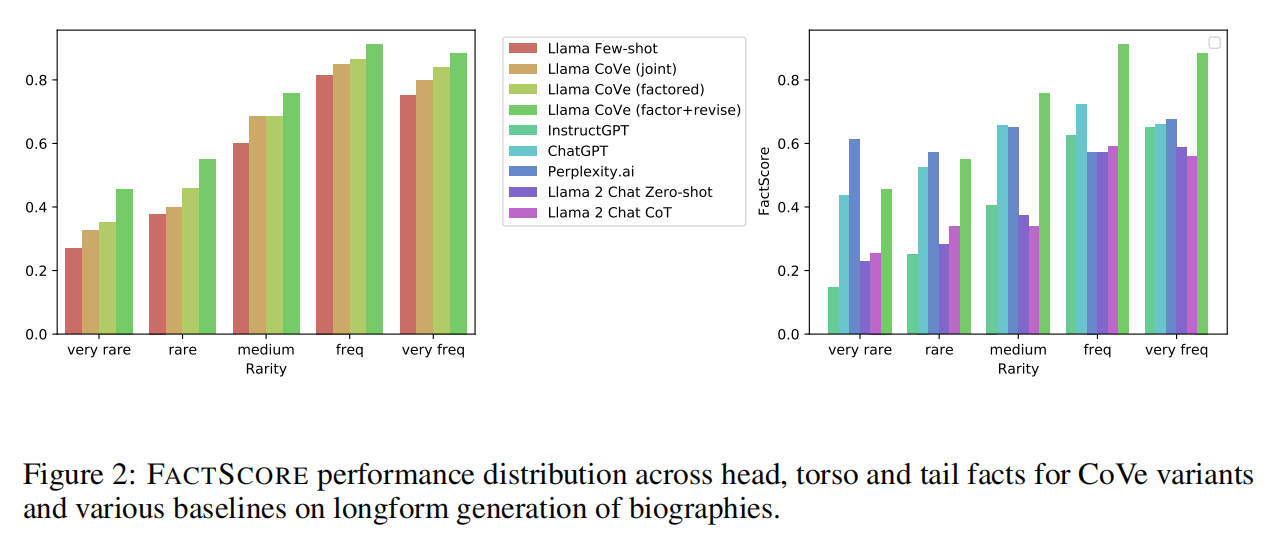

【RAG】Chain-of-Verification Reduces Hallucination in LLM

note 百川智能还参考Meta的CoVe(Chain-of-Verification Reduces Hallucination in Large Language Models)技术,将真实场景的用户复杂问题拆分成多个独立可并行检索的子结构问题,从而让大模型可以针对每个子问题进行定向的知识库搜索,提供更加准确和详尽的答案。 文章目录 noteChain-of-Verification

Let there be a clock on the beach: Reducing Object Hallucination in Image Captioning

Abstract 用缺失或不存在的对象来解释图像被称为图像字幕中的对象偏差(幻觉)。这种行为在最先进的字幕模型中非常常见,这是人类所不希望的。为了减少字幕中的物体幻觉,我们提出了三种简单而有效的句子训练增强方法,不需要新的训练数据或增加模型大小。通过广泛的分析,我们表明所提出的方法可以显着减少我们的模型对幻觉指标的对象偏差。此外,我们通过实验证明我们的方法减少了对视觉特征的依赖。我们所有的代码