fsdp专题

Deepspeed、ZeRO、FSDP、ZeRO-Offload、all reduce、reduce-scatter

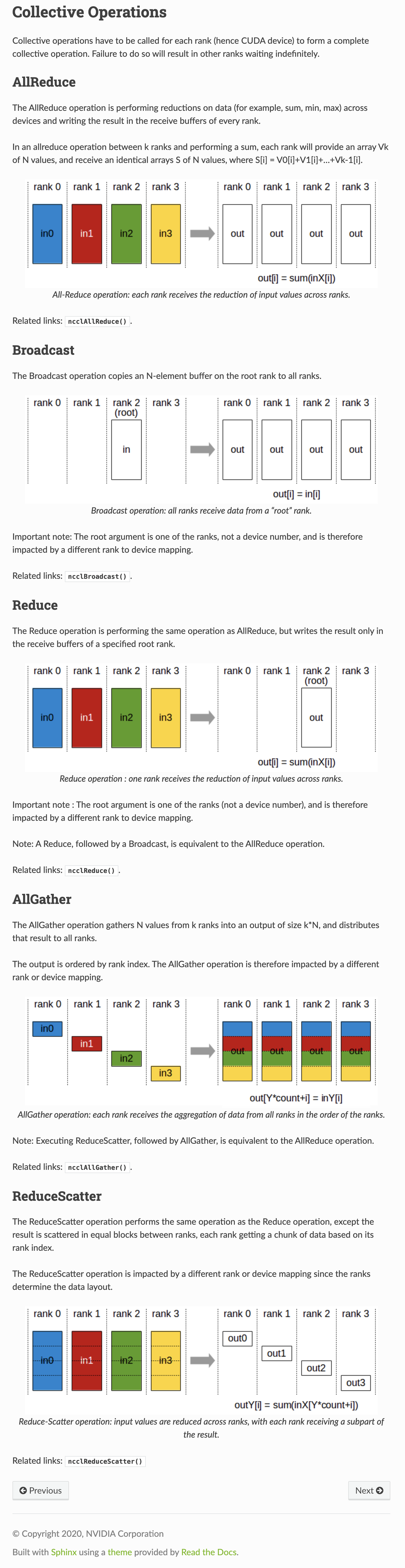

Transformer为基础的大模型应该如何并行 数据并行。但是如果模型太大放不到一块卡上就没用了。为了解决把参数放到一块卡上的问题,演进出了论文Zero的思想,分为Zero-DP和Zero-R两部分。Zero-DP是解决Data parallel的问题,并行过程中内容不够,解决思路也比较简单,模型参数w只存在一台机器上,剩下的部分等用的时候找某台机器通过all-reduce请求就可以了。Zer

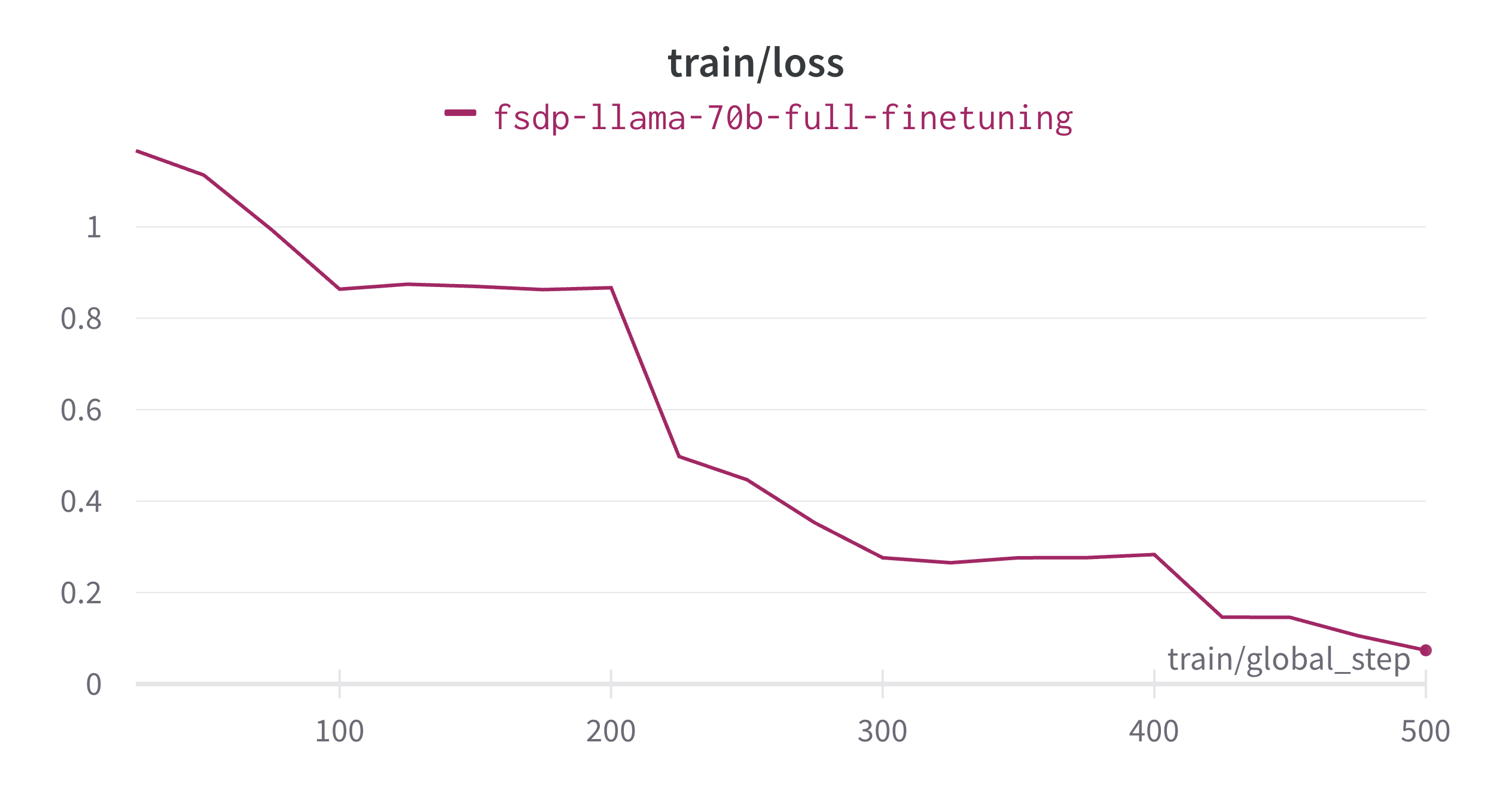

LLMs之Llama2 70B:使用 PyTorch FSDP 微调 Llama 2 70B实现全部过程讲解之详细攻略

LLMs之Llama2 70B:使用 PyTorch FSDP 微调 Llama 2 70B实现全部过程讲解之详细攻略 目录 使用 PyTorch FSDP 微调 Llama 2 70B 引言 FSDP 工作流 使用的硬件 微调 LLaMa 2 70B 面临的挑战 解决上述挑战,微调出一个 70B 的模型 准备工作 微调 应对挑战 1 应对挑战 2 应对挑战 3

pytorch单精度、半精度、混合精度、单卡、多卡(DP / DDP)、FSDP、DeepSpeed模型训练

pytorch单精度、半精度、混合精度、单卡、多卡(DP / DDP)、FSDP、DeepSpeed模型训练、模型保存、模型推理、onnx导出、onnxruntime推理等示例代码,并对比不同方法的训练速度以及GPU内存的使用。 代码:pytorch_model_train FairScale(你真的需要FSDP、DeepSpeed吗?) 在了解各种训练方式之前,先来看一下 FairSc