entscheidungsb专题

ML_3 决策树 Entscheidungsbäume

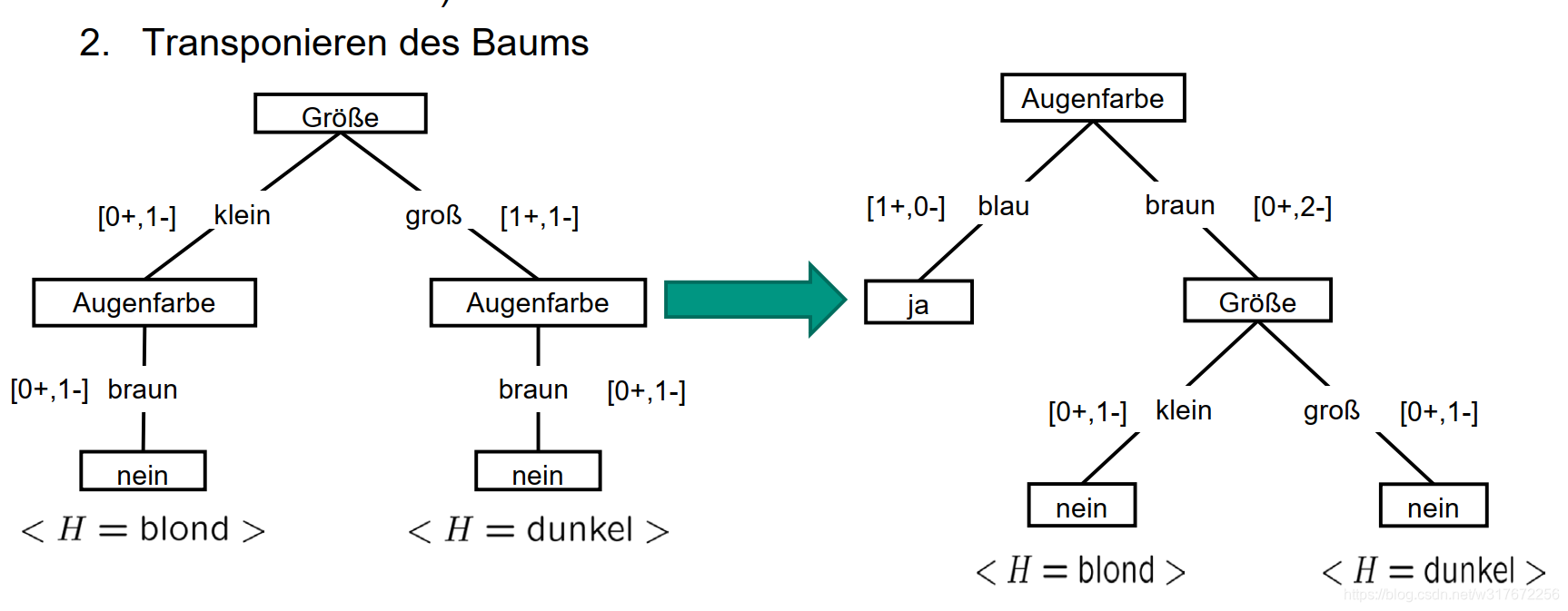

这章就屡一下公式以及适用的方法 ID3–非增量过程 entropie 根据标签生成熵 计算每一个属性的熵之和相减 最大的Gewinn对应的属性最优 +Occam’s Razor+尽可能简单的结构,而ID3生成的树很容易很复杂 Overfitting 如果出现噪声,容易Overfitting C4.5–改变了ID3通过生成的规则(剪枝) 由于Gewinn的方法,使得最优的属性更偏向于数据较少的一