egocentric专题

Fine-Grained Egocentric Hand-Object(中文翻译)

精细化自我中心手-物体分割: 数据集、模型(model)与应用 灵芝张1, 盛昊周1, 西蒙·斯滕特 $ {}^{2} $, 和健博·石 $ {}^{1} $ 摘要。 自我中心视频提供了高保真度建模人类行为的细粒度信息。手和交互对象是理解观众行为和意图的一个关键方面。我们提供了一个标注数据集,包含11,243个自我中心图像,并具有在各种日常活动中与手和对象互动的逐像素分割标签。我们的数据集是

【论文阅读】Single-Stage Visual Query Localization in Egocentric Videos

paper: code: 简介: 长篇自我中心视频的视觉查询定位需要时空搜索和指定对象的定位。之前的工作开发了复杂的多级管道,利用完善的对象检测和跟踪方法来执行 VQL(视觉查询定位)。然而,每个阶段都是独立训练的,管道的复杂性导致推理速度缓慢。我们提出了 VQLoC,这是一种新颖的单阶段 VQL 框架,可进行端到端训练。我们的关键思想是首先建立对查询视频关系的整体理解,然后以单次方式执行时

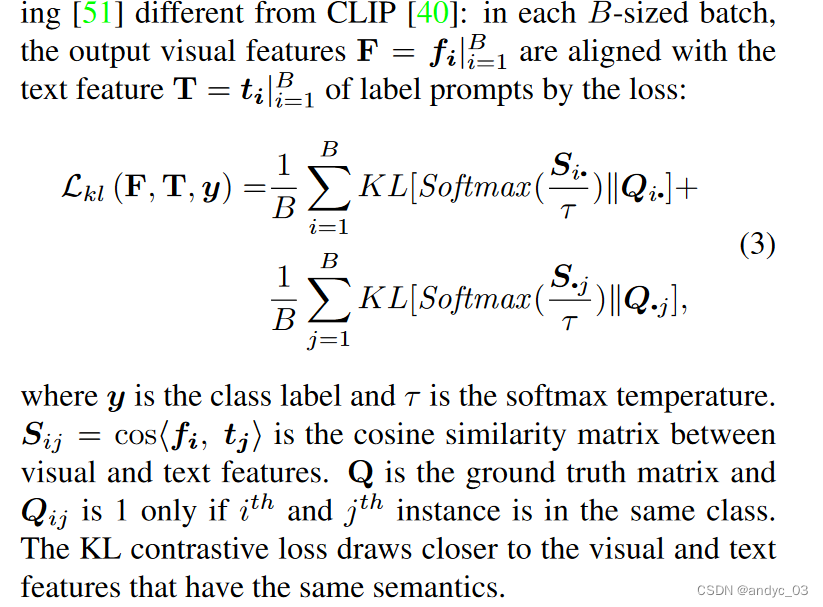

【论文阅读】EgoPCA: A New Framework for Egocentric Hand-Object Interaction

论文主要贡献 提出一种新的框架:Ego-HOI recognition by Probing, Curation and Adaption (EgoPCA)。构建了全面的预训练集,平衡的测试集,以及一个包含了微调策略的baseline。 在Ego-HOI达到了SOTA,并且建立了有效的机制方法。 Code and data are available here. 已有工作 Ego-HOI

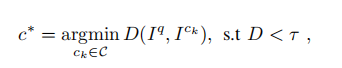

17、论文解读:Scan Context: Egocentric Spatial Descriptor for Place Recognition within 3D Point Cloud Map

简介: Scan Context(常简称SC):是2018年韩国kim等发在IROS上的一篇文章,是在shape context的基础上提出的,可以和loam系的一些文章相结合用于回环检测。 标题:Scan Context: Egocentric Spatial Descriptor for Place Recognition within 3D Point Cloud Map 作者:Gise