本文主要是介绍上传论文到arXiv,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

一、整理提交文件

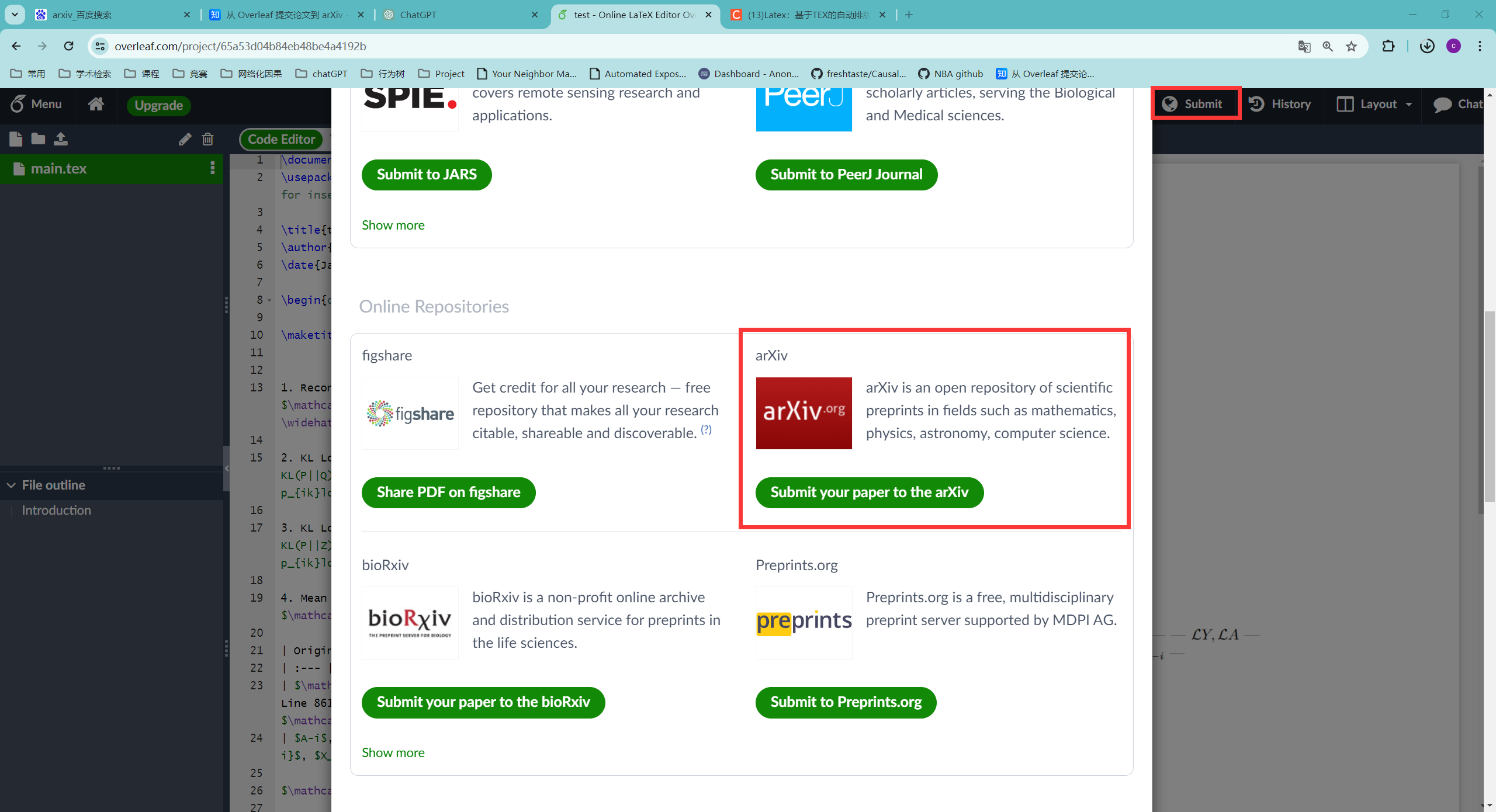

法一:从Overleaf获取.zip

Tips:

- 注意主文件要放在根目录

- 如果用

pdfLatex编译,确保图片全部为.png或.pdf

右上角Submit,选择

二、提交

登录arXiv官网:https://arxiv.org/,选择START NEW SUBMISSION。

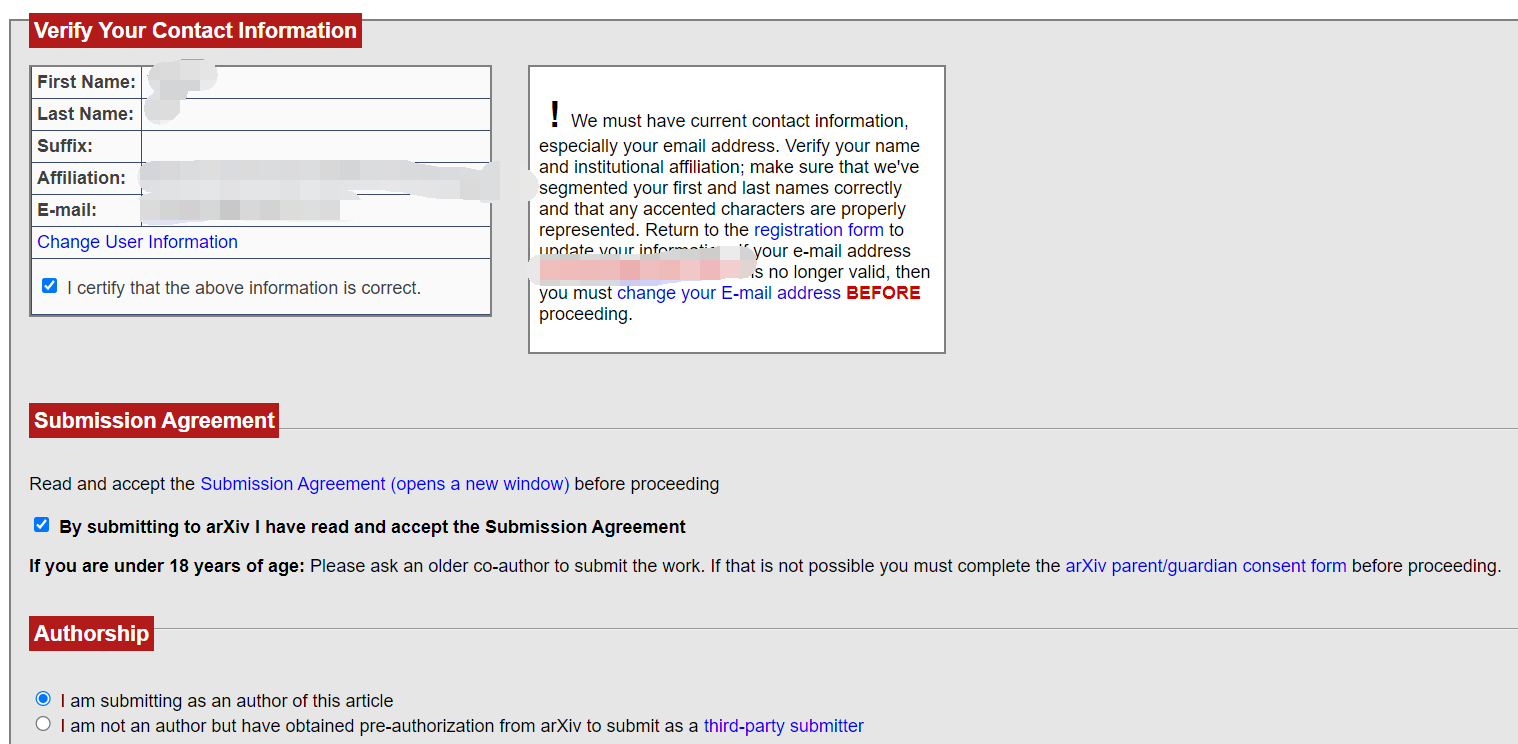

1、Start

(1)基础信息

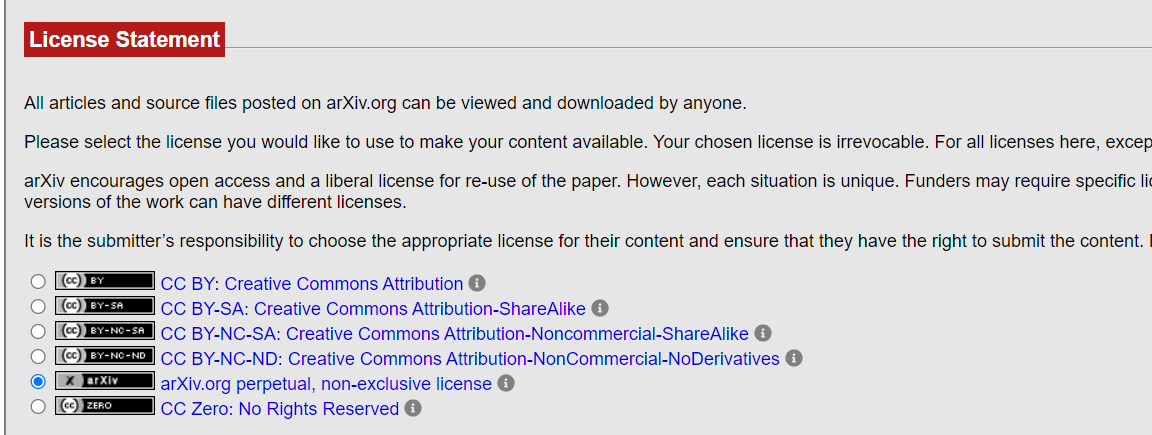

(2)License Statement

一般选择arXiv.org perpetual, non-exclusive license,

(3)Archive and Subject Class

选择该论文归属的主要领域,这里只选一个,想选其他的后面还可以再添加。

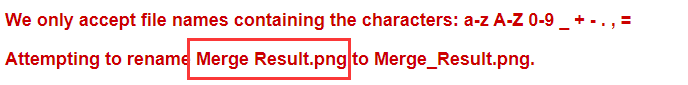

2、Add Files

将刚才的.zip上传,会自动解压识别。注意里面文件的命名只能由a-z A-Z 0-9 _ + - . , =组成,不能有空格,arxiv不支持

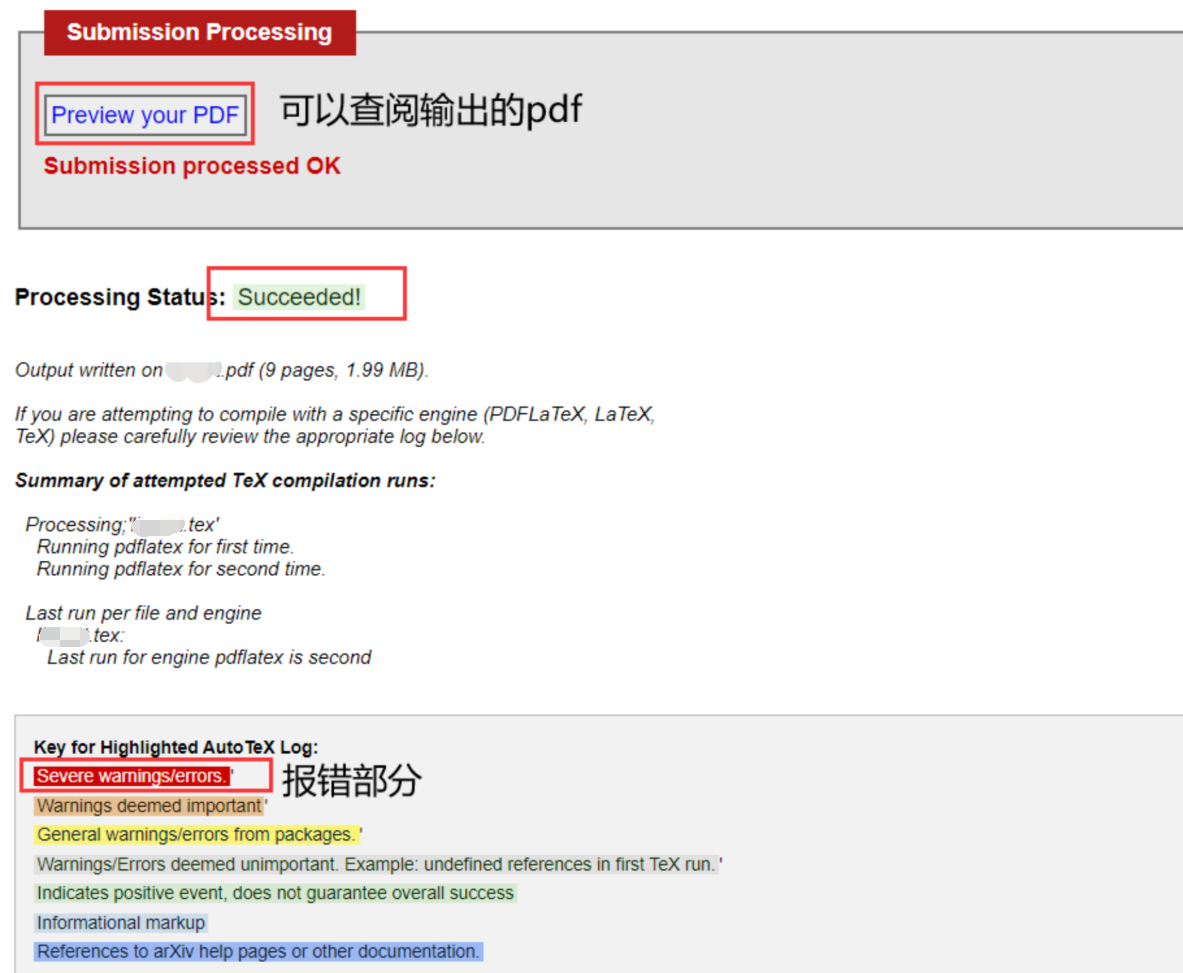

3、Process

这里会编译提交的内容,如果报错,可以找红色的error在哪里,对应解决问题。

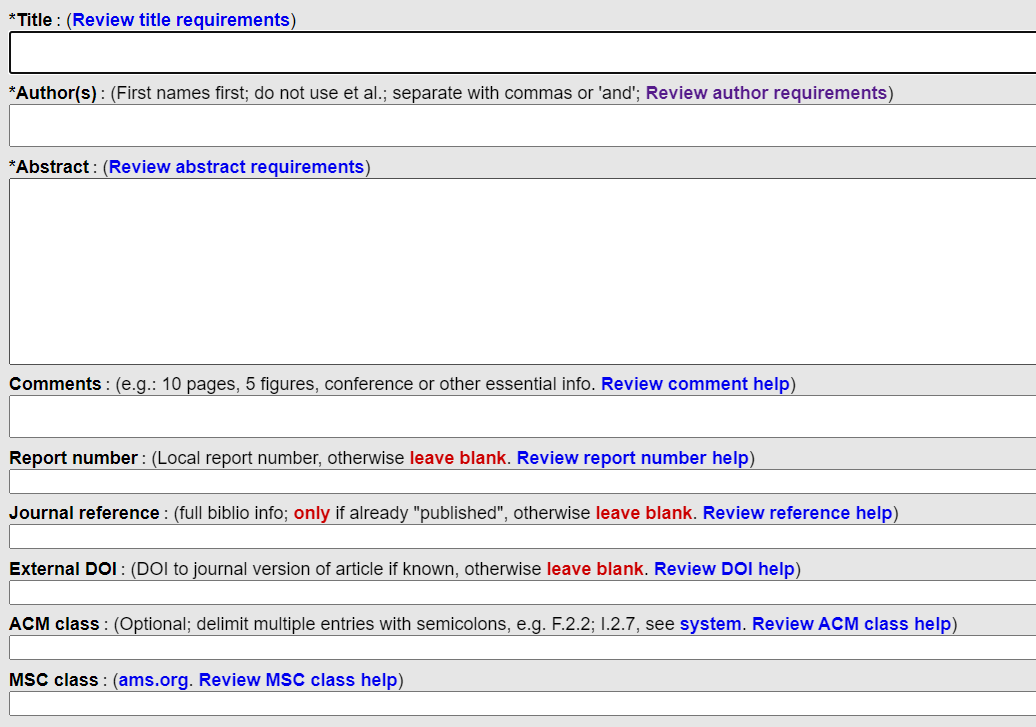

4、Metadata

对应填写信息即可

5、Preview

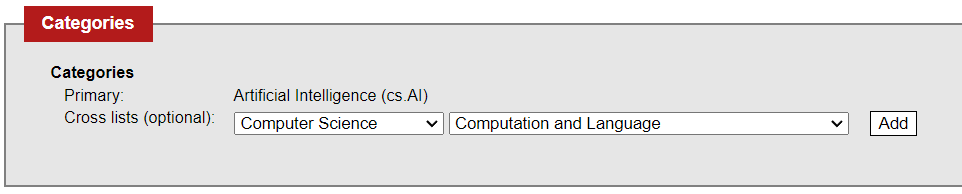

(1)Categories

这里可以添加新的交叉领域

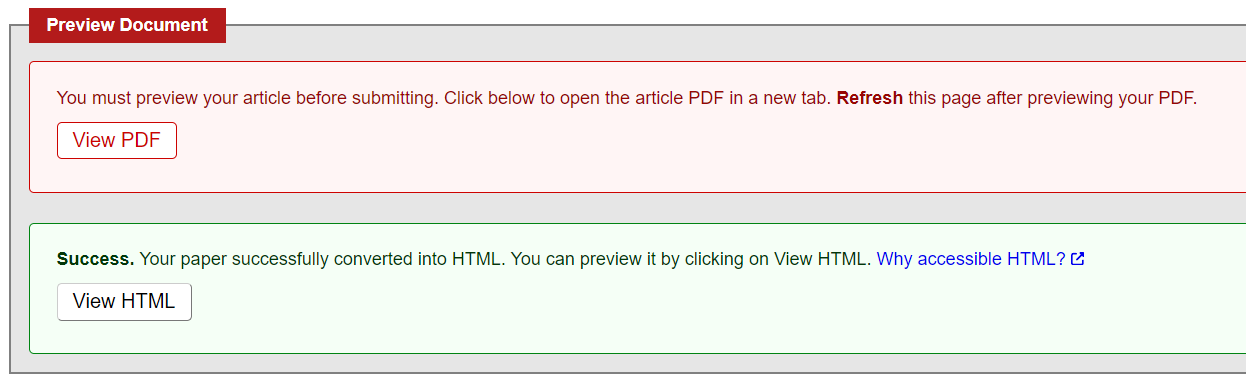

(2)Preview Document

再次检查PDF和HTML的显示

三、后续

(1)待审核

提交完成后会发送一封右键。

(2)审核通过及添加作者

审核通过后会再受到一封成功右键,并提供一个文章密码,密码可以用于添加作者来共同管理这篇论文。大约一周后谷歌学术会收录该arXiv论文。

参考链接:

从 Overleaf 提交论文到 arXiv

Arxiv 论文提交流程——看这篇就够了

这篇关于上传论文到arXiv的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!