本文主要是介绍AnythingLLM,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

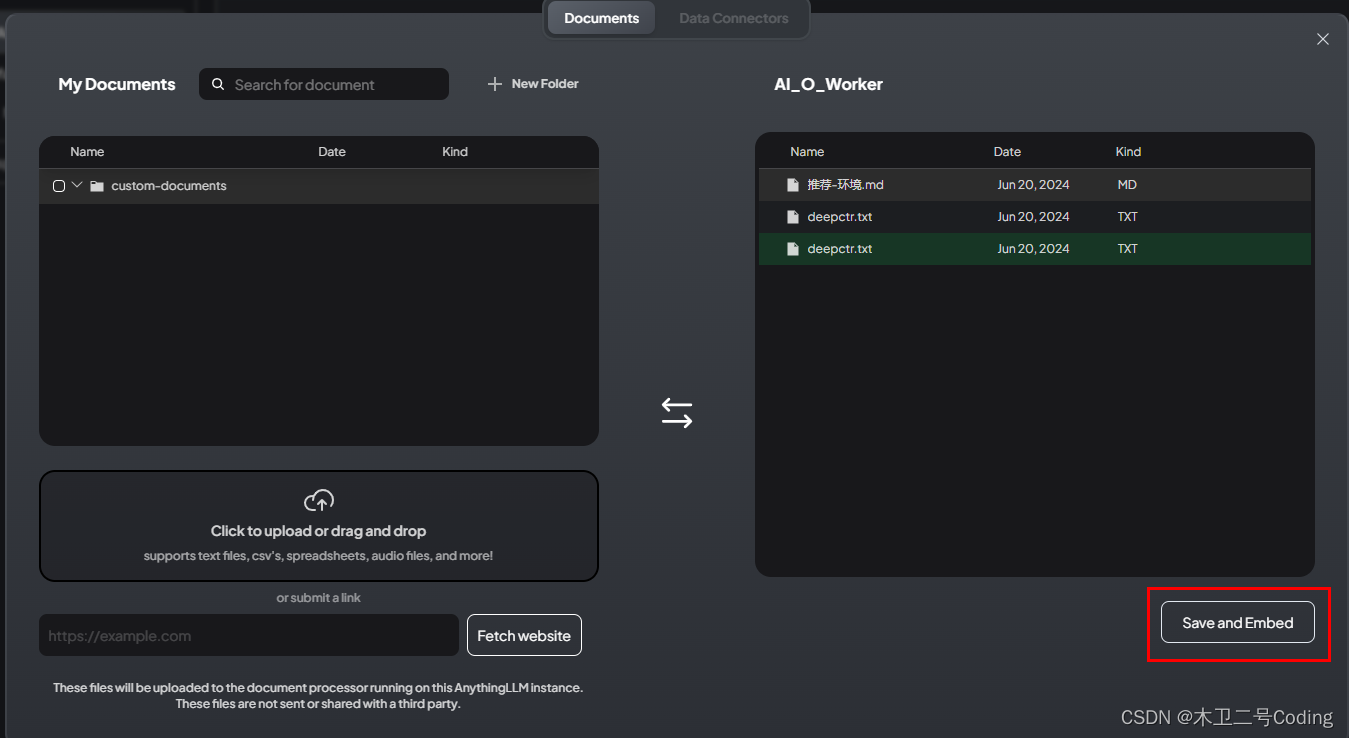

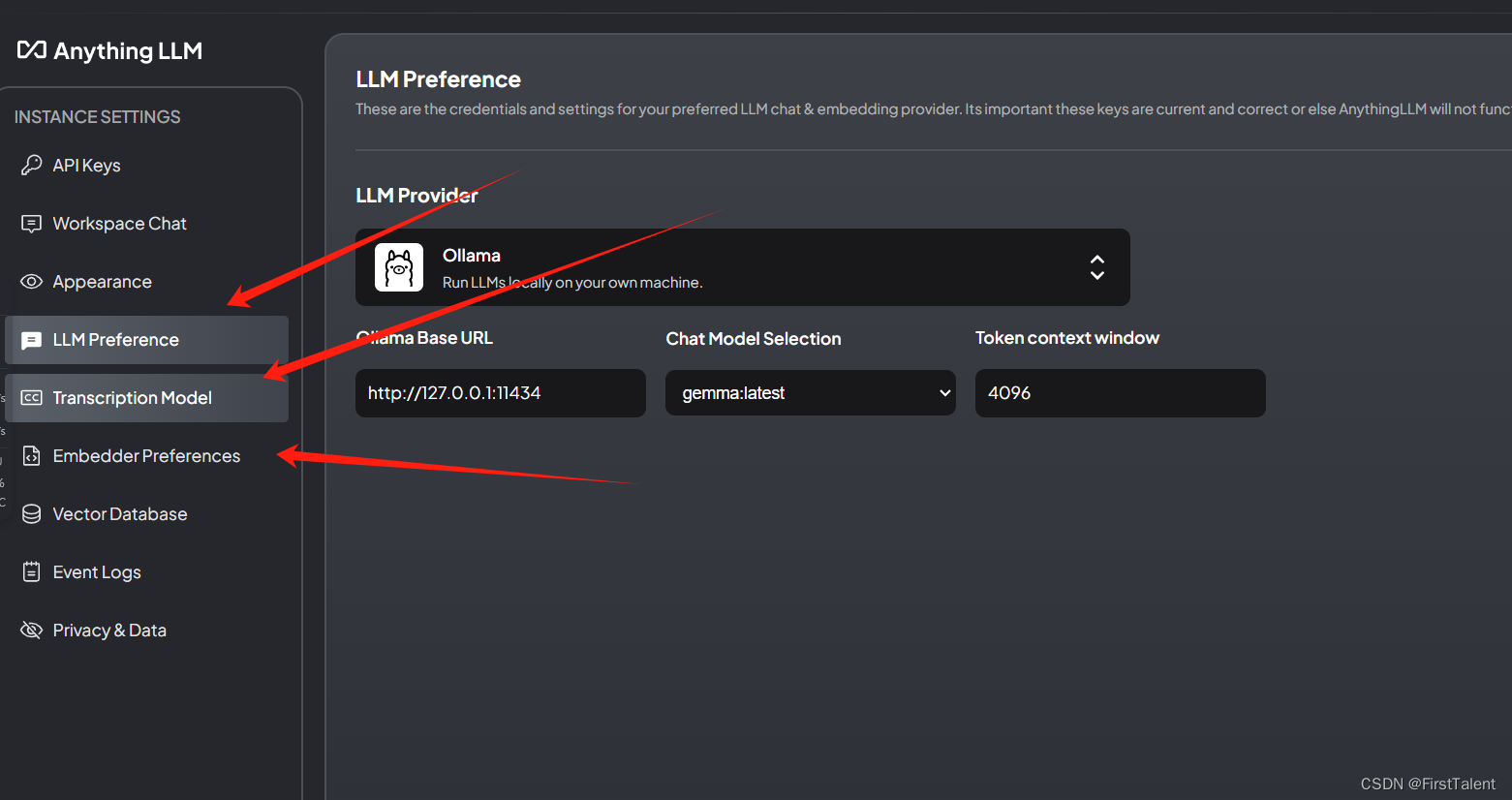

AnythingLLM是一款私人ChatGPT,它与传统的ChatGPT相比,具有更高的灵活性和可定制性。AnythingLLM是一个全栈应用程序,它能够将任何文档、资源或内容片段转化为上下文,供任何LLM(大语言模型)在聊天时作为参考使用。此外,它允许用户灵活选择所使用的LLM或向量数据库,并支持多用户管理和权限设置。因此,AnythingLLM可以被打造成企业内部知识库的私人专属GPT,用于智能处理各种文档并进行对话。

总的来说,AnythingLLM是一个功能强大的工具,它为用户提供了构建私有ChatGPT的便利,使用户能够充分利用现有的LLM技术,在私有环境中构建自己的ChatGPT。

AnythingLLM是LangChain公司的产品。

LangChain公司宣布推出其创新性的开源应用程序AnythingLLM,这款应用程序为个人和企业提供了定制化的ChatGPT体验,使构建私有ChatGPT变得前所未有的便利。无论是使用商业的现成LLM(Large Language Models),还是流行的开源LLM和VectorDB解决方案,用户都可以轻松地在本地或远程托管中运行它,并智能地与提供的任何文档进行对话。AnythingLLM为用户提供了一个灵活而强大的工具,充分利用现有的LLM技术,并在私有环境中构建自己的ChatGPT。

AnythingLLM的推出时间

AnythingLLM的推出时间是在2023年。具体来说,它在2023年6月16日被Mintplex Labs首次发布,并被描述为一个全栈应用程序,旨在通过精心设计的UI,为客户提供与文档、资源等进行智能交互的最简单方式。随后,在2023年12月11日,LangChain正式开源了AnythingLLM,为用户提供了构建私有ChatGPT的便利。这一开源行动使得更多的人可以访问和使用这个强大的工具。

AnythingLLM和langchain的区别和联系

AnythingLLM和LangChain都是与大语言模型(LLM)相关的工具,但它们在功能和用途上有所不同。

AnythingLLM可以看作是一个私人定制的ChatGPT工具。它允许用户利用现有的LLM技术,构建属于自己的私人ChatGPT。这意味着,你可以将AnythingLLM与你的文档、资源或其他内容片段结合起来,让它像一个智能助手一样,与你进行对话,并为你提供有关这些内容的信息或建议。你可以把它想象成一个特别聪明的小助手,能够理解和回答你关于各种文档和资料的问题。

而LangChain则更像是一个大语言模型的应用框架。它提供了一系列的功能和工具,帮助开发者更容易地在应用程序中集成和利用LLM。你可以把LangChain看作是一个工具箱,里面装满了各种可以帮助你更好地使用LLM的“零件”和“工具”。通过使用LangChain,开发者可以更轻松地构建出各种基于LLM的应用,满足不同的需求。

两者的联系在于,它们都是基于LLM技术的工具,都可以用来构建出智能的、能够与人进行交互的应用。而且,AnythingLLM本身就是在LangChain这个框架的基础上开发出来的,所以可以说AnythingLLM是LangChain的一个具体应用或实现。

简单来说,AnythingLLM是一个具体的、可以直接使用的私人ChatGPT工具,而LangChain则是一个更广泛、更灵活的框架,可以用来构建各种基于LLM的应用。

这篇关于AnythingLLM的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!