撰文 | 宇多田

在过去的几年里,一个名为「深度学习」的人工智能技术家族在科技行业掀起了一场风暴。

从帮你对手机相册里的自拍与萌宠进行识别分类,再到大幅度提高 Alexa 们(智能助手)与无人驾驶汽车的「平均智商」,「深度学习」这个人工智能里的门类,具备了更高级的对「复杂结构」进行自动挖掘的能力。

通俗来说,与传统计算通过固定流程解决「确定」问题不同,深度学习算法需要模拟人脑来解决那些取决于概率的「不确定问题」。

而这个解决问题过程所需的算力,却与传统芯片所擅长的不一致。

因此,各类终端,乃至整个智能硬件市场,对底层基础芯片的要求也发生了根本改变。简单来说,就是处理器性能与需求之间出现了巨大的市场缺口。

而这正是为何从英伟达、英特尔等老牌半导体巨头,再到 Cerebras Systems、Wave Computing 等明星AI 芯片初创公司,都在竞相开发供 AI 算法专用的芯片。

从某种意义上,这些芯片能够根本改变计算机的制造方式。

而在这些恰逢其时出现的idea与创业公司中,就包括最近风头正劲的全球第一家芯片独角兽——中国创业公司「寒武纪」。

「寒武纪」们的机会

当下,在很大程度上,深度学习芯片市场是由英伟达主导的。

这家芯片巨头长期以来一直以其「王牌产品」——图形处理器(GPU)而闻名业界。而 GPU 有成千上万个并行的微型计算机,每个都在「专心」地渲染像素。

通常,为了渲染图像的阴影、光线、反射以及透明度,这些小的计算「核心」需要一起执行大量低级的数学运算。

而就在几年前,研究人员又发现,GPU 的功能理论上非常适合运行深度学习算法,因为后者也需要成千上万地并行计算,正迫切需要一款适合的芯片来高效计算深度学习任务。

而这一发现,让 GPU 的出现显得恰逢其时,也让英伟达成功成为人工智能革命的「核心发起人」之一。

不过,虽然这些 GPU 在游戏和其他图像密集型应用中被广泛使用,但是从英伟达近年来的财报可以看出,数据中心的业绩虽然增幅很大,但从GPU在人工智能领域的整体情况来看,并不是非常理想。

特别是2017年第一财季,这项业务同比增长了186%,占总营收的20%。

而在智能终端芯片市场,英伟达并不是明显的赢家。

换句话说,终端市场中的各种垂直场景,包括手机、智能家居、安防、自动驾驶等领域,都存在 AI 芯片创业公司切入的大量机会。

(请注意,游戏领域并不算是GPU在人工智能领域的应用)

而另一个让创业公司「有利可图」的理由,在于通用芯片与专业芯片的差异性。同花顺财经对这个「差异性」有一个非常形象的比喻:

GPU 是一种通用型芯片,就像是你买了一个格局都固定了的房子,然后改变内部的软件设施来让这个房子达到我们需要的功能,优点是对于用户代价小,但肯定没法达到性能最大化。换句话说,就是计算力有限,性能不够。

而专业性的 ASIC 芯片,譬如嵌入华为麒麟 970 芯片的寒武纪 1A 处理器,就像是完全一块砖一块砖按自己需求重新搭建一个房子,这种肯定在性能上最贴近我们的需求,但是一次性投入太大,如果不是某一确定需求,或者能够有足够大的市场规模,肯定要冒风险。

从目前来看,虽然 GPU 的性能已经大大高于传统的 CPU,但是对于功耗较小的终端设备(譬如手机)来说,GPU 的计算力可能仍然不能满足一些需要高效运算的 AI 应用。

因此,一种目前许多终端公司与研究机构在采用的解决方法是,通过硬件加速,采用专用协处理器的异构计算方式来提升处理性能。通俗点来说,就是通用与定制化芯片可以「共存」在一个终端里。

以华为 Mate10 为例,其麒麟 970 芯片的 HiAI 移动计算架构就是由 CPU、GPU、ISP/DSP 和 NPU(寒武纪 1A 处理器)四部分组成。

Mate10 上的一款微软翻译 app,就是基于 NPU 的强大运算性能,将翻译速度提升了 300%,还能实现离线可用的全神经网络机器翻译。

因此,对于芯片创业公司来说,做的「更专」,针对特殊场景和需求进行更多特别的设计,反而是在这个市场进行「弯道超车」的好选择。

目前,从全球来看,大多数芯片创业公司,都是选择了先设计并制造「定制化芯片」的方式来切入市场。

譬如由一群具有传奇色彩的美国芯片业老兵 Andrew Feldman 等人在 2016 年成立的深度学习芯片制造商 Cerebras,就是这样一家公司。

虽然其研发及主体业务一直处于秘密状态,但据消息人士透露,他们的芯片就是为「训练某些 AI 算法模型」而量身定制的。

像 Cerebras 这样的芯片创业公司们相信,自己完全有能力在深度学习应用程序中构建一些优于 GPU 的芯片。作为 Cerebras 的 CEO,Feldman 曾在一次采访中指出,GPU 只是用来生成图形的:

「我不认为 GPU 适用于深度学习,」费尔德曼表示,「它可能比英特尔的 (CPU) 要好,但 GPU 只是代表了一种 25 年来传统芯片针对不同问题的优化结果。」

而许多其他正在崛起的 AI 芯片公司基本都在遵循着 Feldman 的逻辑:他们设计的下一代芯片有着「多核心」的特色,而每个核心都是针对低精度运算。

譬如总部位于加州坎贝尔市的创业公司 Wave Computing,就在最近披露了自己芯片架构的细节——他们在一个被称为「WDPU」的芯片上有 16000 个核心。

而另一家总部位于英国布里斯托的芯片创业公司 Graphcore 则表示,其名叫的 IPU 的芯片上载有 1000 多个核心。

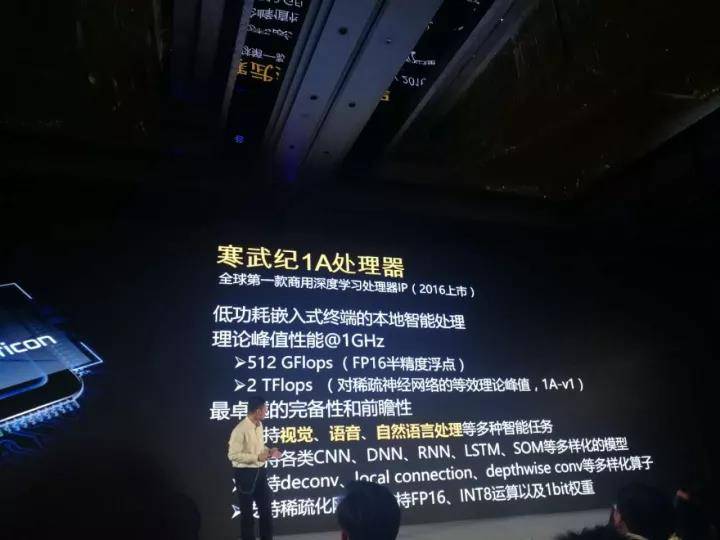

再转向国内,作为全球唯一一家芯片独角兽,诞生于中国科学院计算技术研究所,成立于 2016 年的寒武纪,早在去年就推出了一款名为「1A处理器」的商用深度学习专用处理器(NPU)(神经网络处理器)。

而最值得注意的是,这块具备了传统四核CPU25倍以上性能的专用芯片,主要针对计算机视觉、语音识别等方面的任务。

另外,在今天举行的寒武纪发布会上,CEO 陈天石宣布在 2017 年 3 季度上市的寒武纪 1H8 处理器,主要面向场景视觉的应用;而上市时间「保密」的寒武纪 1M 处理器,则主要面向智能驾驶领域。

总体来说,寒武纪现有以及即将上市的芯片旗舰产品,都只针对一些特定的垂直场景,且运行智能算法时的性能与计算效率,都要大幅超越 CPU 与 GPU。

芯片创业公司的骄傲与挑战

毫无疑问,这个产业的投入非常庞大,而且资金必须可持续。就像 ARM 中国战略发展总监袁伟的表述一样:「芯片研发与制造的投入必须要达到 10 亿美金的级别,基本上只有巨头能担负得起」。

但很显然,资本似乎对这种「费钱」的现实「无动于衷」。

因为从某种程度上,英伟达如今疯狂飙升至 1000 亿美元的市值对投资者们产生了极大的冲击,没有人不对 AI 芯片在商业领域展现出的想象空间垂涎欲滴。

这种意识让投资者在面对 AI 芯片创业者时并没有捂紧钱包,当下,资本正在源源不断地流入这个「又见生机」的古老产业。

以刚刚提到的神秘芯片创业公司 Cerebras 为例,根据资本数据库 PitchBook 提供的融资文件显示,在其结束的三轮融资中,Cerebras 已经筹集了 1.12 亿美元,其估值也在今年8月飙升至高达 8.6 亿美元。

而 Wave Computing 与 Graphcore 迄今为止也分别筹集了 6000 万美元。投资者们包括 DeepMind CEO Demis Hassabis,Uber 首席科学家 Zoubin Ghahramani 以及一些来自 OpenAI 的管理层。

「我们刚刚宣布成立 AI 芯片公司,就被那些对我们产品感兴趣的人的电话打爆了,」Graphcore 的首席执行官兼联合创始人奈杰尔·图恩 (Nigel Toon) 的这番说法既无奈又骄傲,「我们甚至可以和任何 AI 领域的关键人物进行沟通和谈判。」

而刚刚发布了新产品的寒武纪,也是在今年 8 月份获得 1 亿美元 A 轮融资金额,晋升为全球首个芯片独角兽后,开始受到国内的广泛关注。值得注意的是,阿里巴巴、联想等计算巨头都是其重要投资方。

寒武纪CEO陈天石

更大的投入与回报,更令人兴奋的市场,自然也涌动着更大的危险与挑战。

福布斯杂志就曾对这个不断砸钱的市场发出疑问:适合这些芯片的硬件真的成熟了吗?

以无人驾驶汽车为例,大部分零部件仍处于开发阶段与早期试点阶段。

还有就是,即便你花费数年时间研发出一款芯片,但是否能够适应算法及硬件变迁的节奏呢?

特别是对于定制化的 ASIC 芯片来说,算法是固定的,一旦算法变化就可能无法使用。目前人工智能还属于大爆发时期,大量算法不断涌出,远没到算法平稳期,ASIC 专用芯片如何做到适应各种算法是个最大的问题。

因此,像寒武纪这样的公司,虽然以一款深度学习专用芯片为切入点,但公司显然已经在朝着制造更通用芯片的道路迈进了。

譬如,今天寒武纪也在最后顺延推出了一款面向云端的机器学习处理器 MLU,而陈天石也在接受采访时否认了寒武纪是一家制造 ASIC 芯片的公司:

「我们不只有神经网络处理器 ,还会在未来发布适用于更多任务的处理器产品。」

可以看到,MLU涉及了数据中心业务

此外,虽然英伟达让人们看到了 AI 芯片的巨大商机,但我们从目前来看根本不清楚芯片创业公司的商业机遇究竟有多大。

尽管有英伟达在先,但通过芯片产品进入以计算为基础的数据中心市场仍然是一个不容忽视的大目标,因为这是一个随着云计算产业爆发而变得十分有利可图的市场。

但这一市场基本被亚马逊、谷歌、微软、苹果、Facebook 等美国计算巨头所主导。而谷歌也因为 GPU 的功耗问题,开发了属于自己的 AI 芯片 TPU;微软也似乎正在专注使用一种叫做 FPGA 的可编程芯片。

而另一个明显的挑战,在于芯片创业公司独立成长壮大的「高难度」。

在过去几年中,半导体行业经历了大规模的并购整合浪潮,所有芯片巨头对待新事物都十分警惕——在积极寻找下一个可以赚钱的「Big Thing」同时,也在把「一切威胁地位的苗头」无形扼杀于摇篮里。

可以看出,他们大多数的收购目标都瞄准了专注于人工智能计算与自动驾驶等场景的专业级公司。特别是芯片巨头英特尔,其并购套路一直是极具「侵略性」的:

- 耗资 187 亿美元收购 FPGA(可编程芯片)制造商 Altera;

- 花 150 亿美元买下自动驾驶系统制造商 Mobileye;

- 花 3.5 亿美元收购深度学习技术公司 Nervana。

而英特尔的竞争对手高通,正试图以 380 亿美元的价格,与在汽车市场具有绝对话语权的芯片制造商 NXP 进行合并。

高通创投的 CEO Quinn Li 曾透露,公司其实已经研究了像 Cerebras 这样的 AI 芯片公司很长时间,但是因为一些不确定因素还没有进行下一步动作。

「尤其是在供数据中心使用的芯片市场,我们还尚未进行任何投资。每个人都很明白,

在数据中心领域的潜在客户数量有限,而进入一个由英伟达把控的市场会非常困难。而在终端设备领域,由于硬件还不是很成熟,市场规模还远远没有达到想象的样子。」

他坦白,高通也正在试图弄清楚市场机会是什么。「最赚钱的仍然是数据中心领域,或许亚马逊和其他没研发 AI 芯片的大公司会对更新,价格更低性能更好的产品感兴趣。」

(以上为寒武纪的商业目标)

从寒武纪的产品角度来看,与国外同类创业公司相比,这家中国芯片创业公司已经率先进入了商业化流程——其 IP 指令集,已扩大范围授权集成到手机、安防、可穿戴设备等终端芯片中,截止 2016 年已拿到 1 亿元订单。

不过,寒武纪另一个突出优势在于有着「国家战略」的支持,其「中国芯」的宣传口号与国家科技部门对公司进行的专题调研以及学院背景就可见一斑。

但无论如何,你不能否认的是,在这个古老且传统的半导体产业中,AI 在芯片上的突破与寒武纪们的出现,是彻底改变传统市场「赛制」,进行市场洗牌,与加速 AI 产业化的重要机会。

![BUUCTF靶场[web][极客大挑战 2019]Http、[HCTF 2018]admin](https://i-blog.csdnimg.cn/direct/ed45c0efd0ac40c68b2c1bc7b6d90ebc.png)