本文主要是介绍如何利用IP代理高效采集产品数据,打造爆品?,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

文章目录

- 一、什么是网络爬虫?

- 二、普通人如何通过网络爬虫赚钱?

- 2.1、心得分享

- 2.2、工具自动化收集信息

- 三、 动态IP代理

- 3.1、覆盖范围

- 3.2、性价比

- 3.3、教程中心

- F&Q

- 使用教程

- 3.4、在网络数据采集中的重要性

- 四、实战应用案例一:ebay电商【耳机】品类数据抓取

- 4.1、步骤介绍(此处演示所以限定10页数据)

- 4.1.1、使用 Java + Jsoup工具,去获取ebay电商【耳机】品类页面数据,并采用并发方式去执行程序

- 代码示例

- 4.1.2、在【4.1.1】的基础上,加上ipidea动态IP代理

- 代码示例

- 4.2、代码片段分享

- 4.3、结果分析

- 总结与展望

一、什么是网络爬虫?

网络爬虫(Web Crawler),也称为网络蜘蛛(Web Spider),是一种自动化的网络机器人,其主要功能是按照一定的规则自动浏览和索引互联网上的网页。

网络爬虫广泛应用于搜索引擎,比如百度、Google、必应等,通过不断地抓取网页数据来更新其搜索索引库,从而使得用户能够通过搜索引擎查询到最新的网页信息。

网络爬虫也可用作特定的领域,比如电商营销。我们可以通过抓取特定电商网站的网页数据,更新我们的商品库、热销库,从而通过数据来决策我们自己门店的营销活动。

二、普通人如何通过网络爬虫赚钱?

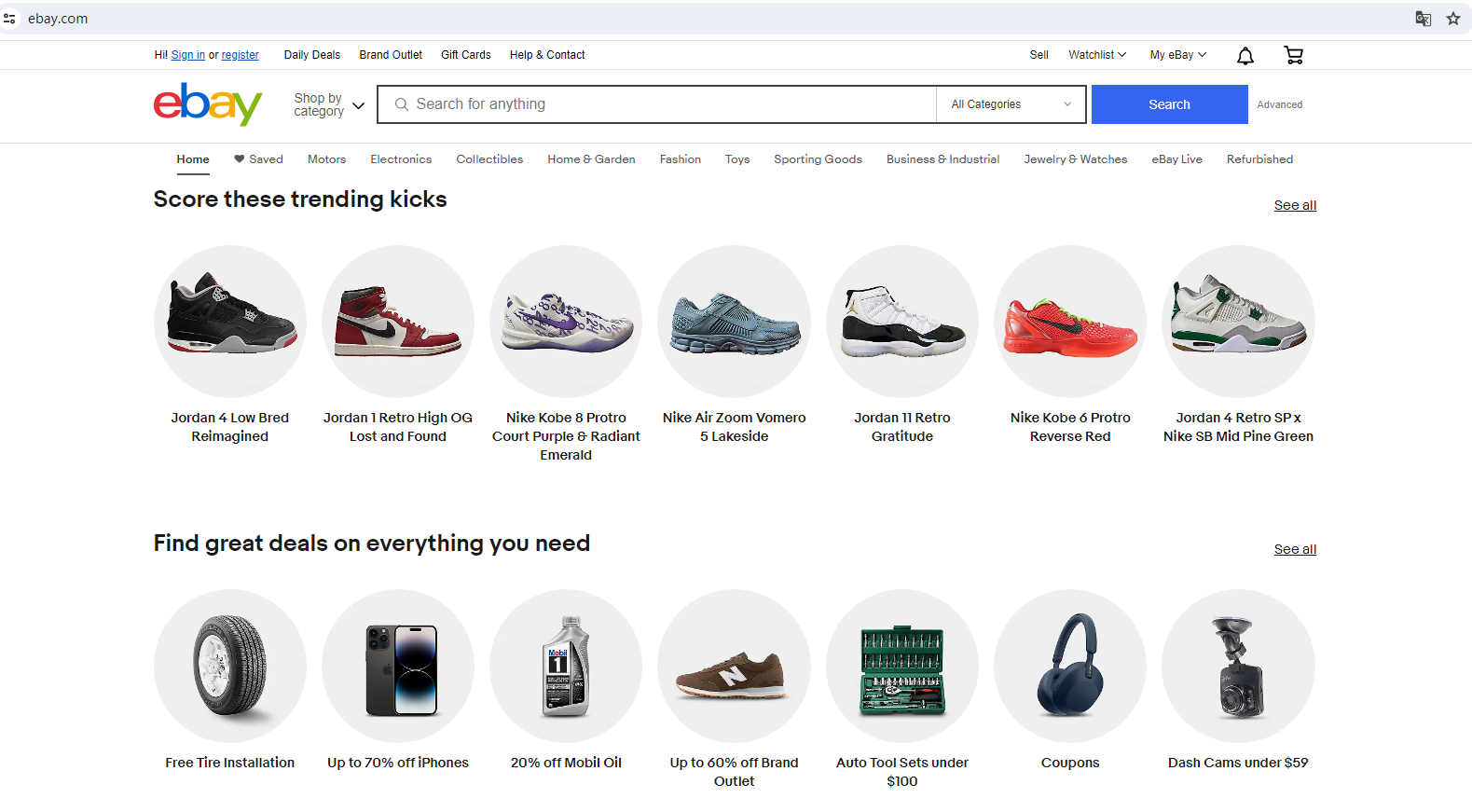

电商最近二十年都特别火爆,比如ebay、希音、lazda、亚马逊、唯品会、抖音电商等,那么我们普通人开的小店铺,都会想从中切到一块小蛋糕。就像普通人刷抖音、小红书,经常都会遇到这种评测,某某年热门耳机排行榜之类的,广告里文案都非常吸引人,就会忍不住入手一款蓝牙耳机,现在家里就有BOSE、airpods、索爱、飞利浦、华为等耳机。往往爆款Top10,就占了市场销量的60%,意味着选品这块是非常重要的。那么我们自己做店铺,选品也要从热门、性价比排行榜中,挑选一些商品,才能打造出爆款商品。

PS:下面给大家晒晒我自己一筐的耳机(还有些已经不知道塞哪里去了)

2.1、心得分享

我自己总结了几条打造爆款商品的心得,也是这么多年摸索电商选品的心血。

1、严选商品:各大电商销售榜,亚马逊、ebay、海外抖音、lazda等,都会有自己的热门商品推荐,其中3C时尚数码类,很受年轻人喜爱,最近十多年的销量都在Top10品类榜。我们也可以在这个赛道深耕,这样我们的投入可以更快的见到收益。

2、紧跟市场: 3C时尚数码类赛道,销量也在实时变化,比如苹果的发布会日期前后几周,苹果手机、苹果手机壳、苹果耳机的销量,对比平时都会有很大的增长。那么这时候我们就得紧跟市场行情,及时调整我们的策略,把苹果相关产品推荐比重加大。

3、收集数据:收集各大电商如:亚马逊、ebay、海外抖音、lazda等它们的公开数据,利用工具自动化大批量收集信息,把第2步市场行情中的热门品类商品详情信息,同步到我们的资源库,进而形成各种营销数据,这样我们做营销就有一手资源数据。

2.2、工具自动化收集信息

在我们运营过程中,很多不懂计算机的同行,在行情来了之后(苹果发布会、索爱新品发布会、华为发布会等) 都是手动打开亚马逊、ebay、海外抖音、lazda这些电商平台,找到对应的品类,去手动获取商品资料(商品名称、价格、评论、图片等),很多时候提前一周我们就得开始动手,忙活4-5天,才收集到足够有效的数据。而我做成工具后,喝杯茶的功夫,数据就自动化下载到了电脑里。

这里给大家介绍下网络数据采集,我们可以使用Python、Java、Rust等编程语言,来完成我们的手动收集信息工作。假如拿ebay网为例,我们去抓取它的【耳机】品类商品,首先找到ebay网以及【耳机】分类页面,查看到总数量在16万左右,每页100条数据,大概有1600页数据。

假定每页数据我们在10秒之内爬取完,那么我们需要1600 * 10 = 16000秒时间完成这个工作。不得不说还是太天真了,刚才的假设只是理想状态。由于ebay网采取了十分严格风控策略,我们通常在采集数据5-10页后,网络请求就会被ebay拒绝。这是因为我们频繁的访问页面,触发了ebay网的风控规则,我们在采集数据1600页数据时,都是同一台电脑,同一个IP地址。我们可以想一想一个自然人是不可能在这么短时间内,去连续不断的翻页查看数据。这种操作会被判定为机器人操作,从而拒绝我们的请求。

这时候我们就需要一款产品,可以为我们提供动态IP代理。首先我们选择一款动态IP代理,其次在每次爬取ebay网数据时,我们都为其设置一个IP代理,这样ebay网就认定这些请求来自不同的IP,就能正常的发起请求。

三、 动态IP代理

我自己用的海外IP代理服务商【ipidea】可以推荐给大家,点击这里可以了解详情。

我已经使用他们家的产品好几年了,有静态IP代理、动态IP代理,今天主要介绍网络采集数据,因此要用到的是动态IP代理。

3.1、覆盖范围

ipidea的IP池覆盖到全球很多城市,尤其是热门国家/地区拥有很多优质的IP资源。

3.2、性价比

ipidea 批量提供动态IP代理,动态IP也支持3种类型:动态住宅IP、动态数据中心IP、动态长效ISP(独享的2种不属于咱们今天要介绍的范畴,因为购买它们之后,是分配的固定IP,不满足网络爬虫切换IP的业务场景。属于是钱花了,事情办不成)。

这些年,这3种动态IP都使用过,这里简单介绍下使用场景:

动态住宅IP、动态长效ISP:这2种安全系数比较高,通常用于需要验证身份的网页;

动态数据中心IP:这种安全系数比较低,通常用于可匿名访问的网页。

ipidea海外IP购买也特别方便,随时随付以及其他套餐都很有性价比,尤其是我们这次的业务场景,匿名访问采集电商网页,可使用动态数据中心IP,价格都非常实惠。最近也赶上5周年优惠活动,基本上所有活动都有5折左右折扣,还是相当划算的。

3.3、教程中心

ipidea在IP代理领域扎根多年,有很多辅助用户操作的文档,我们在官网的教程中心可以看到这些文档。分别有:F&Q、使用教程、最新公告、最新咨询、资源中心。通常我们使用一个产品,最关注的就是F&Q、使用教程了,让我们来简单的看一下,它们分别有哪些内容。

F&Q

F&Q里有对入门、价格、账户、故障方面的问题,官方对此都给出了详细的解决步骤,我们点击对应的问题就可以想看到详细的内容。

使用教程

使用教程中包括了账号设置/使用、代理使用等热门教程,同时也提供搜索框,用户可以搜索自己感兴趣的教程。

3.4、在网络数据采集中的重要性

动态代理在网络数据采集中的作用,通常用于隐藏数据采集服务器的真实IP地址,以及防止被目标网站识别和封禁。就像上文讲到的,采集ebay网【耳机】品类数据,数据量特别大,当我们进行大规模的网络数据采集时,频繁地向目标网站发送请求可能会引起目标网站的风控机制,导致IP被封禁或者请求被拒绝。

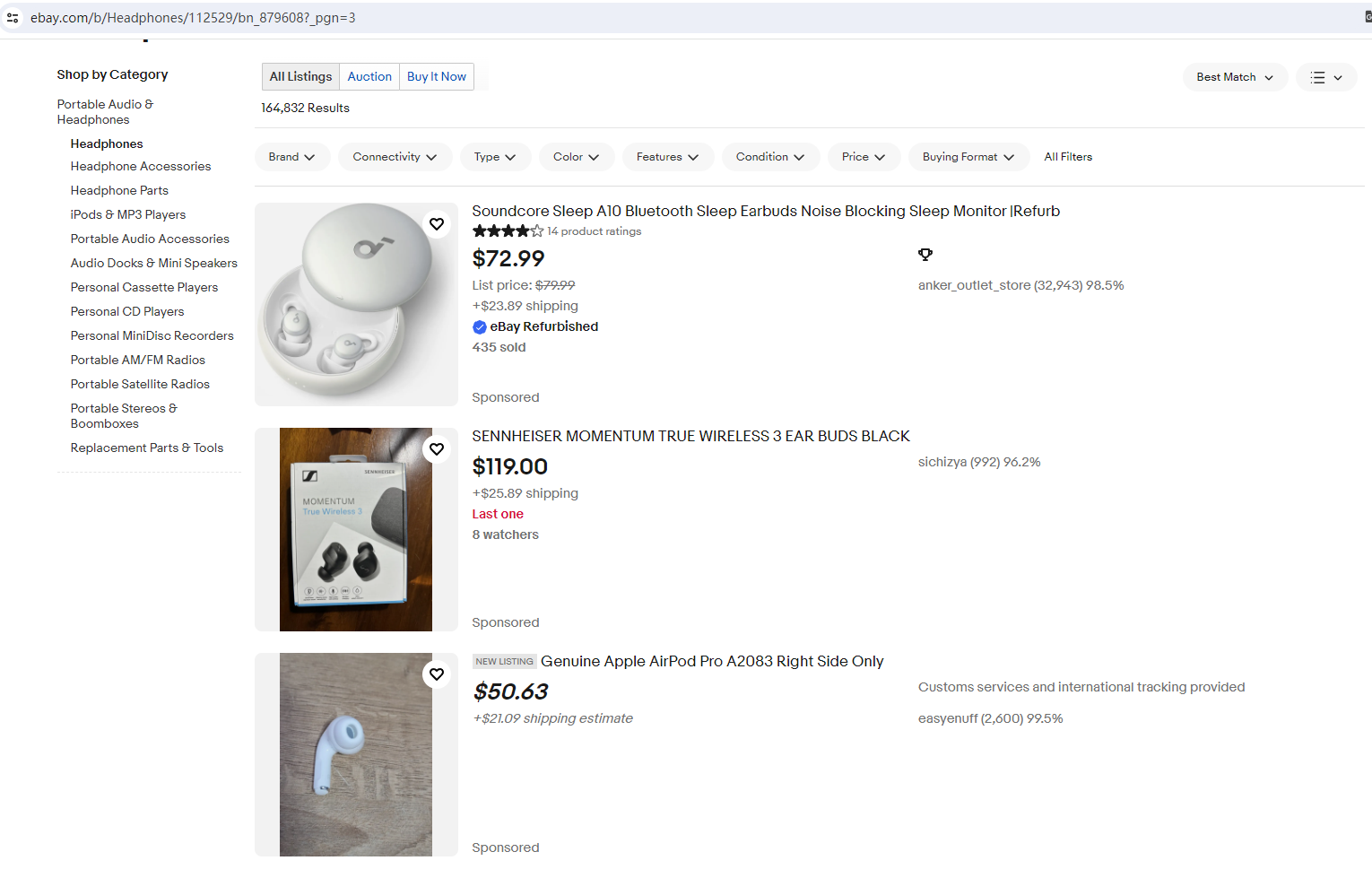

但是我们通过使用动态代理,可以不断地更换代理IP地址来规避这些风控规则。ipidea动态代理服务器会定期更换IP地址,并且有API可以提供大量的IP地址供数据采集程序使用,从而降低被识别和封禁的风险。

此外,动态代理还可以用于实现分布式数据采集系统中的IP代理池,通过多个代理IP轮流使用,有效地分担数据采集任务,提高采集数据的效率和稳定性。

总的来说,动态代理在网络数据采集中的作用是保护采集服务器的隐私和安全,提高数据采集效率,以及规避目标网站的风控策略。下面就给大家看下,我是如何使用ipidea动态IP代理的,如何使用它去采集我们需要的电商数据。

四、实战应用案例一:ebay电商【耳机】品类数据抓取

4.1、步骤介绍(此处演示所以限定10页数据)

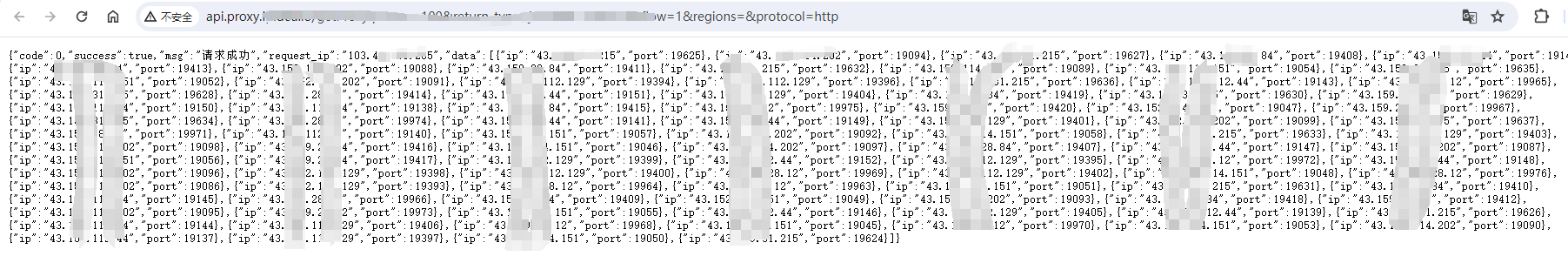

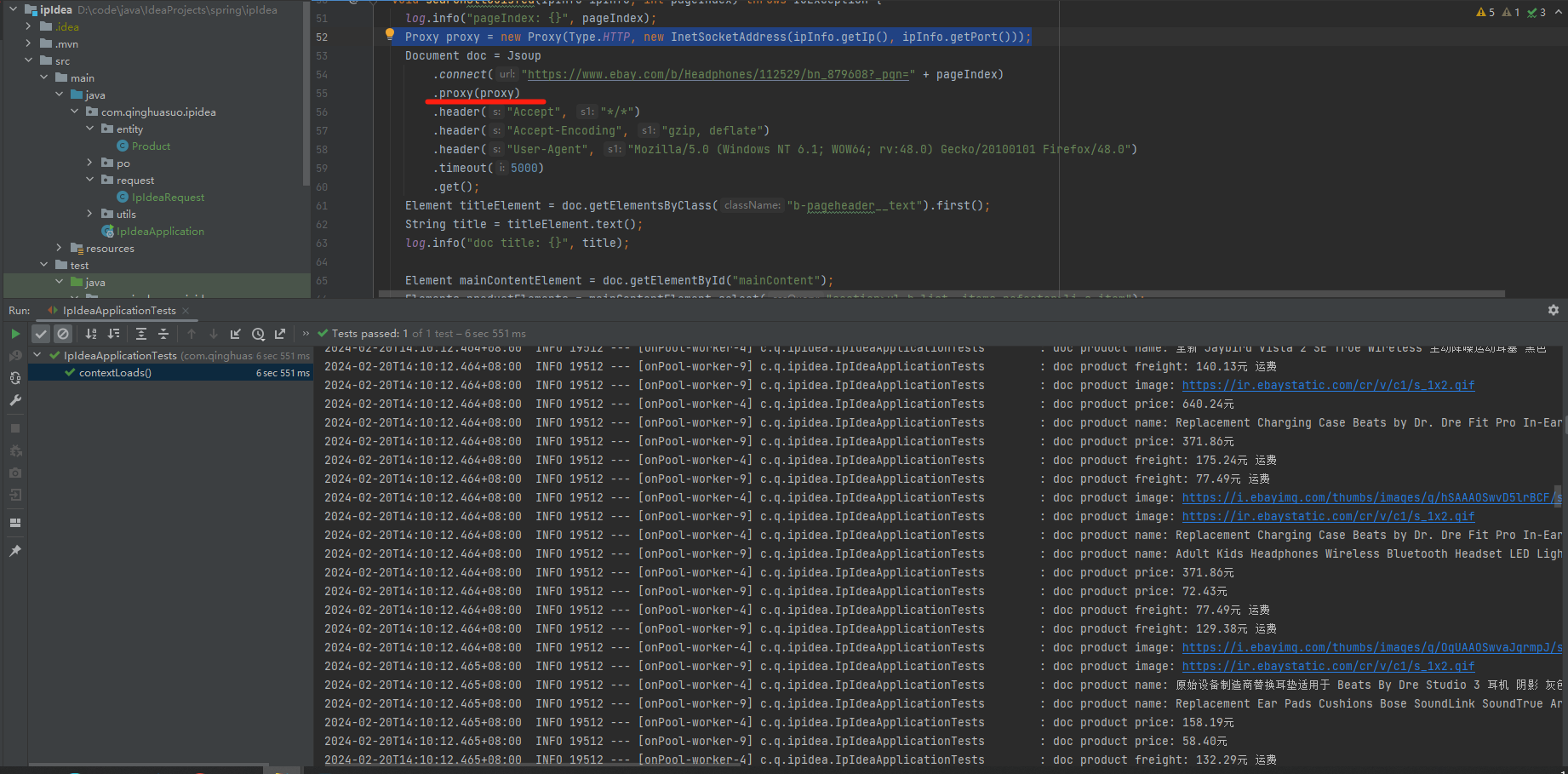

4.1.1、使用 Java + Jsoup工具,去获取ebay电商【耳机】品类页面数据,并采用并发方式去执行程序

- 创建Java Maven工程,导入Jsoup包;

- 找到ebay电商【耳机】品类页面,并且找到翻页参数规则;

- 使用Jsoup去访问ebay电商【耳机】品类页面,通过Jsoup规则解析出商品名称、图片、运费、价格等(还可以继续扩展获取详情页地址、下钻详情页获取评论、介绍、好评率等);

- 改造程序,使用并发执行

代码示例

4.1.2、在【4.1.1】的基础上,加上ipidea动态IP代理

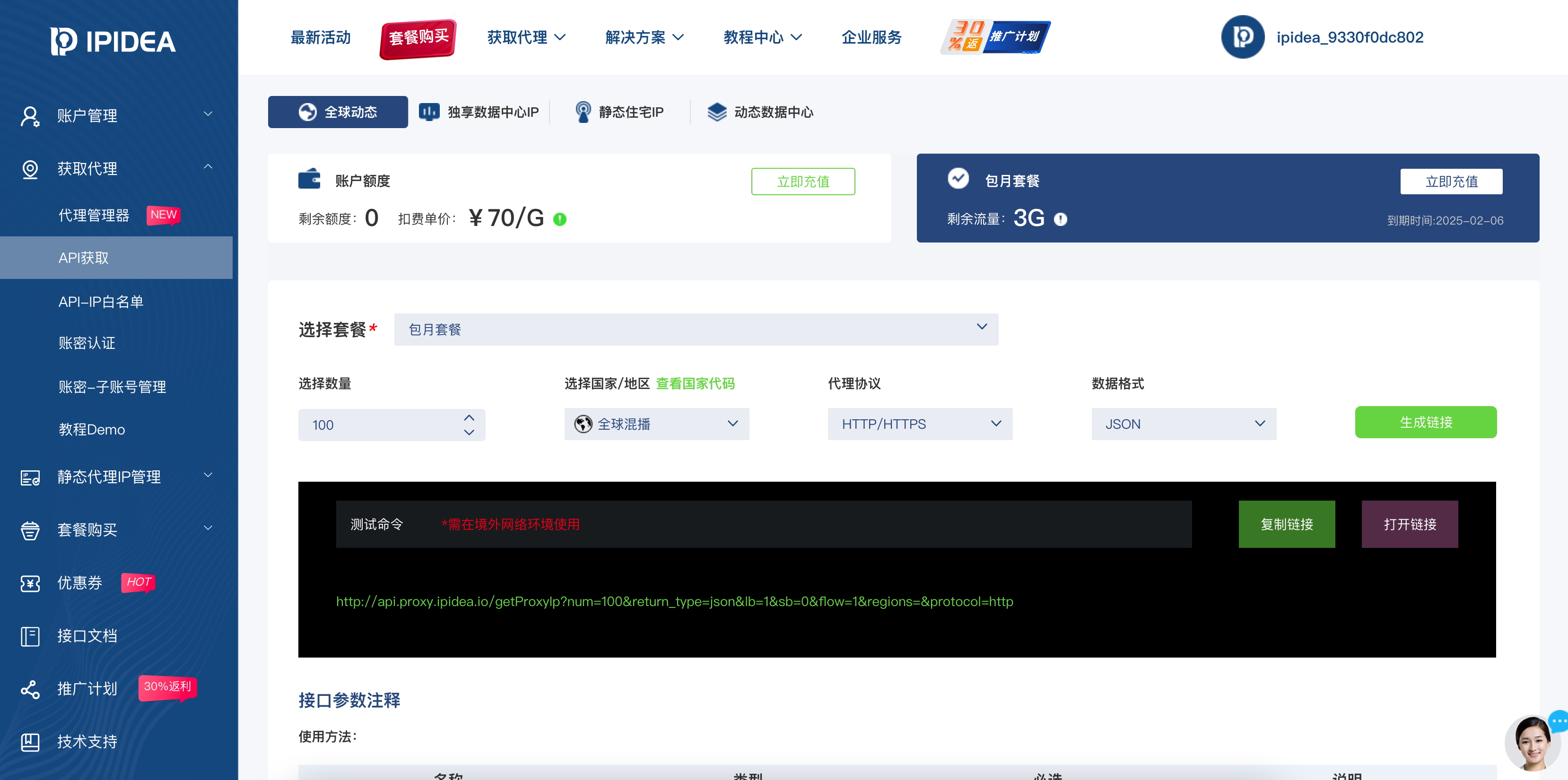

在https://www.ipidea.net/ 官网登录后,点击右上角的个人图标,就会跳转到管理后台(可以管理个人账号、实名认证、获取代理、优惠券等),下面我们操作从管理后台通过API获取我们的海外IP代理。

- 在我自己的ipidea管理后台找到API获取页面;

- 选择我们购买的套餐类型,检查流量余额;

- 选择套餐参数(条数、国家/地区、代理协议、数据格式)

- 选择生成链接,就会出现代理IP的接口API和参数注释

代码示例

4.2、代码片段分享

- pom.xml

<!-- https://mvnrepository.com/artifact/com.google.code.gson/gson --><dependency><groupId>com.google.code.gson</groupId><artifactId>gson</artifactId><version>2.10</version></dependency><!-- 添加Httpclient支持 --><dependency><groupId>org.apache.httpcomponents</groupId><artifactId>httpclient</artifactId><version>4.5.2</version></dependency><!-- 添加jsoup支持 --><dependency><groupId>org.jsoup</groupId><artifactId>jsoup</artifactId><version>1.10.1</version></dependency><dependency><groupId>org.projectlombok</groupId><artifactId>lombok</artifactId><optional>true</optional></dependency>

- 核心数据采集代码

package com.qinghuasuo.ipidea;import com.google.gson.Gson;

import com.google.gson.reflect.TypeToken;

import com.qinghuasuo.ipidea.po.IpIdeaResult;

import com.qinghuasuo.ipidea.po.IpInfo;

import java.io.IOException;

import java.net.InetSocketAddress;

import java.net.Proxy;

import java.net.Proxy.Type;

import java.util.List;

import java.util.concurrent.atomic.AtomicInteger;

import lombok.extern.slf4j.Slf4j;

import org.jsoup.Jsoup;

import org.jsoup.nodes.Document;

import org.jsoup.nodes.Element;

import org.jsoup.select.Elements;

import org.junit.jupiter.api.Test;

import org.springframework.boot.test.context.SpringBootTest;

import org.springframework.util.CollectionUtils;

import org.springframework.web.client.RestTemplate;@Slf4j

@SpringBootTest

class IpIdeaApplicationTests {private RestTemplate restTemplate = new RestTemplate();private Gson gson = new Gson();private AtomicInteger i = new AtomicInteger(0);@Testvoid contextLoads() {int maxPageSize = 10;List<IpInfo> ipInfoList = this.getIpInfoList(maxPageSize );if (CollectionUtils.isEmpty(ipInfoList) || ipInfoList.size() == 0) {return;}ipInfoList.parallelStream().forEach(s ->{try {searchStlouisfed(s, i.incrementAndGet());} catch (IOException e) {throw new RuntimeException(e);}});}void searchStlouisfed(IpInfo ipInfo, int pageIndex) throws IOException {log.info("pageIndex: {}", pageIndex);Proxy proxy = new Proxy(Type.HTTP, new InetSocketAddress(ipInfo.getIp(), ipInfo.getPort()));Document doc = Jsoup.connect("https://www.ebay.com/b/Headphones/112529/bn_879608?_pgn=" + pageIndex).proxy(proxy).header("Accept", "*/*").header("Accept-Encoding", "gzip, deflate").header("User-Agent", "Mozilla/5.0 (Windows NT 6.1; WOW64; rv:48.0) Gecko/20100101 Firefox/48.0").timeout(5000).get();Element titleElement = doc.getElementsByClass("b-pageheader__text").first();String title = titleElement.text();log.info("doc title: {}", title);Element mainContentElement = doc.getElementById("mainContent");Elements productElements = mainContentElement.select("section>ul.b-list__items_nofooter>li.s-item");for (Element e : productElements) {log.info("doc product image: {}", e.select("div.s-item__image-section>div.s-item__image>a>div.s-item__image-wrapper>div>img.s-item__image-img").attr("src"));log.info("doc product name: {}", e.select("div.s-item__info>a>h3.s-item__title").first().text());log.info("doc product price: {}", e.select("div.s-item__details>div.s-item__detail>span.s-item__price").first().text());log.info("doc product freight: {}", null == e.select("div.s-item__details>div.s-item__detail>span.s-item__logisticsCost")? null : e.select("div.s-item__details>div.s-item__detail>span.s-item__logisticsCost").text());}}private List<IpInfo> getIpInfoList(int maxPageSize) {String url = "http://api.proxy.ipidea.io/getProxyIp?num="+maxPageSize+"&return_type=json&lb=1&sb=0&flow=1®ions=&protocol=http";String str = restTemplate.getForObject(url, String.class);IpIdeaResult<IpInfo> result = gson.fromJson(str, new TypeToken<IpIdeaResult<IpInfo>>() {}.getType());if (null == result || result.getData() == null) {return null;}log.info("IpIdea result size: {}", result.getData().size());log.info("IpIdea result: {}", gson.toJson(result));return result.getData();}}

4.3、结果分析

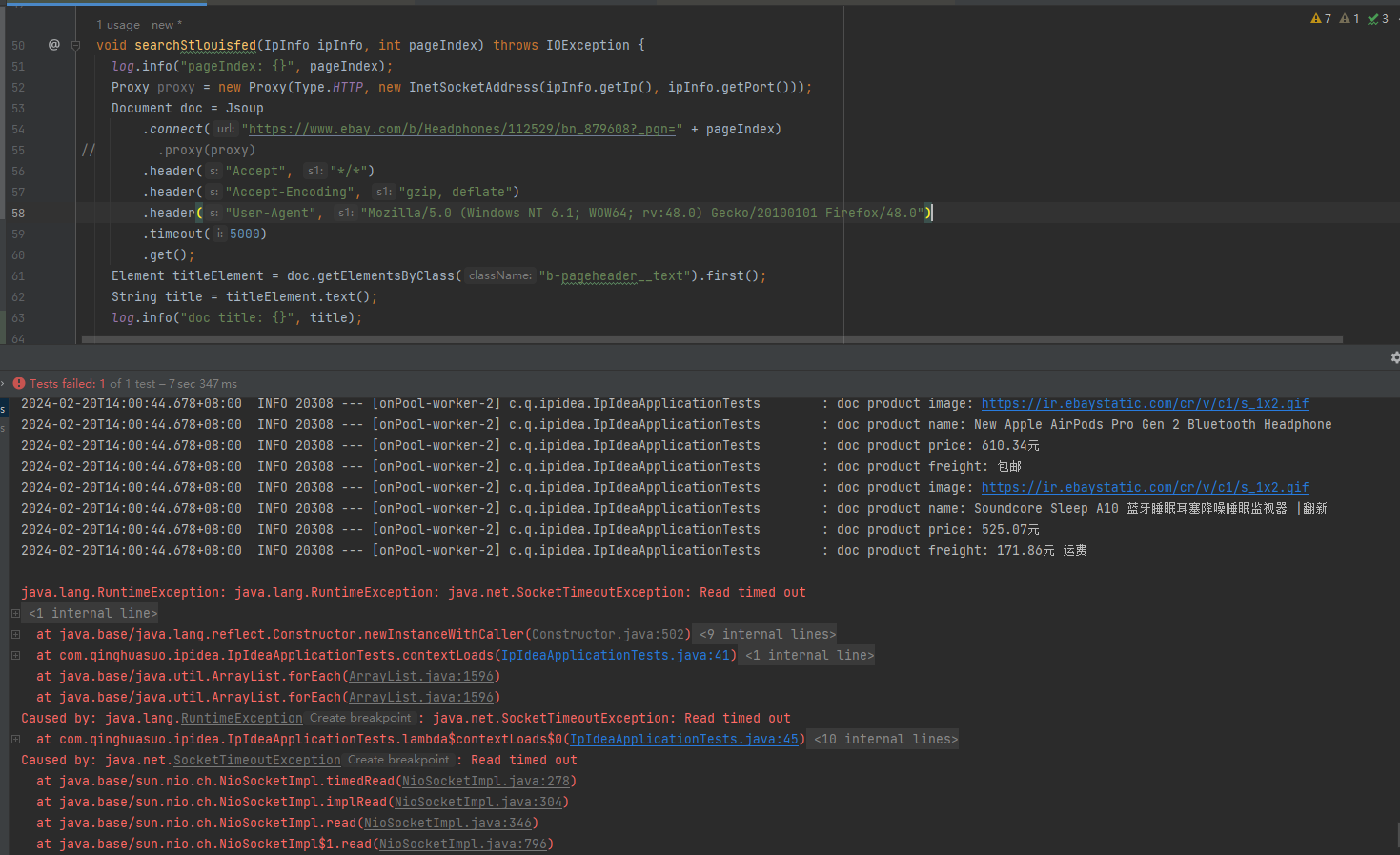

在【 4.1.1】中,我们执行程序时,在中途程序就出现异常,访问ebay网页网络连接超时。

为了解决这个问题,在【 4.1.2】中加入了代理,我们从ipidea 代理接口中获取动态IP,通过这些IP去访问ebay网页。这时的并发访问,没有触发ebay网页的风控机制,因为此时我们每一个请求都给它分配了独立的IP。

通过这个案例,可以说我们ipidea的动态IP代理已经起作用了,隐藏了我们本地的真是IP地址,防止我们的电脑IP被ebay网封禁。而且我们不断地更换代理IP地址,也降低了被识别和封禁的风险,提高爬取效率和稳定性。

总结与展望

了解完上面这些知识,我们在做跨境电商运营选品时,就可以通过数据采集+动态IP代理快速的拿到我们想要的数据,并能根据这些素材,快速做成营销文案推向市场,占据先机,从而在日益激烈的跨界电商竞争中分一块蛋糕。

不过虽然数据采集获取数据很舒爽,但我们也得注意合规,一些网站明确禁止采集的内容,我们也需要规避。这样我们在跨境电商行业在能吃一块蛋糕的同时,也能稳定持久的占有这块蛋糕份额。可能某天机会来了,我们也会出现爆款,从而分得更大的蛋糕。

最后,再次分享下ipidea 代理IP利器,让我们一起来体验吧!(现在ipidea在做活动,新用户注册可以免费试用,包括住宅代理IP、数据中心代理IP、动态代理IP等产品)

https://share.ipidea.net/KHs5Rj

这篇关于如何利用IP代理高效采集产品数据,打造爆品?的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!