本文主要是介绍如何简单上手清华AutoGPT并搭建到本地环境,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

一、准备工作

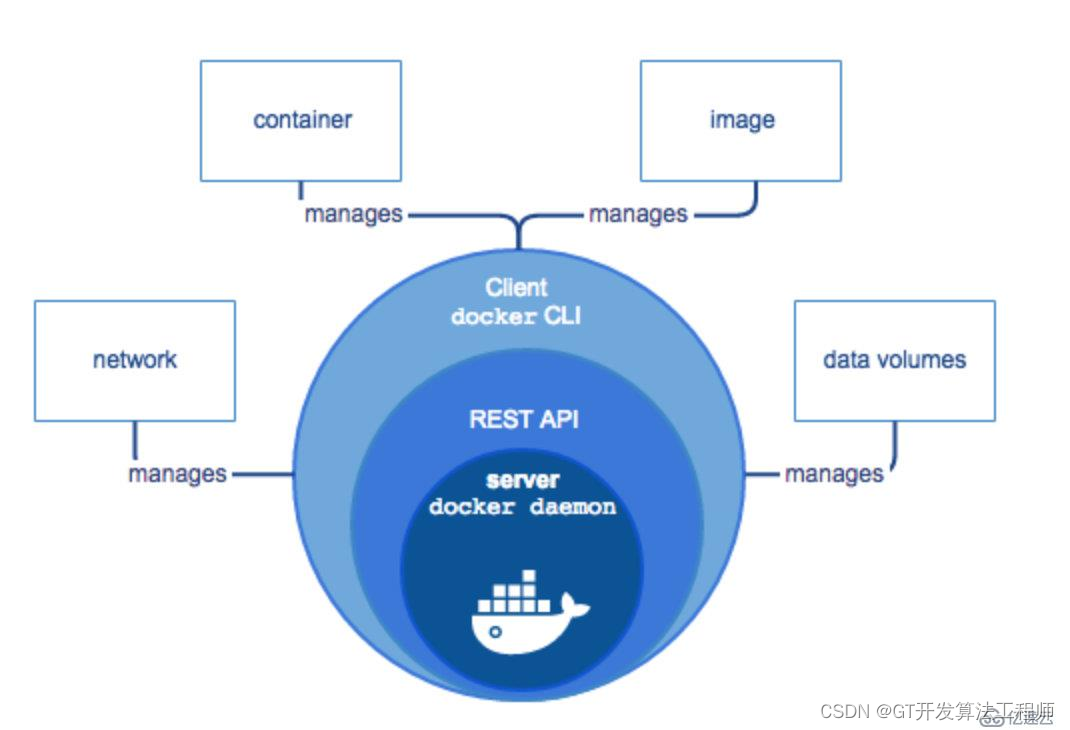

安装Docker:确保你的本地机器上已经安装了Docker。如果还没有安装,请访问Docker官方网站并按照指引进行安装。--点击进入Docker官网

获取清华AutoGPT的Docker镜像:清华AutoGPT团队可能已经提供了一个Docker镜像,方便用户快速部署。你可以在Docker Hub或其他镜像仓库上搜索

autogpt或清华大学的镜像,并获取相应的镜像。--点击获取镜像

目录

一、准备工作

二、搭建清华AutoGPT到本地环境

三、使用API:

以下是一个使用Python和requests库调用API的示例:

四、注意事项

# 假设清华AutoGPT的Docker镜像名为autogpt-docker

docker pull autogpt-docker二、搭建清华AutoGPT到本地环境

- 运行Docker容器:使用Docker运行清华AutoGPT的容器。

- 你可以根据需要设置一些环境变量,如端口号等。

# 运行清华AutoGPT的Docker容器

# -p 参数映射容器内的端口到宿主机端口

# --name 为容器指定一个名称

# -v 参数可以挂载本地目录到容器内,方便数据持久化

docker run -p 8000:8000 --name autogpt -v /path/to/data:/data autogpt-docker

- 访问Web界面:如果清华AutoGPT提供了Web界面,你现在可以通过浏览器访问

http://localhost:8000来体验其功能。

三、使用API:

- 如果清华AutoGPT提供了API接口,你可以通过编写代码来调用这些API。

-

以下是一个使用Python和

requests库调用API的示例:

import requests

import json # 设置API的URL

api_url = "http://localhost:8000/api/generate" # 准备请求数据

data = { "prompt": "请写一篇关于清华AutoGPT的文章。", # 其他可能需要的参数,如模型选择、生成长度等

} # 发送POST请求

response = requests.post(api_url, json=data) # 检查响应状态

if response.status_code == 200: # 解析响应内容 generated_text = response.json().get("generated_text") print(generated_text)

else: print("请求失败,状态码:", response.status_code)四、注意事项

- 确保你的Docker安装正确,并且有足够的权限来运行容器。

- 如果清华AutoGPT的Docker镜像需要特定的环境变量或配置,请确保在运行容器时进行相应的设置。

- 调用API时,请确保遵循清华AutoGPT的API文档,正确设置请求参数和处理响应。

通过上述步骤,你应该能够简单上手清华AutoGPT,并将其搭建到本地环境中。利用Docker,我们可以轻松地部署和管理这个强大的自然语言处理模型。现在,你可以开始探索清华AutoGPT的各种功能了!

这篇关于如何简单上手清华AutoGPT并搭建到本地环境的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!