本文主要是介绍乐鑫特权隔离机制 #1 | 介绍,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

乐鑫特权隔离机制 系列文章 #1

目录

介绍

乐鑫特权隔离机制的亮点

技术细节

1. 应用程序的启动过程

2. World 控制器和权限控制

3. CPU 的世界切换

4. 内存布局

5.系统访问接口

6. API 一致性

7. 用户空间异常处理

8. 设备驱动程序

优势

入门指南

通常,微控制器 (MCU) 上运行的应用程序均采用单体式系统 (Monolithic system),即其“用户-内核”是不隔离的。为改变这种情况,我们一直尝试为 MCU 增加权限管理特性(如通用操作系统)。

这个目标并不容易,我们需要保证对系统的改变不会影响终端应用程序的开发,比如电脑和手机上的应用程序开发与硬件系统就是相互独立的:即底层操作系统负责完成关键任务,而终端应用程序仅使用操作系统开放的接口。

我们围绕这个目标开展了大量工作:首先在 ESP32 上进行了概念验证,但后来意识到这种纯软件层面的隔离存在一定局限,离不开强大的硬件支持。我们只有在硬件级别强制执行权限管理,才能更好地实现用户应用程序和内核应用程序之间的隔离。在此基础上,我们开始在 ESP32-C3 中设计自己的专用外围设备(详见下文)。现在,经过一系列头脑风暴和大量的开发工作,我们终于可以与您分享这个激动人心的消息,即乐鑫特权隔离机制的发布!

介绍

传统上,任何基于乐鑫芯片和 ESP-IDF 开发的应用程序均为单体式固件,即其“内核”组件(操作系统、网络传输等)与“应用程序”或“业务逻辑”之间并不相互独立。如今,在乐鑫特权隔离框架之下,我们成功将固件划分为两个独立的 bin 文件:受保护的“内核”和用户“应用程序”。

乐鑫特权隔离机制的亮点

- 支持两个独立的执行环境:安全世界和非安全世界。

- 将单体式固件划分为两个独立的固件:受保护(安全)应用程序和用户(非安全)应用程序。

- 受保护的应用程序不受用户应用程序异常的影响。

- 提供标准系统调用接口,允许用户应用程序通过这些接口发起内核服务访问请求。

- 保持与 ESP-IDF API 的一致性。

- 支持可配置的内存访问权限和外设访问权限。

- 支持在受保护的应用程序和用户应用程序之间灵活分配内存。

技术细节

1. 应用程序的启动过程

在 ESP 权限隔离框架下,应用程序的启动流程与 ESP-IDF 一致,即Boot ROM(一级引导加载程序)首先进行验证,并从 flash 中加载 ESP-IDF 二级引导加载程序。然后,二级引导加载程序进行验证,并加载受保护的应用程序。最后,受保护的应用程序在 flash 中寻找有效的用户应用程序入口 (header)。如找到,则将设置适当的权限,并尝试验证并加载用户应用程序。

2. World 控制器和权限控制

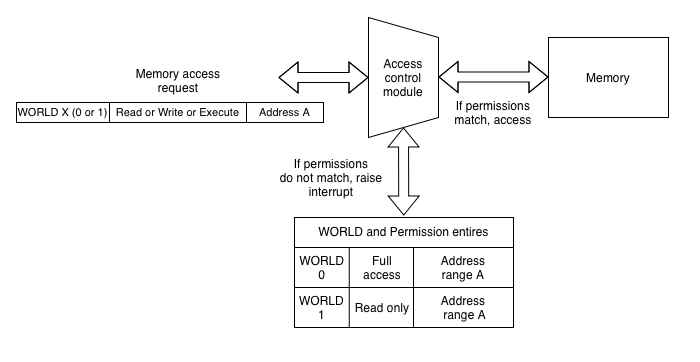

乐鑫特权隔离机制框架的主要目标是实现特权分离和强制权限管理。在 ESP32-C3 中,这是通过 World 控制器和权限管理控制器实现的。具体来说,权限管理控制器管理所有权限,而 World 控制器管理执行环境(世界),且每个世界中均有独立的权限配置。目前,我们有两个世界:World0 和 World1。

World0 是安全(受保护)环境,World1 是非安全(用户)环境。

World 和权限管理

如上图所示:

- 安全世界 (World0) 拥有对地址段 A 的全部访问权限

- 非安全世界 (World1) 仅拥有对地址段 A 的读权限

在这种权限配置下,如果非安全世界试图向地址段 A 中的任何地址进行写操作,则将触发非法访问中断。安全世界将处理这个非法访问中断,并采取适当措施。

3. CPU 的世界切换

- 从安全世界切换到非安全世界:CPU 可以从安全世界切换到非安全世界,此时仅需将需要切换的地址配置至 World 控制器的地址寄存器,接着当 CPU 执行至该地址时即可从安全世界切换到非安全世界,此后在非安全世界执行应用程序。

- 从非安全世界切换到安全世界:CPU 可以从非安全世界切换至安全世界,但只能通过中断或异常,即系统中发生任何中断都会导致 CPU 切换到安全世界。

4. 内存布局

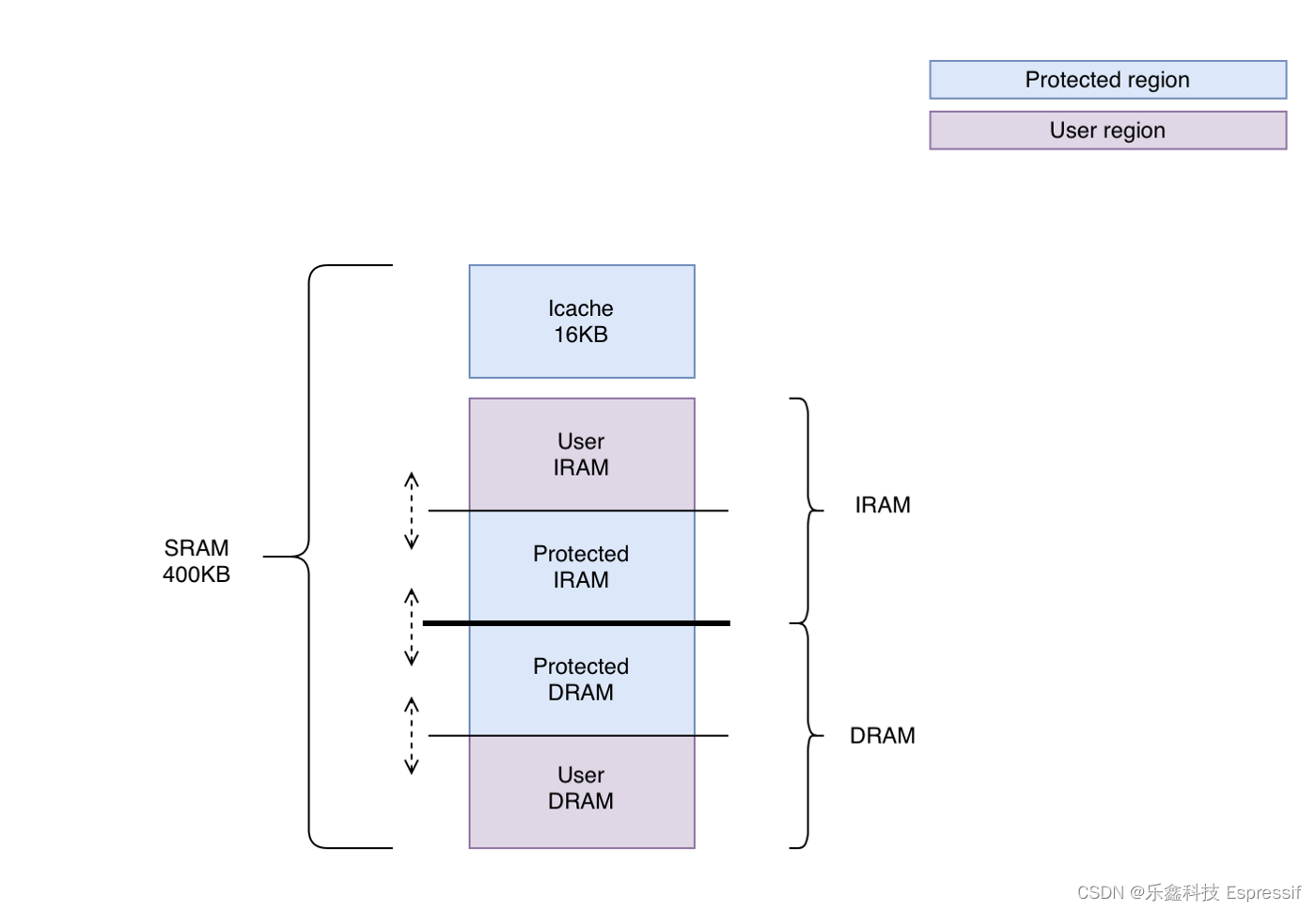

在强制执行权限管理后,下一步是分割内存。

内部 SRAM:

下图展示了如何划分 SRAM,供受保护的应用程序和用户应用程序使用。SRAM 分为 IRAM 和 DRAM,可以根据应用程序的使用情况进行非常灵活的配置。

DRAM 区域包含对应应用程序的 .data 和 .bss 段,其余部分用作堆。在乐鑫特权隔离框架下,每个受保护的应用程序和用户应用程序均有一个专用的堆分配器。

这种 SRAM 内存分布可以在受保护的应用程序升级后,依然很好地使用内存。此时,一旦受保护应用程序使用的 IRAM 有所增加或减少,我们均可以重新配置 IRAM-DRAM 分割线,且并不用影响用户内存的划分情况。

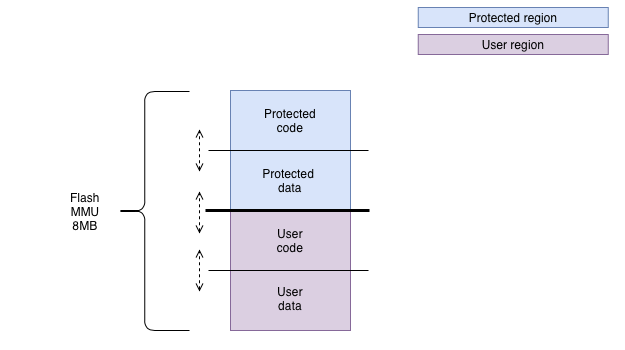

外部 flash:

下图展示了如何在受保护的应用程序和用户应用程序之间分割 flash 虚拟内存。与内存分割一样,flash MMU 地址段也分为 .rodata 和 .text 区域,可进行灵活配置。

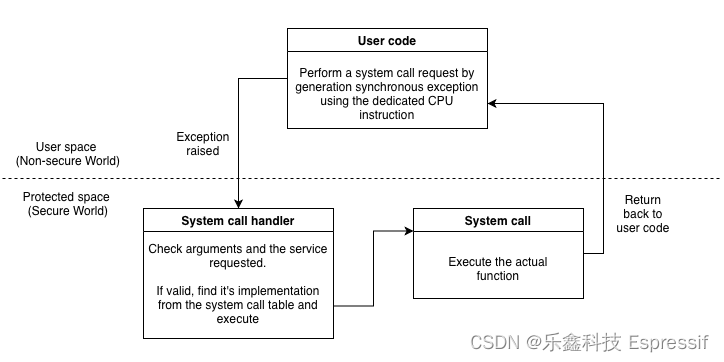

5.系统访问接口

受保护的应用程序提供了一个标准的“系统调用”接口,用户应用程序可以通过该接口请求访问内核服务。这个过程会使用一个特殊的 CPU 指令生成一个同步异常,并通过这个异常将控制权移交给受保护的应用程序。系统调用处理程序将仔细检查请求,并相应地执行操作。下图概述了系统调用接口的实现过程:

系统调用执行过程

6. API 一致性

对于大多数组件,受保护的应用程序和用户应用程序均与 ESP-IDF API 保持一致。通过系统调用接口开放给用户应用程序的组件必须使用系统调用实现,而不是实际功能实现。我们利用链接器的特点,使用系统调用定义覆盖 API 的定义。这种与 ESP-IDF API 的一致性可以确保:

- 轻松将 ESP-IDF 示例应用程序(仅需少量修改)移植到此框架。

- 同一个程序可以构建为受保护的应用程序或用户应用程序。

7. 用户空间异常处理

在完成权限配置和内存分割后,可能会出现用户应用程序故意或无意尝试访问受保护禁区的情况。此时,权限控制器会触发一个非法访问中断,由受保护的应用程序处理。这种强制执行权限管理的好处是,受保护的空间内存和应用程序不会受到用户应用程序任何(错误)行为的影响。在乐鑫特权隔离框架中,我们允许受保护的应用程序注册专门的处理程序,以应对用户应用程序中出现的任何异常。这个处理程序还可以收集一些重要信息,并相应地处理异常。

8. 设备驱动程序

用户应用程序可能需要通过外围设备(SPI、I2C 等)才能与外部设备和传感器通信。在乐鑫特权隔离框架中,我们将设备驱动实现在受保护的应用程序中,并通过标准 I/O 系统调用(open, read, write 等)的方式,将其开放给用户应用程序。这样一来,我们可以通过一组公共的系统调用接口,实现多个设备驱动程序。

此外,也可以向用户应用程序开放对外设寄存器的访问权限,允许用户应用程序写自己的驱动程序。

优势

乐鑫特权隔离机制可以实现一些此前传统单体式方法通常无法实现的用例和场景,以下为一些例子:

- 隔离系统和业务逻辑,从而分离维护软件的责任划分。

- 业务逻辑(用户应用程序)中的任何错误都不会影响整个系统。用户空间中的此类异常由受保护的应用程序捕获并进行相应处理,并且允许实时收集并传输诊断信息(如果需要)。

- 可以独立管理受保护应用程序和用户应用程序的 OTA (空中升级)更新。只要两者的接口相互兼容,受保护的应用程序和用户应用程序可以有不同的发布节奏。

- 从认证角度来说,仅需认证一次受保护的应用程序并进行分发,之后的用户应用程序均可基于此已认证的受保护应用程序进行构建。

- 设备可同时保留多个用户应用程序,并使用同个受保护应用程序进行执行。

入门指南

目前,该项目仍处于 beta 阶段,相关研发也正在积极进行中,我们同时也在解决一些限制和瓶颈。如遇到任何问题或 bug,请与我们联系。如遇到任何问题或有任何反馈,请在 GitHub 上提出 issue。我们也欢迎开发者积极提交 PR,帮助我们不断完善这一框架。

乐鑫特权隔离框架是完全开源的,可在 乐鑫特权隔离仓库获得。更多相关技术文档和演练,请访问这里。

我们希望这种创新应用程序开发方式可以助您打开新的思路,也热切盼望您的反馈。

这篇关于乐鑫特权隔离机制 #1 | 介绍的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!