本文主要是介绍图节点嵌入:编码器-解码器(cs224w笔记-lecture3.1),希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

文章目录

- 图表示学习(graph representation learning)

- 节点嵌入(embedding nodes)

- 节点嵌入步骤

- 节点相似度

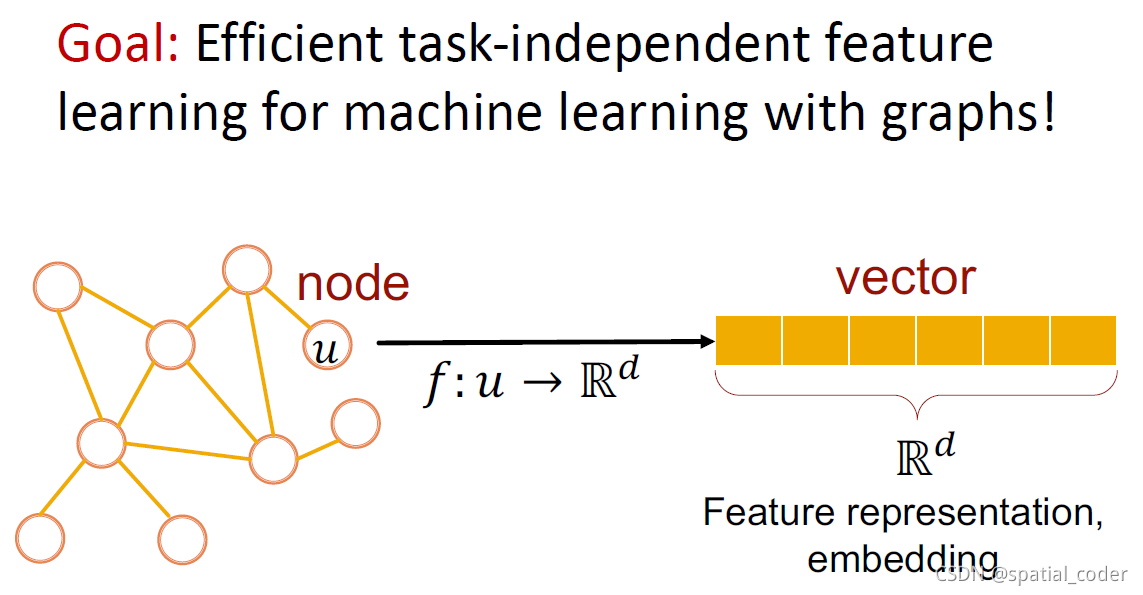

节点嵌入是一种 无监督或自监督的学习方式,且嵌入具有 任务独立的特点,即不针对特定任务,而是可以用于任何任务。

图表示学习(graph representation learning)

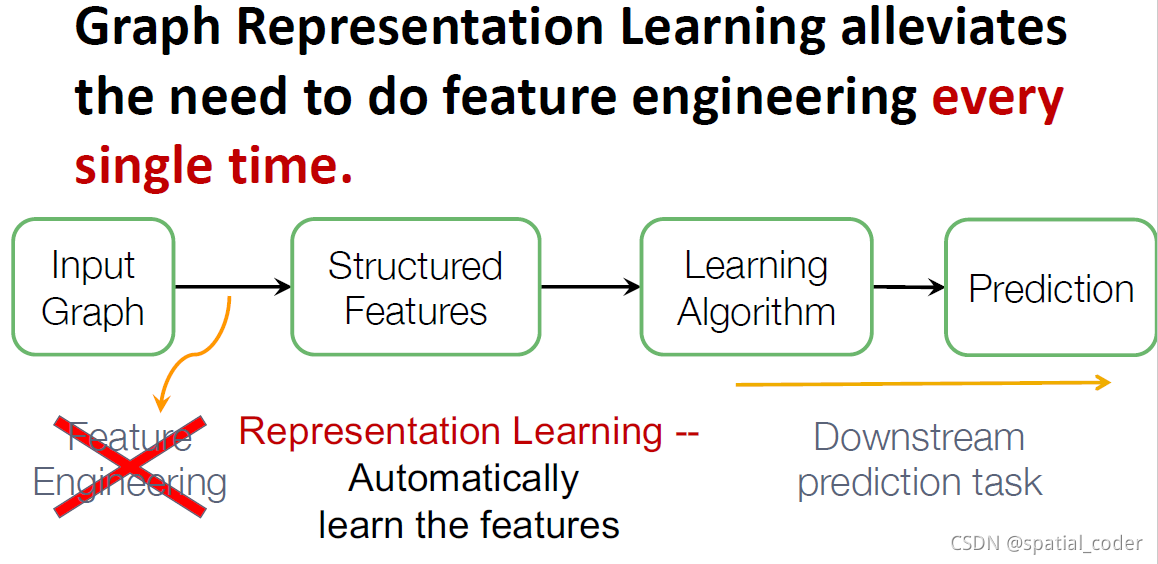

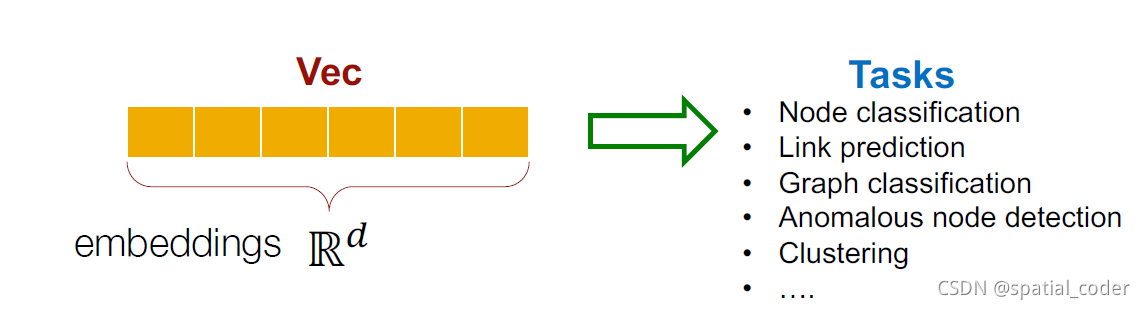

图表示学习的意义在于消除每次需要手工特征工程的繁琐,为在图上进行机器学习生成有效的、任务独立(task independent)的特征表示,用于节点分类、链接预测、图分类、异常节点检测、聚类等下游任务。

节点嵌入(embedding nodes)

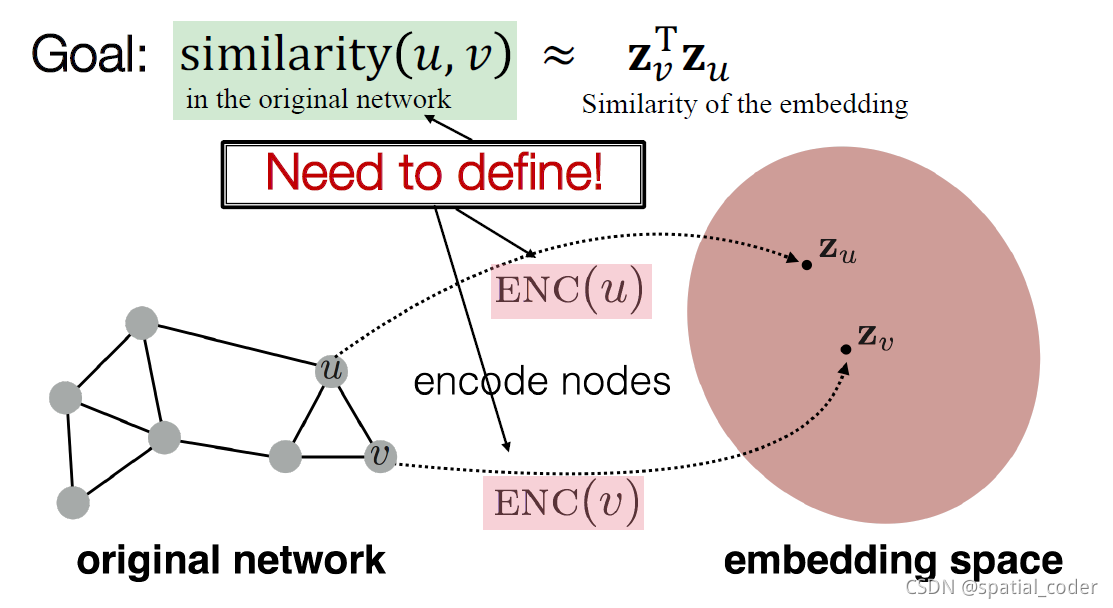

节点嵌入的目的是对图的节点进行编码,使得节点在嵌入空间(embedding space)的相似度近似节点在图中的相似度.

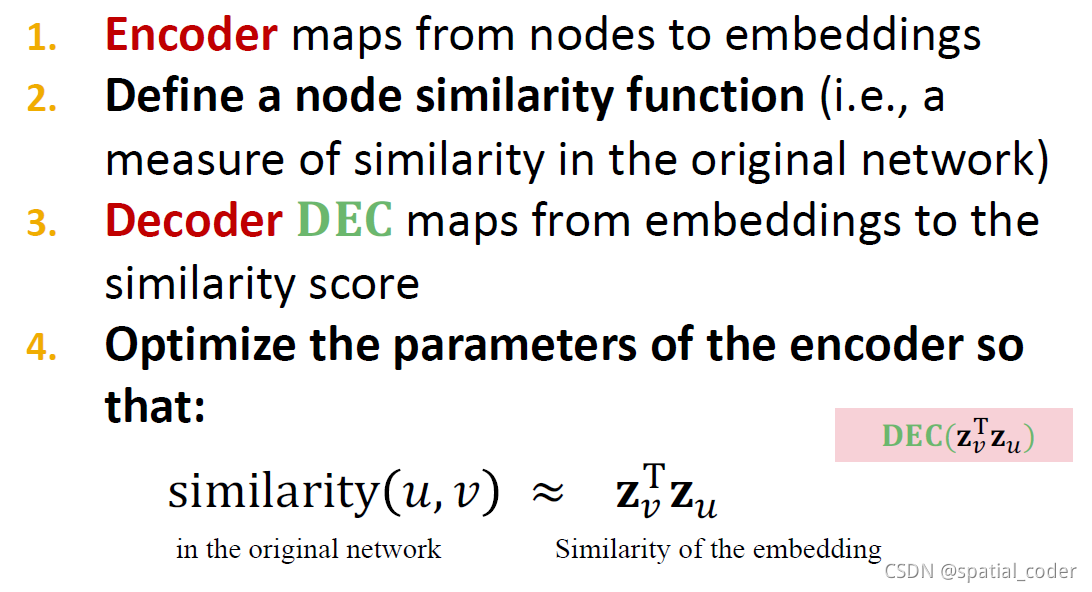

节点嵌入步骤

- 编码器将节点隐射为嵌入向量;

- 定义节点相似度函数,度量节点在原网络的相似度;

- 解码器将嵌入向量隐射为相似度分数;

- 寻找最优的编码器参数,使得节点在嵌入空间的相似度接近节点在原始网络中的相似度。

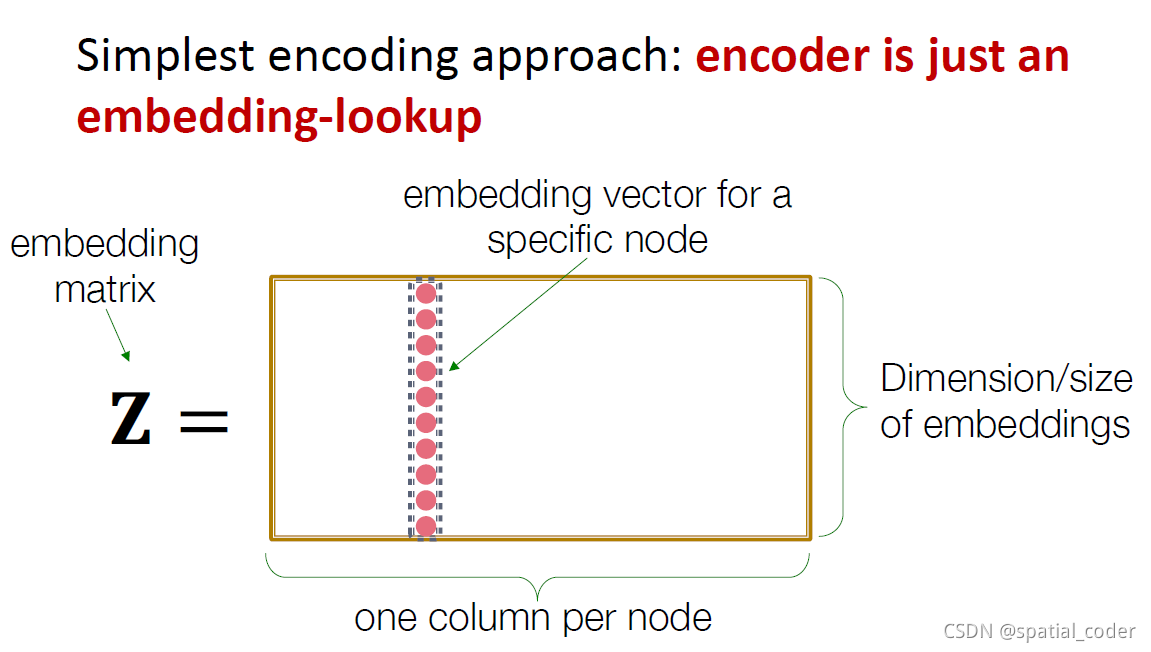

一个简单的编码器(shallow encoder)可以看成是一个嵌入向量的查找表,每列是对一个特定节点的嵌入向量,行数代表嵌入的维度。每行是由每个节点组成。每个节点被分配对应一个独特的嵌入向量(embedding vector)。

解码器基于相似度定义,目标是对于节点对 ( U , V ) (U,V) (U,V)最大化 Z v T Z u Z_v^TZ_u ZvTZu。

节点相似度

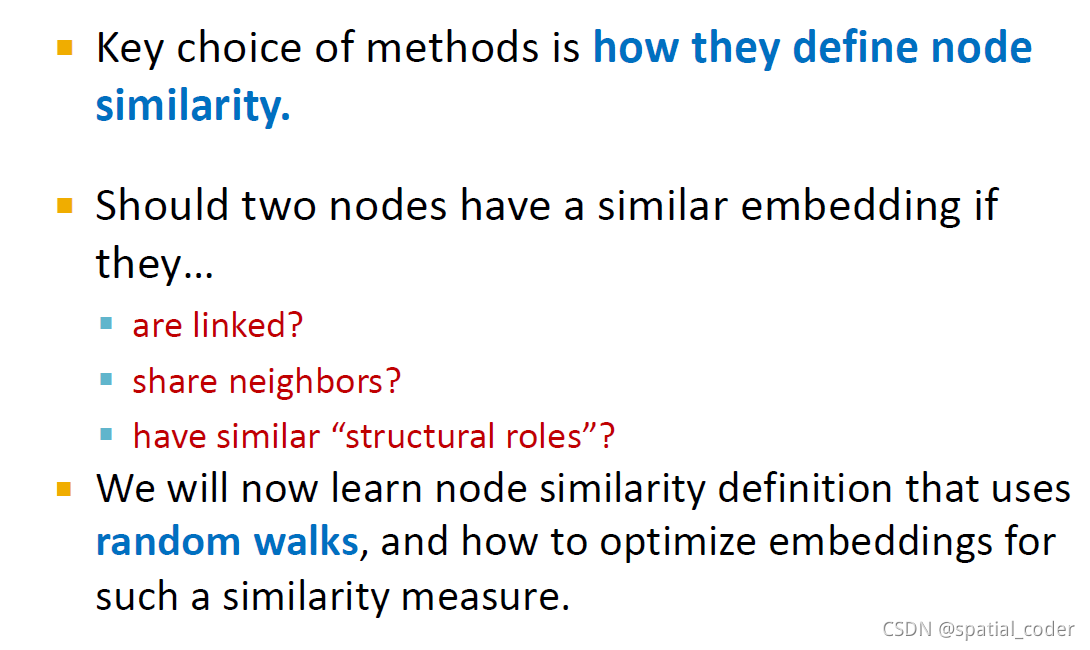

选择节点嵌入方法的关键是如何定义节点的相似度。

这篇关于图节点嵌入:编码器-解码器(cs224w笔记-lecture3.1)的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!