本文主要是介绍关于元学习收集资料杂乱整理2021.9.11,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

元学习论文:https://github.com/rootlu/MetaLearning-Papers

应用于 NLP 领域的 Meta/few-shot 学习方法的最新论文列表:https://github.com/ha-lins/MetaLearning4NLP-Papers (自己准备看对话系统和文本分类)

Dialog System

Learning to Customize Model Structures for Few-shot Dialogue Generation Tasks. Yiping Song, Zequn Liu, Wei Bi, Rui Yan, Ming Zhang ACL 2020. [pdf][code]

Meta-Reinforced Multi-Domain State Generator for Dialogue Systems. Yi Huang, Junlan Feng, Min Hu, Xiaoting Wu, Xiaoyu Du, Shuo Ma ACL 2020. [pdf]

Learning Low-Resource End-To-End Goal-Oriented Dialog for Fast and Reliable System Deployment. Yinpei Dai, Hangyu Li, Chengguang Tang, Yongbin Li, Jian Sun, Xiaodan Zhu ACL 2020[short]. [pdf]

Domain Adaptive Dialog Generation via Meta Learning. Kun Qian, Zhou Yu. ACL 2019. [pdf] [code]

Meta-Learning for Low-resource Natural Language Generation in Task-oriented Dialogue Systems. Fei Mi, Minlie Huang, Jiyong Zhang, Boi Faltings. IJCAI 2019. [pdf]

Personalizing Dialogue Agents via Meta-Learning. Zhaojiang Lin, Andrea Madotto, Chien-Sheng Wu, Pascale Fung. ACL 2019[short]. [pdf] [code]

Dialogue Generation on Infrequent Sentence Functions via Structured Meta-Learning. Yifan Gao, Piji Li, Wei Bi, Xiaojiang Liu, Michael R. Lyu, Irwin King. EMNLP 2020[fingdings]. [pdf]

Graph Evolving Meta-Learning for Low-resource Medical Dialogue Generation. Shuai Lin, Pan Zhou, Xiaodan Liang, Jianheng Tang, Ruihui Zhao, Ziliang Chen, Liang Lin. AAAI 2021. [pdf][code]

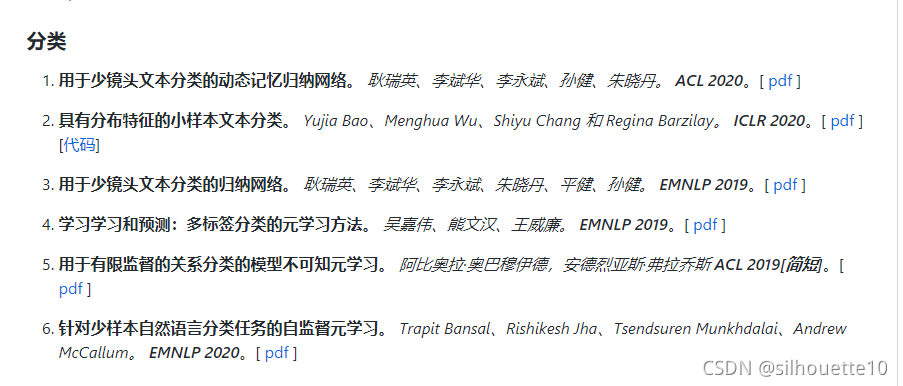

Classification

Dynamic Memory Induction Networks for Few-Shot Text Classification. Ruiying Geng, Binhua Li, Yongbin Li, Jian Sun, Xiaodan Zhu. ACL 2020. [pdf]

Few-shot Text Classification with Distributional Signatures. Yujia Bao, Menghua Wu, Shiyu Chang and Regina Barzilay. ICLR 2020. [pdf] [code]

Induction Networks for Few-Shot Text Classification. Ruiying Geng, Binhua Li, Yongbin Li, Xiaodan Zhu, Ping Jian, Jian Sun. EMNLP 2019. [pdf]

Learning to Learn and Predict: A Meta-Learning Approach for Multi-Label Classification. Jiawei Wu, Wenhan Xiong, William Yang Wang. EMNLP 2019. [pdf]

Model-Agnostic Meta-Learning for Relation Classification with Limited Supervision. Abiola Obamuyide, Andreas Vlachos. ACL 2019[short]. [pdf]

Self-Supervised Meta-Learning for Few-Shot Natural Language Classification Tasks. Trapit Bansal, Rishikesh Jha, Tsendsuren Munkhdalai, Andrew McCallum. EMNLP 2020. [pdf]

以后找相关论文的地方:

发现一个网址总结了各个方向的论文:https://www.aminer.cn/topic

比如搜索元学习:https://www.aminer.cn/topic?sort=num_view&page=1&query=%E5%85%83%E5%AD%A6%E4%B9%A0

0、【元学习】Meta Learning 介绍

https://www.cnblogs.com/xxxxxxxxx/p/11695044.html

1、元学习与自然语言处理

2019年三篇NLP和自然语言处理的应用:

1)Domain Adaptive Dialog Generation via Meta Learning, ACL2019

讲述的是任务型对话系统面向的领域和应用很多,这就对数据有了要求。希望能够对于较少的样本也能达到效果较好的域自适应的任务型对话生成模型。提出DAML。

2)Personalizing Dialogue Agents via Meta-Learning, ACL2019

个性化对话系统需要在较少的数据上迅速调整为针对特定用户的定制模型。采用MAML。

3)Meta Relational Learning for Few-Shot Link Prediction in Knowledge Graphs, EMNLP2019

通过元学习方式解决少样本条件下的知识图谱链接预测问题。

2、如何快速水一篇NLP论文

介绍了两篇论文:

1)Domain Adaptive Dialog Generation via Meta Learning, ACL2019

2)Graph Evolving Meta-Learning for Low-resource Medical Dialogue Generation, AAAI 2021.

低资源场景下的医疗对话系统的工作,旨在通过元学习构建一个跨疾病可迁移的对话系统。该对话系统包含三个组件:分层上下文编码器、元知识图推理模块与图指导的响应生成器;同样还是类似MAML的思路,只不过针对现有知识图谱对对话实体覆盖不全的问题,本文还通过graph evolving的方法对知识图谱进行丰富。

通过这两个工作和paper list,可以看到以「MAML」为代表的optimization-based meta learning方法,以其模型无关的灵活性的特点,在各个NLP topic(如:dialog system/ semantic parsing等)的few-shot场景下遍地开花,而其他的meta-learning方法(如metric-based)多集中在解决分类问题上。如何在少量数据场景下构造出合理的meta task,是解决问题的关键。

3、基于元学习的现实场景应用论文介绍

两篇基于元学习方法在现实场景的应用论文。

1)Relation-aware Meta-learning for Market Segment Demand Prediction with Limited Records

应用场景:大型电子商务平台

新的框架RMLDP,以解决细分市场的需求预测任务。RMLDP结合了一个具有元学习范式的多模式融合网络。在元学习范式中,进一步提取片段关系以定制模型参数初始化。并将所提出的方法应用于在线平台。

2)Learning from Multiple Cities: A Meta-Learning Approach for Spatial-Temporal Prediction

应用场景:智慧城市建设

提出了一个新的MetaST框架,通过将时空网络与元学习范式相结合来解决问题。

4、元学习相关的经典文章、代码、书籍、博客、视频教程、数据集等其他资源,提供给需要的朋友

简单列出了上述内容,论文未标明出处。

5、初探元学习 2021.9.11晚看

写的挺好的。

什么是元学习;其与机器学习和迁移学习的区别;在数学上的定义;元学习的基本问题可分三类;元学习的分类/方法;

文中参考的博客文章都要细看。

元学习:学会快速学习:https://www.bilibili.com/read/cv4310739/

综述:

1、一篇元学习综述的总结《Meta-Learning in Neural Networks: A Survey》:https://mp.weixin.qq.com/s/QLzdW6CMkcXWQbGjtOBNwg

https://zhuanlan.zhihu.com/p/261170127?utm_source=cn.wiz.note

http://www.360doc.com/content/20/1028/18/32196507_942850516.shtml

http://www.360doc.com/content/20/1028/18/32196507_942850516.shtml

2、小样本学习领域的综述《Generalizing from a Few Examples: A Survey on Few-Shot Learning》

https://blog.csdn.net/z704630835/article/details/103959490

https://blog.csdn.net/algorithmPro/article/details/106184414

https://zhuanlan.zhihu.com/p/129786553

3、

3、https://zhuanlan.zhihu.com/p/64775132

4、文中提了两篇综述

https://blog.csdn.net/weixin_41803874/article/details/89847811

5、《A Survey of Deep Meta-Learning》

https://zhuanlan.zhihu.com/p/264402151

6、元学习(Meta-Learning) 综述及五篇顶会论文推荐

https://blog.csdn.net/weixin_41803874/article/details/89920370

1)微分凸优化元学习 ,CVPR 2019 Oral

2)无监督元学习,ICLR 2019

3)在线元学习

4)多城市学习:时空预测的元学习方法,WWW2019

5)通过元学习进行图神经网络对抗攻击,ICLR 2019

7、计算机学报的元学习研究综述

http://cjc.ict.ac.cn/online/onlinepaper/lfz-2021128205230.pdf

其他:

ACL2020放榜!事件抽取、关系抽取、NER、Few-Shot相关论文整理~

AAAI2021中事件抽取、关系抽取、NER、NLP相关的Few-Shot和Zero-Shot论文整理

一文速览 | ACL 2021 主会571篇长文分类汇总

如何通过元学习解决小样本图像分类任务

通过改进特征提取算法和匹配算法,每年都会产生许多新的度量学习方法。

说实话,在主流小样本图像分类的评价标准上,MAML目前性能不如度量学习。由于它的两级训练过程,在实践中训练难度很大,因此超参搜索要比普通模型复杂得多。另外,元反向传播需要计算梯度的梯度,所以目前只能通过计算其近似值才能在标准GPU上进行训练。出于这些原因,大家在实际应用中可能更愿意使用度量学习算法。

但之所以MAML模型受到那么多关注,是因为它是模型不可知的。这意味着它实际上可以应用于任何神经网络,任何任务。掌握MAML意味着能够训练任何一个神经网络,使其快速适应新的任务,而且只需要很少的训练样本。MAML的作者Chelsea Finn和Sergey Levine,将其应用于有监督的小样本分类、有监督的回归和强化学习。但只要多努努力,你就可以用它把任何一个神经网络转换成一些高效的神经网络!

元学习研究的进展与未来——VALSE Webinar 21-10期观看笔记

入门 | 从零开始,了解元学习 已看

《Meta-Learning a Dynamical Language Model》

A Simple Neural Attentive Meta-Learner

学习如何学习的算法:简述元学习研究方向现状

这篇关于关于元学习收集资料杂乱整理2021.9.11的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!