本文主要是介绍算力-计算量,关于TOPS和FLOPS,及FLOPs,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

目录

一、易混淆的三个点

二、芯片算力单位详解

四、模型算力单位详解

五、算力单位量级变换

六、计算机存储单位换算

七、科学计算单位换算

一、易混淆的三个点

关于TOPS和FLOPS,及FLOPs,这里有3个易混淆的点。

1、最大的混淆点,上述三个名词是两种东西,注意“S/s”的大小写。TOPS和FLOPS指的是每秒的计算量,算是速度方面的,用在芯片算力性能上。FLOPs指的是自身的计算量,算是体量方面的,用在深度学习模型本身参数计算量上。

2、针对算力速度方面的TOPS和FLOPS,其中OPS指的是每秒处理次数,但通常是默认对INT8整型数的处理次数(INT8省略不写),加上FL后FLOPS指的是对FP32浮点数的处理次数。

3、仍然是针对算力速度方面的TOPS和FLOPS,这里的T指的是量级(Tera ,万亿,10^12),同理TFLOPS专门指每秒对浮点数处理的达到多少万亿次数。

二、芯片算力单位详解

通过缩写就能发现其中的奥妙。

| 芯片速度类 | 基础单位 | OPS | (operations per second) | 每秒处理次数,通俗是对INT8类型的操作次数,整型默认省略。 |

| FLOPS | Floating point number operations per second | 是指浮点数每秒处理的次数,通常是FP32,浮点着重强调。 | ||

| 量级单位 (万亿次) | TOPS | Tera operations per second | 每秒可以处理的整型运算的万亿次数(10^12次) | |

| TFLOPS | Tera Floating point number operations per second | 每秒对浮点数处理的达到多少万亿次数 | ||

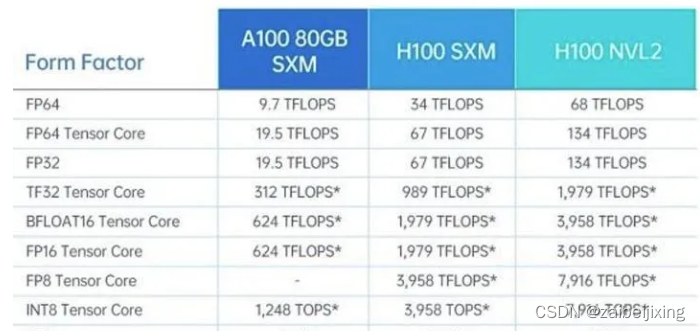

下图为nvidia-A100/H100部分算力信息,可对比TOPS/TFLOPS区别。

四、模型算力单位详解

| 模型体量类 | FLOPs | Floating point number operations | 模型参数的处理次数。衡量模型参数计算量 |

以基础的分类卷积神经网络为例:

| AlexNet | 对于AlexNet处理224*224的图像,需要1.4G FLOPS |

| ResNet-152 | 对于224*224的图像,ResNet-152需要22.6G FLOPS |

五、算力单位量级变换

MOPS (Million Operation Per Second) 一百万次(10^6) 兆;百万

GOPS (Giga Operations Per Second) 十亿次 (10^9) 千兆;十亿(billion,B)

TOPS (Tera Operations Per Second) 一万亿次 (10^12) 兆兆

| 1 MOPS = 10^6 FLOPS | 一个MFLOPS(megaFLOPS)等于每秒一百万 (=10^6)次的浮点运算, |

| 1 GOPS = 10^9 FLOPS | 一个GFLOPS(gigaFLOPS)等于每秒十亿 (=10^9)次的浮点运算, 十亿(部分地方可能会用billion,B) |

| 1 TOPS = 10^12 FLOPS | 一个TFLOPS(teraFLOPS)等于每秒一万亿 (=10^12)次的浮点运算,(1太拉) |

| 注意:这个地方有时候加不加FL比较含糊,很多厂家和个人有时候没有专门写明,一般先关注量级即可 | |

六、计算机存储单位换算

1Byte=8bit

1KB=1024Byte(字节)=8*1024bit

1MB=1024KB

1GB=1024MB

1TB=1024GB tera(梯)单位标示:T/TB

七、科学计算单位换算

| 10^15 | 拍[它] | P | peta |

| 10^12 | 太[拉](万亿) | T | tera |

| 10^9 | 吉[咖](十亿) | G | giga |

| 10^6 | 兆(百万) | M | mega |

| 10^3 | 千 | k | kilo |

这篇关于算力-计算量,关于TOPS和FLOPS,及FLOPs的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!